Clear Sky Science · ja

負のホットラベル符号化とクラス重みマスキングによる特徴非識別型機械忘却

機械に忘れさせることが重要な理由

写真のタグ付けから医用画像解析まで、現代のアプリケーションは膨大なデータセットで訓練された強力な画像認識システムに依存しています。しかし、誰かが自分のデータを削除してほしいと求めたり、データセットに偏りや安全性の問題が見つかったりしたらどうなるでしょうか。現在のニューラルネットワークには単純な「削除」ボタンはありません。本論文は、学習済みモデルに特定のカテゴリのデータを“忘れさせる”現実的な方法を提示し、他の知識は大部分そのまま保持することを目指します。

無視するだけでなくデータを消去する必要があるとき

EUの一般データ保護規則(GDPR)などの法律は「忘れられる権利」を個人に与えており、組織は単にファイルの保存をやめるだけでなく、モデルから特定のデータの影響を取り除く必要が生じます。大規模なニューラルネットワークを完全に再訓練するのは遅く高価であり、元のデータが完全に利用できない場合は不可能なこともあります。既存の「機械的忘却」手法は役立ちますが、しばしば全訓練セットへのアクセスを要求したり、重い数値計算を伴ったり、残されたデータに対する性能を著しく損なったりします。著者たちは、ターゲットを絞り、効率的で、モデルの有用な知識に優しい手法を設計することを目指しました。

望ましくない記憶をぼかす新しいレシピ

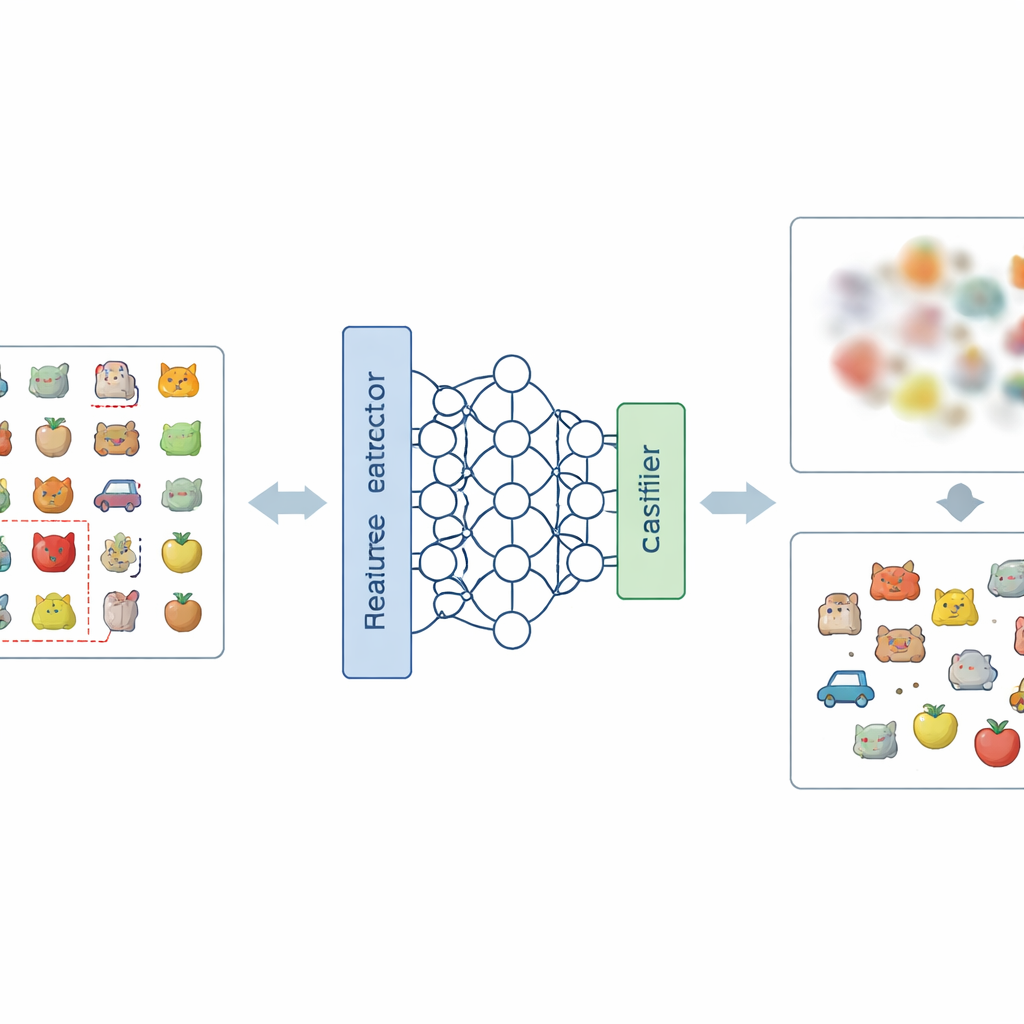

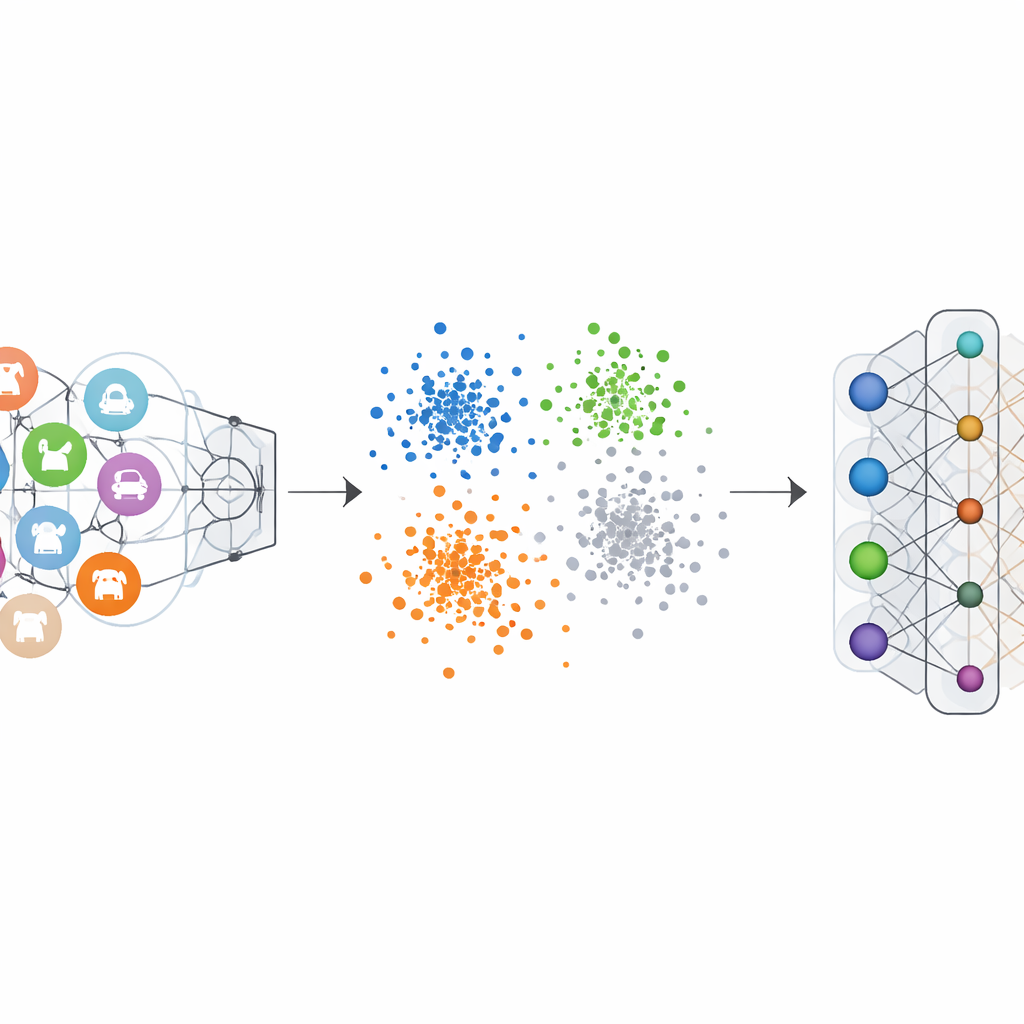

この論文の核となる発想は、ネットワークが画像を内部で表現する方法と、最終的に判断を下す方法の両面から問題に取り組むことです。表現レベルでは、著者らは「負のホットラベル符号化(Negative-Hot Label Encoding)」という新しいラベル符号化法を導入します。忘れさせたいカテゴリを強化する代わりに、それをほとんど「反クラス」のように扱う方式です。除去対象カテゴリのごく少数の画像だけを用いた短い微調整フェーズで、そのカテゴリの画像に対するネットワークの内部表現が特徴的でなくなり、他のクラスとより絡み合うように促されます。判断レベルではクラス重みマスキング(Class Weight Masking)を加え、忘却対象のカテゴリに関連する最終的な結合を選択的に弱めて出力への直接的影響を切ります。

負のラベルがカテゴリを弱める仕組み

通常の画像分類器は「ワンホット」ラベルで訓練されます:正しいクラスを強調し、他はゼロにすることで、ネットワークは各カテゴリの明確な境界を切り拓こうとします。負のホットラベル符号化は、消去したいカテゴリに対してこの論理を反転させます。忘却中、そのカテゴリには負の寄与が与えられ、残りのカテゴリには小さな正の寄与が与えられます。数学的には、これはかつて忘れられるクラスを特徴付けた勾配更新を反転・増幅し、その特徴を徐々に群集へ押し戻します。ネットワークの内部特徴空間の可視化を見ると、この方式の下では忘れられたクラスの点が緊密に分離したクラスタを形成するのをやめ、周囲の他クラスの雲へと溶け込んでいくことが示されます。

残すものを守りつつ判断の結びつきを切る

ラベルの変更だけでは十分ではありません。ネットワークの初期層を調整すると、他のカテゴリの認識に意図せぬ影響を与える可能性があるからです。クラス重みマスキングは直接的で費用のかからない安全策を提供します。負のラベルでの短い微調整の後、本手法は最終分類器層で忘却対象カテゴリに最も結びついたモデル要素を特定して消音します。このステップにより、そのカテゴリを見分けるモデルの能力は大幅に低下しますが、全訓練例へのアクセスや複雑なグローバル計算を必要としません。両手順を合わせてNHLE–CWMフレームワークを構成します:第一に特徴空間で望ましくない記憶をぼかし、第二に判断への残余の影響を断ち、いずれも削除対象クラスからごく少数のサンプル画像だけで調整されます。

視覚ベンチマークでの多数のテストによる実証

著者らは、このフレームワークを手書き数字、街路の家番号、衣類画像、カラフルな物体写真など、よく知られた複数の画像データセットで、多様な人気ニューラルネットワークアーキテクチャを用いて評価しました。単一クラスおよび多クラスの忘却シナリオの両方で、本手法は忘却対象クラスの精度をほぼゼロまで低下させ、モデルがそれらを認識できなくすることに成功しました。重要なのは、保持されたクラスの精度低下が最大でも数パーセントにとどまり、場合によってはわずかに改善することもあった点です。主要な既存手法との比較では、本アプローチは残存性能へのダメージを抑えつつ、より強い忘却を達成し、しかも忘却対象クラスの少数の例だけで重い計算を避けられることを示しました。

日常のAIにとっての意味

簡潔に言えば、本研究は特定の種類のデータに対して制御された「記憶消去器」をニューラルネットワークに後付けすることが可能であることを示しています。短時間の再訓練中にラベルの使い方を巧妙に変え、ターゲットとなる判断重みをマスクすることで、NHLE–CWMフレームワークは忘れられたカテゴリに対するモデルの見方をぼんやりさせ、かつ非活性化します。利用者や規制当局にとっては、貴重なモデルを廃棄することなく忘れられる権利を実現する現実的な道筋を提供します。実務者にとっては、偏った、時代遅れの、あるいは機微なクラスを除去しつつシステムの残りを維持するためのスケーラブルで計算負荷の小さい手段を提供します。

引用: Wang, J., Bie, H., Jing, Z. et al. Feature-indistinguishable machine unlearning via negative-hot label encoding and class weight masking. Sci Rep 16, 11879 (2026). https://doi.org/10.1038/s41598-026-40379-9

キーワード: 機械的忘却, データプライバシー, 深層学習, 画像分類, モデルの忘却