Clear Sky Science · fr

Sélection de caractéristiques textuelles multi-étiquettes fédérée via modélisation parcimonieuse consciente de la variété et optimisation coopérative de type loup gris

Pourquoi un tri de texte plus intelligent importe

Chaque jour, hôpitaux, salles de rédaction et réseaux sociaux produisent des océans de texte qui doivent être étiquetés par plusieurs sujets simultanément — pensez à un compte rendu médical annoté avec plusieurs maladies, traitements et facteurs de risque. Ce multi-étiquetage facilite la recherche, les recommandations et l’aide à la décision, mais il surcharge aussi les systèmes avec d’immenses listes de mots et d’expressions possibles. L’article présente une nouvelle façon d’extraire uniquement les indices textuels les plus utiles tout en gardant les données des personnes sur leurs propres appareils, dans le but de rendre ces systèmes à la fois plus rapides et plus respectueux de la vie privée.

Couper à travers le bruit

Dans les problèmes de texte multi-étiquettes, chaque document peut appartenir à plusieurs catégories, et ces catégories sont souvent reliées : un article sur la science du climat peut aussi aborder la politique et l’économie. Parallèlement, les représentations textuelles modernes — comme les larges vocabulaires ou les embeddings denses — contiennent des milliers de signaux potentiels, dont beaucoup sont redondants ou sans pertinence. Ce problème du « trop grand nombre de caractéristiques » ralentit l’apprentissage, favorise le surapprentissage et affaiblit les prédictions. Les auteurs se concentrent sur la sélection de caractéristiques, la tâche consistant à trouver un sous-ensemble compact de caractéristiques textuelles informatives, mais ils le font dans un contexte où les données sont réparties sur de nombreux appareils et ne peuvent pas être centralisées sur un serveur unique.

Apprendre la structure sans voir les données

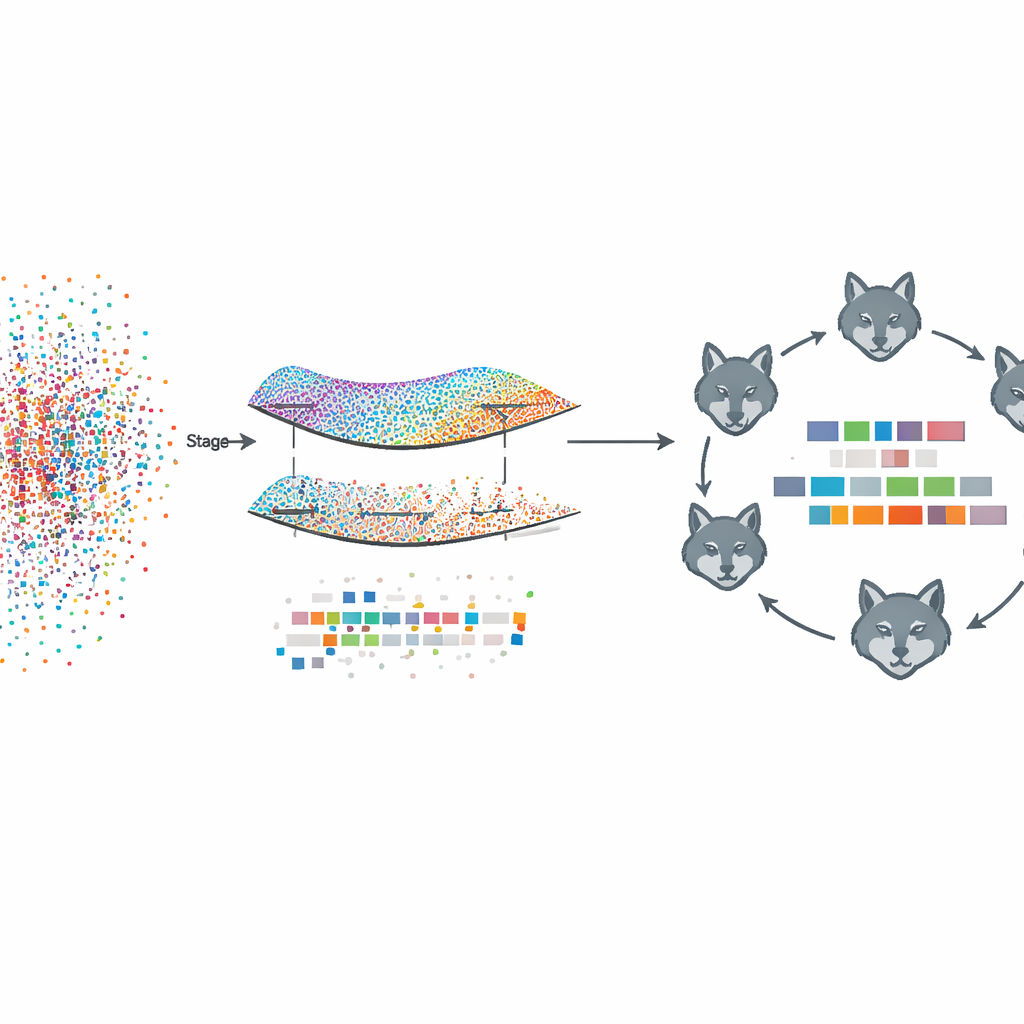

Le cadre proposé, appelé Fed‑MSMCGWO, fonctionne dans une configuration d’apprentissage fédéré : chaque client, comme un hôpital ou un site d’information, conserve localement ses textes bruts et ses étiquettes. Dans la première étape, la méthode construit une sorte de carte — ou variété — décrivant la ressemblance entre documents et la cooccurrence des étiquettes. Elle relie les documents voisins et les étiquettes connexes en graphes, puis apprend des poids de caractéristiques qui respectent ces structures. Une règle de parcimonie particulière favorise l’atténuation simultanée des caractéristiques inutiles sur l’ensemble des étiquettes, produisant une représentation plus concise qui capture néanmoins les relations sous-jacentes entre textes et tags.

Ajustement inspiré par la nature

Après cet élagage basé sur la variété, la deuxième étape affine les poids des caractéristiques restantes en utilisant une stratégie de recherche inspirée du vivant, modélisée sur les meutes de loups gris. Les sous-ensembles candidats de caractéristiques sont traités comme des loups explorant un paysage de solutions possibles. Ils sont organisés en trois groupes coopératifs qui équilibrent l’exploitation prudente de bonnes solutions partielles et l’exploration large de nouvelles zones. En mettant à jour à plusieurs reprises leurs positions en fonction des membres de la meute les plus performants, ces loups virtuels convergent vers des combinaisons de caractéristiques qui améliorent encore la performance d’étiquetage tout en restant parcimonieuses.

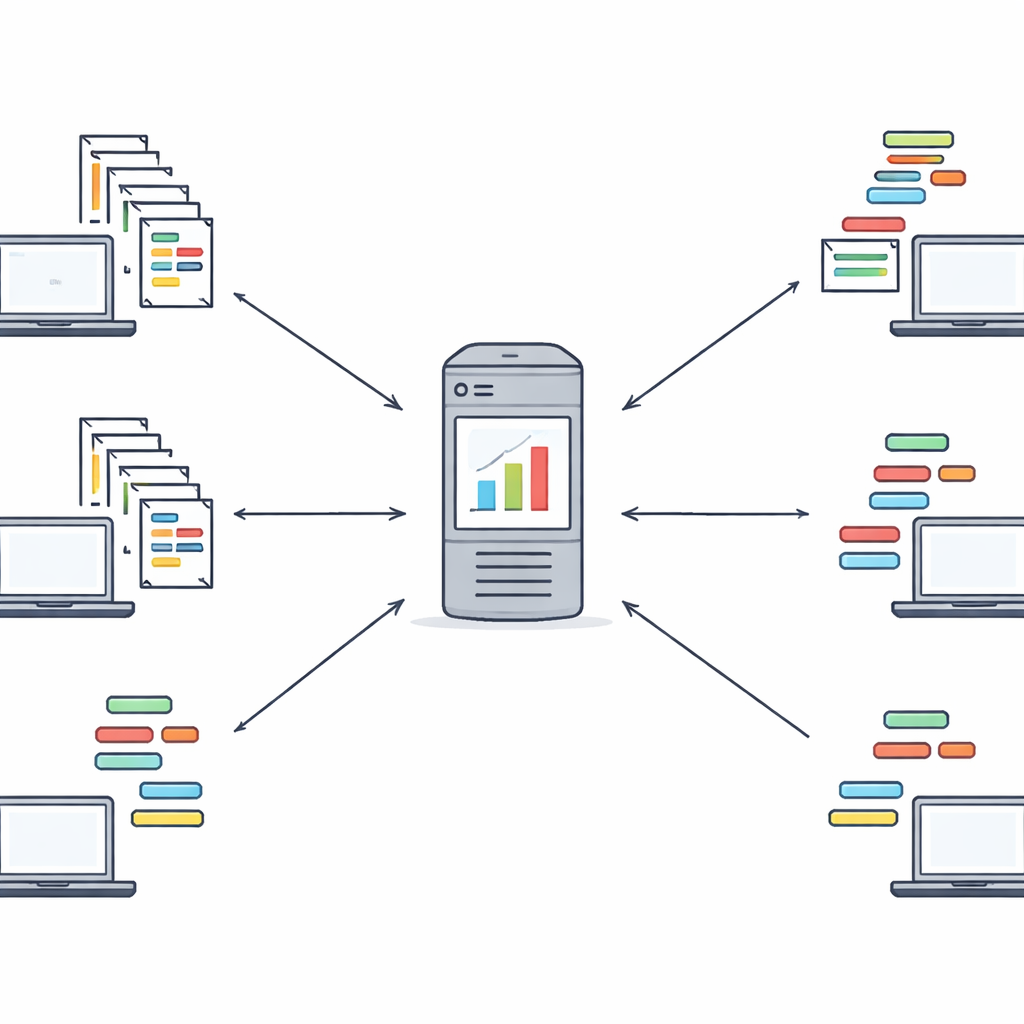

Collaborer tout en restant privé

Une fois que chaque client a exécuté localement l’optimisation en deux étapes, il n’envoie au serveur central que ses poids de caractéristiques et les indices des caractéristiques choisies — pas les documents ou les étiquettes originaux. Le serveur agrège ces poids, en donnant plus d’influence aux clients disposant de jeux de données plus importants, pour former une vue globale des caractéristiques les plus pertinentes. Il renvoie ensuite ce vecteur de poids global à tous les clients, qui s’en servent pour guider une nouvelle ronde d’affinements locaux. Quelques itérations suffisent généralement pour atteindre un ensemble de caractéristiques partagé et stable. Cette boucle crée un processus d’apprentissage collaboratif dans lequel les institutions bénéficient de l’expérience des autres sans jamais partager leurs textes bruts. Les auteurs discutent également de la manière dont ce dispositif peut être combiné avec des outils cryptographiques plus forts dans des travaux futurs.

Montrer les gains en pratique

Pour valider leur idée, les chercheurs ont réalisé des expériences sur huit jeux de données public multi-étiquettes couvrant des domaines tels que l’éducation, la santé, les arts et la science. Ils ont comparé leur méthode à la fois aux approches centralisées classiques supposant que toutes les données peuvent être regroupées et aux schémas fédérés récents de sélection de caractéristiques. Sur plusieurs mesures standard de performance multi-étiquettes — incluant la précision du classement des tags corrects et la fréquence des étiquettes manquées ou mal assignées — le nouveau cadre a systématiquement égalé ou surpassé les alternatives, atteignant souvent une forte précision avec étonnamment peu de caractéristiques sélectionnées. Des tests statistiques ont confirmé que ces améliorations n’étaient pas dues au hasard, et des études d’ablation ont montré que tant la modélisation de la variété que l’optimisation de type loup gris étaient des éléments cruciaux du dispositif global.

Ce que cela implique pour l’avenir

En termes simples, ce travail montre qu’il est possible de réduire des représentations textuelles massives, de respecter des relations complexes entre plusieurs tags et de collaborer entre de nombreux détenteurs de données — tout en gardant les documents sensibles chez eux. En combinant une compréhension géométrique structurée avec une stratégie de recherche inspirée de la nature, Fed‑MSMCGWO propose une recette pratique pour construire des systèmes d’étiquetage de texte plus rapides, plus précis et plus respectueux de la vie privée. Les auteurs envisagent d’étendre cette approche au-delà du texte brut vers des types de données plus riches et de l’associer à un chiffrement renforcé, ouvrant la voie à une IA collaborative capable d’apprendre de nombreuses sources sans exposer leur contenu.

Citation: Zheng, Y., Ye, Z., Zhang, S. et al. Federated multi-label text feature selection via manifold-aware sparse modeling and cooperative grey wolf optimization. Sci Rep 16, 11680 (2026). https://doi.org/10.1038/s41598-026-46223-4

Mots-clés: apprentissage fédéré, sélection de caractéristiques, classification de textes multi-étiquettes, IA préservant la vie privée, optimisation métaheuristique