Clear Sky Science · zh

从计算到环境代价:人工智能的资源负担

为什么我们智能设备里的金属很重要

每一个友好的聊天机器人或图像生成器背后,都隐藏着一个由金属、采矿和制造构成的庞大世界。本文揭开了这层数字帷幕,表明人工智能(AI)不仅仅关乎电力和数据,它同样依赖于使之成为可能的实体硬件——从强大的芯片到它们所含的多种化学元素。随着 AI 模型规模变大、能力增强,研究提出了一个简单但紧迫的问题:这种进步对地球以及生活在矿区和工厂附近的人们,在物质上究竟付出了怎样的代价?

从需求上升到现实限制

作者首先把 AI 放在更广泛的资源使用叙事中加以考察。近年来,数据中心和专业芯片已成为从流媒体到云服务乃至 AI 的核心。科技巨头正在数百亿美元地建设新数据中心,预计到本世纪末,AI 工作负载将主导这些中心的使用。目前公众讨论主要集中在这些中心消耗了多少电力和水。但这些系统的核心机器依赖一长串金属与矿物,其中一些稀缺、难以开采或在处理不当时具有毒性。研究认为,要判断 AI 是否真正可持续,就必须超越仅仅统计千瓦时,开始同时统计材料的千克数。

单颗 AI 芯片的真实组成

为把这一抽象问题落到实处,研究人员拆解了一款广泛使用的图形处理器 Nvidia A100,并对其成分进行了化学分析。他们识别出 32 种不同元素,包括常见金属如铜、铁和锡,以及少量镍、钡、锌和若干贵金属如金与银。引人注目的是,约 90% 的芯片质量由重金属构成,约 93% 的质量由在典型暴露条件下被归类为危险的元素组成。芯片的不同部件有各自的作用与配方:散热片几乎是纯铜以便散热,电路板混合了铜与铁及其它添加剂,而微小的计算核心则集中着硅和多种其他金属。

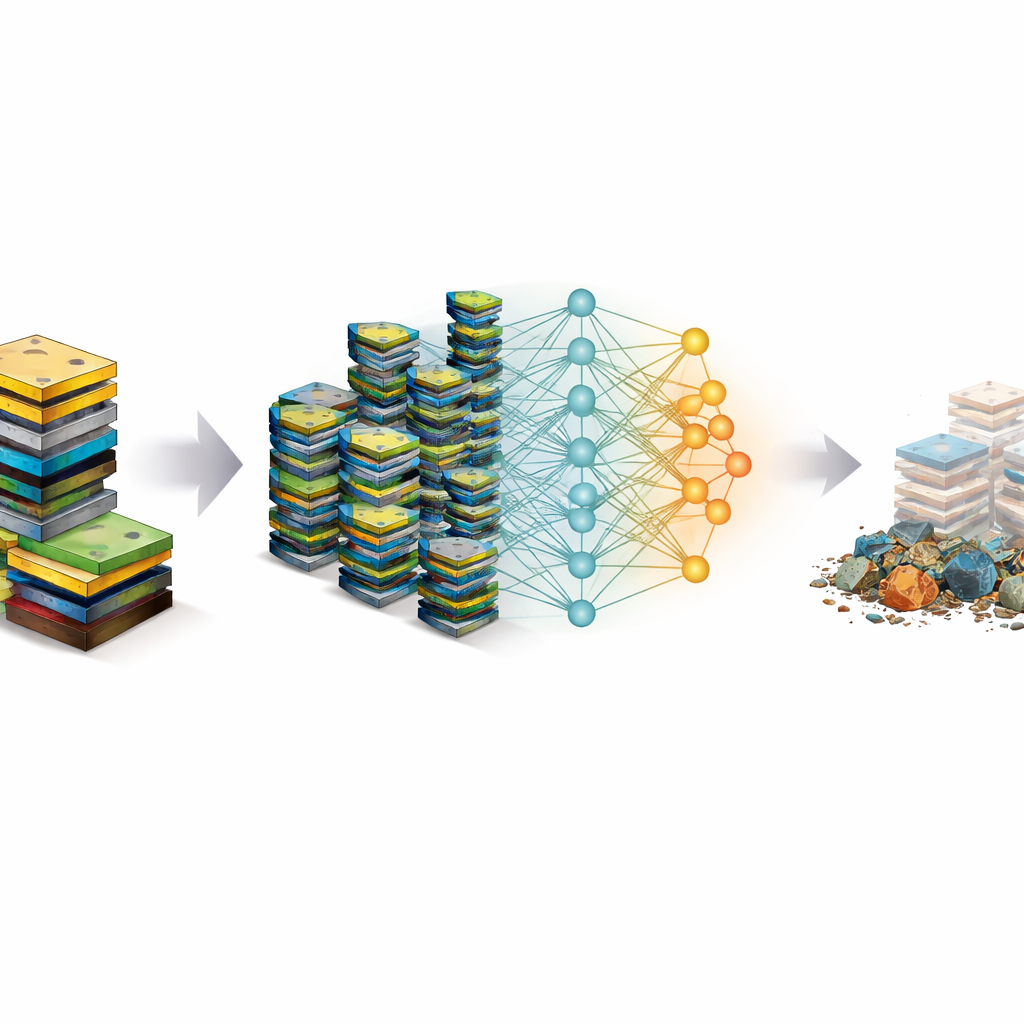

让 AI 学会“说话”需要多少芯片

接下来,研究将训练大型 AI 模型的数字工作量与硬件的物理磨损联系起来。训练工作量以 FLOPs(浮点运算次数)衡量,这是模型执行基本计算次数的标准计数。通过估算 Nvidia A100 在其使用寿命内可提供的 FLOPs,并将其与主要模型的计算预算(公开报道或推断得出)比较,作者计算出一次训练运行相当于“耗尽”了多少 GPU。在关于芯片寿命和效率的现实假设下,训练像 GPT-4 这样的先进语言模型相当于消耗数千个 A100 单位。对于九个著名模型组合,所需的材料总量落在数吨提取资源的范围内,其中大部分是采矿与处置过程中存在风险的危险金属。

小幅性能提升,却要付出高昂材料代价

论文进一步比较了模型性能的提升与不断增长的硬件负担之间的关系。通过数学能力、常识、编程、科学问题和日常推理的标准测试,作者显示,新一代更大模型相比其前代常常只带来适度的分数提升,尽管它们使用了十倍甚至百倍以上的计算资源。某些能力,如高级数学问题解决,确实有显著提升,但尤其消耗资源。其他能力,例如基本常识推理,即便训练工作量激增也仅有微小改进。这一模式表明,简单地通过扩模型规模和硬件投入来取得进步,正变成一种日益昂贵的路径,不仅在能源方面,在金属开采和未来电子废物上亦然。

如何让每颗芯片发挥更大作用

研究还探讨了更好的工程手段如何缓解材料负担。有两项杠杆效应尤为突出。其一,提高每块 GPU 在训练期间的利用率可以减少所需单元数量;将利用率从低水平提高到高水平,可使 GPU 需求减少超过一半。其二,延长数据中心中芯片的典型寿命——从大约一到三年或甚至五年——能进一步减少必须生产并最终报废的数量。结合这些措施,作者估计,训练像 GPT-4 这样的模型的有效 GPU 需求理论上可以减少超过 90%。然而,他们警告说,现实世界的收益取决于冷却、维护和系统设计,且效率提升有时会刺激更多 AI 使用,从而抵消部分节省。

这对 AI 的未来意味着什么

最后,作者主张不能仅凭电表来评判 AI 的环境足迹。每一代强大模型的构建都建立在铜、镍、砷、铅及许多其他从地里挖掘出来的元素之上,这些原料往往来自监管与保护工人能力有限的地区。随着通过蛮力扩规模获得的性能收益开始减弱,研究建议将优先事项转向更智能的架构、更好的算法、更高质量的数据以及更耐用的硬件,而不是仅仅生产更多相同的芯片。对普通读者而言,信息是:我们的数字助手与创意工具并非无重量的存在。它们携带着隐性的材料成本,若要让 AI 在不超出地球资源与污染承载力的前提下发展,这些成本必须被承认并加以管理。

引用: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

关键词: 人工智能硬件材料, GPU 环境影响, 大型语言模型训练, 电子废物, 可持续计算