Clear Sky Science · ja

計算から環境コストへ 人工知能の資源負荷

なぜ私たちの賢い機械の内部の金属が重要なのか

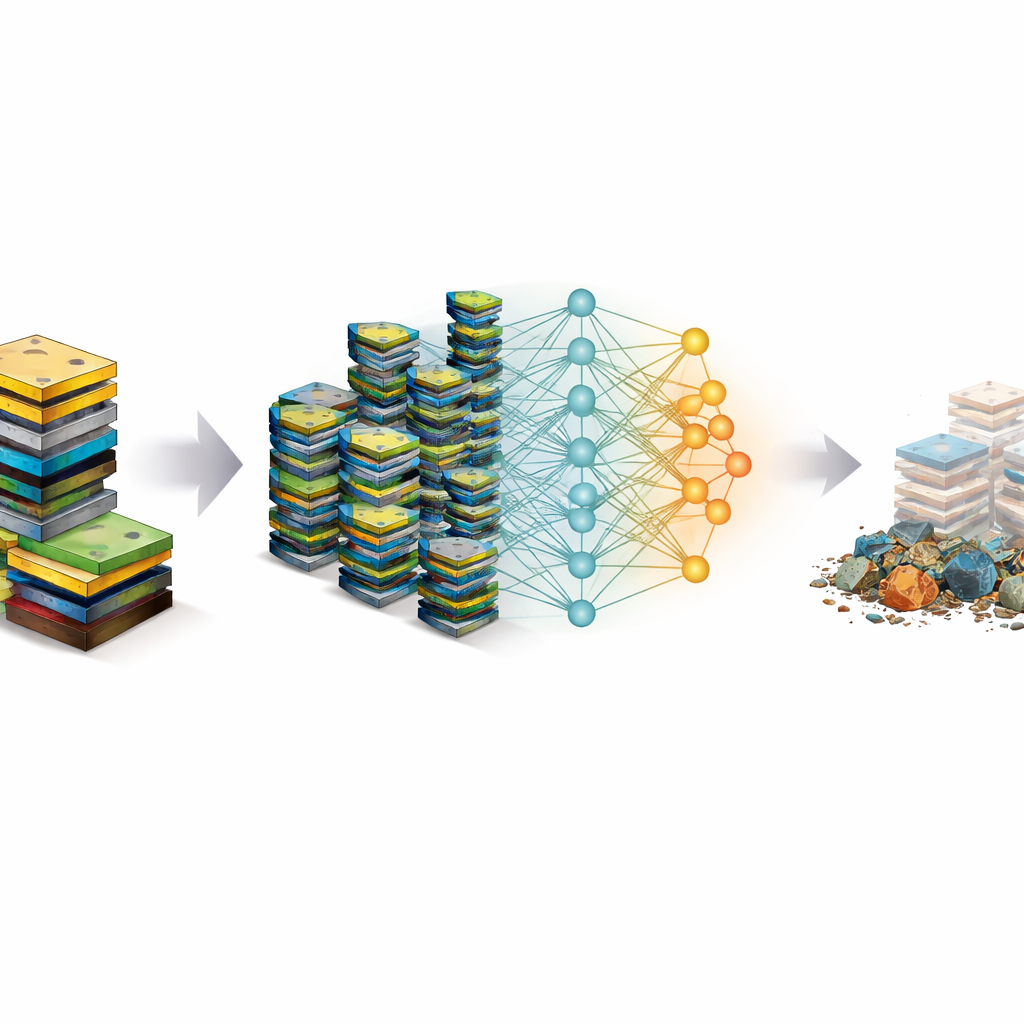

親しみやすいチャットボットや画像生成ツールの背後には、金属、採掘、製造という広大な隠れた世界が存在します。本稿はそのデジタルの幕をめくり、人工知能(AI)が単に電力やデータの問題ではないことを示します。重要なのは、高性能チップからそれらに含まれる多数の化学元素に至るまで、AIを可能にする物理的なハードウェアです。モデルが大きく高性能になるにつれて、本研究は単純だが差し迫った問いを投げかけます:この進歩は地球や鉱山や工場の近くで暮らす人々にとって、物質的にどれほどの代償を伴うのか?

高まる需要から現実の限界へ

著者らはまず、AIを資源利用のより広い物語の中に位置づけます。近年、データセンターと専用チップはストリーミングやクラウドサービスからAIに至るまで中核的な役割を担うようになりました。テクノロジー大手は新しいデータセンターに数千億ドルを投じており、今後数年でAIワークロードがそれらの利用を支配すると予想されています。これまで公の議論は主にこれらセンターが消費する電力や水の量に集中してきました。しかし、それらの中核を成す機械は長いリストの金属や鉱物に依存しており、その中には希少で採掘が難しいものや、管理を誤ると有害となるものもあります。本研究は、AIが真に持続可能かどうかを判断するには、キロワット時を数えるだけでなく、同時に物質のキログラムを数える必要があると主張します。

単一のAIチップは実際に何でできているか

この抽象的な問題を事実に基づいて検証するため、研究者らは広く使われているグラフィックス処理装置、Nvidia A100を分解し、その化学成分を分析しました。彼らは銅、鉄、スズのような一般的な金属に加え、ニッケル、バリウム、亜鉛、金や銀といったいくつかの貴金属を含む32種の元素を特定しました。注目すべきは、チップの質量の約90%が重金属で構成され、約93%が典型的な曝露条件下で有害と分類される元素で占められていることです。チップの異なる部位はそれぞれ役割と組成が異なります:放熱板は冷却のためほぼ純銅、回路基板は銅と鉄に他の添加物が混ざり、小さな演算コアはシリコンと多様な金属を濃縮しています。

AIに会話を学ばせるのに何枚のチップが必要か

次に、研究は大規模モデルのトレーニングというデジタルな作業負荷を、ハードウェアの物理的な摩耗と結びつけます。トレーニングの労力はFLOP(浮動小数点演算回数)で測られ、モデルが行う基本計算の回数を示す標準的な指標です。Nvidia A100が使用寿命の間に提供できるFLOP数を推定し、主要モデルについて報告または推定された計算予算と比較することで、著者らは単一のトレーニングで実質的に「使い潰される」GPUの数を算出します。チップの寿命や効率に関する現実的な仮定のもとでは、GPT-4のような最先端の言語モデルのトレーニングは数千台分のA100に相当する資源を消費します。9つの主要モデルを対象とした場合、総材料需要は数トン単位の採掘資源に達し、その多くは採掘や廃棄時にリスクを伴う有害金属です。

小さな性能向上、大きな材料費

論文は次に、モデルの性能向上がこの増大するハードウェア負荷に比してどのような比率で進んでいるかを比較します。数学力、一般知識、コーディング、科学的質問、日常の推論といった標準テストを用いて、著者らは新しくはるかに大きなモデルが、十倍あるいは百倍の計算を用いながらも前世代に比べてせいぜい控えめなスコア向上しか示さないことを示します。高度な数学問題の解決など一部の能力は劇的に改善しますが、特に資源集約的であるように見えます。基本的な常識的推論のような他の能力は、トレーニング負荷が急増してもわずかな向上にとどまります。このパターンは、単にモデルとハードウェアを拡大することが、エネルギー面だけでなく金属採掘や将来の電子廃棄物の点でもますますコストのかかる進路であることを示唆しています。

各チップをより長く使う方法

研究はまた、より良いエンジニアリングが物質負荷を軽減する方法を探ります。注目すべき二つの手段があります。第一に、トレーニング中に各GPUをより完全に活用することで必要台数を減らすことができます。低い利用率から高い利用率へ引き上げるだけでGPU需要を半分以上削減できる場合があります。第二に、データセンターでのチップの典型的な寿命を約1年から3年、あるいは5年に延ばすことで、最終的に生産・廃棄される総数をさらに削減できます。これらの対策を組み合わせると、著者らはGPT-4のようなモデルのトレーニングに必要な実効GPU需要を理論上90%以上削減できると推定します。ただし、実際の効果は冷却、保守、システム設計に依存し、効率改善が結果的にAI利用の拡大を促して節約の一部を相殺する場合があると注意しています。

AIの未来にとってこれが意味すること

結論として著者らは、AIの環境フットプリントは電力計だけで評価できないと主張します。強力なモデルの新しい世代は、銅、ニッケル、ヒ素、鉛、そして多くの他の元素という地面から掘り出された土台の上に築かれており、しばしば汚染管理や労働者保護の能力が限られた地域で採掘されています。力任せのスケールアップによる性能向上が次第に鈍化する中で、本研究は優先順位の転換を提案します:単に同じチップを増やすのではなく、より賢いアーキテクチャ、より良いアルゴリズム、質の高いデータ、長持ちするハードウェアへと向かうことです。一般の読者に向けたメッセージは、私たちのデジタルアシスタントや創作ツールが無重量ではないということです。これらは隠れた物質的コストを伴っており、AIが地球の資源や汚染の限界を圧倒しない形で成長するためには、それを認識し管理する必要があります。

引用: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

キーワード: AIハードウェアの材料, GPUの環境影響, 大規模言語モデルのトレーニング, 電子廃棄物, 持続可能なコンピューティング