Clear Sky Science · pl

Od obliczeń do kosztów środowiskowych: obciążenie zasobów sztucznej inteligencji

Dlaczego metale w naszych inteligentnych maszynach mają znaczenie

Za każdym przyjaznym chatbotem czy generatorem obrazów kryje się rozległy, ukryty świat metali, wydobycia i produkcji. Artykuł odsłania cyfrową kurtynę, pokazując, że sztuczna inteligencja (SI) to nie tylko prąd i dane. To także fizyczny sprzęt, który ją umożliwia — od wydajnych układów po liczne pierwiastki chemiczne, które się w nich znajdują. W miarę jak modele SI rosną i stają się bardziej zaawansowane, badanie stawia proste, ale pilne pytanie: jaki jest koszt materiałowy tego postępu dla planety i dla ludzi mieszkających w pobliżu kopalń i fabryk?

Od rosnącego popytu do realnych ograniczeń

Autorzy zaczynają od umieszczenia SI w szerszym kontekście wykorzystania zasobów. W ostatnich latach centra danych i wyspecjalizowane układy stały się kluczowe dla wszystkiego, od streamingu po usługi w chmurze, a teraz również dla SI. Giganci technologiczni inwestują setki miliardów dolarów w nowe centra danych, a obciążenia związane z SI mają zdominować ich wykorzystanie przed końcem dekady. Do tej pory debata publiczna koncentrowała się głównie na zużyciu energii elektrycznej i wody przez te centra. Jednak maszyny w ich wnętrzu opierają się na długiej liście metali i minerałów, z których niektóre są rzadkie, trudne do wydobycia lub toksyczne przy niewłaściwym obchodzeniu się z nimi. Badanie argumentuje, że aby ocenić, czy SI jest rzeczywiście zrównoważona, trzeba pójść dalej niż liczenie kilowatogodzin i zacząć liczyć także kilogramy materiału.

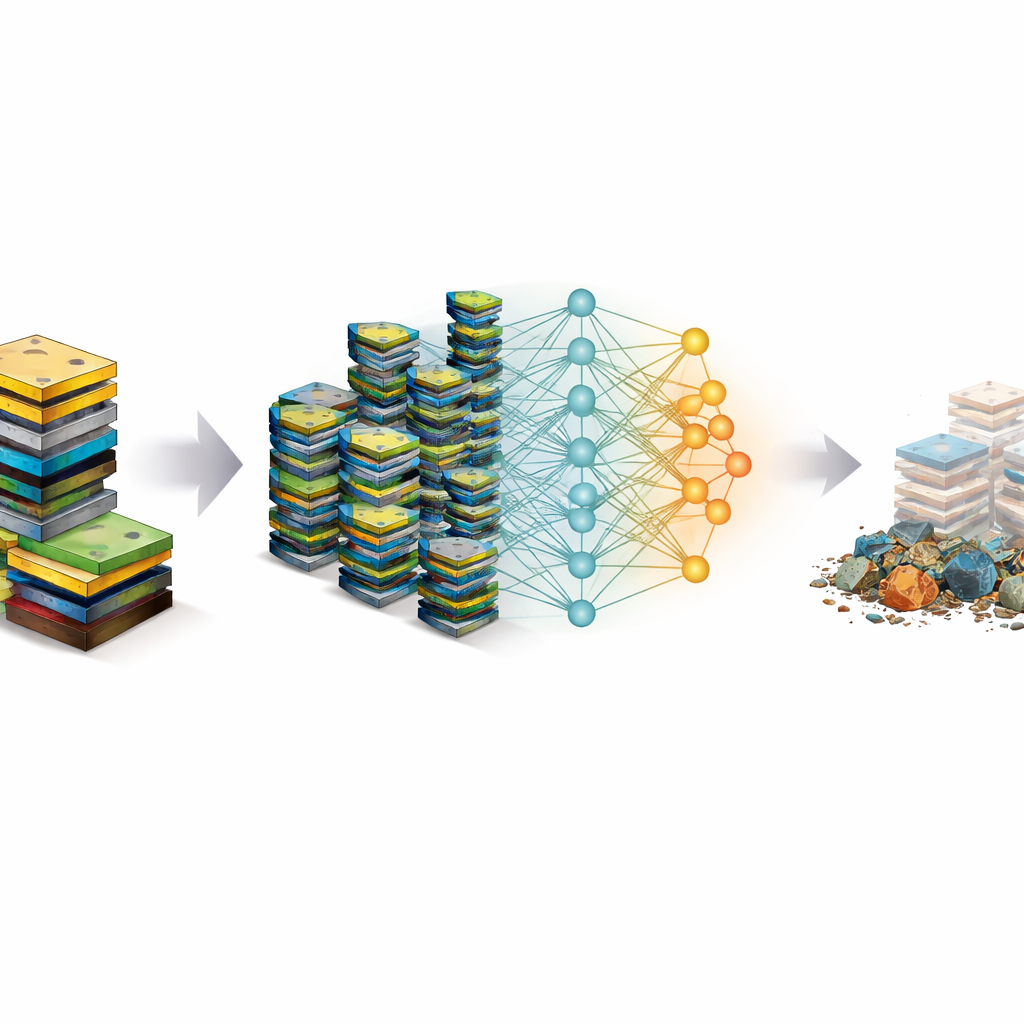

Z czego naprawdę składa się pojedynczy układ SI

Aby ugruntować tę abstrakcyjną kwestię w twardych faktach, badacze rozebrali na części powszechnie używany procesor graficzny, Nvidia A100, i przeanalizowali jego zawartość chemiczną. Zidentyfikowali 32 różne pierwiastki, w tym powszechne metale takie jak miedź, żelazo i cyna, a także mniejsze ilości niklu, baru, cynku oraz kilka metali szlachetnych, jak złoto i srebro. Co istotne, około 90 procent masy układu stanowią metale ciężkie, a mniej więcej 93 procent to pierwiastki klasyfikowane jako niebezpieczne przy typowych warunkach narażenia. Różne części układu pełnią odmienne role i mają odrębne składy: radiator to niemal czysta miedź do odprowadzania ciepła, płytka drukowana łączy miedź i żelazo z dodatkami, natomiast maleńkie jądro obliczeniowe koncentruje krzem i różnorodne inne metale.

Ile układów potrzeba, by nauczyć SI mówić

Dalej badanie łączy cyfrowe obciążenie związane z trenowaniem dużych modeli SI z fizycznym zużyciem sprzętu. Wysiłek treningowy mierzy się w FLOPach, standardowej miary liczby podstawowych obliczeń wykonywanych przez model. Poprzez oszacowanie, ile FLOPów Nvidia A100 może dostarczyć w czasie swojej użytecznej żywotności, i porównanie tego z budżetami obliczeniowymi raportowanymi lub wnioskowanymi dla największych modeli, autorzy obliczają, ile GPU jest w praktyce „zużywanych” podczas pojedynczego procesu trenowania. Przy realistycznych założeniach dotyczących żywotności i efektywności układów trenowanie najnowocześniejszego modelu językowego, takiego jak GPT-4, zużywa ekwiwalent tysięcy jednostek A100. Dla zestawu dziewięciu wyróżniających się modeli całkowite zapotrzebowanie materiałowe mieści się w przedziale kilku ton wydobytych zasobów, z których większość to metale niebezpieczne stanowiące ryzyko podczas wydobycia i utylizacji.

Małe przyrosty wydajności, duże koszty materiałowe

Artykuł porównuje następnie, jak poprawa wyników modeli odnosi się do rosnącego obciążenia sprzętowego. Używając standardowych testów umiejętności matematycznych, wiedzy ogólnej, kodowania, pytań naukowych i rozumowania codziennego, autorzy wykazują, że nowsze, znacznie większe modele często dają jedynie umiarkowany wzrost wyników w porównaniu z poprzednikami, mimo że używają dziesiątki lub nawet setki razy więcej mocy obliczeniowej. Niektóre zdolności, jak zaawansowane rozwiązywanie zadań matematycznych, poprawiają się dramatycznie, ale wydają się szczególnie zasobożerne. Inne, jak podstawowe rozumowanie zdroworozsądkowe, wykazują tylko niewielkie przyrosty nawet przy rosnących obciążeniach treningowych. Ten wzorzec sugeruje, że sam wzrost skali modeli i sprzętu jest coraz bardziej kosztowną drogą do postępu — nie tylko pod względem energii, ale także wydobycia metali i przyszłych elektroodpadów.

Sposoby na wydłużenie życia każdego układu

Badanie eksploruje również, jak lepsze inżynieria może złagodzić obciążenie materiałowe. Dwa dźwignie wyróżniają się najbardziej. Po pierwsze, poprawa wykorzystania każdego GPU podczas treningu może zmniejszyć liczbę potrzebnych jednostek; zwiększenie wykorzystania z niskiego do wysokiego poziomu może zredukować zapotrzebowanie na GPU o ponad połowę. Po drugie, wydłużenie typowej żywotności układów w centrach danych — z około roku do trzech lub nawet pięciu lat — dodatkowo ogranicza całkowitą liczbę konieczną do wyprodukowania i ostatecznego wyrzucenia. Łącząc te środki, autorzy szacują, że efektywne zapotrzebowanie na GPU dla modelu takiego jak GPT-4 mogłoby w zasadzie zostać zmniejszone o ponad 90 procent. Odradzają jednak, że rzeczywiste zyski zależą od chłodzenia, utrzymania i konstrukcji systemu, a poprawa efektywności może czasem pobudzić większe użycie SI, niwelując część oszczędności.

Co to oznacza dla przyszłości SI

Na zakończenie autorzy twierdzą, że śladu środowiskowego SI nie da się ocenić wyłącznie za pomocą liczników energii. Każde nowe pokolenie potężnych modeli opiera się na fundamencie miedzi, niklu, arsenu, ołowiu i wielu innych pierwiastków wydobywanych z ziemi, często w regionach o ograniczonych możliwościach kontroli zanieczyszczeń i ochrony pracowników. W miarę jak przyrosty wydajności wynikające z brutalnego skalowania zaczynają słabnąć, badanie sugeruje zmianę priorytetów: w kierunku mądrzejszych architektur, lepszych algorytmów, wyższej jakości danych i trwalszego sprzętu, zamiast po prostu większej liczby tych samych układów. Dla czytelników codziennych przesłanie jest takie, że nasze cyfrowe asystenty i narzędzia twórcze nie są bezmasowe. Niosą ukryty koszt materiałowy, który trzeba uznać i zarządzać nim, jeśli SI ma rozwijać się nie przekraczając granic zasobów i zanieczyszczeń planety.

Cytowanie: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Słowa kluczowe: materiały sprzętowe AI, wpływ GPU na środowisko, trenowanie dużych modeli językowych, elektroodpady, zrównoważone przetwarzanie