Clear Sky Science · ru

От вычислений к экологической цене: материальная нагрузка искусственного интеллекта

Почему металлы внутри наших «умных» машин имеют значение

За каждым дружелюбным чат-ботом или генератором изображений скрывается обширный мир металла, добычи и производства. В этой статье отодвигается цифровой занавес, чтобы показать: искусственный интеллект (ИИ) — это не только электричество и данные. Это также физическое аппаратное обеспечение, которое делает его возможным, от мощных чипов до множества химических элементов, которые в них содержатся. По мере роста и усложнения моделей ИИ исследование задаёт простой, но актуальный вопрос: какова материальная цена этого прогресса для планеты и для людей, живущих рядом с рудниками и фабриками?

От растущего спроса к реальным ограничениям

Авторы начинают с того, что помещают ИИ в более широкий контекст использования ресурсов. За последние годы центры обработки данных и специализированные чипы стали центральными для всего — от стриминга до облачных сервисов и теперь ИИ. Технологические гиганты вкладывают сотни миллиардов долларов в новые центры обработки данных, и ожидается, что к концу десятилетия рабочие нагрузки по ИИ будут доминировать в их использовании. До сих пор общественная дискуссия в основном фокусировалась на том, сколько электроэнергии и воды потребляют эти центры. Но машины в их основе зависят от длинного списка металлов и минералов, некоторые из которых дефицитны, труднодобываемы или токсичны при неправильном обращении. Авторы утверждают, что чтобы судить об устойчивости ИИ, нужно выйти за рамки подсчёта киловатт-часов и начать учитывать килограммы материалов.

Из чего на самом деле состоит один чип ИИ

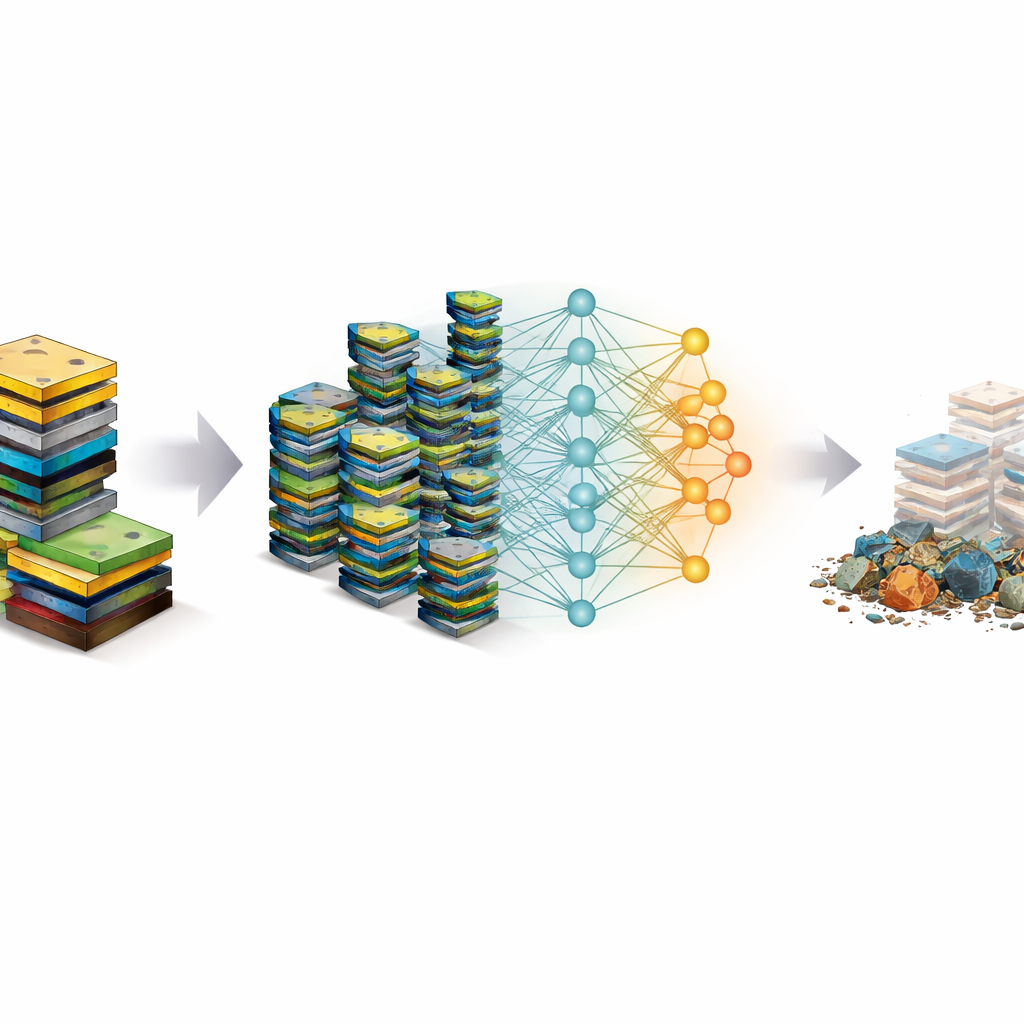

Чтобы привязать этот абстрактный вопрос к твёрдым фактам, исследователи разобрали широко используемый графический процессор Nvidia A100 и провели его химический анализ. Они идентифицировали 32 разных элемента, включая распространённые металлы, такие как медь, железо и олово, а также меньшие количества никеля, бария, цинка и нескольких драгоценных металлов, таких как золото и серебро. Поразительно, что около 90 процентов массы чипа составляют тяжёлые металлы, и примерно 93 процента — элементы, классифицируемые как опасные при типичных условиях воздействия. Разные части чипа выполняют различные функции и имеют разные составы: радиатор почти полностью состоит из меди для охлаждения, печатная плата смешивает медь и железо с другими добавками, а крошечное вычислительное ядро концентрирует кремний и разнообразные другие металлы.

Сколько чипов требуется, чтобы натренировать ИИ разговорной речи

Далее исследование связывает цифровую нагрузку по обучению больших моделей ИИ с физическим износом аппаратного обеспечения. Усилие по обучению измеряют в FLOP — стандартной мере количества элементарных вычислений, которое выполняет модель. Оценив, сколько FLOP может обеспечить Nvidia A100 в течение срока полезной службы, и сравнив это с вычислительными бюджетами, заявленными или выведенными для крупных моделей, авторы вычисляют, сколько GPU фактически «используется» в одном запуске обучения. При реалистичных допущениях о сроке службы и эффективности чипов обучение современной языковой модели, подобной GPT-4, потребляет эквивалент тысяч единиц A100. Для набора из девяти известных моделей суммарный спрос на материалы оказывается в пределах нескольких тонн извлечённых ресурсов, большая часть которых — опасные металлы, представляющие риски при добыче и утилизации.

Незначительные приросты производительности, крупные материальные счета

Далее статья сравнивает, как улучшается производительность моделей относительно растущей аппаратной нагрузки. Используя стандартные тесты по математике, общим знаниям, программированию, научным вопросам и повседневному рассуждению, авторы показывают, что новые, значительно более крупные модели часто дают лишь скромное повышение показателей по сравнению с предшественниками, несмотря на то что используют в десятки или даже сотни раз больше вычислений. Некоторые способности, например решение сложных математических задач, действительно улучшаются драматически, но требуют особенно много ресурсов. Другие, такие как базовое здравомыслие, показывают лишь незначительные улучшения, даже когда рабочие нагрузки на обучение взлетают. Эта картина указывает на то, что простое увеличение масштабов моделей и аппаратуры становится всё более дорогостоящим путём к прогрессу — не только с точки зрения энергии, но и с точки зрения добычи металлов и будущих электронных отходов.

Как растянуть ресурс каждого чипа

Исследование также рассматривает, как более грамотная инженерия может облегчить материальную нагрузку. Выделяются два рычага. Во-первых, повышение степени загрузки каждого GPU во время обучения может сократить число необходимых единиц; повышение использования от низкого до высокого уровня может уменьшить спрос на GPU более чем наполовину. Во-вторых, продление типичного срока службы чипов в центрах данных — с примерно одного до трёх или даже пяти лет — дополнительно сокращает общее число, которое нужно производить и в итоге утилизировать. В комбинации эти меры, по оценке авторов, в принципе могут снизить эффективный спрос на GPU для обучения модели вроде GPT-4 более чем на 90 процентов. Однако они предупреждают, что реальные выгоды зависят от систем охлаждения, обслуживания и архитектуры системы, а улучшение эффективности иногда может стимулировать более широкое использование ИИ, сведя часть экономии на нет.

Что это значит для будущего ИИ

В заключение авторы утверждают, что экологический след ИИ нельзя оценивать только по показаниям электрических счётчиков. Каждое новое поколение мощных моделей строится на фундаменте из меди, никеля, мышьяка, свинца и многих других элементов, выкопанных из земли, часто в регионах с ограниченными возможностями контролировать загрязнение и защищать рабочих. По мере того как выгоды от грубого масштабирования начинают иссякать, исследование предлагает сместить приоритеты: в сторону более умных архитектур, лучших алгоритмов, данных более высокого качества и более долговечного аппаратного обеспечения, а не просто большего количества тех же чипов. Для повседневных читателей посыл ясен: наши цифровые помощники и творческие инструменты не лишены веса. У них есть скрытая материальная цена, которую нужно признавать и управлять ею, если ИИ должен развиваться, не перегружая ресурсные и загрязняющие лимиты планеты.

Цитирование: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Ключевые слова: материалы аппаратного обеспечения ИИ, экологическое воздействие GPU, обучение больших языковых моделей, электронные отходы, устойчивые вычисления