Clear Sky Science · fr

De la computation au coût environnemental : le fardeau matériel de l’intelligence artificielle

Pourquoi les métaux à l’intérieur de nos machines intelligentes comptent

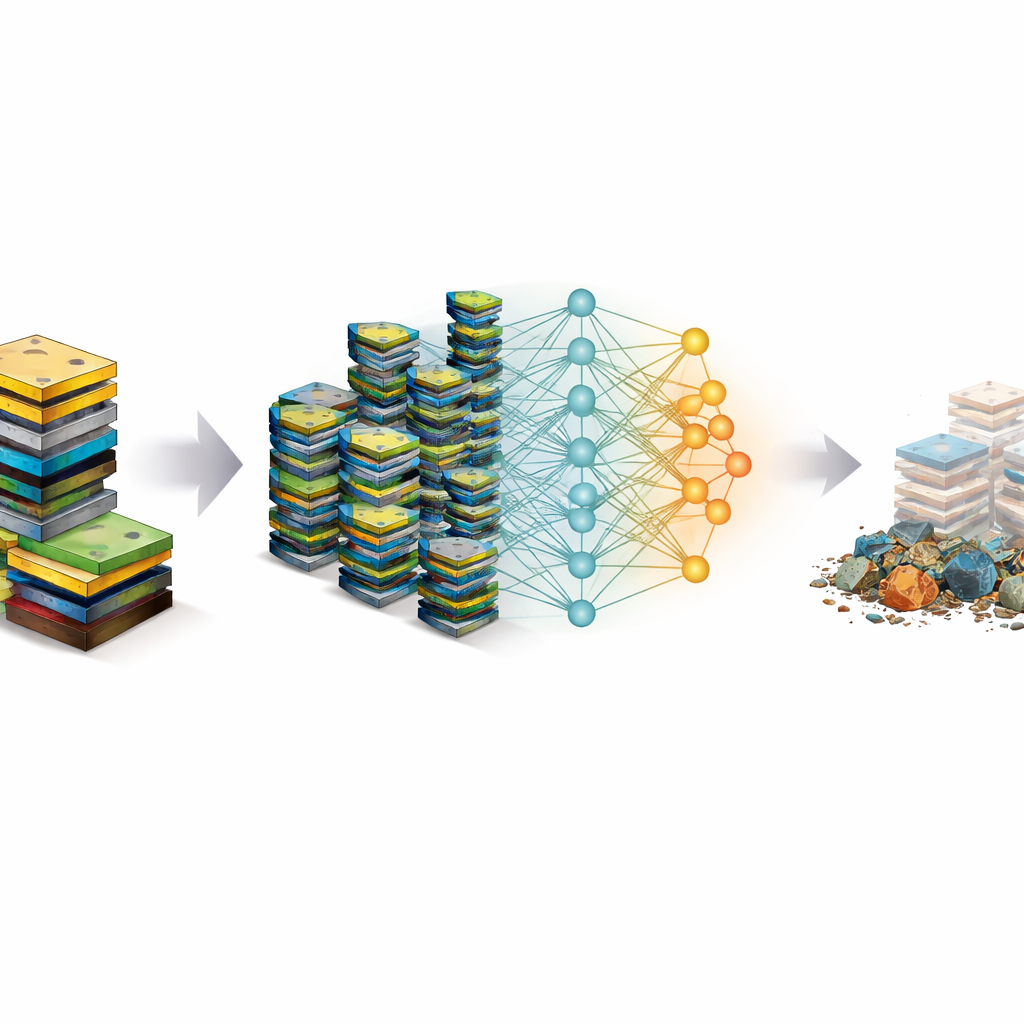

Derrière chaque chatbot amical ou générateur d’images se cache un vaste monde fait de métaux, d’exploitation minière et de fabrication. Cet article soulève le voile numérique pour montrer que l’intelligence artificielle (IA) ne se résume pas à l’électricité et aux données. Elle repose aussi sur le matériel physique qui la rend possible, des puces puissantes aux nombreux éléments chimiques qu’elles contiennent. À mesure que les modèles d’IA deviennent plus grands et plus performants, l’étude pose une question simple mais urgente : quel est le coût matériel de ces progrès pour la planète et pour les populations vivant près des mines et des usines ?

De la demande croissante aux limites réelles

Les auteurs commencent par replacer l’IA dans une histoire plus large de l’utilisation des ressources. Ces dernières années, les centres de données et les puces spécialisées sont devenus centraux pour tout, du streaming aux services cloud, et désormais pour l’IA. Les géants de la technologie investissent des centaines de milliards de dollars dans de nouveaux centres de données, et les charges de travail liées à l’IA devraient dominer leur utilisation d’ici la fin de la décennie. Jusqu’à présent, le débat public a surtout porté sur la consommation d’électricité et d’eau de ces centres. Mais les machines au cœur de ces infrastructures dépendent d’une longue liste de métaux et de minéraux, dont certains sont rares, difficiles à extraire ou toxiques en cas de mauvaise gestion. L’étude soutient que pour juger de la durabilité réelle de l’IA, il faut aller au‑delà du comptage des kilowattheures et commencer aussi à compter les kilogrammes de matériaux.

De quoi est vraiment faite une seule puce d’IA

Pour ancrer cette question abstraite dans des faits concrets, les chercheurs ont démonté une unité de traitement graphique largement utilisée, la Nvidia A100, et ont analysé chimiquement son contenu. Ils ont identifié 32 éléments différents, y compris des métaux courants comme le cuivre, le fer et l’étain, ainsi que de plus faibles quantités de nickel, baryum, zinc et plusieurs métaux précieux tels que l’or et l’argent. Fait remarquable, environ 90 % de la masse de la puce est constitué de métaux lourds, et près de 93 % se compose d’éléments classés comme dangereux dans des conditions d’exposition typiques. Les différentes parties de la puce ont des rôles et des compositions distincts : le dissipateur est presque du cuivre pur pour le refroidissement, la carte électronique mélange cuivre et fer avec d’autres additifs, tandis que le minuscule cœur de calcul concentre le silicium et une variété d’autres métaux.

Combien de puces il faut pour apprendre à une IA à parler

Ensuite, l’étude relie la charge de travail numérique de l’entraînement des grands modèles d’IA à l’usure matérielle physique. L’effort d’entraînement se mesure en FLOP, une unité standard comptant le nombre d’opérations de base effectuées par un modèle. En estimant combien de FLOP la Nvidia A100 peut fournir au cours de sa durée de vie utile, puis en comparant cela aux budgets de calcul déclarés ou inférés pour les modèles majeurs, les auteurs calculent combien de GPU sont effectivement « consommés » par un seul entraînement. Dans des hypothèses réalistes sur la durée de vie et l’efficacité des puces, l’entraînement d’un modèle de langage de pointe comme GPT‑4 consomme l’équivalent de milliers d’unités A100. Pour un ensemble de neuf modèles importants, la demande matérielle totale se situe dans une fourchette de plusieurs tonnes de ressources extraites, la plupart étant des métaux dangereux posant des risques lors de l’extraction et de l’élimination.

Petains gains de performance, lourdes factures matérielles

L’article compare ensuite l’amélioration des performances des modèles par rapport à cet encombrement matériel croissant. En utilisant des tests standards de compétences mathématiques, de connaissances générales, de codage, de questions scientifiques et de raisonnement quotidien, les auteurs montrent que les modèles plus récents et beaucoup plus grands n’apportent souvent que des augmentations de score modestes par rapport à leurs prédécesseurs, malgré l’usage de dizaines voire de centaines de fois plus de calcul. Certaines capacités, comme la résolution avancée de problèmes mathématiques, s’améliorent de manière spectaculaire mais semblent particulièrement voraces en ressources. D’autres, comme le raisonnement de sens commun basique, progressent peu même lorsque les charges d’entraînement montent en flèche. Ce schéma suggère que se contenter d’augmenter la taille des modèles et du matériel devient une voie de progrès de plus en plus coûteuse, non seulement en termes d’énergie mais aussi en termes d’extraction de métaux et de déchets électroniques futurs.

Comment tirer plus de chaque puce

L’étude explore également comment un meilleur ingénierie pourrait alléger la charge matérielle. Deux leviers ressortent. D’abord, améliorer le taux d’utilisation de chaque GPU pendant l’entraînement peut réduire le nombre d’unités nécessaires ; passer d’une faible à une forte utilisation peut diminuer la demande en GPU de plus de moitié. Ensuite, prolonger la durée de vie typique des puces dans les centres de données — d’environ un à trois voire cinq ans — réduit encore le nombre total à produire puis à jeter. En combinant ces mesures, les auteurs estiment que la demande effective en GPU pour entraîner un modèle comme GPT‑4 pourrait, en principe, être réduite de plus de 90 %. Ils avertissent toutefois que les gains réels dépendent du refroidissement, de la maintenance et de la conception des systèmes, et que les améliorations d’efficacité peuvent parfois stimuler une utilisation accrue de l’IA, compensant une partie des économies.

Ce que cela signifie pour l’avenir de l’IA

En conclusion, les auteurs soutiennent que l’empreinte environnementale de l’IA ne peut pas être évaluée uniquement à l’aune des compteurs d’électricité. Chaque nouvelle génération de modèles puissants repose sur une fondation de cuivre, nickel, arsenic, plomb et bien d’autres éléments extraits du sol, souvent dans des régions ayant des capacités limitées de contrôle de la pollution et de protection des travailleurs. Alors que les gains de performance issus d’un simple agrandissement commencent à s’atténuer, l’étude suggère un redéploiement des priorités : vers des architectures plus intelligentes, de meilleurs algorithmes, des données de meilleure qualité et du matériel plus durable, plutôt que simplement davantage des mêmes puces. Pour le lecteur non spécialiste, le message est que nos assistants numériques et outils créatifs ne sont pas sans poids. Ils entraînent un coût matériel caché qui doit être reconnu et géré si l’IA doit se développer sans dépasser les limites de ressources et de pollution de la planète.

Citation: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Mots-clés: matériaux matériels IA, impact environnemental des GPU, entraînement des grands modèles de langage, déchets électroniques, informatique durable