Clear Sky Science · es

De la computación al costo ambiental: la carga de recursos de la inteligencia artificial

Por qué importan los metales dentro de nuestras máquinas inteligentes

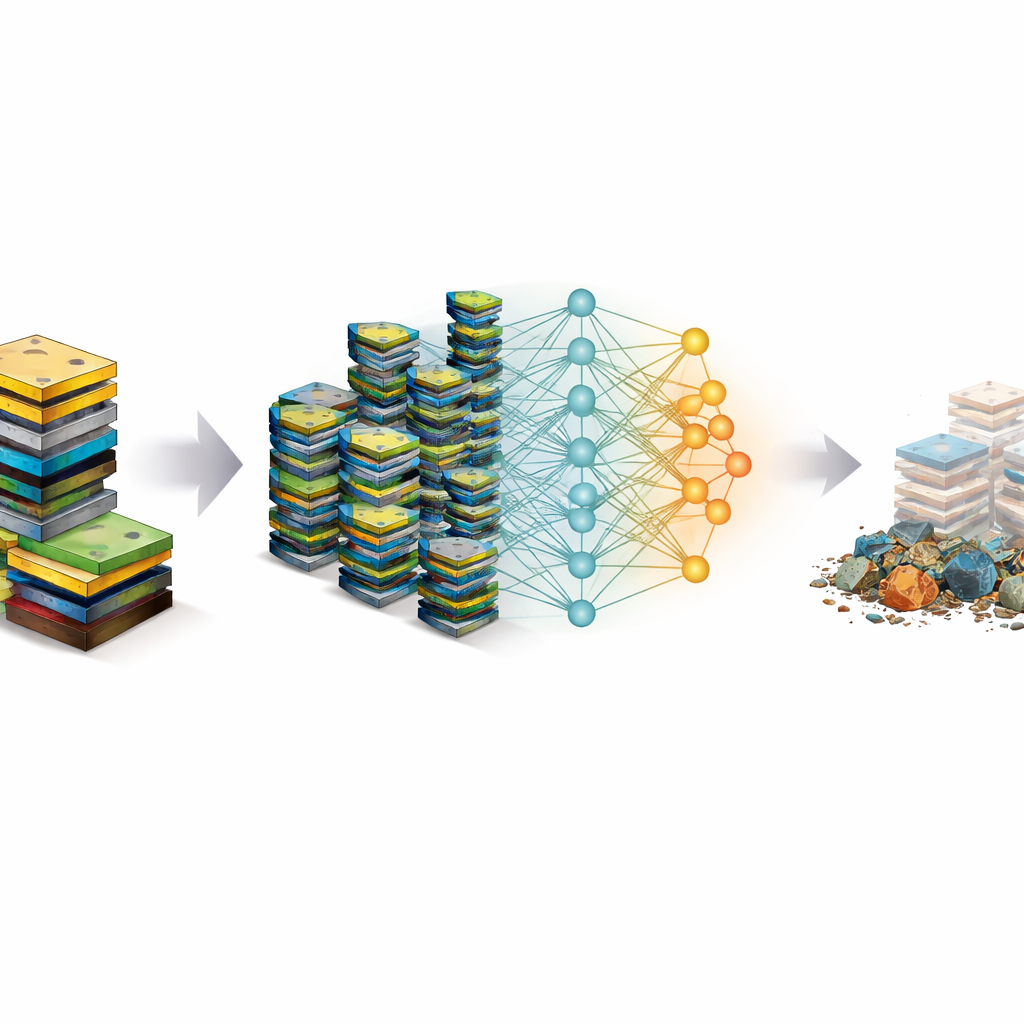

Detrás de cada chatbot amigable o generador de imágenes existe un vasto mundo oculto de metales, minería y fabricación. Este artículo descorre el telón digital para mostrar que la inteligencia artificial (IA) no se reduce solo a la electricidad y los datos. También se trata del hardware físico que la hace posible, desde chips potentes hasta los numerosos elementos químicos que contienen. A medida que los modelos de IA crecen en tamaño y capacidad, el estudio plantea una pregunta sencilla pero urgente: ¿cuál es el coste material de este progreso para el planeta y para las personas que viven cerca de minas y fábricas?

De la demanda creciente a los límites reales

Los autores comienzan situando la IA dentro de una historia más amplia de uso de recursos. En los últimos años, los centros de datos y los chips especializados se han convertido en piezas centrales de todo, desde la transmisión en línea hasta los servicios en la nube y, ahora, la IA. Los gigantes tecnológicos están invirtiendo cientos de miles de millones de dólares en nuevos centros de datos, y se espera que las cargas de trabajo de IA dominen su uso hacia finales de la década. Hasta ahora, el debate público se ha centrado principalmente en cuánta electricidad y agua consumen estos centros. Pero las máquinas en su núcleo dependen de una larga lista de metales y minerales, algunos de los cuales son escasos, difíciles de extraer o tóxicos si se gestionan mal. El estudio sostiene que para juzgar si la IA es realmente sostenible debemos ir más allá de contar kilovatios-hora y comenzar a contar también kilogramos de material.

De qué está hecho realmente un único chip de IA

Para anclar este asunto abstracto en hechos concretos, los investigadores desarmaron una unidad de procesamiento gráfico ampliamente utilizada, la Nvidia A100, y analizaron químicamente su contenido. Identificaron 32 elementos diferentes, incluidos metales comunes como cobre, hierro y estaño, junto con cantidades menores de níquel, bario, zinc y varios metales preciosos como el oro y la plata. De forma llamativa, alrededor del 90 por ciento de la masa del chip está compuesto por metales pesados, y aproximadamente el 93 por ciento consiste en elementos clasificados como peligrosos bajo condiciones típicas de exposición. Diferentes partes del chip tienen roles y composiciones distintas: el disipador térmico es casi puro cobre para la refrigeración, la placa de circuito mezcla cobre y hierro con otros aditivos, mientras que el pequeño núcleo de cálculo concentra silicio y una variedad de otros metales.

Cuántos chips hacen falta para enseñar a una IA a hablar

A continuación, el estudio vincula la carga de trabajo digital del entrenamiento de grandes modelos de IA con el desgaste físico del hardware. El esfuerzo de entrenamiento se mide en FLOPs, un conteo estándar de cuántos cálculos básicos realiza un modelo. Estimando cuántos FLOPs puede entregar una Nvidia A100 durante su vida útil y comparándolo con los presupuestos de cómputo reportados o inferidos para modelos importantes, los autores calculan cuántas GPU se «consumen» efectivamente en una sola ejecución de entrenamiento. Bajo supuestos realistas sobre la vida útil y la eficiencia del chip, entrenar un modelo de lenguaje de vanguardia como GPT-4 consume el equivalente a miles de unidades A100. Para un conjunto de nueve modelos prominentes, la demanda total de material se sitúa en el rango de varias toneladas de recursos extraídos, la mayoría metales peligrosos que conllevan riesgos durante la minería y la eliminación.

Pequeñas ganancias de rendimiento, grandes facturas materiales

El artículo compara luego cómo mejora el rendimiento de los modelos en relación con esta creciente carga de hardware. Usando pruebas estándar de habilidades matemáticas, conocimiento general, codificación, preguntas científicas y razonamiento cotidiano, los autores muestran que los modelos más nuevos y mucho más grandes a menudo ofrecen solo incrementos de puntuación modestos en comparación con sus predecesores, a pesar de usar decenas o incluso cientos de veces más cómputo. Algunas capacidades, como la resolución avanzada de problemas matemáticos, mejoran de forma dramática pero resultan especialmente hambrientas de recursos. Otras, como el razonamiento de sentido común básico, muestran solo ligeros avances incluso cuando las cargas de entrenamiento se disparan. Este patrón sugiere que simplemente escalar modelos y hardware es un camino cada vez más costoso hacia el progreso, no solo en términos de energía sino también en extracción de metales y futuros residuos electrónicos.

Maneras de alargar la vida útil de cada chip

El estudio también explora cómo una mejor ingeniería podría aliviar la carga material. Dos palancas destacan. Primero, mejorar el grado de utilización de cada GPU durante el entrenamiento puede reducir el número de unidades necesarias; aumentar la utilización de niveles bajos a altos puede reducir la demanda de GPU en más de la mitad. Segundo, extender la vida útil típica de los chips en centros de datos —de alrededor de uno a tres o incluso cinco años— recorta además el número total que debe producirse y, eventualmente, desecharse. Combinando estas medidas, los autores estiman que la demanda efectiva de GPU para entrenar un modelo como GPT-4 podría, en principio, reducirse en más del 90 por ciento. Sin embargo, advierten que las ganancias en el mundo real dependen de la refrigeración, el mantenimiento y el diseño del sistema, y que las mejoras de eficiencia a veces pueden estimular un mayor uso de la IA en general, compensando parte de los ahorros.

Qué significa esto para el futuro de la IA

Para concluir, los autores sostienen que la huella ambiental de la IA no puede juzgarse solo por los contadores eléctricos. Cada nueva generación de modelos potentes se edifica sobre una base de cobre, níquel, arsénico, plomo y muchos otros elementos extraídos de la tierra, a menudo en regiones con capacidad limitada para controlar la contaminación y proteger a los trabajadores. A medida que las ganancias de rendimiento por escalado masivo comienzan a disminuir, el estudio sugiere un cambio de prioridades: hacia arquitecturas más inteligentes, mejores algoritmos, datos de mayor calidad y hardware de mayor duración, en lugar de simplemente más de los mismos chips. Para los lectores en general, el mensaje es que nuestros asistentes digitales y herramientas creativas no son ingrávidos. Llevan un coste material oculto que debe reconocerse y gestionarse si la IA ha de crecer sin sobrepasar los límites de recursos y contaminación del planeta.

Cita: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Palabras clave: materiales de hardware de IA, impacto ambiental de las GPU, entrenamiento de grandes modelos de lenguaje, residuos electrónicos, computación sostenible