Clear Sky Science · it

Dalla computazione al costo ambientale: il peso delle risorse dell’intelligenza artificiale

Perché i metalli all’interno delle nostre macchine intelligenti sono importanti

Dietro ogni chatbot cordiale o generatore di immagini si nasconde un vasto mondo fatto di metallo, estrazione mineraria e produzione. Questo studio solleva il sipario digitale per mostrare che l’intelligenza artificiale (IA) non riguarda solo elettricità e dati. Riguarda anche l’hardware fisico che la rende possibile, dai chip potenti ai numerosi elementi chimici che contengono. Man mano che i modelli di IA diventano più grandi e capaci, lo studio pone una domanda semplice ma urgente: quale è il costo materiale di questo progresso per il pianeta e per le persone che vivono vicino a miniere e fabbriche?

Dalla domanda in aumento ai limiti del mondo reale

Gli autori iniziano coll’inquadrare l’IA all’interno di una storia più ampia sull’uso delle risorse. Negli ultimi anni, i data center e i chip specializzati sono diventati centrali per tutto, dallo streaming ai servizi cloud, fino all’IA. I giganti della tecnologia stanno investendo centinaia di miliardi di dollari in nuovi data center, e si prevede che i carichi di lavoro legati all’IA ne domineranno l’uso entro la fine del decennio. Finora, il dibattito pubblico si è concentrato principalmente su quanta elettricità e acqua consumano questi centri. Ma le macchine al loro cuore dipendono da una lunga lista di metalli e minerali, alcuni dei quali scarsi, difficili da estrarre o tossici se gestiti male. Lo studio sostiene che per giudicare se l’IA sia veramente sostenibile dobbiamo andare oltre il conteggio dei kilowattora e iniziare a contare anche i chilogrammi di materiale.

Di cosa è davvero composto un singolo chip per l’IA

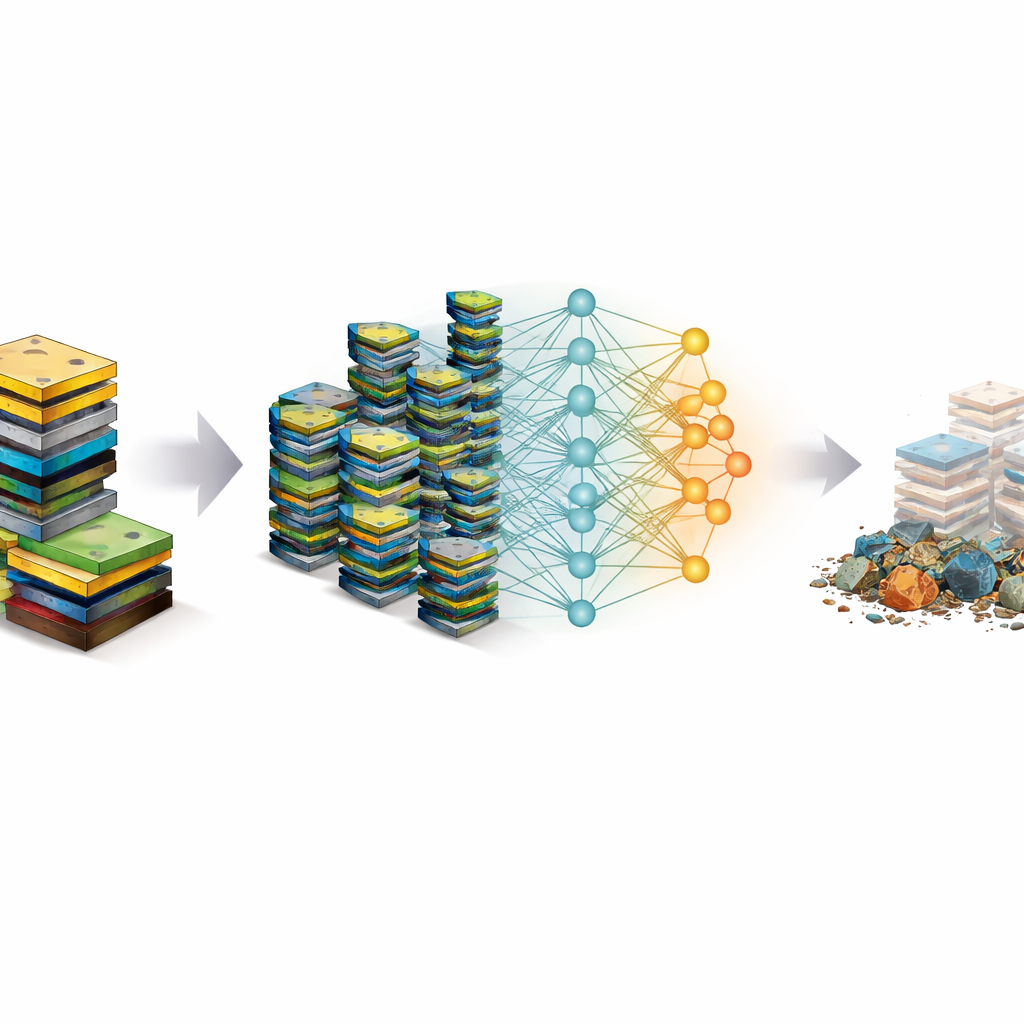

Per ancorare questa questione astratta a fatti concreti, i ricercatori hanno smontato un’unità di elaborazione grafica ampiamente utilizzata, la Nvidia A100, e ne hanno analizzato chimicamente i componenti. Hanno identificato 32 elementi diversi, inclusi metalli comuni come rame, ferro e stagno, insieme a quantità minori di nichel, bario, zinco e vari metalli preziosi come oro e argento. In modo sorprendente, circa il 90 percento della massa del chip è costituito da metalli pesanti, e approssimativamente il 93 percento è formato da elementi classificati come pericolosi in condizioni tipiche di esposizione. Diverse parti del chip hanno ruoli e composizioni distinti: il dissipatore è quasi puro rame per il raffreddamento, la scheda di circuito miscela rame e ferro con altri additivi, mentre il piccolo nucleo di calcolo concentra silicio e vari altri metalli.

Quanti chip servono per insegnare a un’IA a parlare

Successivamente, lo studio collega il carico di lavoro digitale dell’addestramento dei grandi modelli di IA all’usura fisica dell’hardware. Lo sforzo di addestramento è misurato in FLOP, un conteggio standard di quante operazioni elementari esegue un modello. Stimando quanti FLOP la Nvidia A100 può fornire nel corso della sua vita utile e confrontando questo valore con i budget di calcolo riportati o dedotti per i principali modelli, gli autori calcolano quante GPU vengono effettivamente “consumate” da una singola sessione di addestramento. Sotto ipotesi realistiche sulla durata e sull’efficienza del chip, l’addestramento di un modello linguistico all’avanguardia come GPT-4 consuma l’equivalente di migliaia di unità A100. Per un insieme di nove modelli di rilievo, la domanda totale di materiali rientra nell’ordine di diverse tonnellate di risorse estratte, per lo più metalli pericolosi che comportano rischi durante l’estrazione e lo smaltimento.

Piccoli guadagni di prestazioni, grandi bollette materiali

Il documento confronta poi come le prestazioni dei modelli migliorino rispetto a questo crescente onere hardware. Utilizzando test standard su abilità matematiche, conoscenza generale, programmazione, domande scientifiche e ragionamento quotidiano, gli autori mostrano che i modelli più recenti e molto più grandi spesso offrono solo aumenti di punteggio modesti rispetto ai predecessori, nonostante utilizzino decine o addirittura centinaia di volte più potenza di calcolo. Alcune capacità, come la risoluzione avanzata di problemi matematici, migliorano in modo drammatico ma risultano particolarmente voraci di risorse. Altre, come il ragionamento di buon senso di base, mostrano solo lievi miglioramenti anche quando i carichi di addestramento aumentano vertiginosamente. Questo quadro suggerisce che aumentare semplicemente scala e hardware è una strada sempre più costosa per il progresso, non solo in termini di energia ma anche di estrazione di metalli e di rifiuti elettronici futuri.

Modi per far durare di più ciascun chip

Lo studio esplora anche come un migliore ingegneria possa alleviare il carico materiale. Spiccano due leve. Primo, migliorare l’utilizzo effettivo di ciascuna GPU durante l’addestramento può ridurre il numero di unità necessarie; portare l’utilizzo da livelli bassi a livelli alti può ridurre la domanda di GPU di oltre la metà. Secondo, estendere la vita tipica dei chip nei data center — da circa uno a tre o anche cinque anni — riduce ulteriormente il totale che deve essere prodotto e infine scartato. Combinando queste misure, gli autori stimano che la domanda effettiva di GPU per addestrare un modello come GPT-4 potrebbe, in linea di principio, essere ridotta di oltre il 90 percento. Avvertono però che i guadagni nel mondo reale dipendono dal raffreddamento, dalla manutenzione e dal design del sistema, e che i miglioramenti di efficienza possono talvolta incentivare un uso maggiore dell’IA nel complesso, compensando in parte i risparmi.

Cosa significa questo per il futuro dell’IA

In chiusura, gli autori sostengono che l’impronta ambientale dell’IA non può essere valutata solo dai contatori dell’elettricità. Ogni nuova generazione di modelli potenti si basa su una base di rame, nichel, arsenico, piombo e molti altri elementi estratti dal sottosuolo, spesso in regioni con capacità limitata di controllare l’inquinamento e proteggere i lavoratori. Man mano che i guadagni di prestazione dovuti alla semplice espansione cominciano a ridursi, lo studio suggerisce uno spostamento delle priorità: verso architetture più intelligenti, algoritmi migliori, dati di qualità superiore e hardware più duraturo, piuttosto che semplicemente più degli stessi chip. Per i lettori quotidiani, il messaggio è che i nostri assistenti digitali e gli strumenti creativi non sono privi di peso. Portano un costo materiale nascosto che deve essere riconosciuto e gestito se l’IA deve crescere senza travolgere i limiti delle risorse e dell’inquinamento del pianeta.

Citazione: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Parole chiave: materiali hardware per l'IA, impatto ambientale delle GPU, addestramento dei grandi modelli di linguaggio, rifiuti elettronici, informatica sostenibile