Clear Sky Science · sv

Från beräkning till miljökostnad – artificiell intelligens resursbörda

Varför metallerna i våra smarta maskiner spelar roll

Bakom varje vänlig chattbot eller bildgenerator ligger en vidsträckt dold värld av metall, gruvdrift och tillverkning. Den här artikeln drar undan den digitala gardinen för att visa att artificiell intelligens (AI) inte bara handlar om elektricitet och data. Det handlar också om den fysiska hårdvaran som gör den möjlig, från kraftfulla kretsar till de många kemiska grundämnen de innehåller. När AI-modeller växer och blir allt mer kapabla ställer studien en enkel men angelägen fråga: vad är materialkostnaden för denna utveckling för planeten och för människor som bor nära gruvor och fabriker?

Från stigande efterfrågan till verkliga gränser

Författarna inleder med att placera AI i en bredare berättelse om resursanvändning. Under de senaste åren har datacenter och specialiserade chips blivit centrala för allt från streaming till molntjänster – och nu för AI. Teknikjättar satsar hundratals miljarder dollar på nya datacenter, och AI-arbetsbelastningar väntas dominera användningen mot slutet av decenniet. Hittills har den offentliga debatten främst handlat om hur mycket el och vatten dessa center drar. Men maskinerna i deras kärna är beroende av en lång lista metaller och mineraler, några av vilka är knappa, svåra att utvinna eller giftiga vid felhantering. Studien hävdar att för att bedöma om AI verkligen är hållbar måste vi gå bortom att räkna kilowattimmar och börja räkna kilogram material också.

Vad en enskild AI-chip egentligen består av

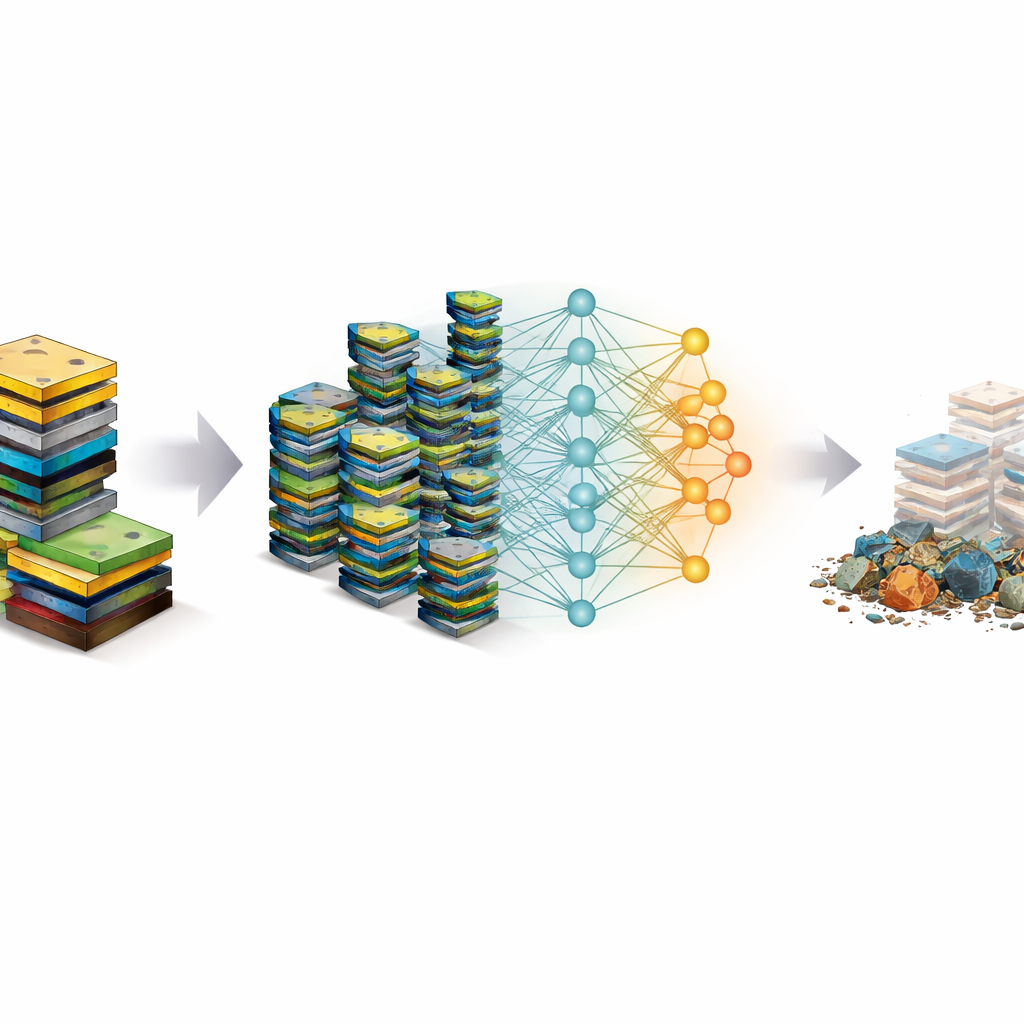

För att förankra denna abstrakta fråga i hårda fakta plockade forskarna isär en vida använd grafikprocessor, Nvidia A100, och analyserade dess innehåll kemiskt. De identifierade 32 olika grundämnen, inklusive vanliga metaller som koppar, järn och tenn, tillsammans med mindre mängder nickel, barium, zink och flera ädla metaller såsom guld och silver. Slående är att ungefär 90 procent av chippets massa utgörs av tunga metaller, och cirka 93 procent består av grundämnen klassade som farliga under typiska exponeringsförhållanden. Olika delar av chippet har skilda roller och sammansättningar: kylflänsen är nästan ren koppar för kylning, kretskortet blandar koppar och järn med andra tillsatser, medan den lilla beräkningskärnan koncentrerar kisel och en mängd andra metaller.

Hur många chips som krävs för att lära en AI att tala

Nästa steg kopplar det digitala arbetsbelastningen för träning av stora AI-modeller till det fysiska slitage på hårdvaran. Träningsinsats mäts i FLOP:s, ett standardmått på hur många grundläggande beräkningar en modell utför. Genom att uppskatta hur många FLOP:s en Nvidia A100 kan leverera under sin användbara livslängd, och jämföra detta med de beräkningsbudgetar som rapporterats eller härletts för stora modeller, räknar författarna ut hur många GPU:er som i praktiken ”förbrukas” av en enda träningsomgång. Under realistiska antaganden om chippets livslängd och effektivitet förbrukar träningen av en toppmodern språkmodell som GPT‑4 motsvarande tusentals A100-enheter. För en uppsättning av nio framträdande modeller hamnar den totala materialefterfrågan i spannet flera ton utvunna resurser, där majoriteten är farliga metaller som utgör risker vid gruvdrift och bortskaffande.

Små prestandavinster, stora materialkostnader

Artikeln jämför sedan hur modellernas prestanda förbättras i förhållande till denna växande hårdvarubörda. Med standardtester av matematiska färdigheter, allmänbildning, kodning, naturvetenskapliga frågor och vardagsresonemang visar författarna att nyare, mycket större modeller ofta bara ger måttliga poängökningar jämfört med sina föregångare, trots att de använder tio- till hundrafalt mer beräkningskraft. Vissa förmågor, som avancerad matematiklösning, förbättras dramatiskt men är särskilt resurskrävande. Andra, som grundläggande sunt förnuft, visar bara små förbättringar även när träningsarbetsbelastningen skjuter i höjden. Detta mönster tyder på att ren uppskalning av modeller och hårdvara blir en allt dyrare väg till framsteg – inte bara i termer av energi utan också vad gäller metallutvinning och framtida e‑avfall.

Sätt att få ut mer av varje chip

Studien utforskar också hur bättre ingenjörskonst kan lätta det materiella trycket. Två hävstänger framträder. För det första kan förbättrad utnyttjandegrad av varje GPU under träning minska antalet enheter som behövs; att höja användningsgraden från låga till höga nivåer kan krympa GPU‑efterfrågan med mer än hälften. För det andra minskar förlängd typisk livslängd för chips i datacenter – från omkring ett till tre eller till och med fem år – det totala antalet som måste produceras och slutligen kasseras. Genom att kombinera dessa åtgärder uppskattar författarna att den effektiva GPU‑efterfrågan för att träna en modell som GPT‑4 i princip skulle kunna minskas med mer än 90 procent. De varnar dock för att verkliga vinster beror på kylning, underhåll och systemdesign, och att effektivitetsförbättringar ibland kan driva på mer AI‑användning totalt sett och så kompensera delar av besparingarna.

Vad detta betyder för AI:s framtid

Avslutningsvis menar författarna att AI:s miljöavtryck inte kan bedömas enbart med elmätare. Varje ny generation av kraftfulla modeller är byggd på en grund av koppar, nickel, arsenik, bly och många andra element uppgrävda ur marken, ofta i regioner med begränsade möjligheter att kontrollera föroreningar och skydda arbetare. När prestandavinster från ren uppskalning börjar avta föreslår studien en förändring i prioriteringar: mot smartare arkitekturer, bättre algoritmer, högkvalitativare data och hårdvara med längre livslängd, snarare än bara fler av samma chip. För vardagsläsaren är budskapet att våra digitala assistenter och kreativa verktyg inte är viktlösa. De bär en dold materialkostnad som måste erkännas och hanteras om AI ska kunna växa utan att överbelasta planetens resurs‑ och föroreningsgränser.

Citering: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Nyckelord: AI-hårdvarumaterial, GPU miljöpåverkan, träning av stora språkmodeller, elektroniskt avfall, hållbar databehandling