Clear Sky Science · de

Von Berechnung zu Umweltkosten: die Ressourcenbelastung durch künstliche Intelligenz

Warum die Metalle in unseren smarten Maschinen eine Rolle spielen

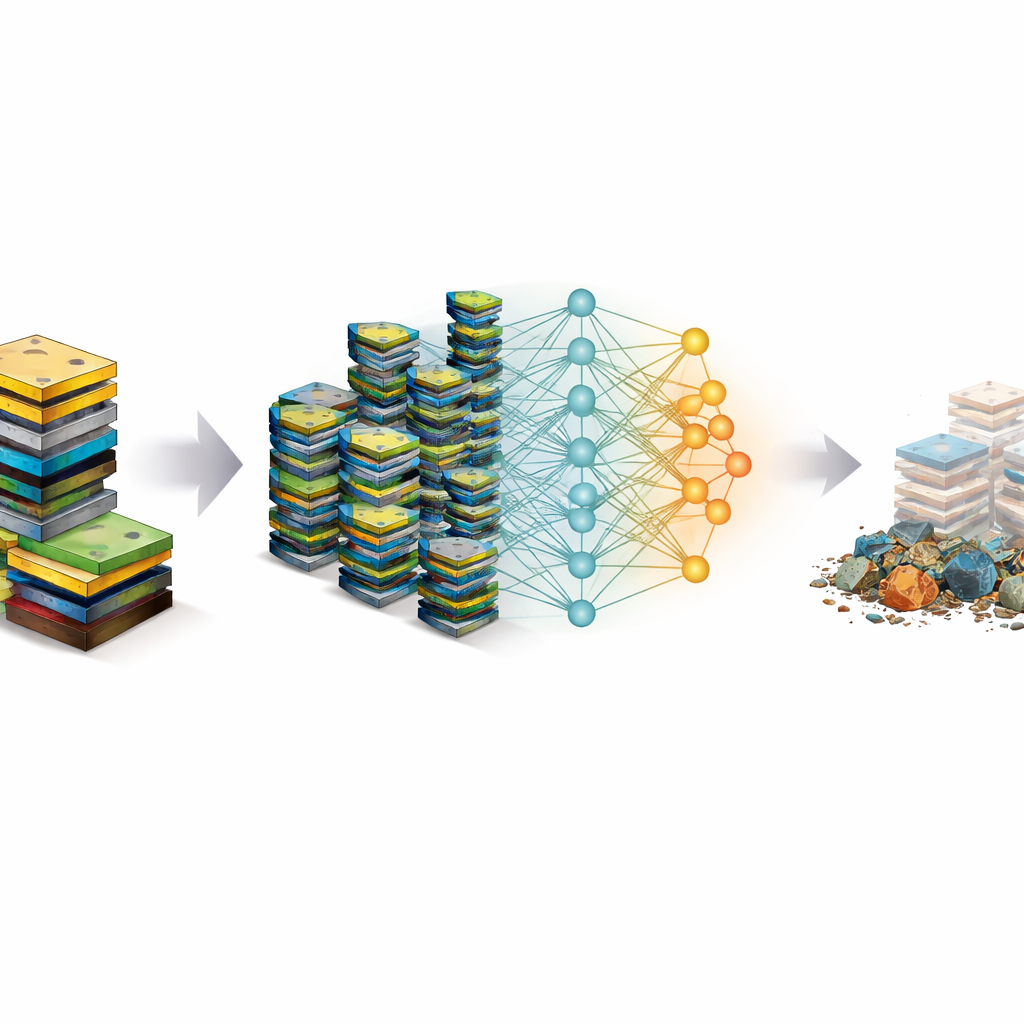

Hinter jedem freundlichen Chatbot oder Bildgenerator liegt eine umfangreiche, verborgene Welt aus Metall, Bergbau und Fertigung. Dieses Papier zieht den digitalen Vorhang beiseite und zeigt, dass künstliche Intelligenz (KI) nicht nur aus Strom und Daten besteht. Sie hängt auch von der physischen Hardware ab, die sie ermöglicht, von leistungsstarken Chips bis zu den vielen chemischen Elementen, die diese enthalten. Während KI‑Modelle größer und leistungsfähiger werden, stellt die Studie eine einfache, aber dringliche Frage: Welchen materiellen Preis zahlt der Planet — und die Menschen in der Nähe von Minen und Fabriken — für diesen Fortschritt?

Von wachsender Nachfrage zu realen Grenzen

Die Autorinnen und Autoren beginnen damit, KI in eine größere Geschichte des Ressourcenverbrauchs einzubetten. In den letzten Jahren sind Rechenzentren und spezialisierte Chips zentral geworden — für alles von Streaming bis hin zu Cloud‑Diensten und nun KI. Technologiekonzerne investieren Hunderte von Milliarden Dollar in neue Rechenzentren, und bis zum Ende des Jahrzehnts dürften KI‑Workloads dort dominieren. Die öffentliche Debatte konzentrierte sich bisher vor allem auf Strom‑ und Wasserverbrauch dieser Zentren. Doch die Maschinen im Kern benötigen eine lange Liste von Metallen und Mineralien, von denen einige knapp, schwer zu fördern oder bei unsachgemäßer Handhabung giftig sind. Die Studie argumentiert, dass wir, um zu beurteilen, ob KI wirklich nachhaltig ist, über Kilowattstunden hinausgehen und auch Kilogramm an Material zählen müssen.

Woraus ein einzelner KI‑Chip wirklich besteht

Um dieses abstrakte Thema mit harten Fakten zu untermauern, bauten die Forschenden eine weitverbreitete Grafikeinheit, die Nvidia A100, auseinander und analysierten ihre chemische Zusammensetzung. Sie identifizierten 32 verschiedene Elemente, darunter gängige Metalle wie Kupfer, Eisen und Zinn sowie kleinere Mengen von Nickel, Barium, Zink und mehrere Edelmetalle wie Gold und Silber. Auffällig ist, dass etwa 90 Prozent der Masse des Chips aus Schwermetallen besteht und rund 93 Prozent aus Elementen, die unter typischen Expositionsbedingungen als gefährlich eingestuft werden. Verschiedene Teile des Chips haben unterschiedliche Aufgaben und Zusammensetzungen: der Kühlkörper ist fast reines Kupfer zur Wärmeableitung, die Leiterplatte mischt Kupfer und Eisen mit weiteren Zusätzen, während der winzige Rechenkern Silizium und eine Reihe anderer Metalle konzentriert.

Wie viele Chips es braucht, um einer KI das Sprechen beizubringen

Im nächsten Schritt verknüpft die Studie die digitale Arbeitslast beim Training großer KI‑Modelle mit dem physischen Verschleiß der Hardware. Der Trainingsaufwand wird in FLOPs gemessen, einer Standardgröße dafür, wie viele Grundrechenoperationen ein Modell ausführt. Indem sie schätzten, wie viele FLOPs die Nvidia A100 über ihre Nutzungsdauer liefern kann, und dies mit den für große Modelle berichteten oder abgeleiteten Rechenbudgets verglichen, berechnen die Autorinnen und Autoren, wie viele GPUs durch einen einzelnen Trainingslauf effektiv „aufgebraucht“ werden. Unter realistischen Annahmen zu Chip‑Lebensdauer und Effizienz verbraucht das Training eines hochmodernen Sprachmodells wie GPT‑4 das Äquivalent von Tausenden A100‑Einheiten. Für eine Auswahl von neun prominenten Modellen liegt die gesamte Materialnachfrage im Bereich mehrerer Tonnen an geförderten Ressourcen, die meisten davon gefährliche Metalle, die beim Abbau und der Entsorgung Risiken bergen.

Kleine Leistungsgewinne, große Materialkosten

Die Arbeit vergleicht dann, wie sich die Modellleistung im Verhältnis zu dieser wachsenden Hardwarelast verbessert. Anhand gängiger Tests zu Mathematikfähigkeiten, Allgemeinwissen, Programmierung, naturwissenschaftlichen Fragen und Alltagslogik zeigen die Autorinnen und Autoren, dass neuere, deutlich größere Modelle oft nur moderate Punktsteigerungen gegenüber ihren Vorgängern liefern, obwohl sie zehn‑ bis hundertfach mehr Rechenleistung verbrauchen. Manche Fähigkeiten, etwa fortgeschrittenes mathematisches Problemlösen, verbessern sich dramatisch, scheinen aber besonders ressourcenintensiv zu sein. Andere, wie grundlegendes Alltagsverständnis, zeigen nur geringe Verbesserungen, selbst wenn die Trainingslast stark ansteigt. Dieses Muster legt nahe, dass bloßes Hochskalieren von Modellen und Hardware ein zunehmend kostspieliger Weg des Fortschritts ist — nicht nur in Bezug auf Energie, sondern auch hinsichtlich Metallförderung und zukünftigem Elektroschrott.

Möglichkeiten, jeden Chip länger nutzbar zu machen

Die Studie untersucht außerdem, wie bessere Technik die Materiallast mindern könnte. Zwei Stellschrauben stechen hervor. Erstens kann eine bessere Auslastung jeder GPU während des Trainings die benötigte Anzahl an Einheiten reduzieren; das Anheben der Nutzung von niedrigen auf hohe Niveaus kann die GPU‑Nachfrage mehr als halbieren. Zweitens reduziert eine Verlängerung der typischen Lebensdauer von Chips in Rechenzentren — von etwa einem auf drei oder sogar fünf Jahre — die insgesamt zu produzierende und schließlich zu entsorgende Stückzahl weiter. In Kombination schätzen die Autorinnen und Autoren, dass sich die effektive GPU‑Nachfrage für das Training eines Modells wie GPT‑4 prinzipiell um mehr als 90 Prozent reduzieren ließe. Sie warnen jedoch, dass reale Einsparungen von Kühlung, Wartung und Systemdesign abhängen und dass Effizienzverbesserungen manchmal zu mehr KI‑Nutzung insgesamt führen können, wodurch ein Teil der Einsparungen wieder aufgezehrt wird.

Was das für die Zukunft der KI bedeutet

Abschließend argumentieren die Autorinnen und Autoren, dass der ökologische Fußabdruck der KI nicht allein an Stromzählern gemessen werden kann. Jede neue Generation leistungsfähiger Modelle basiert auf Kupfer, Nickel, Arsen, Blei und vielen anderen Elementen, die aus der Erde geborgen werden — oft in Regionen mit begrenzten Möglichkeiten, Verschmutzung zu kontrollieren und Arbeiter zu schützen. Da die Leistungszuwächse durch reines Hochskalieren beginnen, abzuebben, schlägt die Studie eine Verschiebung der Prioritäten vor: hin zu schlaueren Architekturen, besseren Algorithmen, höherwertigen Daten und langlebigerer Hardware, statt einfach mehr der gleichen Chips. Für Leserinnen und Leser bedeutet das: Unsere digitalen Assistenten und kreativen Werkzeuge sind nicht ohne Gewicht. Sie tragen versteckte Materialkosten, die anerkannt und gesteuert werden müssen, wenn KI wachsen soll, ohne die Ressourcen- und Verschmutzungsgrenzen des Planeten zu überlasten.

Zitation: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Schlüsselwörter: Materialien für KI‑Hardware, Umweltauswirkung von GPUs, Training großer Sprachmodelle, elektronischer Abfall, nachhaltiges Rechnen