Clear Sky Science · pt

Do cálculo ao custo ambiental: o ônus de recursos da inteligência artificial

Por que os metais dentro de nossas máquinas inteligentes importam

Por trás de todo chatbot amigável ou gerador de imagens existe um vasto mundo oculto de metal, mineração e fabricação. Este artigo abre a cortina digital para mostrar que a inteligência artificial (IA) não se resume a eletricidade e dados. Trata-se também do hardware físico que a torna possível, desde chips potentes até os muitos elementos químicos que eles contêm. À medida que os modelos de IA ficam maiores e mais capazes, o estudo faz uma pergunta simples, porém urgente: qual é o custo material desse progresso para o planeta e para as pessoas que vivem próximas a minas e fábricas?

Da demanda crescente aos limites do mundo real

Os autores começam situando a IA dentro de uma história mais ampla de uso de recursos. Nos últimos anos, centros de dados e chips especializados tornaram-se centrais para tudo, desde streaming até serviços em nuvem, e agora para IA. Gigantes da tecnologia estão investindo centenas de bilhões de dólares em novos centros de dados, e espera-se que cargas de trabalho de IA passem a dominar seu uso até o fim da década. Até agora, o debate público concentrou-se principalmente em quanta eletricidade e água esses centros consomem. Mas as máquinas em seu núcleo dependem de uma longa lista de metais e minerais, alguns dos quais são escassos, difíceis de extrair ou tóxicos quando manuseados incorretamente. O estudo defende que, para avaliar se a IA é realmente sustentável, devemos ir além de contar quilowatt-hora e começar também a contar quilos de material.

Do que um único chip de IA é realmente feito

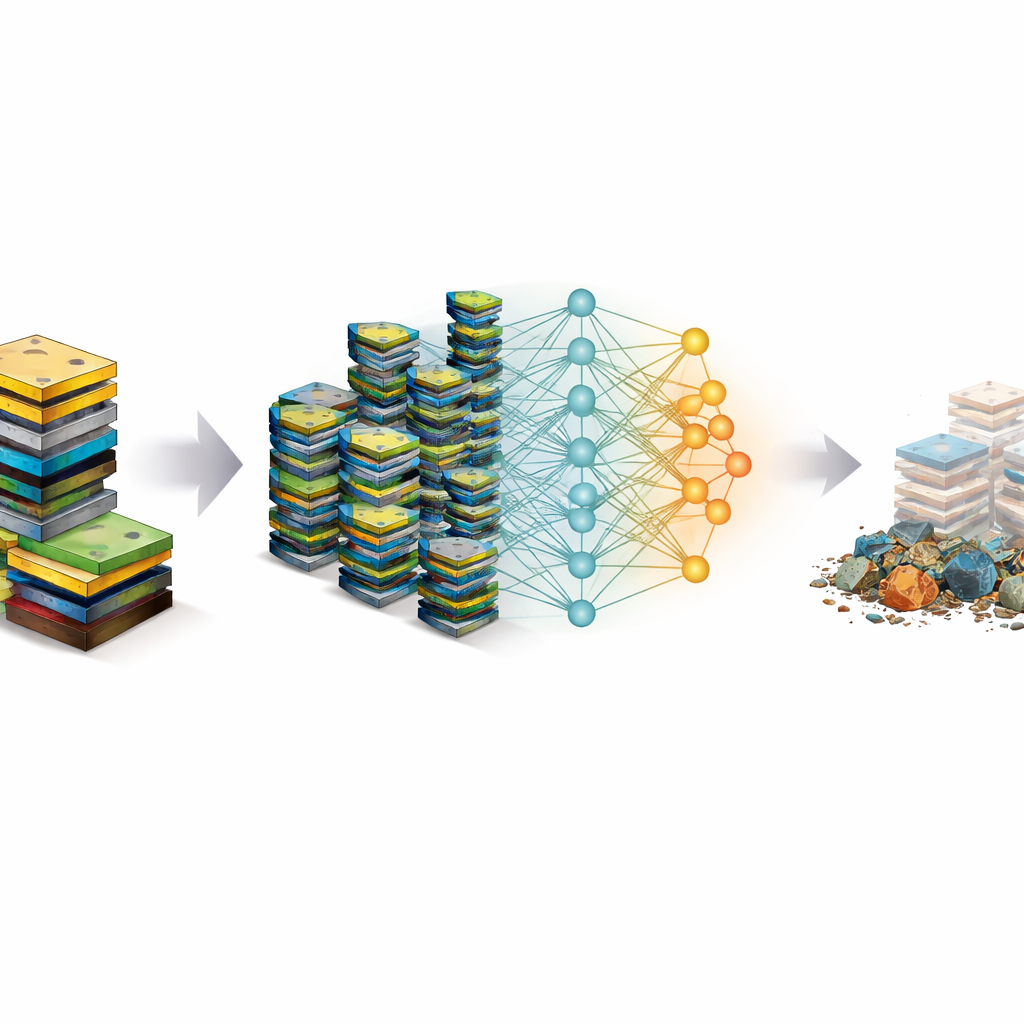

Para concretizar essa questão abstrata em fatos, os pesquisadores desmontaram uma unidade de processamento gráfico amplamente usada, a Nvidia A100, e analisaram quimicamente seu conteúdo. Identificaram 32 elementos diferentes, incluindo metais comuns como cobre, ferro e estanho, além de quantidades menores de níquel, bário, zinco e vários metais preciosos, como ouro e prata. De forma marcante, cerca de 90% da massa do chip é composta por metais pesados, e aproximadamente 93% consiste em elementos classificados como perigosos em condições típicas de exposição. Diferentes partes do chip têm papéis e composições distintas: o dissipador de calor é quase puro cobre para resfriamento, a placa de circuito mistura cobre e ferro com outros aditivos, enquanto o minúsculo núcleo de cálculo concentra silício e uma variedade de outros metais.

Quantos chips são necessários para ensinar uma IA a falar

Em seguida, o estudo relaciona a carga de trabalho digital do treinamento de grandes modelos de IA ao desgaste físico do hardware. O esforço de treinamento é medido em FLOPs, uma contagem padrão de quantas operações básicas um modelo realiza. Ao estimar quantos FLOPs a Nvidia A100 pode entregar durante sua vida útil e comparar isso com os orçamentos de computação relatados ou inferidos para os principais modelos, os autores calculam quantas GPUs são efetivamente “consumidas” por uma única execução de treinamento. Sob suposições realistas sobre vida útil e eficiência do chip, treinar um modelo de linguagem de ponta como o GPT-4 consome o equivalente a milhares de unidades A100. Para um conjunto de nove modelos proeminentes, a demanda total de material situa-se na ordem de várias toneladas de recursos extraídos, a maioria deles metais perigosos que apresentam riscos durante a mineração e o descarte.

Pequenos ganhos de desempenho, grandes faturas de material

O artigo compara então como o desempenho dos modelos melhora em relação a esse crescente ônus de hardware. Usando testes padrão de habilidades matemáticas, conhecimento geral, programação, questões científicas e raciocínio cotidiano, os autores mostram que modelos mais novos e muito maiores frequentemente oferecem apenas aumentos modestos de pontuação em comparação com seus predecessores, apesar de usarem dezenas ou até centenas de vezes mais computação. Algumas habilidades, como resolução avançada de problemas matemáticos, melhoram dramaticamente, mas parecem exigir muitos recursos. Outras, como raciocínio de senso comum básico, mostram apenas ganhos pequenos mesmo quando as cargas de treinamento disparam. Esse padrão sugere que simplesmente escalar modelos e hardware é um caminho cada vez mais custoso para o progresso, não só em termos de energia, mas também em termos de extração de metais e futuro lixo eletrônico.

Maneiras de estender a vida útil de cada chip

O estudo também explora como melhor engenharia pode aliviar a carga material. Duas alavancas se destacam. Primeiro, melhorar o quanto cada GPU é efetivamente utilizada durante o treinamento pode reduzir o número de unidades necessárias; elevar a utilização de níveis baixos para altos pode reduzir a demanda por GPUs em mais da metade. Segundo, estender a vida típica dos chips em centros de dados — de cerca de um para três ou até cinco anos — corta ainda mais o total que precisa ser produzido e, eventualmente, descartado. Combinando essas medidas, os autores estimam que a demanda efetiva por GPUs para treinar um modelo como o GPT-4 poderia, em princípio, ser reduzida em mais de 90%. No entanto, eles alertam que ganhos no mundo real dependem de resfriamento, manutenção e design de sistema, e que melhorias de eficiência às vezes podem estimular maior uso de IA no geral, compensando parte das economias.

O que isso significa para o futuro da IA

Para concluir, os autores defendem que a pegada ambiental da IA não pode ser avaliada apenas pelos medidores de eletricidade. Cada nova geração de modelos poderosos é construída sobre uma base de cobre, níquel, arsênico, chumbo e muitos outros elementos extraídos do solo, frequentemente em regiões com capacidade limitada para controlar a poluição e proteger os trabalhadores. À medida que os ganhos de desempenho por escalonamento bruto começam a diminuir, o estudo sugere uma mudança de prioridades: para arquiteturas mais inteligentes, algoritmos melhores, dados de maior qualidade e hardware de vida útil mais longa, em vez de simplesmente mais dos mesmos chips. Para leitores gerais, a mensagem é que nossos assistentes digitais e ferramentas criativas não são sem peso. Eles carregam um custo material oculto que precisa ser reconhecido e gerenciado se a IA for crescer sem sobrecarregar os limites de recursos e poluição do planeta.

Citação: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Palavras-chave: materiais de hardware de IA, impacto ambiental de GPU, treinamento de grandes modelos de linguagem, lixo eletrônico, computação sustentável