Clear Sky Science · nl

Van berekening tot milieukosten: de materiaallast van kunstmatige intelligentie

Waarom de metalen in onze slimme machines ertoe doen

Achter elke vriendelijke chatbot of beeldgenerator schuilt een uitgestrekte verborgen wereld van metaal, mijnbouw en productie. Dit artikel trekt het digitale gordijn open en laat zien dat kunstmatige intelligentie (AI) niet alleen over elektriciteit en data gaat. Het gaat ook over de fysieke hardware die het mogelijk maakt, van krachtige chips tot de vele chemische elementen die ze bevatten. Naarmate AI-modellen groter en capabeler worden, stelt de studie een eenvoudige maar urgente vraag: wat is de materiaalkost van deze vooruitgang voor de planeet en voor de mensen die nabij mijnen en fabrieken wonen?

Van stijgende vraag naar grenzen in de praktijk

De auteurs beginnen met het plaatsen van AI in een bredere context van hulpbronnengebruik. In de afgelopen jaren zijn datacenters en gespecialiseerde chips centraal komen te staan in alles van streaming tot clouddiensten, en nu ook in AI. Technologiebedrijven pompen honderden miljarden dollars in nieuwe datacenters, en naar verwachting zullen AI-workloads tegen het einde van het decennium hun gebruik domineren. Tot nu toe richt het publieke debat zich voornamelijk op hoeveel elektriciteit en water deze centra verbruiken. Maar de machines in hun kern zijn afhankelijk van een lange lijst metalen en mineralen, waarvan sommige schaars, moeilijk te delven of giftig zijn bij onjuiste behandeling. De studie betoogt dat we, om te beoordelen of AI werkelijk duurzaam is, verder moeten gaan dan het tellen van kilowatturen en ook kilo’s materiaal moeten gaan tellen.

Waaruit een enkele AI-chip echt bestaat

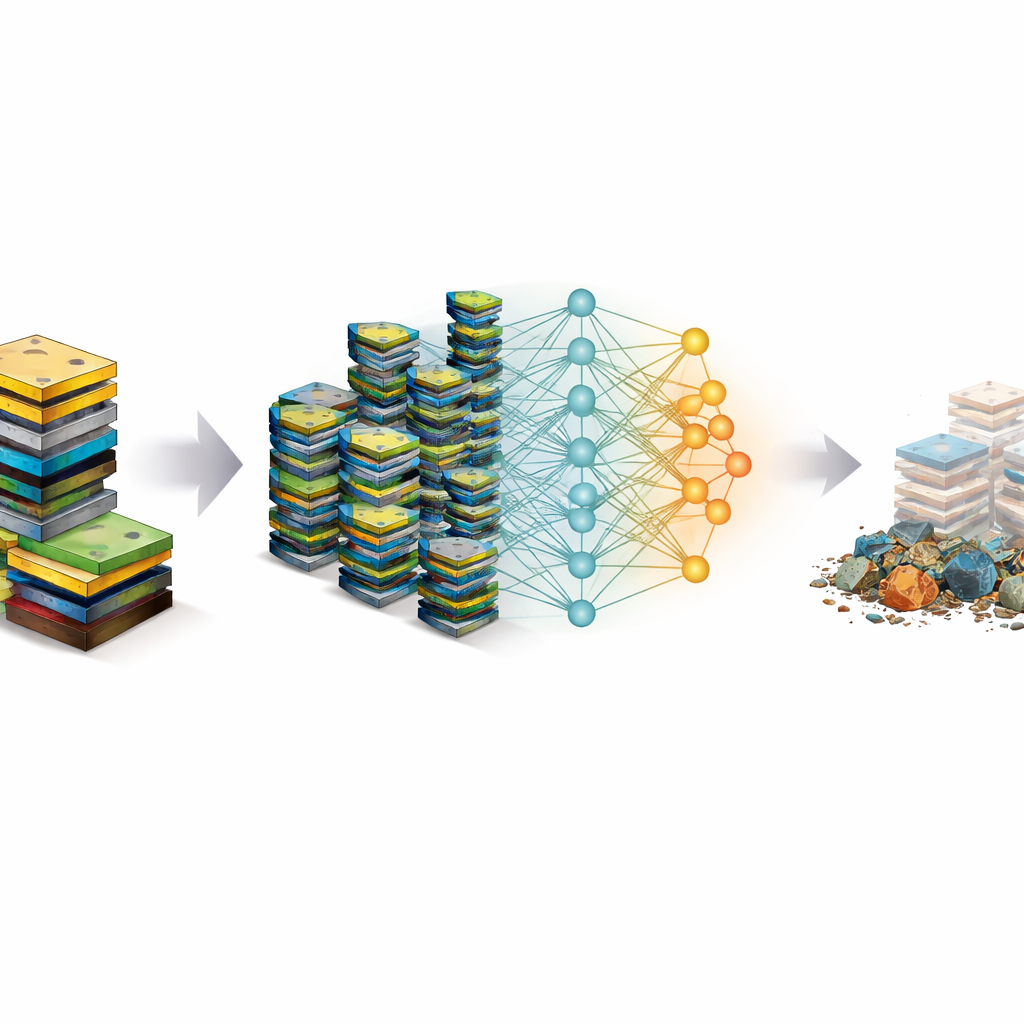

Om deze abstracte kwestie te verankeren in harde feiten, haalden de onderzoekers een veelgebruikte grafische verwerkingschip uit elkaar, de Nvidia A100, en analyseerden chemisch wat erin zat. Ze identificeerden 32 verschillende elementen, waaronder gangbare metalen zoals koper, ijzer en tin, samen met kleinere hoeveelheden nikkel, barium, zink en verschillende edelmetalen zoals goud en zilver. Opvallend is dat ongeveer 90 procent van de massa van de chip uit zware metalen bestaat, en ruwweg 93 procent uit elementen die onder typische blootstellingscondities als gevaarlijk worden geclassificeerd. Verschillende onderdelen van de chip hebben verschillende rollen en samenstellingen: de koellichaam bestaat bijna volledig uit koper voor koeling, de printplaat mengt koper en ijzer met andere toevoegingen, terwijl de kleine rekenkern silicium en een verscheidenheid aan andere metalen concentreert.

Hoeveel chips het kost om een AI te leren praten

Vervolgens koppelt de studie de digitale werklast van het trainen van grote AI-modellen aan de fysieke slijtage van hardware. Trainingsinspanning wordt gemeten in FLOP’s, een standaardtelling van hoeveel basale berekeningen een model uitvoert. Door te schatten hoeveel FLOP’s de Nvidia A100 over zijn nuttige levensduur kan leveren, en dit te vergelijken met de rekenbudgetten die zijn gerapporteerd of afgeleid voor grote modellen, berekenen de auteurs hoeveel GPU’s in feite “versleten” raken door een enkele trainingsrun. Onder realistische aannames over chiplevensduur en efficiëntie verbruikt het trainen van een state-of-the-art taalmodel zoals GPT-4 het equivalent van duizenden A100-eenheden. Voor een selectie van negen prominente modellen valt de totale materiaaleis in het bereik van enkele tonnen gewonnen grondstoffen, waarvan het grootste deel gevaarlijke metalen zijn die risico’s vormen tijdens mijnbouw en verwijdering.

Kleine prestatiewinst, grote materiaalkosten

Het artikel vergelijkt vervolgens hoe modelprestaties verbeteren ten opzichte van deze groeiende hardwarelast. Met behulp van standaardtests voor rekenvaardigheden, algemene kennis, coderen, wetenschappelijke vragen en alledaags redeneren tonen de auteurs aan dat nieuwere, veel grotere modellen vaak slechts bescheiden scoreverbeteringen leveren vergeleken met hun voorgangers, ondanks dat ze tientallen of zelfs honderden keren meer rekenkracht gebruiken. Sommige vaardigheden, zoals geavanceerd wiskundig probleemoplossen, verbeteren dramatisch maar blijken bijzonder hulpbronnenintensief. Andere, zoals basaal gezond verstandredeneren, laten slechts kleine verbeteringen zien, zelfs wanneer de trainingswerklast hoog oploopt. Dit patroon suggereert dat simpelweg opschalen van modellen en hardware een steeds kostbaardere route naar vooruitgang is, niet alleen in termen van energie maar ook wat betreft metaalwinning en toekomstig e‑afval.

Manieren om elke chip langer mee te laten gaan

De studie onderzoekt ook hoe betere engineering de materiaallast kan verlichten. Twee hefbomen springen eruit. Ten eerste kan het verbeteren van de benutting van elke GPU tijdens training het aantal benodigde eenheden verminderen; het verhogen van de benuttingsgraad van laag naar hoog kan de vraag naar GPU’s met meer dan de helft verkleinen. Ten tweede vermindert het verlengen van de typische levensduur van chips in datacenters — van ongeveer één naar drie of zelfs vijf jaar — bovendien het totaal aantal dat geproduceerd en uiteindelijk weggegooid moet worden. Door deze maatregelen te combineren schatten de auteurs dat de effectieve GPU-vraag voor het trainen van een model als GPT-4 in principe met meer dan 90 procent kan worden verminderd. Ze waarschuwen echter dat de werkelijke winst afhangt van koeling, onderhoud en systeembouw, en dat efficiëntieverbeteringen soms juist meer AI-gebruik kunnen aanwakkeren, waardoor een deel van de besparingen teniet kan worden gedaan.

Wat dit betekent voor de toekomst van AI

Tot slot betogen de auteurs dat de ecologische voetafdruk van AI niet alleen met elektriciteitsmeters kan worden beoordeeld. Elke nieuwe generatie krachtige modellen rust op een fundament van koper, nikkel, arsenicum, lood en vele andere elementen die uit de grond worden gehaald, vaak in regio’s met beperkte capaciteit om vervuiling te beheersen en arbeiders te beschermen. Nu de prestatiewinsten van brute-force opschaling beginnen af te nemen, suggereert de studie een verschuiving in prioriteiten: naar slimmere architecturen, betere algoritmen, hogere datakwaliteit en duurzamere hardware, in plaats van simpelweg meer van dezelfde chips. Voor alledaagse lezers is de boodschap dat onze digitale assistenten en creatieve tools niet gewichtloos zijn. Ze dragen een verborgen materiaalkost die erkend en beheerd moet worden als AI wil groeien zonder de grenzen van de planeet’s hulpbronnen en vervuiling te overschrijden.

Bronvermelding: Falk, S., Kluge Corrêa, N., Luccioni, S. et al. From computation to environmental cost the resource burden of artificial intelligence. Commun Earth Environ 7, 397 (2026). https://doi.org/10.1038/s43247-026-03537-5

Trefwoorden: materialen voor AI-hardware, milieu-impact van GPU's, training van grote taalmodellen, elektronisch afval, duurzaam rekenen