Clear Sky Science · zh

评估大型语言模型在药物治疗模拟中的应用:一项混合方法研究

这对未来药师为何重要

随着功能强大的聊天机器人在课堂和临床中越来越常见,教育者面临一个紧迫问题:这些工具能否安全地帮助培训将来管理高风险癌症治疗的药师?本研究深入考察了四种大型语言模型(LLM)在被要求运行两种严重血液系统肿瘤的现实药物治疗模拟时的表现,为可能很快影响卫生专业人员学习方式的技术提供了早期安全性评估。

在不冒患者风险的情况下练习

基于模拟的学习让药学学生能够在一个安全的环境中排练复杂的治疗决策,而无需在真实处方上犯错。传统上,这些模拟由经验丰富的教师设计和运行,虽然有效但耗时且难以扩展。大型语言模型承诺带来新途径:自动生成、交互式的病例,能够根据学生的回答调整并提供即时反馈。作者试图检验这一承诺在一个要求很高的领域是否成立——急性髓系白血病(AML)和慢性髓性白血病(CML)的药物治疗,这两种相关但治疗方式截然不同的白血病。

用成对的血液肿瘤进行严苛测试

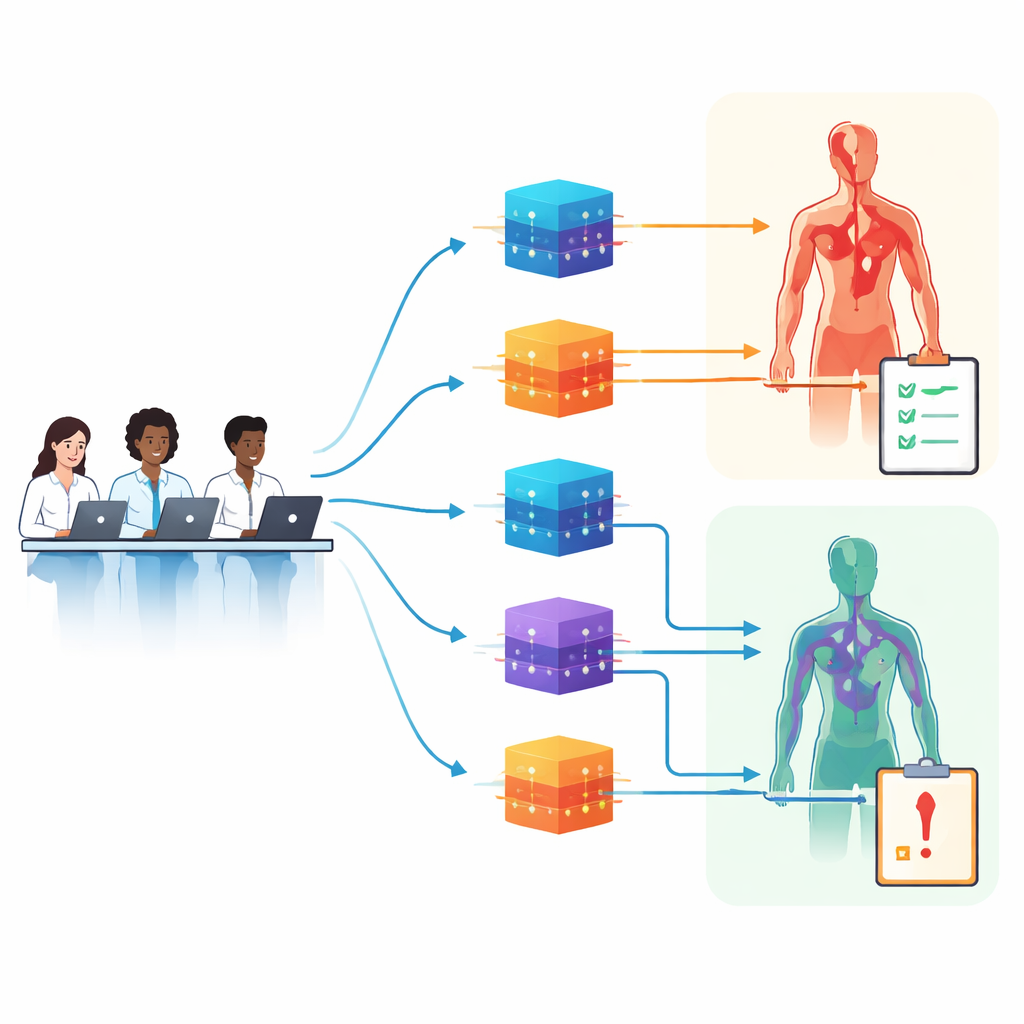

研究者选择AML和CML,因为它们在表面上可能相似,但需要截然不同的用药策略。这种相似性对LLM构成了“压力测试”:模型能否区分这些疾病,还是会混淆并建议错误的治疗?研究人员使用精心设计的主提示,要求四个平台生成完整的教学环节,包括患者病例、问题和逐步的推理过程。104名药学博士(PharmD)学生与这些由AI构建的模拟进行自然交互,同时肿瘤学和教育学专家小组从三个方面对每个环节进行评分:临床内容的真实度与指南一致性、所示推理的质量以及教学设计的合理性。

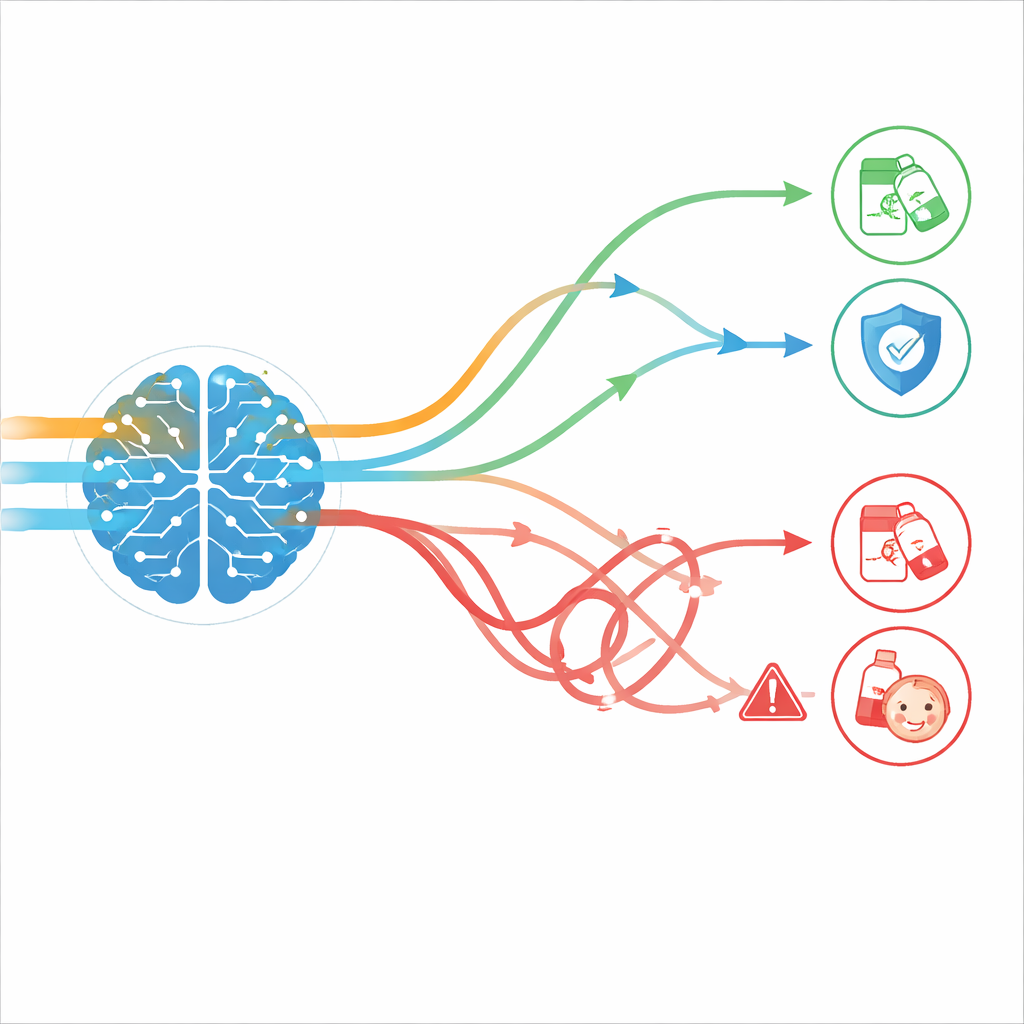

聊天机器人表现好的方面——以及失败的地方

在103个可用环节中,只有略多于一半(约52%)在三个领域同时达到专家标准。最强的方面是课程结构和模拟的推理:超过80%的环节提供了清晰的目标、有用的支架式设计以及可信的临床思路。换言之,LLM在讲述可信情境并以类似专家的方式分步决策方面表现良好。薄弱环节则是实际用药建议的准确性与安全性,仅约58%的环节合格。错误包括过时或不符合指南的选择、与剂量相关的不当决策、捏造的临床试验却带有逼真的细节,以及“领域纠缠”,即将用于一种白血病的治疗(或甚至另一种血液肿瘤的治疗)应用到另一种白血病上。值得注意的是,这类跨疾病混淆仅在更复杂的AML病例中出现。

不同的癌症、不同的模型、不同的结果

总体而言,CML模拟的表现优于AML,约三分之二的CML环节通过,而仅有约五成的AML环节通过。作者指出,CML较为线性的治疗规则可能比AML那种分支且依赖多因素的抉择更容易被LLM遵循。不同平台间的表现也有差异:一些模型生成了更安全的用药方案但教学设计略逊,另一些则提供结构优美的教学但临床错误更多。不过学生对各模型的喜好大致相当。他们的满意度高于“中性”基准,尤其赞赏易用性和节省时间,近一半学生表示更喜欢基于LLM的学习而非传统病例。关键是,学生的满意度并未与专家评判的安全性或准确性相关——无论是有缺陷的环节还是高质量的环节,学生的满意度都类似。

为何专家监督仍然重要

对教育者和卫生系统而言,结论是细致而微妙的。LLM已经能构建引人入胜、结构良好的模拟,这些模拟看起来真实并能帮助学生练习癌症治疗的推理过程。但同一模拟常常隐藏细微或严重的治疗错误,学习者难以自行发现。作者认为,至少在目前,应将AI用于起草模拟,然后由临床专家仔细审查和编辑,尤其是在像肿瘤学这样复杂且快速变化的领域。通过更完善的防护措施——例如实时接入指南、针对捏造证据的核查以及防止相关疾病混淆的更强保护——LLM最终可能提供安全且可扩展的培训。在此之前,人类判断仍是将打磨过的AI病例和未来学生面对的真实患者之间的关键安全网。

引用: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

关键词: 药学教育, 大型语言模型, 癌症药物治疗, 医学模拟, 人工智能安全