Clear Sky Science · nl

Het evalueren van grote taalmodellen voor farmacotherapiesimulaties: een mixed-methods studie

Waarom dit belangrijk is voor toekomstige apothekers

Naarmate krachtige chatbots steeds meer in klaslokalen en klinieken verschijnen, stellen opleiders een urgente vraag: kunnen deze hulpmiddelen veilig helpen bij het opleiden van toekomstige apothekers die verantwoordelijk zijn voor risicovolle kankerbehandelingen? Deze studie onderzoekt hoe vier grote taalmodellen (LLM’s) presteren wanneer ze worden gevraagd realistische farmacotherapiesimulaties uit te voeren voor twee ernstige bloedkankers, en biedt daarmee een vroege veiligheidscontrole op technologie die mogelijk binnenkort bepaalt hoe zorgprofessionals leren.

Oefenen zonder patiënten in gevaar te brengen

Simulatiegebaseerd leren stelt apotheekstudenten in staat complexe behandelbeslissingen te oefenen in een veilige omgeving voordat ze ooit een echt recept uitschrijven. Traditioneel worden deze simulaties ontworpen en uitgevoerd door deskundige docenten, wat effectief is maar veel tijd kost en moeilijk schaalbaar is. LLM’s beloven iets nieuws: automatisch gegenereerde, interactieve casussen die zich kunnen aanpassen aan de antwoorden van een student en directe feedback geven. De auteurs wilden testen of die belofte standhoudt in een veeleisend domein — farmacotherapie voor acute myeloïde leukemie (AML) en chronische myeloïde leukemie (CML), twee verwante maar zeer verschillend behandelde kankers.

Een zware test met twee verwante bloedkankers

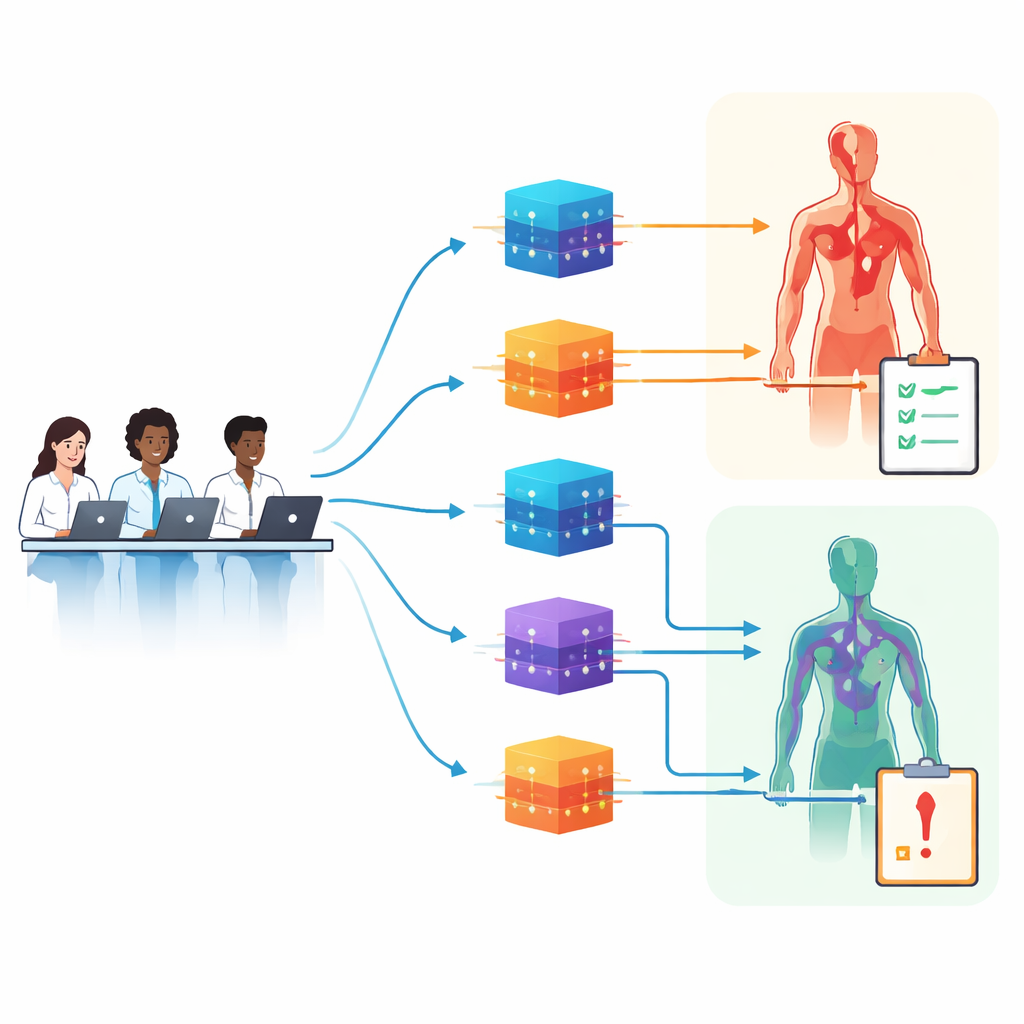

De onderzoekers kozen AML en CML omdat ze op papier op elkaar lijken maar sterk verschillende medicatiestrategieën vereisen. Die gelijkenis vormt een "stress-test" voor LLM’s: kunnen de modellen de ziekten uit elkaar houden, of zullen ze ze door elkaar halen en de verkeerde therapie voorstellen? Met een zorgvuldig geëngineerde master-prompt vroegen ze vier grote platforms volledige lesmomenten te genereren, inclusief patiëntencasuïstiek, vragen en stapsgewijs redeneren. Honderdvier PharmD-studenten gingen natuurlijk in gesprek met deze door AI gebouwde simulaties, terwijl panels van oncologie- en onderwijsexperts elke sessie beoordeelden op drie aspecten: hoe realistisch en richtlijnconform de klinische inhoud was, hoe goed het redeneren werd gemodelleerd en hoe degelijk het didactisch ontwerp leek.

Waar de chatbots goed presteerden — en waar ze faalden

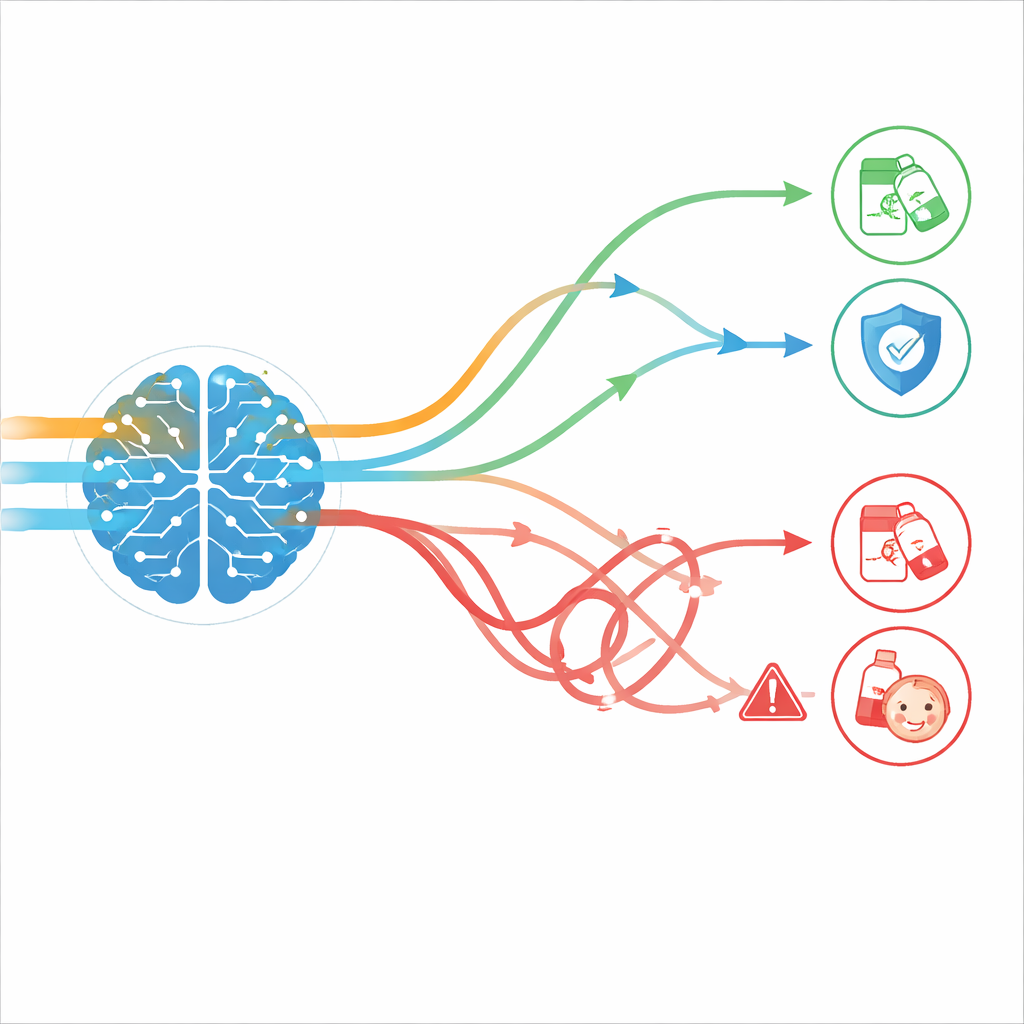

Uit 103 bruikbare sessies voldeed iets meer dan de helft (ongeveer 52%) in alle drie de domeinen tegelijk aan de deskundigenstandaard. De sterkste gebieden waren lesstructuur en gemodelleerd redeneren: meer dan 80% van de sessies bood duidelijke leerdoelen, nuttige opbouw en plausibele klinische denkprocessen. Met andere woorden: de LLM’s waren redelijk goed in het vertellen van een geloofwaardig verhaal en het stapsgewijs doorlopen van beslissingen op een manier die leek op deskundig redeneren. De zwakke plek was de nauwkeurigheid en veiligheid van de feitelijke medicatieaanbevelingen, die slechts in ongeveer 58% van de gevallen door de keuring kwamen. Fouten omvatten verouderde of niet-richtlijnconforme keuzes, onjuiste dosisgerelateerde beslissingen, verzonnen klinische onderzoeken met realistisch klinkende details en "domeinverstrengeling", waarbij behandelingen bedoeld voor de ene leukemie — of zelfs voor een geheel andere bloedkanker — werden toegepast op een andere. Opmerkelijk genoeg trad dit soort cross-ziektevermenging alleen op bij de complexere AML-casuïstiek.

Verschillende kankers, verschillende modellen, verschillende uitkomsten

CML-simulaties presteerden over het algemeen beter dan AML-simulaties: ongeveer drie op de vijf CML-sessies slaagden, versus slechts twee op de vijf voor AML. De auteurs suggereren dat de meer lineaire behandelregels van CML voor LLM’s gemakkelijker te volgen zijn dan de vertakkende, multifactor-keuzes bij AML. De prestaties verschilden ook per platform: sommige modellen produceerden veiligere behandelplannen maar hadden iets zwakkere lesopzet, terwijl andere prachtig gestructureerd onderwijs boden met vaker klinische fouten. Studenten leken ze desalniettemin ongeveer evenveel te waarderen. Ze rapporteerden een hogere tevredenheid dan de "neutrale" benchmark, prezen met name het gebruiksgemak en de tijdsbesparing, en bijna de helft zei LLM-gebaseerd leren te verkiezen boven traditionele casussen. Cruciaal is dat hun tevredenheid niet samenhing met door experts beoordeelde veiligheid of nauwkeurigheid — studenten waren net zo tevreden met gebrekkige sessies als met hoogwaardige.

Waarom deskundig toezicht nog steeds van belang is

Voor opleiders en zorgsystemen is de boodschap genuanceerd. LLM’s lijken al in staat om boeiende, goed gestructureerde simulaties te bouwen die realistisch aanvoelen en studenten helpen redeneren over kankertherapie. Maar dezelfde sessies verbergen vaak subtiele of ernstige behandelingsfouten die leerlingen waarschijnlijk niet zelf zullen opmerken. De auteurs betogen dat AI, althans voorlopig, gebruikt zou moeten worden om simulaties te schetsen die vervolgens zorgvuldig worden beoordeeld en bewerkt door klinische experts, vooral in complexe, snel veranderende vakgebieden zoals oncologie. Met betere waarborgen — zoals realtime toegang tot richtlijnen, controles op gefabriceerd bewijs en sterkere veiligheidsmechanismen tegen het door elkaar halen van verwante ziekten — kunnen LLM’s uiteindelijk veilig, schaalbaar onderwijs leveren. Tot die tijd blijft menselijk oordeel het cruciale veiligheidsnet tussen een gepolijste AI-casus en de echte patiënten die studenten ooit zullen behandelen.

Bronvermelding: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Trefwoorden: apotheekonderwijs, grote taalmodellen, kankerfarmacotherapie, medische simulatie, AI-veiligheid