Clear Sky Science · he

הערכת מודלים לשוניים גדולים עבור סימולציות פארмакותרפיה: מחקר מעורב‑שיטות

מדוע זה חשוב עבור רוקחים עתידיים

עם התפשטות צ׳אטבוטים רבי‑עוצמה בכיתות ובמרפאות, מחנכים נשאלים שאלה דחופה: האם הכלים הללו יכולים לסייע בבטחה בהכשרת רוקחים שינהלו טיפולים סרטניים בסיכון גבוה? המחקר בוחן כיצד ארבעה מודלים לשוניים גדולים (LLMs) מתפקדים כאשר מבקשים מהם לערוך סימולציות טיפוליות ריאליסטיות לשני סוגי סרטן דם קשים, ומספק בדיקת‑בטיחות מוקדמת לטכנולוגיה שעשויה לעצב בקרוב את הדרכים בהן אנשי מקצוע רפואיים לומדים.

אימון ללא סיכון למטופלים

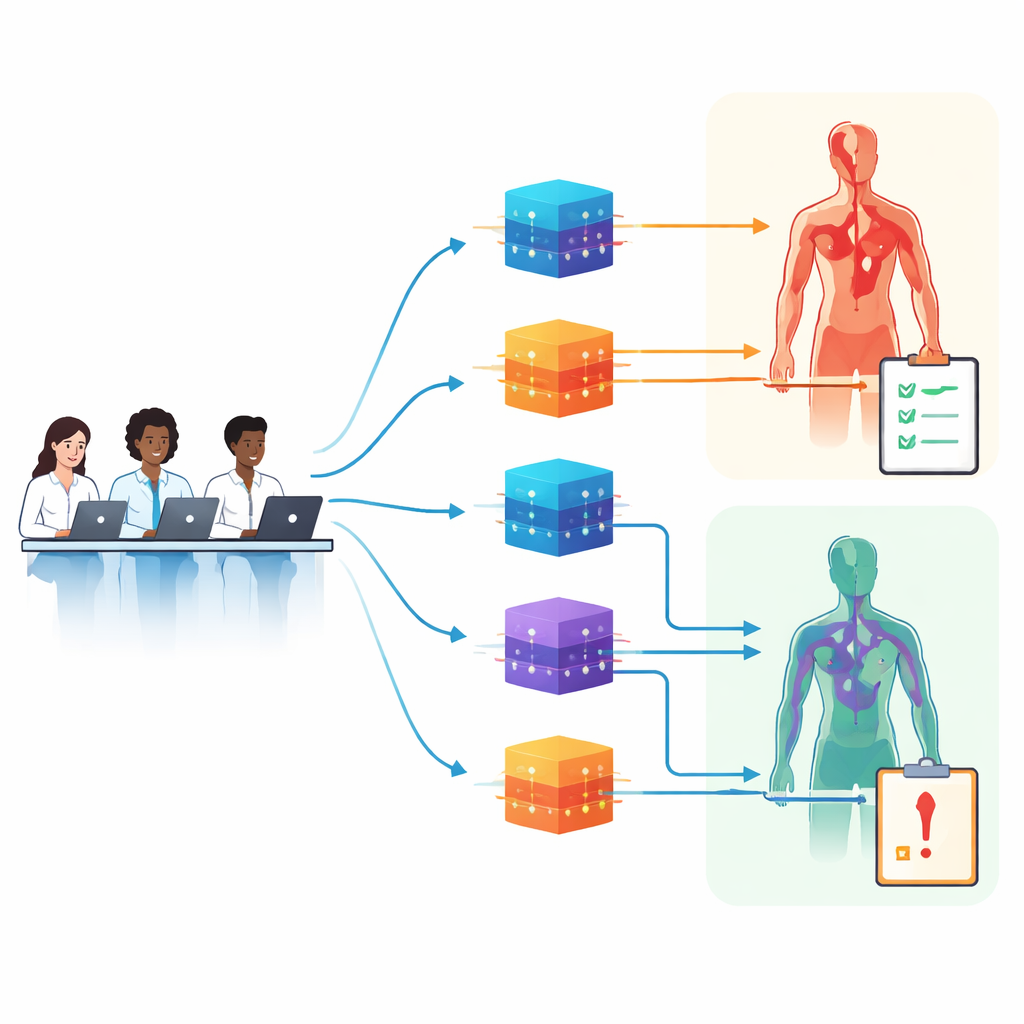

למידה מבוססת סימולציה מאפשרת לסטודנטים לרוקחות לתרגל החלטות טיפול מורכבות בסביבה בטוחה לפני שהם כותבים מרשם אמיתי. בדרך כלל סימולציות אלה מעוצבות ומנוהלות על ידי צוות מומחים, מה שאפקטיבי אך גוזל זמן וקשה לשלב בקנה מידה גדול. מודלים לשוניים גדולים מבטיחים משהו חדש: יצירת מקרים אינטראקטיביים באופן אוטומטי שיכולים להסתגל לתשובות הסטודנט ולספק משוב מיידי. המחברים בדקו האם ההבטחה הזו מתקיימת בתחום תובעני — פארמקותרפיה של לוקמיה מיאלואידית חריפה (AML) ולוקמיה מיאלואידית כרונית (CML), שני סוגים קרובים אך מטופלים בצורה שונה באופן מובהק.

מבחן קשה באמצעות סרטן דם תאום

החוקרים בחרו ב‑AML וב‑CML כי בשטח הם דומים, אך דורשים אסטרטגיות תרופתיות שונות באופן נחרץ. הדמיון הזה יוצר "מבחן לחץ" ל‑LLMs: האם המודלים ישמרו על הבחנה בין המחלות, או שמא הם ימזגו ביניהן וימליצו על טיפול שגוי? באמצעות פרומפט מתקדם ומהונדס בקפידה, הם ביקשו מארבע פלטפורמות עיקריות ליצור מפגשי הוראה מלאים, כולל מקרים קליניים, שאלות ותהליכי חשיבה שלב‑אחר‑שלב. מאה וארבעה סטודנטים לתואר PharmD התקשו באופן טבעי עם הסימולציות שבנה ה‑AI, בעוד פאנלים של מומחי אונקולוגיה וחינוך דירגו כל מפגש בשלושה מישורים: מידת הריאליזם והתאימות להנחיות הקליניות, איכות המידול של החשיבה הקלינית, ומידת התכנון ההדרכתי התקין.

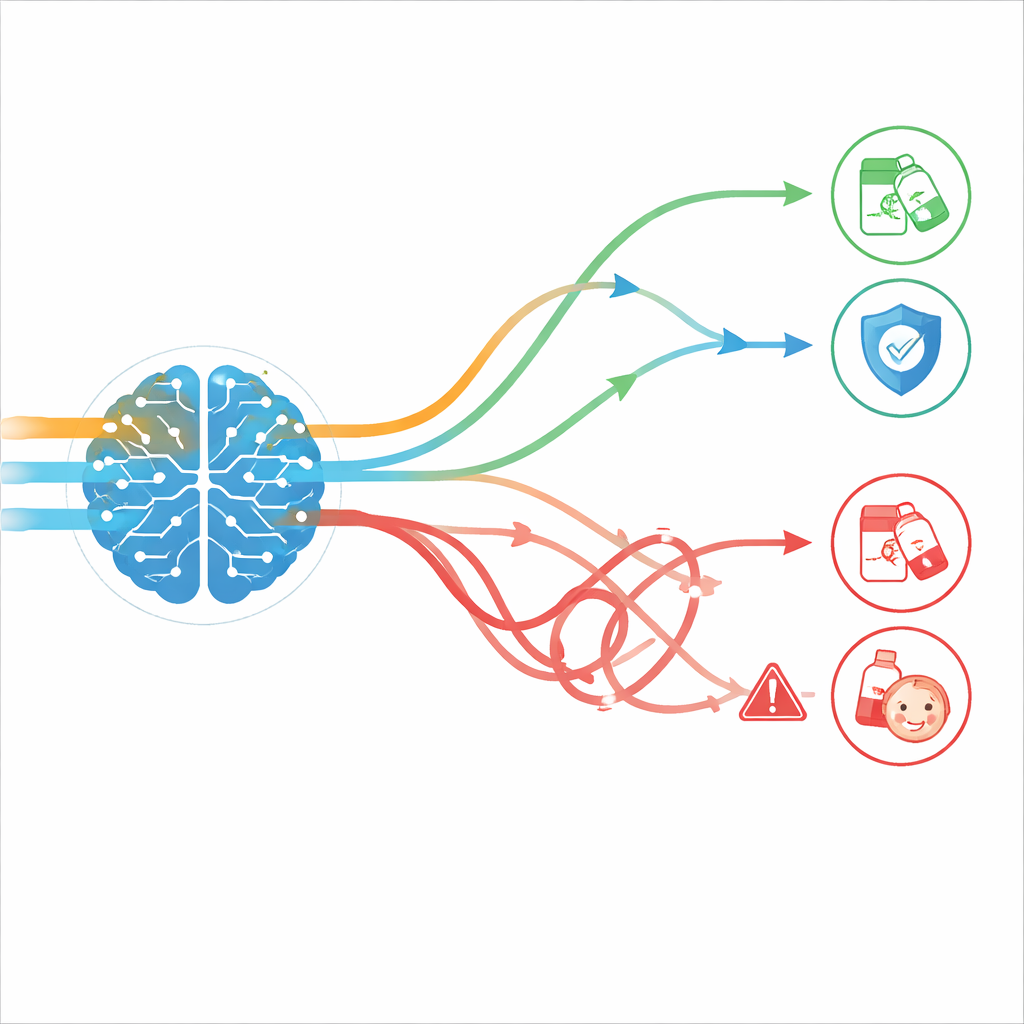

מה הצ׳אטבוטים עשו טוב — והיכן הם כשלו

ב‑103 מפגשים שניתן היה לנתח, קצת יותר ממחצית (כ‑52%) עמדו בסטנדרט המומחים בשלושת התחומים יחד. התחומים החזקים ביותר היו מבנה השיעור ומידול החשיבה: יותר מ‑80% מן המפגשים הציגו מטרות ברורות, סולמות תמיכה שימושיים ותהליכי חשיבה קליניים סבירים. במילים אחרות, ה‑LLMs היו טובים ביצירת סיפור משכנע ובהצגת החלטות באופן שנראה כמו טיעון מומחה. הנקודה החלשה הייתה הדיוק והבטיחות של ההמלצות התרופתיות בפועל, שעברו רק בכ‑58% מהמקרים. השגיאות כללו בחירות מיושנות או שאינן תואמות הנחיות, החלטות שגויות הקשורות למינון, המצאת ניסויים קליניים עם פרטים שנשמעו אמינים, ו"שיבוש תחומי" (domain entanglement), שבו טיפולים שמיועדים ללוקמיה אחת — או אפילו לסרטן דם אחר — יוחלו על אחרת. יש לציין שהופעת מיזוג מחלות כזה התרחשה בעיקר במקרים המסובכים יותר של AML.

סרטן שונה, מודלים שונים, תוצאות שונות

סימולציות CML הצליחו טוב יותר באופן כללי מאשר סימולציות AML, עם בערך שלוש מתוך חמש מפגשי CML שעברו לעומת שתי מתוך חמש של AML. המחברים מציעים שחוקי הטיפול הליניאריים יותר ב‑CML קלים יותר עבור LLMs לעקוב אחריהם מאשר הבחירות המתפצלות והרבות‑גורמים ב‑AML. הביצועים השתנו גם בין פלטפורמות: חלק מהמודלים ייצרו תכניות תרופתיות בטוחות יותר אך עם עיצוב שיעור חלש יותר במעט, בעוד אחרים הציעו הוראה מסודרת יפה אך עם טעויות קליניות תכופות יותר. עם זאת, הסטודנטים נטו לחבב את כולם בערך באותה מידה. הם דיווחו על שביעות רצון גבוהה יותר מאשר קו הבסיס ה"נייטרלי", בעיקר שבח לגבי קלות השימוש וחיסכון בזמן, וכמעט חצי אמרו שהם מעדיפים למידה מבוססת LLM על פני מקרים מסורתיים. משמעותית, שביעות הרצון שלהם לא התאמה לשיפוט המומחים לגבי בטיחות או דיוק — הסטודנטים היו מרוצים בדיוק באותה מידה מהמקרים הפגומים כמו מהמקרים האיכותיים.

מדוע השגחה מקצועית עדיין חשובה

למחנכים ולמערכות הבריאות המסר מורכב. נראה כי LLMs כבר מסוגלים ליצור סימולציות מרתקות ומובנות היטב שמרגישות ריאליסטיות ועוזרות לסטודנטים לתרגל חשיבה על טיפול בסרטן. אך באותם מפגשים לעתים קרובות מסתתרות שגיאות טיפול עדינות או חמורות שלימוד אין סביר שיזהה לבדו. המחברים טוענים שלפחות בינתיים, יש להשתמש בבינה מלאכותית כדי לערוך טיוטות של סימולציות שהן לאחר מכן יעברו סקירה ועריכה קפדניות על‑ידי מומחים קליניים, במיוחד בתחומים מורכבים ומשתנים במהירות כמו אונקולוגיה. עם שומרי סף טובים יותר — כגון גישה בזמן אמת להנחיות, בדיקות נגד ראיות מומצאות ואמצעי הגנה חזקים יותר מפני מיזוג מחלות קרובות — LLMs עשויים בסופו של דבר לספק הכשרה בטוחה וניתנת להרחבה. עד אז, השפיטה האנושית נשארת רשת הביטחון הקריטית בין מקרה‑AI מלוטש לבין המטופלים האמיתיים שהסטודנטים יטפלו בהם יום אחד.

ציטוט: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

מילות מפתח: חינוך בביקורת, מודלים לשוניים גדולים, פארמקותרפיה של סרטן, סימולציה רפואית, בטיחות בינה מלאכותית