Clear Sky Science · pt

Avaliação de grandes modelos de linguagem para simulações de farmacoterapia: um estudo de métodos mistos

Por que isso importa para futuros farmacêuticos

À medida que chatbots poderosos se tornam mais comuns em salas de aula e clínicas, educadores fazem uma pergunta urgente: essas ferramentas podem ajudar com segurança a formar futuros farmacêuticos que irão manejar tratamentos oncológicos de alto risco? Este estudo investiga como quatro grandes modelos de linguagem (LLMs) se saem ao serem solicitados a executar simulações realistas de terapias medicamentosas para dois cânceres sanguíneos graves, oferecendo uma verificação inicial de segurança sobre uma tecnologia que em breve pode moldar a formação de profissionais de saúde.

Prática sem colocar pacientes em risco

O aprendizado baseado em simulação permite que estudantes de farmácia ensaiem decisões complexas de tratamento em um ambiente seguro antes de prescrever de fato. Tradicionalmente, essas simulações são elaboradas e conduzidas por docentes especialistas, o que é eficaz, porém demanda tempo e é difícil de escalar. Os LLMs prometem algo novo: casos interativos gerados automaticamente que podem se adaptar às respostas do aluno e fornecer feedback instantâneo. Os autores propuseram testar se essa promessa se sustenta em uma área exigente — farmacoterapia da leucemia mieloide aguda (LMA) e da leucemia mieloide crônica (LMC), dois cânceres relacionados, porém tratados de formas muito distintas.

Um teste rigoroso com dois cânceres sanguíneos

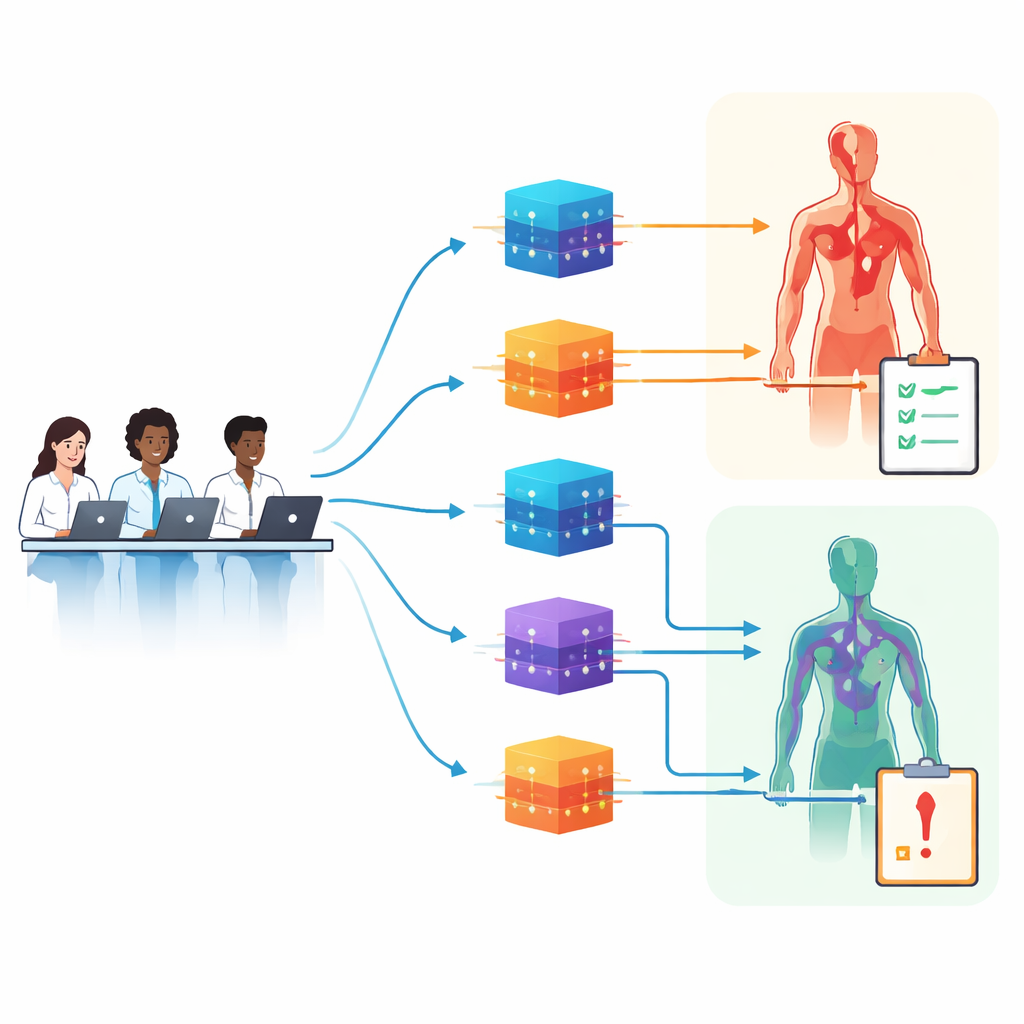

Os pesquisadores escolheram LMA e LMC porque podem parecer semelhantes em termos clínicos, mas exigem estratégias de tratamento nitidamente diferentes. Essa semelhança cria um “teste de estresse” para os LLMs: os modelos conseguem diferenciar as doenças ou irão confundi‑las e sugerir terapias inadequadas? Usando um prompt mestre cuidadosamente elaborado, solicitaram a quatro grandes plataformas que gerassem sessões de ensino completas, incluindo casos de pacientes, perguntas e raciocínio passo a passo. Cento e quatro estudantes de PharmD interagiram naturalmente com essas simulações geradas por IA, enquanto painéis de especialistas em oncologia e educação avaliaram cada sessão em três frentes: quão realista e alinhado às diretrizes era o conteúdo clínico, quão bem o raciocínio foi modelado e quão sólido parecia o desenho instrucional.

Onde os chatbots foram bem — e onde falharam

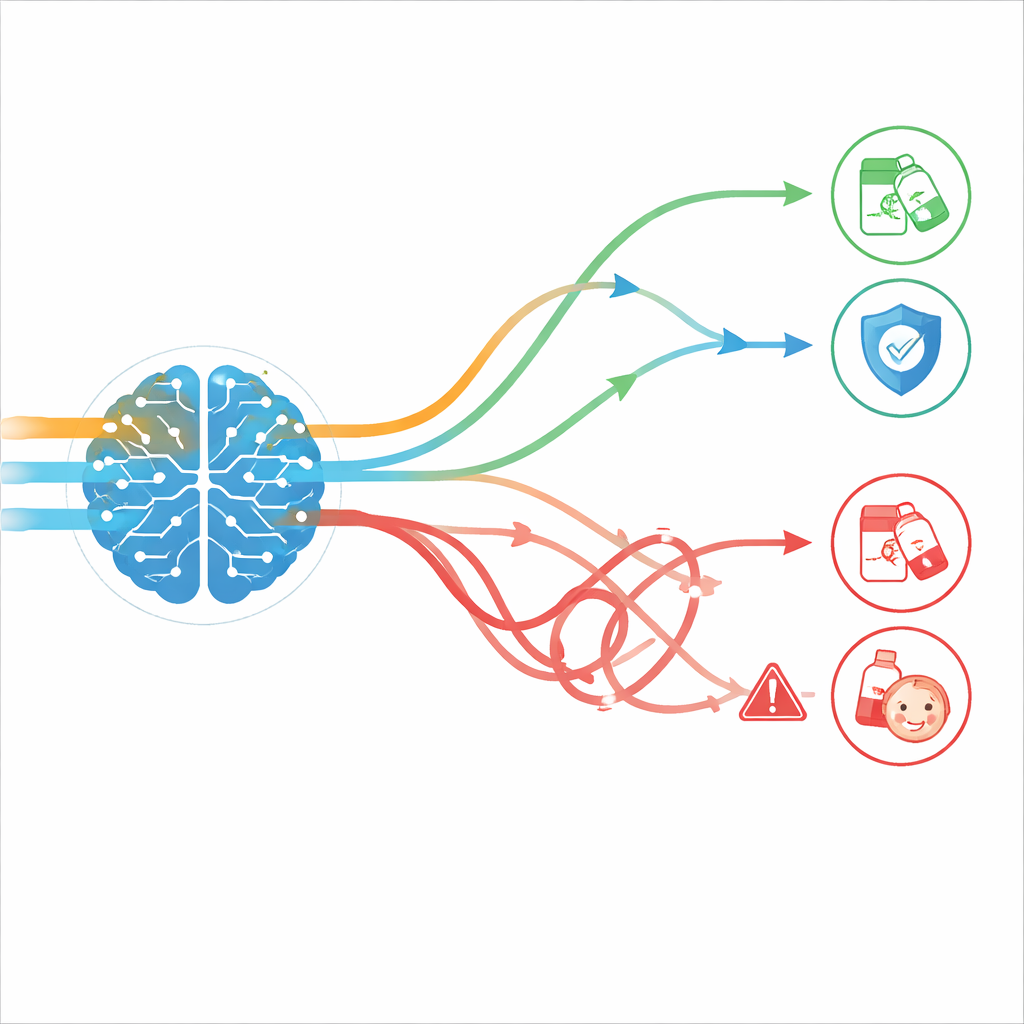

Entre 103 sessões utilizáveis, pouco mais da metade (aproximadamente 52%) atingiu o padrão dos especialistas nas três dimensões simultaneamente. Os pontos fortes foram a estrutura da aula e o raciocínio modelado: mais de 80% das sessões ofereceram objetivos claros, apoio didático útil e processos de pensamento clínico plausíveis. Em outras palavras, os LLMs foram bastante eficazes em contar uma história crível e expor decisões de forma semelhante ao raciocínio de um especialista. O ponto fraco foi a precisão e a segurança das recomendações medicamentosas, que passaram no exame em apenas cerca de 58% das vezes. Erros incluíram escolhas desatualizadas ou fora de diretriz, decisões incorretas relacionadas a doses, ensaios clínicos inventados com detalhes verossímeis e “entrelaçamento de domínio”, em que tratamentos destinados a uma leucemia — ou mesmo a outro câncer sanguíneo — eram aplicados a outro. Notavelmente, esse tipo de mistura entre doenças ocorreu apenas nos casos mais complexos de LMA.

Cânceres diferentes, modelos diferentes, resultados diferentes

As simulações de LMC se saíram melhor no geral do que as de LMA, com cerca de três em cada cinco sessões de LMC aprovadas contra apenas duas em cada cinco de LMA. Os autores sugerem que as regras de tratamento mais lineares da LMC podem ser mais fáceis de seguir para os LLMs do que as escolhas ramificadas e multifatoriais da LMA. O desempenho também variou entre plataformas: alguns modelos produziram planos medicamentosos mais seguros, porém com desenho instrucional ligeiramente mais fraco, enquanto outros ofereceram um ensino bem estruturado, porém com mais erros clínicos. Ainda assim, os estudantes tendiam a gostar de todos os modelos de maneira semelhante. Eles relataram satisfação acima de um ponto de referência “neutro”, elogiando especialmente a facilidade de uso e a economia de tempo, e quase metade disse preferir o aprendizado baseado em LLM a casos tradicionais. Crucialmente, a satisfação dos alunos não se correlacionou com a segurança ou precisão julgadas por especialistas — os estudantes ficaram igualmente satisfeitos com sessões falhas e com as de alta qualidade.

Por que a supervisão de especialistas ainda importa

Para educadores e sistemas de saúde, a mensagem é matizada. Os LLMs já parecem capazes de construir simulações envolventes e bem estruturadas que parecem realistas e ajudam os alunos a praticar o raciocínio sobre terapias oncológicas. Mas essas mesmas sessões muitas vezes escondem erros de tratamento sutis ou graves que os aprendizes dificilmente detectarão por conta própria. Os autores defendem que, pelo menos por enquanto, a IA deve ser usada para redigir simulações que sejam então revisadas e editadas cuidadosamente por especialistas clínicos, especialmente em campos complexos e de rápida evolução como a oncologia. Com salvaguardas melhores — como acesso às diretrizes em tempo real, checagens contra evidências fabricadas e proteções mais robustas contra a mistura de doenças relacionadas — os LLMs poderão eventualmente oferecer treinamento seguro e escalável. Até lá, o julgamento humano permanece a rede de segurança crítica entre um caso polido pela IA e os pacientes reais que os estudantes um dia irão tratar.

Citação: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Palavras-chave: educação farmacêutica, grandes modelos de linguagem, farmacoterapia do câncer, simulação médica, segurança em IA