Clear Sky Science · es

Evaluación de grandes modelos de lenguaje para simulaciones de farmacoterapia: un estudio de métodos mixtos

Por qué esto importa para los futuros farmacéuticos

A medida que los potentes chatbots se vuelven más comunes en aulas y clínicas, los educadores se hacen una pregunta urgente: ¿pueden estas herramientas ayudar de forma segura a formar a futuros farmacéuticos que manejarán tratamientos oncológicos de alto riesgo? Este estudio explora cómo se comportan cuatro grandes modelos de lenguaje (LLM) cuando se les pide ejecutar simulaciones realistas de farmacoterapia para dos graves leucemias sanguíneas, ofreciendo una primera comprobación de seguridad sobre una tecnología que pronto podría marcar cómo aprenden los profesionales sanitarios.

Practicar sin poner en riesgo a los pacientes

El aprendizaje basado en simulación permite a los estudiantes de farmacia ensayar decisiones complejas de tratamiento en un entorno seguro antes de emitir una prescripción real. Tradicionalmente, estas simulaciones las diseñan y dirigen profesores expertos, lo que es eficaz pero consume mucho tiempo y es difícil de escalar. Los LLM prometen algo nuevo: casos interactivos generados automáticamente que se adaptan a las respuestas del estudiante y ofrecen retroalimentación instantánea. Los autores se propusieron comprobar si esa promesa se sostiene en un área exigente: la farmacoterapia de la leucemia mieloide aguda (LMA) y la leucemia mieloide crónica (LMC), dos cánceres relacionados pero tratados de forma muy diferente.

Una prueba dura usando dos leucemias gemelas

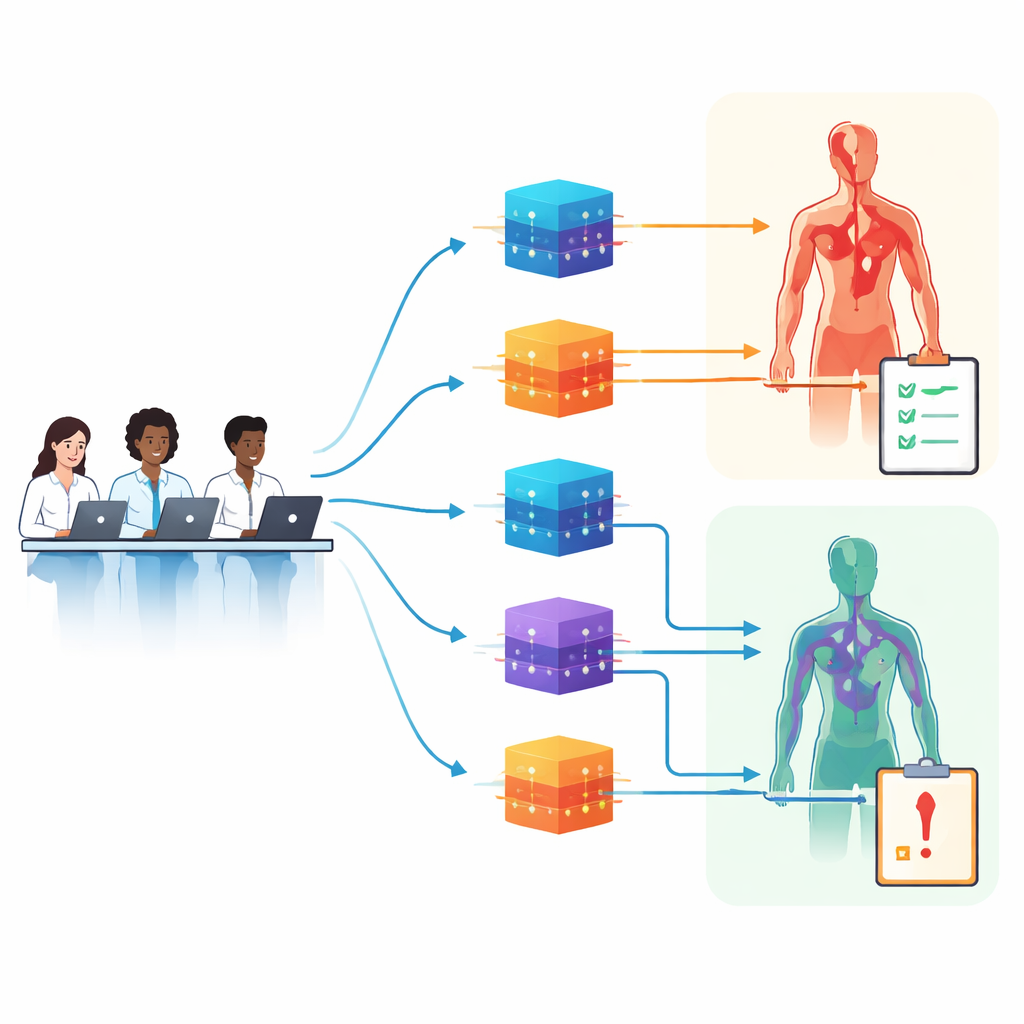

Los investigadores eligieron LMA y LMC porque se parecen en la presentación clínica pero requieren estrategias farmacológicas marcadamente distintas. Esa similitud crea una “prueba de estrés” para los LLM: ¿serán capaces los modelos de distinguir las enfermedades o las mezclarán y sugerirán la terapia equivocada? Con un prompt maestro cuidadosamente diseñado, pidieron a cuatro plataformas importantes que generaran sesiones docentes completas, incluyendo casos clínicos, preguntas y razonamiento paso a paso. Ciento cuatro estudiantes de PharmD interactuaron de forma natural con estas simulaciones creadas por la IA, mientras paneles de expertos en oncología y educación evaluaban cada sesión en tres ejes: cuán realista y acorde a las guías era el contenido clínico, qué tan bien se modeló el razonamiento y qué tan sólido parecía el diseño instruccional.

Dónde los chatbots acertaron —y dónde fallaron

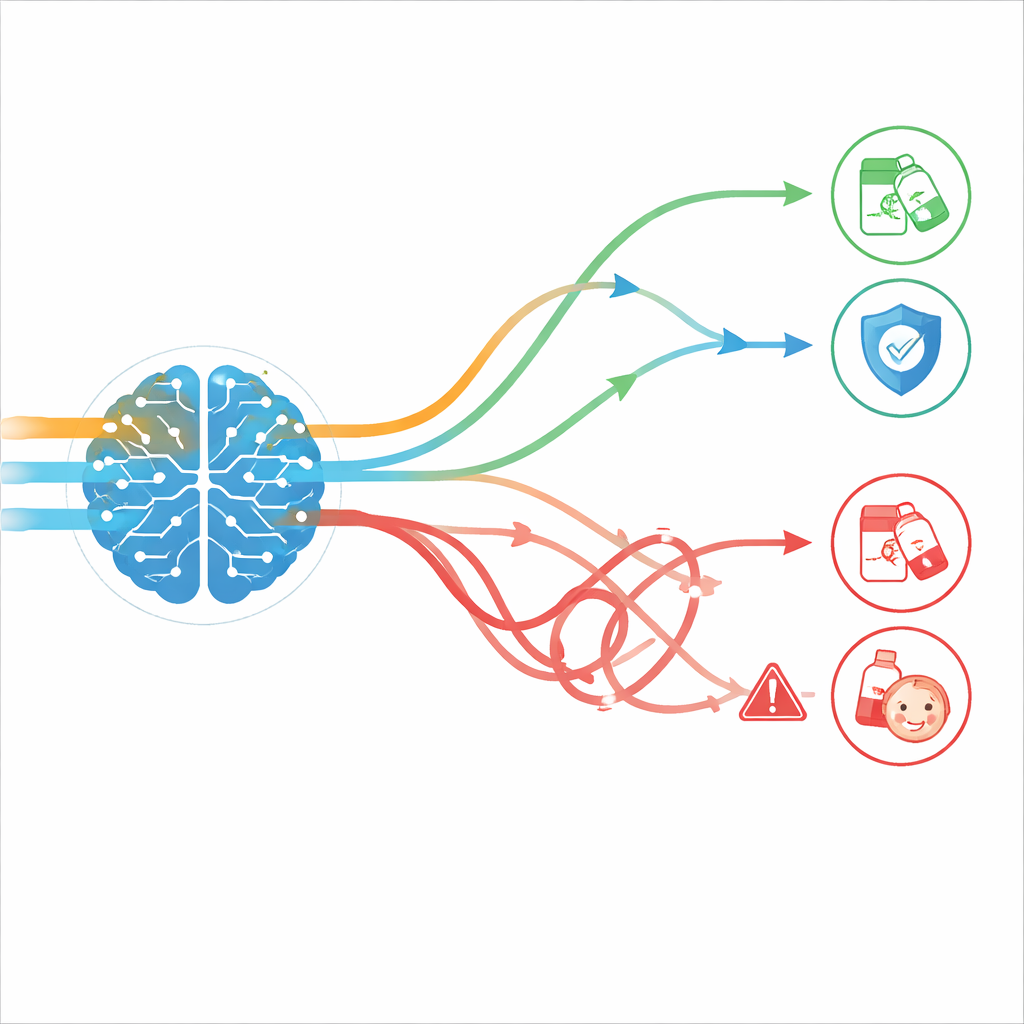

Entre 103 sesiones utilizables, algo más de la mitad (unos 52%) alcanzaron el umbral experto en las tres áreas a la vez. Las áreas más fuertes fueron la estructura de la lección y el razonamiento modelado: más del 80% de las sesiones ofrecieron objetivos claros, andamiaje útil y procesos de pensamiento clínico plausibles. En otras palabras, los LLM fueron bastante buenos contando una historia creíble y desgranando decisiones de manera que parecía razonamiento experto. El punto débil fue la exactitud y seguridad de las recomendaciones farmacológicas, que solo superaron la evaluación en torno al 58% de los casos. Los errores incluyeron opciones desactualizadas o fuera de guías, decisiones incorrectas relacionadas con dosis, ensayos clínicos inventados con detalles de apariencia realista y “entrelazamiento de dominios”, en el que tratamientos destinados a una leucemia —o incluso a otro cáncer sanguíneo distinto— se aplicaban a la equivocada. Cabe destacar que este tipo de mezcla entre enfermedades ocurrió únicamente en los casos más complejos de LMA.

Diferentes cánceres, distintos modelos, distintos resultados

Las simulaciones de LMC rindieron mejor en general que las de LMA, con aproximadamente tres de cada cinco sesiones de LMC aprobadas frente a solo dos de cada cinco en LMA. Los autores sugieren que las reglas de tratamiento más lineales de la LMC pueden ser más fáciles de seguir para los LLM que las opciones ramificadas y multifactoriales de la LMA. El rendimiento también varió entre plataformas: algunos modelos produjeron planes farmacológicos más seguros pero con un diseño de lección ligeramente inferior, mientras que otros ofrecieron una enseñanza bellamente estructurada con errores clínicos más frecuentes. Aun así, a los estudiantes les gustaron todos por igual. Mostraron una satisfacción superior al punto de referencia “neutral”, alabando especialmente la facilidad de uso y el ahorro de tiempo, y casi la mitad dijo preferir el aprendizaje basado en LLM frente a los casos tradicionales. Es crucial señalar que su satisfacción no se correlacionó con la seguridad o exactitud valoradas por expertos: los estudiantes estaban igual de satisfechos con sesiones defectuosas que con las de alta calidad.

Por qué la supervisión experta sigue siendo importante

Para educadores y sistemas de salud, el mensaje es matizado. Los LLM ya parecen capaces de construir simulaciones atractivas y bien estructuradas que resultan realistas y ayudan a los estudiantes a practicar el razonamiento sobre la terapia del cáncer. Pero las mismas sesiones a menudo ocultan errores de tratamiento sutiles o graves que los aprendices difícilmente detectarán por sí solos. Los autores sostienen que, al menos por ahora, la IA debería usarse para redactar simulaciones que luego sean revisadas y editadas cuidadosamente por expertos clínicos, especialmente en campos complejos y de rápida evolución como la oncología. Con mejores salvaguardas —como acceso en tiempo real a guías, comprobaciones contra evidencia fabricada y protecciones más fuertes contra la mezcla de enfermedades relacionadas— los LLM podrían finalmente ofrecer una formación segura y escalable. Hasta entonces, el juicio humano sigue siendo la red de seguridad crítica entre un caso de IA pulido y los pacientes reales que los estudiantes tratarán algún día.

Cita: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Palabras clave: educación farmacéutica, grandes modelos de lenguaje, farmacoterapia del cáncer, simulación médica, seguridad de la IA