Clear Sky Science · ru

Оценка больших языковых моделей для симуляций фармакотерапии: исследование с использованием смешанных методов

Почему это важно для будущих фармацевтов

По мере того как мощные чат‑боты становятся более распространёнными в классах и клиниках, у педагогов появляется важный вопрос: могут ли эти инструменты безопасно помочь в подготовке будущих фармацевтов, которые будут управлять высокорисковыми онкотерапиями? Это исследование анализирует, как четыре большие языковые модели (LLM) справляются с реалистичными симуляциями лекарственной терапии для двух серьёзных онкогематологических заболеваний, выполняя раннюю проверку безопасности технологии, которая вскоре может повлиять на обучение медицинских специалистов.

Практика без риска для пациентов

Обучение на основе симуляций позволяет студентам‑фармацевтам отрабатывать сложные терапевтические решения в безопасной среде прежде, чем им придётся выписывать реальные предписания. Традиционно такие симуляции разрабатывают и проводят эксперты‑преподаватели: это эффективно, но требует много времени и плохо масштабируется. LLM обещают новое: автоматически генерируемые интерактивные кейсы, которые адаптируются к ответам студентов и дают мгновенную обратную связь. Авторы поставили цель проверить, выдерживает ли это обещание в требовательной области — фармакотерапии острого миелоидного лейкоза (ОМЛ) и хронического миелоидного лейкоза (ХМЛ), двух родственных, но лечащихся совсем по‑разному заболеваний.

Жёсткое испытание на примере близких заболеваний крови

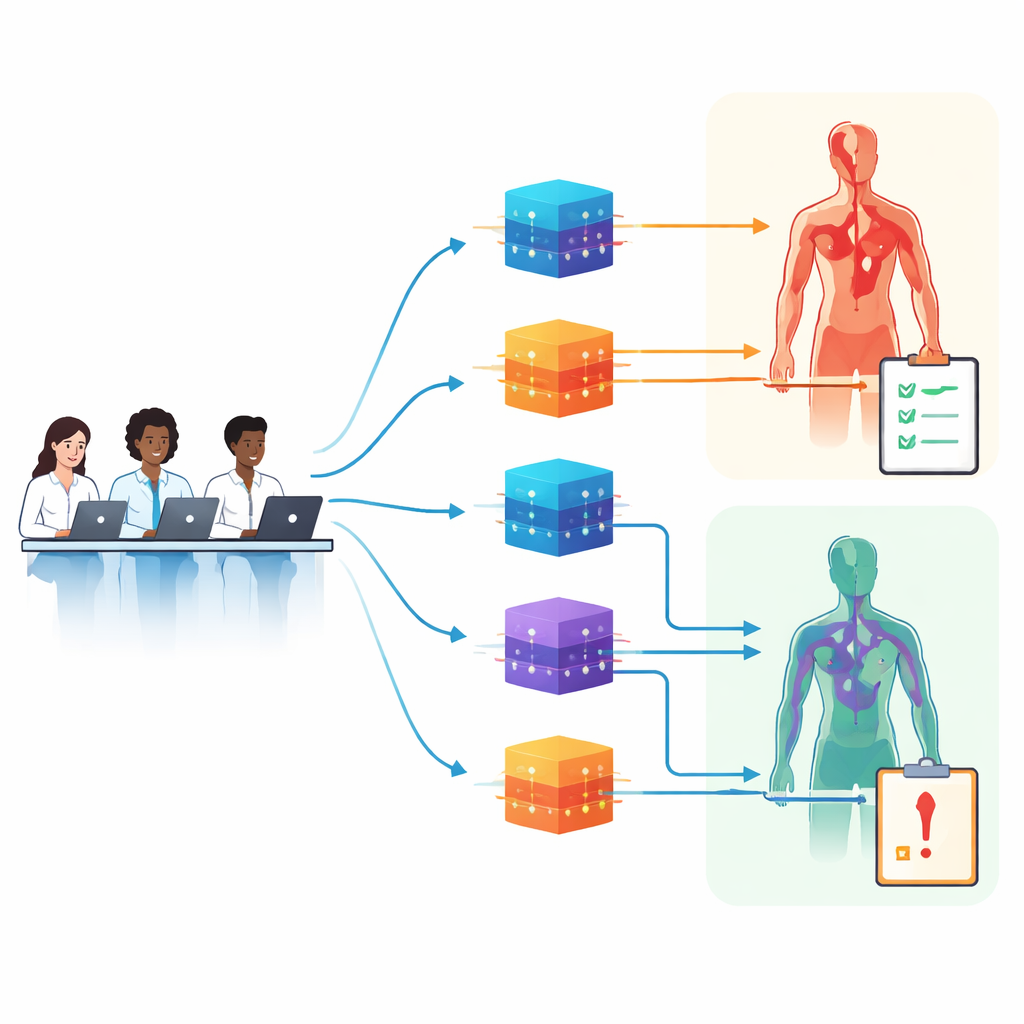

Исследователи выбрали ОМЛ и ХМЛ потому, что на бумаге они похожи, но требуют совершенно разных терапевтических подходов. Эта схожесть создаёт «стресс‑тест» для LLM: смогут ли модели различать болезни или они смешают их и предложат неверную терапию? С помощью тщательно разработанного мастер‑промпта они попросили четыре крупные платформы сгенерировать полноценные учебные сессии, включая клинические кейсы, вопросы и пошаговое обоснование. 104 студента программы PharmD взаимодействовали с этими AI‑созданными симуляциями, а панели экспертов по онкологии и методике обучения оценивали каждую сессию по трём параметрам: реалистичность и соответствие руководствам клинического содержания, качество моделируемого клинического мышления и надёжность дизайна обучения.

Где чат‑боты преуспели — и где они провалились

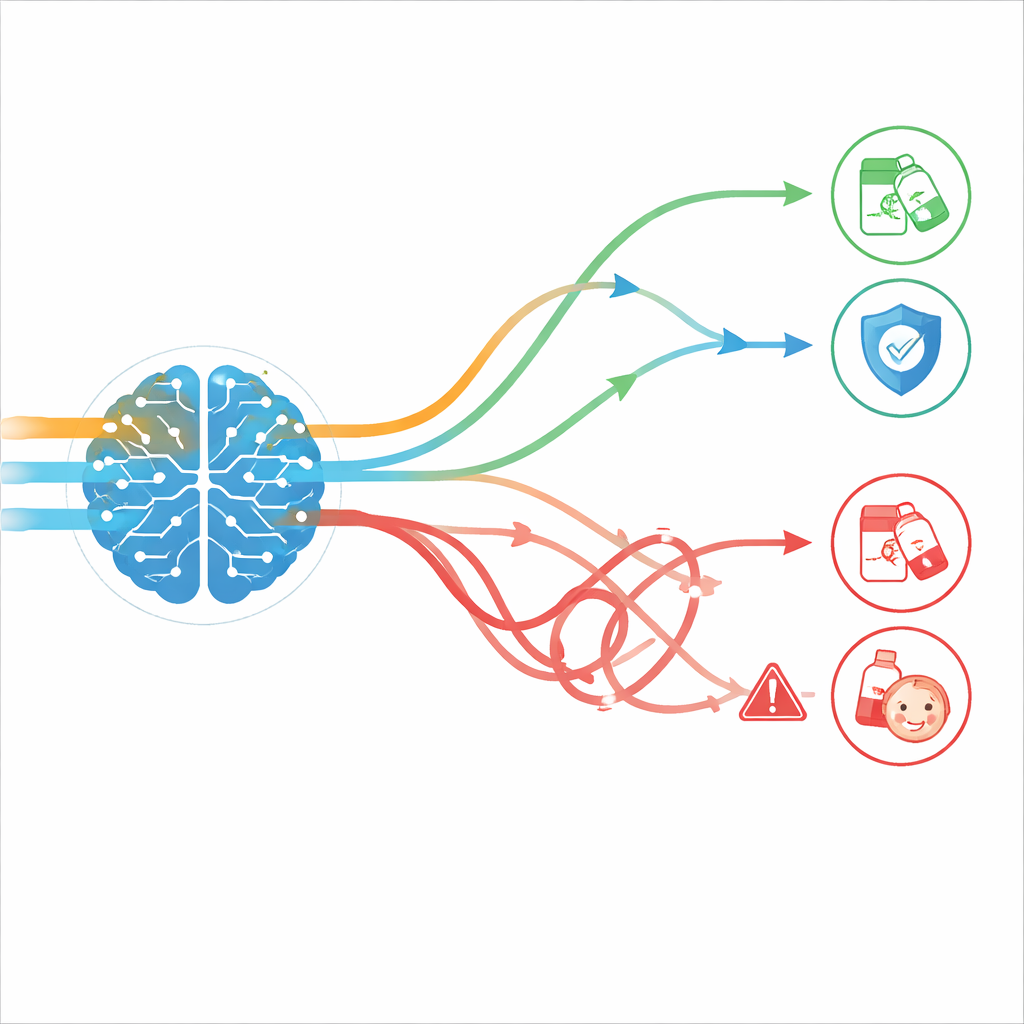

Из 103 пригодных для анализа сессий чуть более половины (примерно 52%) соответствовали экспертным критериям по всем трём областям одновременно. Сильные стороны были в структуре урока и моделировании рассуждений: более 80% сессий предлагали чёткие цели, полезную систему поддержки (scaffolding) и правдоподобные клинические рассуждения. Иными словами, LLM хорошо умели выстраивать убедительный сценарий и шаг за шагом демонстрировать ход принятия решений, похожий на экспертный. Слабым местом оказалась точность и безопасность фактических рекомендаций по лекарствам: они соответствовали требованиям лишь около 58% случаев. Ошибки включали устаревшие или не соответствующие руководствам варианты, неверные решения по дозировке, вымышленные клинические исследования с реалистично звучащими деталями и «переплетение доменов» (domain entanglement), когда терапии, предназначенные для одного типа лейкемии — или даже для другой онкогематологической болезни — применялись к неверной болезни. Примечательно, что такого рода смешение заболеваний происходило только в более сложных случаях ОМЛ.

Разные раки, разные модели, разные результаты

Симуляции ХМЛ в целом показали себя лучше, чем симуляции ОМЛ: примерно три из пяти сессий по ХМЛ прошли проверку, тогда как по ОМЛ — только две из пяти. Авторы предполагают, что более линейные правила лечения ХМЛ легче даются LLM, чем ветвящиеся, мультифакторные решения при ОМЛ. Производительность также варьировала между платформами: некоторые модели выдавали более безопасные планы терапии, но слабее справлялись с дизайном урока, в то время как другие предлагали прекрасно структурированные занятия с более частыми клиническими ошибками. Тем не менее студенты в целом относились к ним примерно одинаково. Они сообщали о более высокой удовлетворённости по сравнению с «нейтральным» эталоном, особенно отмечая простоту использования и экономию времени, и почти половина заявила, что предпочла бы обучение на базе LLM традиционным кейсам. Важно, что удовлетворённость студентов не коррелировала с оценками экспертов по безопасности и точности — студенты были одинаково довольны как сессиями с ошибками, так и с высококачественными.

Почему экспертный надзор по‑прежнему важен

Для преподавателей и медицинских организаций вывод нюансирован. LLM уже способны создавать увлекательные, хорошо структурированные симуляции, которые выглядят реалистично и помогают студентам отрабатывать клиническое мышление при онкотерапии. Но те же сессии часто скрывают тонкие или серьёзные ошибки в лечении, которые обучающиеся вряд ли заметят самостоятельно. Авторы утверждают, что, по крайней мере пока, ИИ следует использовать для составления черновых симуляций, которые затем тщательно просматриваются и редактируются клиническими экспертами, особенно в таких сложных и быстро меняющихся областях, как онкология. С лучшими предохранителями — например, доступом к актуальным руководствам в реальном времени, проверками на вымышленные доказательства и более надёжными защитами от смешения родственных заболеваний — LLM могут в перспективе обеспечить безопасное и масштабируемое обучение. До тех пор человеческое суждение остаётся ключевой спасательной сетью между отшлифованным AI‑кейсом и реальными пациентами, которых однажды будут лечить студенты.

Цитирование: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Ключевые слова: образование фармацевтов, большие языковые модели, фармакотерапия рака, медицинская симуляция, безопасность ИИ