Clear Sky Science · fr

Évaluation des grands modèles de langage pour des simulations de pharmacothérapie : une étude à méthodes mixtes

Pourquoi cela compte pour les futurs pharmaciens

À mesure que des chatbots puissants se répandent dans les salles de classe et les cliniques, les enseignants se posent une question cruciale : ces outils peuvent‑ils aider en toute sécurité à former les futurs pharmaciens qui géreront des traitements contre le cancer à haut risque ? Cette étude explore les performances de quatre grands modèles de langage (LLM) lorsqu'on leur demande d'exécuter des simulations réalistes de thérapie médicamenteuse pour deux cancers du sang graves, fournissant un premier contrôle de sécurité sur une technologie qui pourrait bientôt influencer la formation des professionnels de santé.

Pratiquer sans mettre les patients en danger

L'apprentissage par simulation permet aux étudiants en pharmacie de répéter des décisions thérapeutiques complexes dans un environnement sûr avant de prescrire pour de vrai. Traditionnellement, ces simulations sont conçues et animées par des enseignants experts, ce qui est efficace mais chronophage et difficile à déployer à grande échelle. Les LLM promettent quelque chose de neuf : des cas interactifs générés automatiquement, capables de s'adapter aux réponses de l'étudiant et d'offrir un retour immédiat. Les auteurs ont voulu vérifier si cette promesse tient dans un domaine exigeant — la pharmacothérapie de la leucémie myéloïde aiguë (LMA) et de la leucémie myéloïde chronique (LMC), deux cancers apparentés mais traités de façon très différente.

Un test exigeant avec deux cancers du sang « jumeaux »

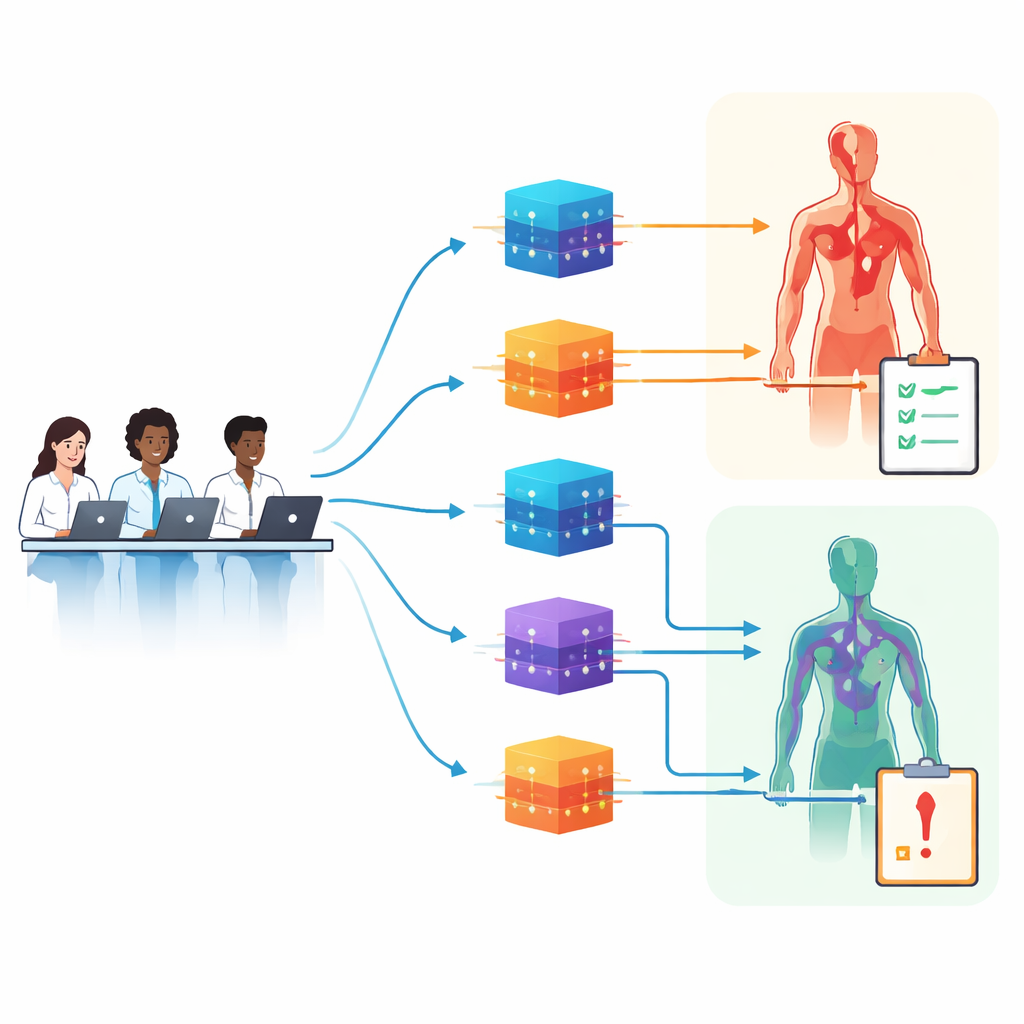

Les chercheurs ont choisi la LMA et la LMC parce qu'elles se ressemblent sur le plan clinique mais requièrent des stratégies médicamenteuses nettement distinctes. Cette similitude constitue un « test de résistance » pour les LLM : les modèles vont‑ils distinguer correctement les maladies, ou vont‑ils les confondre et proposer un traitement inadapté ? À l'aide d'un prompt principal finement conçu, ils ont demandé à quatre grandes plateformes de générer des séances pédagogiques complètes, incluant des dossiers patients, des questions et un raisonnement étape par étape. Cent quatre étudiants en PharmD ont interagi naturellement avec ces simulations construites par l'IA, tandis que des panels d'experts en oncologie et en pédagogie ont évalué chaque séance selon trois critères : réalisme et conformité aux recommandations cliniques, qualité du raisonnement modélisé, et solidité de la conception pédagogique.

Ce que les chatbots ont bien fait — et où ils ont échoué

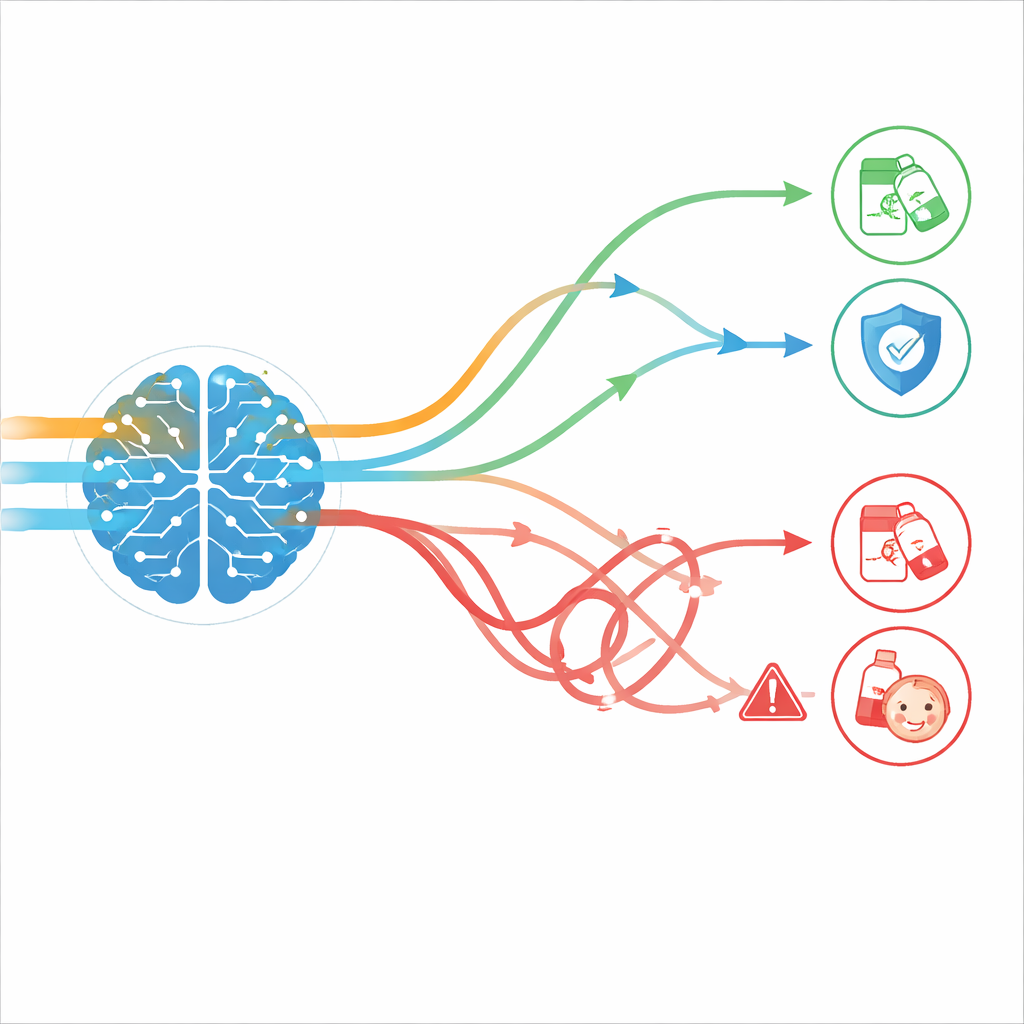

Sur 103 séances exploitables, un peu plus de la moitié (environ 52 %) ont atteint le niveau exigé par les experts sur les trois volets simultanément. Les points forts concernaient la structure des leçons et le raisonnement modélisé : plus de 80 % des séances présentaient des objectifs clairs, un étayage utile et des processus de pensée clinique plausibles. Autrement dit, les LLM étaient très performants pour raconter une histoire crédible et expliciter des décisions de manière semblable au raisonnement d'un expert. Le point faible était l'exactitude et la sécurité des recommandations médicamenteuses, qui n'ont été validées qu'environ 58 % du temps. Les erreurs comprenaient des choix obsolètes ou contraires aux guides, des décisions incorrectes liées aux posologies, des essais cliniques inventés avec des détails plausibles, et un « enchevêtrement de domaines » où des traitements destinés à une leucémie — ou même à un autre cancer du sang — étaient appliqués à une autre. Fait notable, ce type de confusion intermaladie est survenu uniquement dans les cas de LMA, qui sont plus complexes.

Des cancers différents, des modèles différents, des résultats différents

Les simulations de LMC se sont mieux comportées que celles de LMA : environ trois séances de LMC sur cinq ont été validées, contre seulement deux sur cinq pour la LMA. Les auteurs suggèrent que les règles de traitement plus linéaires de la LMC seraient plus faciles à suivre pour les LLM que les choix ramifiés et multifactoriels de la LMA. Les performances variaient également selon les plateformes : certains modèles généraient des plans médicamenteux plus sûrs mais une conception pédagogique légèrement moins aboutie, tandis que d'autres proposaient un enseignement très structuré au prix d'erreurs cliniques plus fréquentes. Pourtant, les étudiants ont eu tendance à les apprécier à peu près de la même manière. Leur satisfaction dépassait la référence « neutre », louant en particulier la facilité d'utilisation et le gain de temps, et près d'un étudiant sur deux a déclaré préférer l'apprentissage basé sur les LLM aux cas traditionnels. Fait important : la satisfaction des étudiants n'était pas corrélée à la sécurité ou à l'exactitude jugées par les experts — les étudiants étaient aussi satisfaits des séances défaillantes que des séances de haute qualité.

Pourquoi la supervision experte reste nécessaire

Pour les enseignants et les systèmes de santé, le message est nuancé. Les LLM semblent déjà capables de construire des simulations engageantes et bien structurées qui paraissent réalistes et aident les étudiants à exercer leur raisonnement sur les thérapies anticancéreuses. Mais ces mêmes séances cachent souvent des erreurs thérapeutiques subtiles ou graves que les apprenants sont peu susceptibles de repérer seuls. Les auteurs soutiennent qu'à ce stade, l'IA devrait servir à rédiger des simulations qui sont ensuite soigneusement relues et corrigées par des experts cliniques, en particulier dans des domaines complexes et en évolution rapide comme l'oncologie. Avec de meilleures garde‑fous — accès en temps réel aux recommandations, contrôles contre la fabrication de preuves, et protections renforcées contre la confusion entre maladies apparentées — les LLM pourraient finalement offrir une formation sûre et évolutive. Jusque‑là, le jugement humain demeure le filet de sécurité essentiel entre un cas IA bien présenté et les patients réels que les étudiants traiteront un jour.

Citation: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Mots-clés: éducation pharmaceutique, grands modèles de langage, pharmacothérapie du cancer, simulation médicale, sécurité de l'IA