Clear Sky Science · sv

Utvärdering av stora språkmodeller för farmakoterapisimuleringar: en studie med blandade metoder

Varför detta är viktigt för framtidens farmaceuter

När kraftfulla chatbotar blir vanligare i klassrum och kliniker ställer utbildare en brännande fråga: kan dessa verktyg säkert hjälpa till att träna framtidens farmaceuter som ska hantera höginsats cancerbehandlingar? Denna studie undersöker hur fyra stora språkmodeller (LLM:er) presterar när de ombeds genomföra realistiska läkemedelsbehandlingssimuleringar för två allvarliga blodcancerformer, och erbjuder en tidig säkerhetskontroll av teknik som snart kan påverka hur vårdpersonal utbildas.

Öva utan att utsätta patienter för risk

Simuleringsbaserat lärande låter farmacistudenter öva komplexa behandlingsbeslut i en säker miljö innan de någonsin skriver ett verkligt recept. Traditionellt utformas och körs dessa simuleringar av sakkunniga lärare, vilket är effektivt men tidskrävande och svårt att skala upp. LLM:er lovar något nytt: automatiskt genererade, interaktiva fall som kan anpassa sig efter studentens svar och ge omedelbar återkoppling. Författarna ville testa om detta löfte håller i ett krävande område—farmakoterapi för akut myeloisk leukemi (AML) och kronisk myeloisk leukemi (CML), två närbesläktade men mycket olika behandlade cancerformer.

Ett tufft test med tvillingblodcancerformer

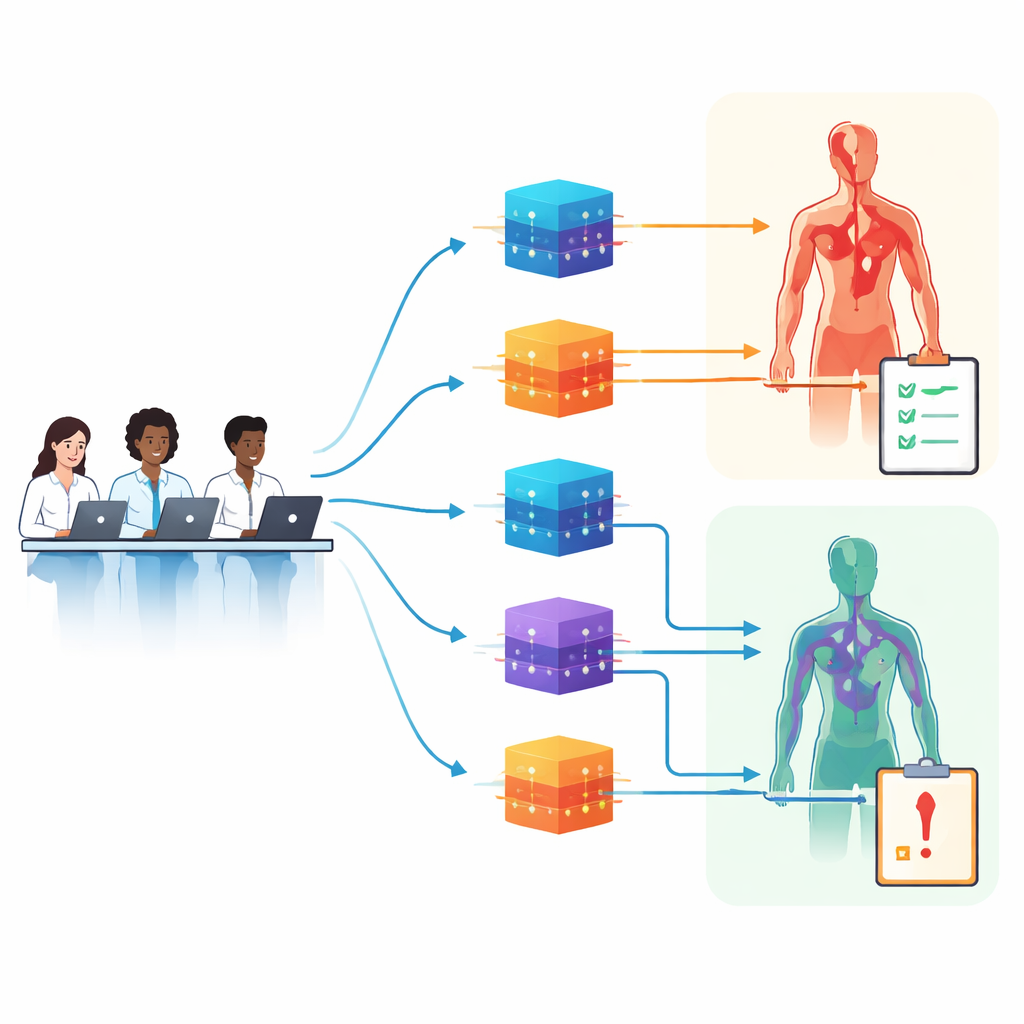

Forskaren valde AML och CML eftersom de kan likna varandra på pappret men kräver skarpt olika läkemedelsstrategier. Den likheten skapar ett “stress-test” för LLM:er: kan modellerna hålla sjukdomarna åtskilda, eller kommer de att blanda ihop dem och föreslå fel behandling? Med en noggrant utformad huvudprompt bad de fyra stora plattformar att generera fullständiga undervisningssessioner, inklusive patientfall, frågor och steg‑för‑steg resonemang. Hundrafyra PharmD‑studenter interagerade naturligt med dessa AI‑byggda simuleringar, medan paneler av onkolog‑ och utbildningsexperter bedömde varje session utifrån tre aspekter: hur realistiskt och riktlinjeanpassat det kliniska innehållet var, hur väl resonemanget modellerades, och hur sund den didaktiska utformningen verkade.

Var chatbotarna gjorde bra ifrån sig — och var de misslyckades

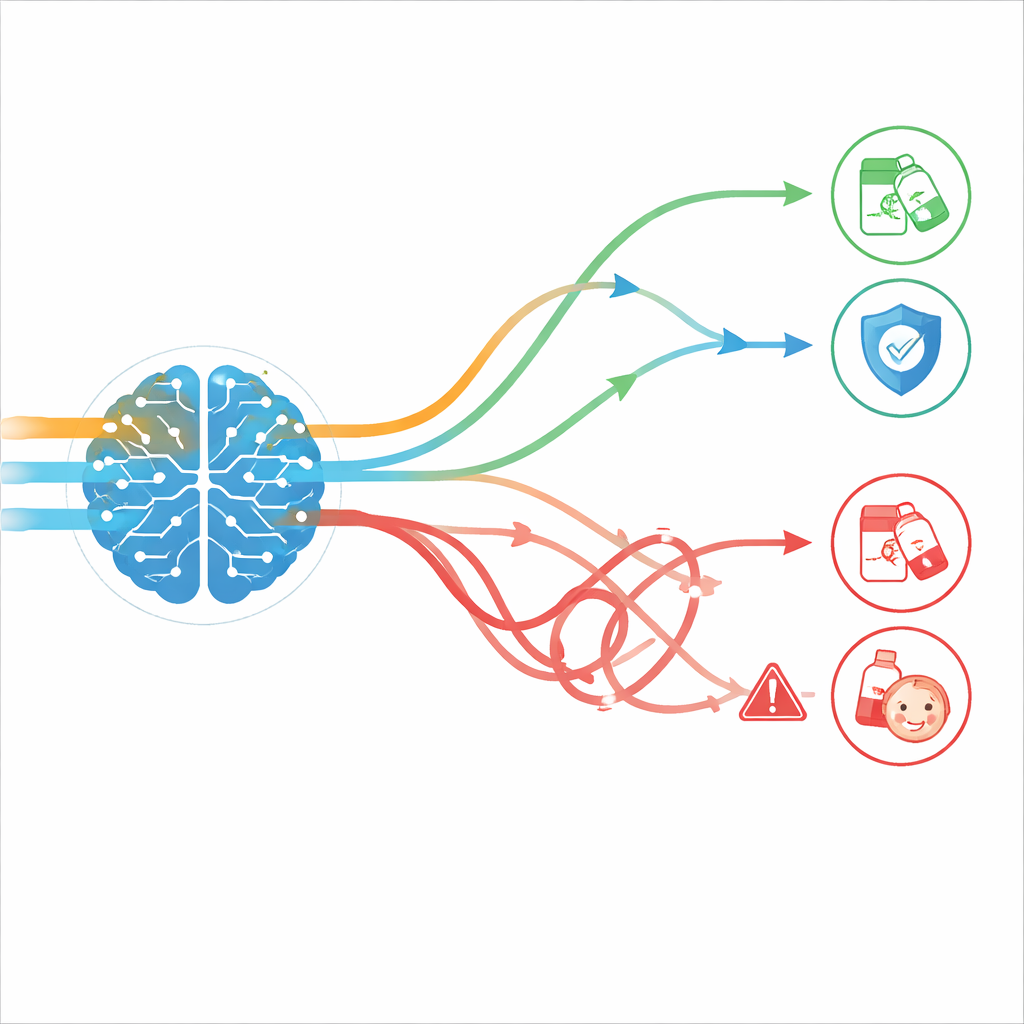

I de 103 användbara sessionerna uppfyllde strax över hälften (ungefär 52 %) expertkraven i alla tre domäner samtidigt. Starkast var områdena lektionsstruktur och modellerat resonemang: mer än 80 % av sessionerna gav tydliga mål, användbara byggstenar och rimliga kliniska tankeprocesser. Med andra ord var LLM:erna ganska bra på att berätta en trovärdig berättelse och gå igenom beslut på ett sätt som liknade expertresonemang. Svagheten var däremot noggrannhet och säkerhet i de faktiska läkemedelsrekommendationerna, som bara klarade sig i ungefär 58 % av fallen. Fel inkluderade föråldrade eller avvikande riktlinjeval, felaktiga dosrelaterade beslut, påhittade kliniska prövningar med trovärdigt klingande detaljer, och ”domänentanglement” där behandlingar avsedda för en leukemi—eller till och med för en annan blodcancer—tillämpades på en annan. Anmärkningsvärt nog uppstod denna form av kors‑sjukdomsblandning endast i de mer komplexa AML‑fallen.

Olika cancerformer, olika modeller, olika resultat

CML‑simulationerna klarade sig överlag bättre än AML‑simulationerna, med ungefär tre av fem CML‑sessioner godkända jämfört med endast två av fem AML‑sessioner. Författarna antyder att CML:s mer linjära behandlingsregler kan vara lättare för LLM:er att följa än AML:s förgrenande, mångfaktorbeslut. Prestanda varierade också mellan plattformarna: vissa modeller producerade säkrare läkemedelsplaner men något svagare lektionsdesign, medan andra erbjöd vackert strukturerad undervisning med fler kliniska misstag. Studenterna tycktes dock uppskatta dem i stort sett lika mycket. De rapporterade högre nöjdhet än en ”neutral” referenspunkt, berömde särskilt användarvänlighet och tidsbesparing, och nästan hälften sade att de föredrog LLM‑baserat lärande framför traditionella fall. Viktigt är att deras tillfredsställelse inte korrelerade med expertbedömd säkerhet eller noggrannhet—studenterna var lika nöjda med bristfälliga sessioner som med högkvalitativa.

Varför expertgranskning fortfarande är avgörande

För utbildare och vårdsystem är budskapet nyanserat. LLM:er verkar redan kunna bygga engagerande, välstrukturerade simuleringar som känns realistiska och hjälper studenter att öva resonemang kring cancerbehandling. Men samma sessioner döljer ofta subtila eller allvarliga behandlingsfel som lärande inte sannolikt upptäcker på egen hand. Författarna hävdar att AI åtminstone för närvarande bör användas för att utarbeta simuleringar som sedan noggrant granskas och redigeras av kliniska experter, särskilt inom komplexa och snabbt föränderliga områden som onkologi. Med bättre skyddsåtgärder—såsom realtidsåtkomst till riktlinjer, kontroller mot fabricerad evidens och starkare skydd mot att blanda närliggande sjukdomar—kan LLM:er så småningom leverera säker, skalbar utbildning. Fram tills dess förblir mänskligt omdöme det kritiska säkerhetsnätet mellan ett polerat AI‑fall och de verkliga patienter som studenter en dag kommer att behandla.

Citering: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Nyckelord: farmaceutisk utbildning, stora språkmodeller, cancerfarmakoterapi, medicinsk simulering, AI-säkerhet