Clear Sky Science · pl

Ocena dużych modeli językowych do symulacji farmakoterapii: badanie metod mieszanych

Dlaczego to ma znaczenie dla przyszłych farmaceutów

W miarę jak potężne chatboty pojawiają się coraz częściej w salach wykładowych i gabinetach klinicznych, edukatorzy zadają ważne pytanie: czy te narzędzia mogą bezpiecznie wspierać szkolenie przyszłych farmaceutów, którzy będą zarządzać terapiami o wysokim ryzyku w onkologii? To badanie analizuje, jak cztery duże modele językowe (LLM) radzą sobie, gdy poproszono je o przeprowadzenie realistycznych symulacji leczenia farmakologicznego dla dwóch poważnych nowotworów krwi, stanowiąc wczesną kontrolę bezpieczeństwa technologii, która wkrótce może kształtować sposób, w jaki uczą się profesjonaliści medyczni.

Ćwiczyć bez narażania pacjentów

Nauka oparta na symulacjach pozwala studentom farmacji ćwiczyć złożone decyzje terapeutyczne w bezpiecznym środowisku, zanim kiedykolwiek wypiszą prawdziwy recept. Tradycyjnie symulacje są projektowane i prowadzone przez ekspertów z kadry, co jest skuteczne, ale czasochłonne i trudno skalowalne. LLM obiecują coś nowego: automatycznie generowane, interaktywne przypadki, które mogą dostosowywać się do odpowiedzi studenta i zapewniać natychmiastową informację zwrotną. Autorzy postanowili sprawdzić, czy ta obietnica sprawdza się w wymagającym obszarze — farmakoterapii ostrej białaczki szpikowej (AML) i przewlekłej białaczki szpikowej (CML), dwóch powiązanych, lecz leczonych zupełnie inaczej nowotworów.

Trudny test na przykładzie bliźniaczych nowotworów krwi

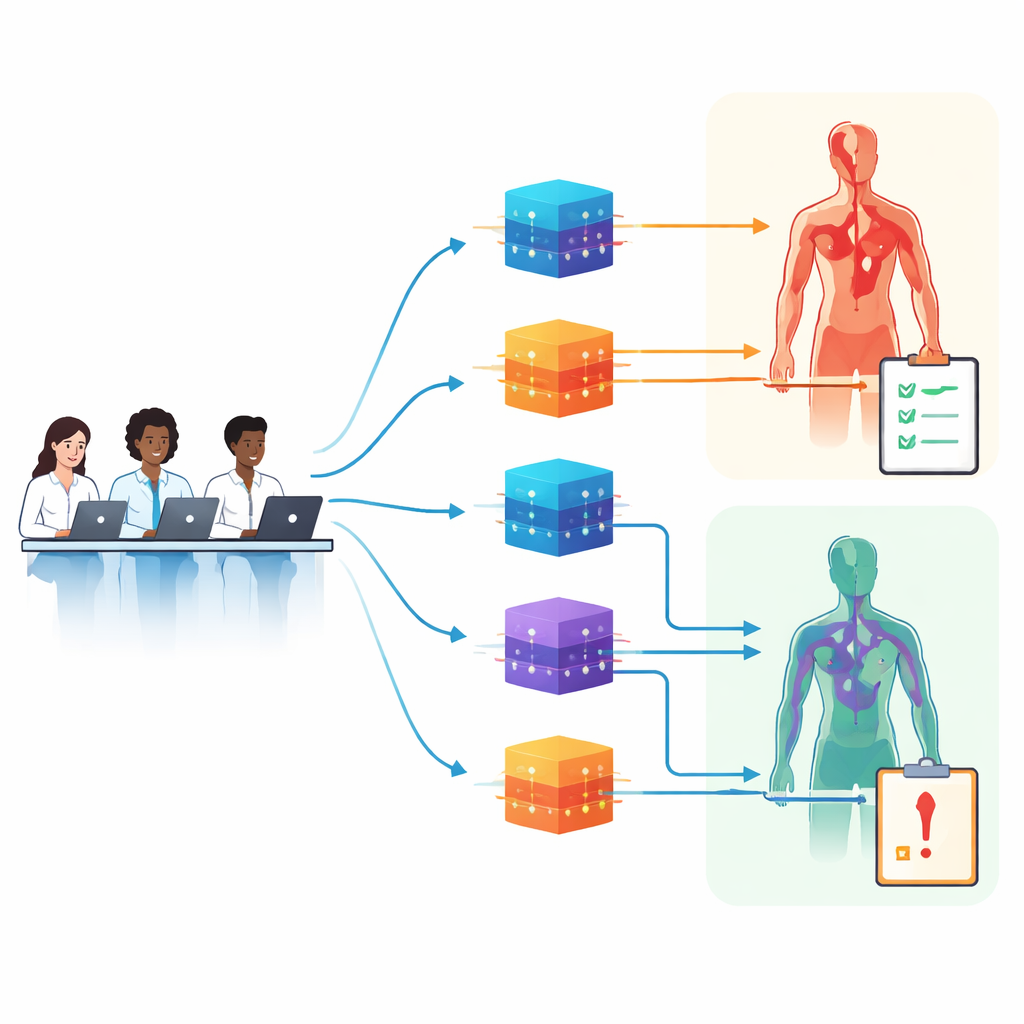

Naukowcy wybrali AML i CML, ponieważ na papierze wyglądają podobnie, ale wymagają zdecydowanie odmiennych strategii leczenia. To podobieństwo tworzy „test obciążeniowy” dla LLM: czy modele potrafią rozróżnić te choroby, czy je zlewają i sugerują niewłaściwą terapię? Przy użyciu starannie opracowanej instrukcji głównej poprosili cztery główne platformy o wygenerowanie pełnych sesji dydaktycznych, w tym przypadków pacjentów, pytań i krok po kroku uzasadnień. Sto cztery osoby studiujące farmację (PharmD) wchodziły w naturalną interakcję z tymi symulacjami tworzonymi przez AI, podczas gdy panele ekspertów z onkologii i dydaktyki oceniały każdą sesję w trzech obszarach: jak realistyczna i zgodna z wytycznymi była treść kliniczna, jak dobrze odwzorowano rozumowanie oraz jak solidny był projekt instruktażowy.

Gdzie chatboty radziły sobie dobrze — i gdzie zawodziły

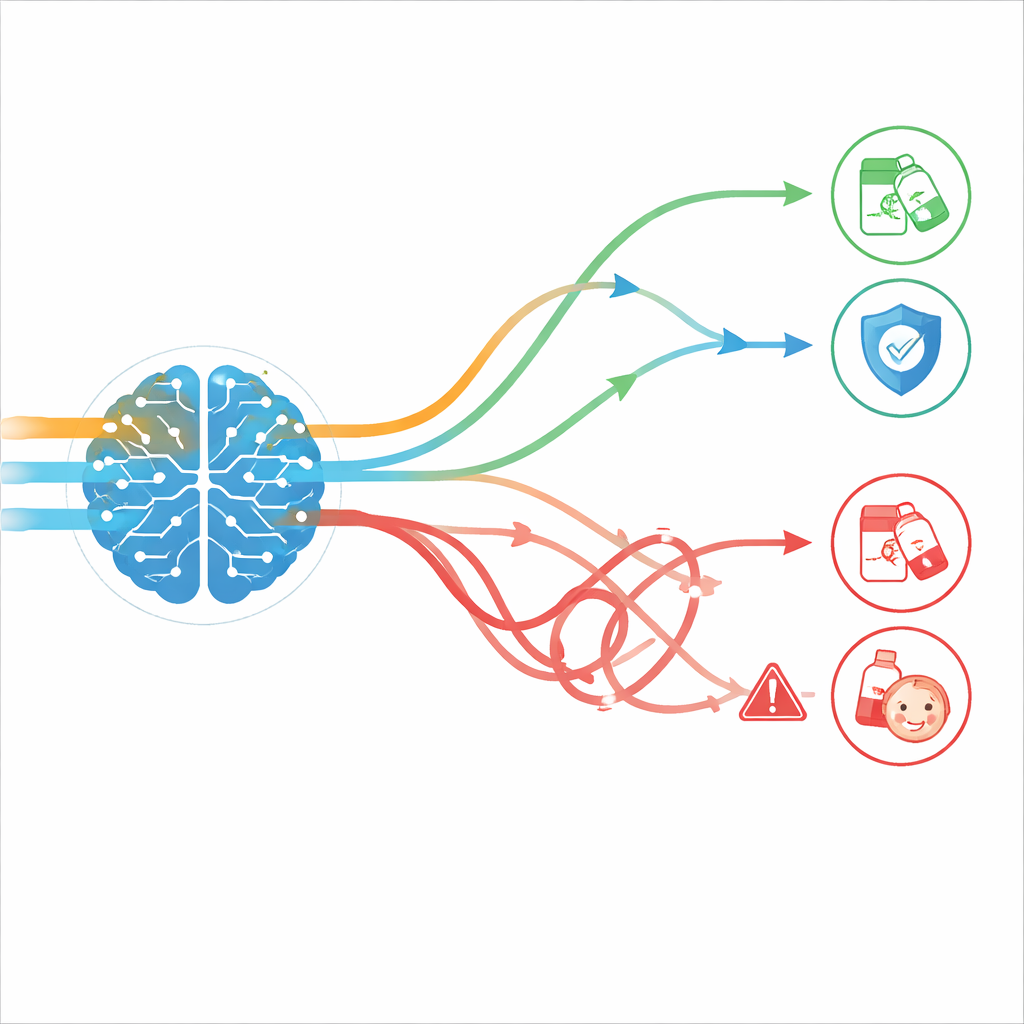

Wśród 103 użytecznych sesji nieco ponad połowa (około 52%) spełniła jednocześnie kryteria ekspertów we wszystkich trzech domenach. Najmocniejsze były struktura lekcji i modelowane rozumowanie: ponad 80% sesji dostarczało jasnych celów, użytecznego stopniowania trudności i wiarygodnych procesów myślowych klinicznego podejmowania decyzji. Innymi słowy, LLM potrafiły stworzyć przekonującą narrację i przeprowadzić przez decyzje w sposób przypominający eksperckie rozumowanie. Słabym punktem była dokładność i bezpieczeństwo rzeczywistych zaleceń lekowych — tutaj wskaźnik pozytywny wyniósł zaledwie około 58%. Błędy obejmowały przestarzałe lub niezgodne z wytycznymi wybory, niewłaściwe decyzje związane z dawkowaniem, wymyślone badania kliniczne z realistycznie brzmiącymi szczegółami oraz „splątanie dziedzinowe”, gdzie terapie przeznaczone dla jednej białaczki — a nawet dla innego nowotworu krwi — były stosowane w niewłaściwym kontekście. Co istotne, tego rodzaju mieszanie między chorobami występowało jedynie w bardziej złożonych przypadkach AML.

Różne nowotwory, różne modele, różne wyniki

Symulacje CML wypadły lepiej niż symulacje AML: około trzy na pięć sesji CML przeszło ocenę, podczas gdy w przypadku AML — tylko dwie na pięć. Autorzy sugerują, że bardziej liniowe zasady leczenia CML mogą być łatwiejsze do odwzorowania przez LLM niż rozgałęzione, wieloczynnikowe wybory w AML. Wyniki różniły się też między platformami: niektóre modele generowały bezpieczniejsze plany lekowe, lecz nieco słabszy projekt lekcji, inne oferowały pięknie zorganizowane nauczanie z częstszymi klinicznymi błędami. Studenci jednak na ogół oceniali wszystkie z nich podobnie. Zgłaszali wyższe zadowolenie niż punkt odniesienia „neutralny”, szczególnie chwaląc łatwość użycia i oszczędność czasu, a niemal połowa stwierdziła, że preferuje naukę opartą na LLM niż tradycyjne przypadki. Co kluczowe, ich satysfakcja nie korelowała z oceną bezpieczeństwa czy dokładności dokonaną przez ekspertów — studenci byli równie zadowoleni z sesji wadliwych, jak i wysokiej jakości.

Dlaczego nadzór ekspertów nadal ma znaczenie

Dla edukatorów i systemów ochrony zdrowia przekaz jest zniuansowany. LLM wydają się już zdolne do tworzenia angażujących, dobrze skonstruowanych symulacji, które sprawiają wrażenie realistycznych i pomagają studentom ćwiczyć rozumowanie w terapii nowotworowej. Jednak te same sesje często ukrywają subtelne lub poważne błędy terapeutyczne, których uczący się prawdopodobnie nie wychwycą samodzielnie. Autorzy argumentują, że przynajmniej na razie AI powinno służyć do szkicowania symulacji, które następnie są starannie przeglądane i redagowane przez ekspertów klinicznych, szczególnie w złożonych, szybko zmieniających się dziedzinach, takich jak onkologia. Przy lepszych zabezpieczeniach — na przykład dostępie do aktualnych wytycznych w czasie rzeczywistym, kontrolach zapobiegających fałszowaniu dowodów oraz silniejszych mechanizmach zapobiegania mieszaniu pokrewnych chorób — LLM mogą w przyszłości zapewnić bezpieczne, skalowalne szkolenia. Do tego czasu ludzki osąd pozostaje krytyczną siatką bezpieczeństwa między dopracowanym przypadkiem AI a prawdziwymi pacjentami, których studenci będą kiedyś leczyć.

Cytowanie: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Słowa kluczowe: kształcenie farmaceutyczne, duże modele językowe, farmakoterapia nowotworów, symulacja medyczna, bezpieczeństwo AI