Clear Sky Science · de

Bewertung großer Sprachmodelle für Pharmakotherapie‑Simulationen: eine Mixed‑Methods‑Studie

Warum das für angehende Apotheker wichtig ist

Da leistungsfähige Chatbots in Klassenzimmern und Kliniken zunehmend verbreitet sind, stellen Lehrende eine drängende Frage: Können diese Werkzeuge künftig sicher dazu beitragen, Pharmaziestudierende auszubilden, die hochriskante Krebstherapien betreuen werden? Diese Studie untersucht, wie vier große Sprachmodelle (LLMs) abschneiden, wenn sie realistische Pharmakotherapie‑Simulationen für zwei schwere Blutkrebsarten durchführen sollen, und liefert damit einen frühen Sicherheitscheck für eine Technologie, die bald die Ausbildung von Gesundheitsfachkräften prägen könnte.

Übung ohne Patientengefährdung

Simulationsbasiertes Lernen ermöglicht es Pharmaziestudierenden, komplexe Therapieentscheidungen in einer sicheren Umgebung zu üben, bevor sie jemals ein reales Rezept ausstellen. Traditionell werden diese Simulationen von fachkundigen Lehrkräften entworfen und durchgeführt, was zwar wirksam, aber zeitaufwendig und schwer skalierbar ist. LLMs versprechen etwas Neues: automatisch generierte, interaktive Fälle, die sich an die Antworten der Lernenden anpassen und sofortiges Feedback liefern. Die Autoren wollten testen, ob dieses Versprechen in einem anspruchsvollen Bereich hält — der Pharmakotherapie bei akutem myeloischer Leukämie (AML) und chronischer myeloischer Leukämie (CML), zwei verwandten, aber sehr unterschiedlich behandelten Krebsarten.

Ein harter Test mit Zwillings‑Blutkrebserkrankungen

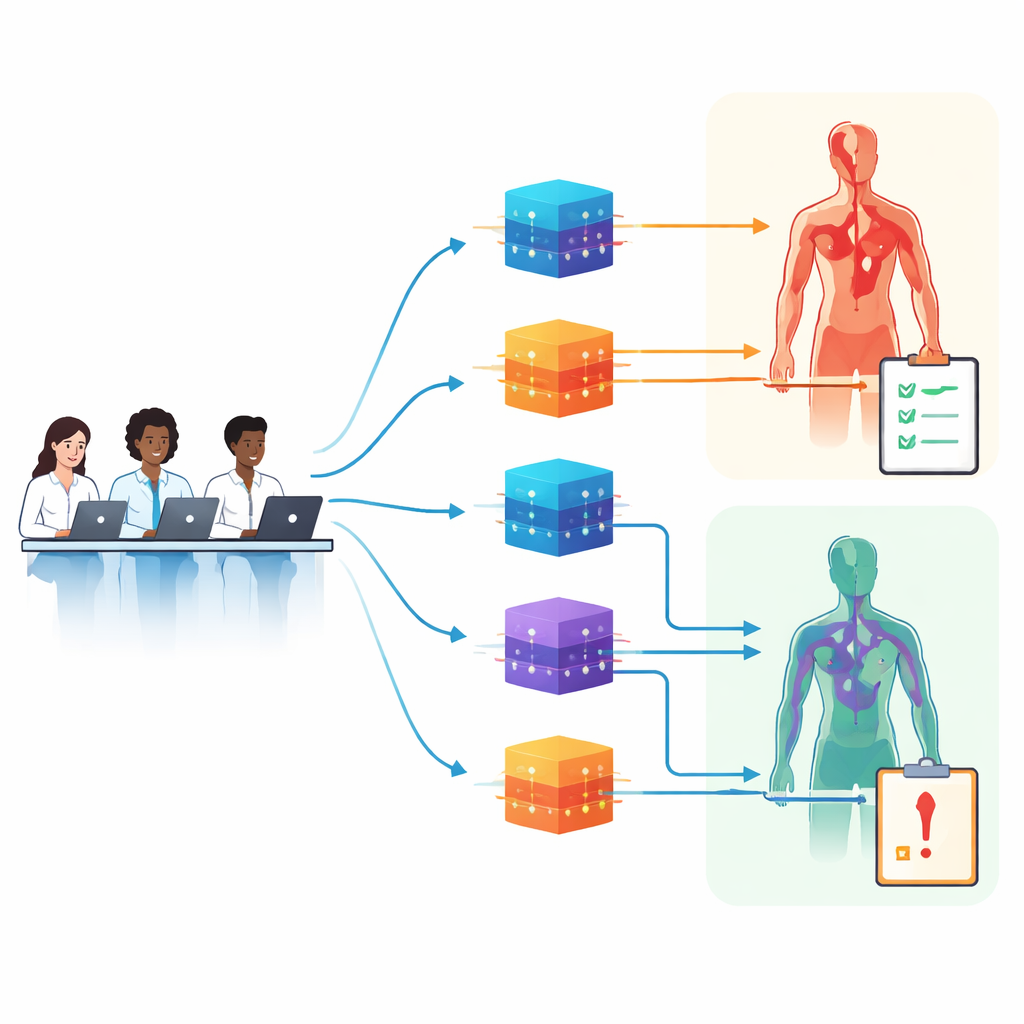

Die Forschenden wählten AML und CML, weil sie auf dem Papier ähnlich erscheinen, aber ganz unterschiedliche medikamentöse Strategien erfordern. Diese Ähnlichkeit wird zu einem „Stresstest“ für LLMs: Können die Modelle die Krankheiten auseinanderhalten, oder vermischen sie sie und schlagen die falsche Therapie vor? Mit einem sorgfältig ausgearbeiteten Master‑Prompt baten sie vier große Plattformen, komplette Unterrichtssitzungen zu erzeugen, inklusive Patientenfällen, Fragen und schrittweiser Begründungen. 104 PharmD‑Studierende interagierten natürlich mit diesen KI‑generierten Simulationen, während Panels aus Onkologie‑ und Bildungsfachleuten jede Sitzung in drei Bereichen bewerteten: wie realistisch und leitlinienkonform der klinische Inhalt war, wie gut das klinische Denken modelliert wurde und wie solide das instruktionsdesign wirkte.

Wo die Chatbots überzeugten — und wo sie versagten

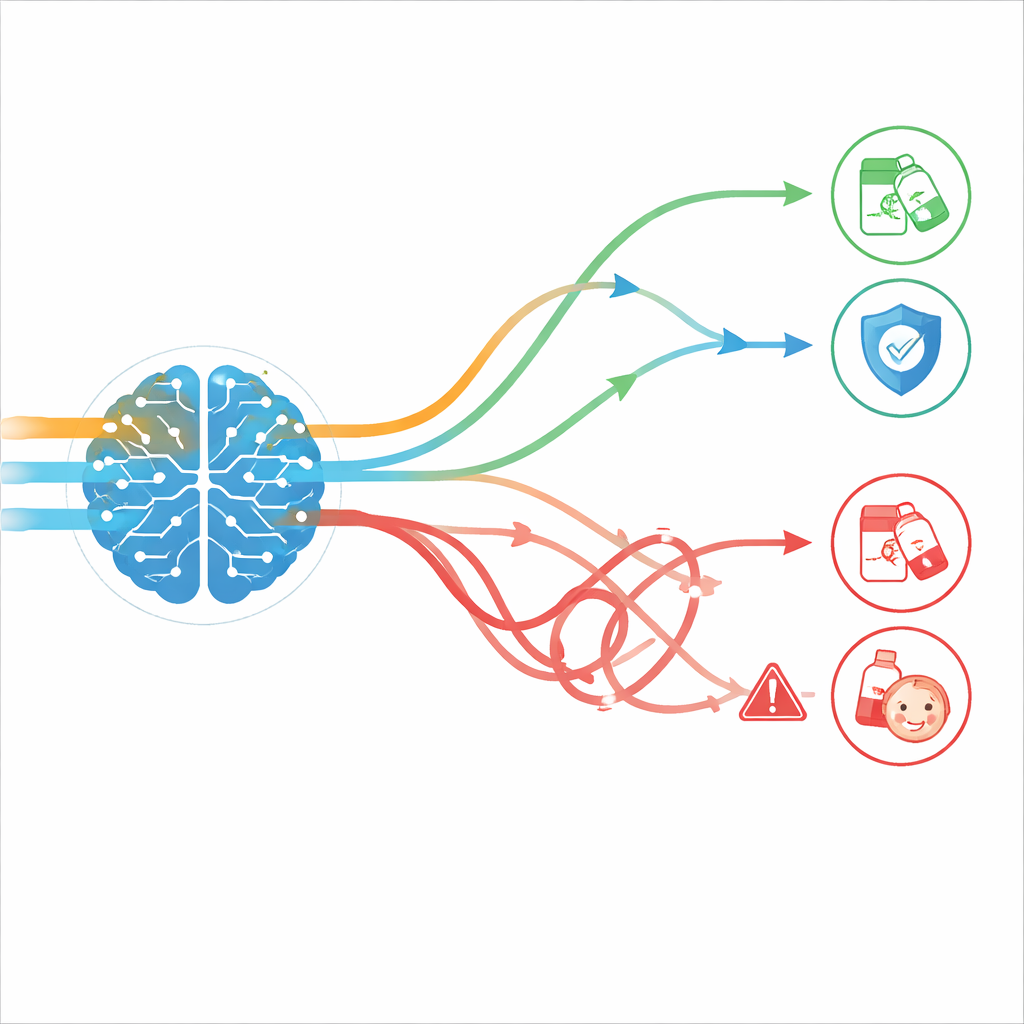

Von 103 verwertbaren Sitzungen erfüllten etwas mehr als die Hälfte (etwa 52 %) in allen drei Bereichen gleichzeitig die Expertenanforderungen. Die stärksten Bereiche waren Aufbau der Lektion und modelliertes klinisches Denken: mehr als 80 % der Sitzungen boten klare Lernziele, nützliche Scaffolds und plausibel dargestellte klinische Überlegungen. Anders gesagt: Die LLMs waren ziemlich gut darin, eine glaubwürdige Geschichte zu erzählen und Entscheidungen so zu durchlaufen, dass es wie Expertenlogik wirkte. Schwachpunkt war die Genauigkeit und Sicherheit der tatsächlichen Medikamentenempfehlungen, die nur in etwa 58 % der Fälle bestanden. Fehler umfassten veraltete oder leitlinienwidrige Auswahl, fehlerhafte dosisbezogene Entscheidungen, erfundene klinische Studien mit realistisch klingenden Details und „Domänenvermischung“, bei der Behandlungen, die für eine Leukämie gedacht sind — oder sogar für eine andere Blutkrebserkrankung — auf eine andere angewandt wurden. Auffällig trat diese Form der Krankheitsvermischung nur in den komplexeren AML‑Fällen auf.

Unterschiedliche Krebsarten, unterschiedliche Modelle, unterschiedliche Ergebnisse

CML‑Simulationen schnitten insgesamt besser ab als AML‑Simulationen: ungefähr drei von fünf CML‑Sitzungen bestanden im Vergleich zu nur zwei von fünf AML‑Sitzungen. Die Autoren vermuten, dass die eher linearen Behandlungsregeln bei CML für LLMs leichter zu befolgen sind als die verzweigten, multifaktoriellen Entscheidungen bei AML. Die Leistung variierte auch zwischen den Plattformen: Einige Modelle lieferten sicherere Therapiepläne, aber etwas schwächeres Lehrdesign, während andere sehr gut strukturierte Unterrichtseinheiten mit häufiger auftretenden klinischen Fehlern kombinierten. Studierende mochten die Systeme jedoch weitgehend gleich. Sie berichteten über eine höhere Zufriedenheit als die „neutrale“ Vergleichsgröße, lobten besonders die einfache Bedienung und Zeitersparnis, und fast die Hälfte gab an, LLM‑gestütztes Lernen traditionellen Fällen vorzuziehen. Entscheidend ist: Ihre Zufriedenheit korrelierte nicht mit der von Experten bewerteten Sicherheit oder Genauigkeit — Studierende waren mit fehlerhaften Sitzungen genauso zufrieden wie mit hochwertigen.

Warum Expert:innenaufsicht weiterhin wichtig ist

Für Lehrende und Gesundheitssysteme ist die Botschaft differenziert. LLMs scheinen bereits in der Lage zu sein, ansprechende, gut strukturierte Simulationen zu erstellen, die realistisch wirken und Studierenden helfen, klinisches Denken bei Krebstherapien zu üben. Dieselben Sitzungen verbergen jedoch oft subtile oder schwerwiegende Behandlungsfehler, die Lernenden allein kaum auffallen dürften. Die Autoren argumentieren, dass KI vorerst am besten zur Erstellung von Entwürfen eingesetzt wird, die dann von klinischen Expert:innen sorgfältig überprüft und bearbeitet werden sollten — insbesondere in komplexen, sich schnell wandelnden Bereichen wie der Onkologie. Mit besseren Schutzmaßnahmen — etwa Echtzeitzugriff auf Leitlinien, Prüfungen gegen erfundene Evidenz und stärkeren Vorkehrungen gegen das Vermischen verwandter Erkrankungen — könnten LLMs langfristig sichere, skalierbare Trainings liefern. Bis dahin bleibt menschliches Urteilsvermögen das entscheidende Sicherheitsnetz zwischen einem polierten KI‑Fall und den echten Patient:innen, die Studierende eines Tages behandeln werden.

Zitation: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Schlüsselwörter: Apothekenausbildung, große Sprachmodelle, Krebspharmakotherapie, medizinische Simulation, KI‑Sicherheit