Clear Sky Science · it

Valutazione dei grandi modelli linguistici per simulazioni di farmacoterapia: uno studio a metodi misti

Perché questo è importante per i farmacisti del futuro

Con l’aumento dell’uso di potenti chatbot in aule e ambulatori, gli educatori si pongono una domanda pressante: questi strumenti possono aiutare in sicurezza a formare i futuri farmacisti che gestiranno terapie oncologiche ad alto rischio? Questo studio esplora come quattro grandi modelli linguistici (LLM) si comportano quando vengono incaricati di eseguire simulazioni realistiche di terapie farmacologiche per due gravi tumori del sangue, offrendo un primo controllo di sicurezza su una tecnologia che potrebbe presto influenzare il modo in cui i professionisti della salute apprendono.

Fare pratica senza mettere i pazienti a rischio

L’apprendimento basato sulla simulazione consente agli studenti di farmacia di esercitarsi in decisioni terapeutiche complesse in un ambiente sicuro prima di prescrivere nella pratica reale. Tradizionalmente queste simulazioni sono progettate e condotte da docenti esperti, una soluzione efficace ma dispendiosa in termini di tempo e difficile da scalare. Gli LLM promettono qualcosa di nuovo: casi interattivi generati automaticamente che si adattano alle risposte dello studente e forniscono un feedback immediato. Gli autori hanno voluto verificare se questa promessa regge in un ambito esigente — la farmacoterapia per la leucemia mieloide acuta (LMA) e la leucemia mieloide cronica (LMC), due neoplasie ematologiche correlate ma trattate in modo molto diverso.

Una prova severa usando due tumori del sangue gemelli

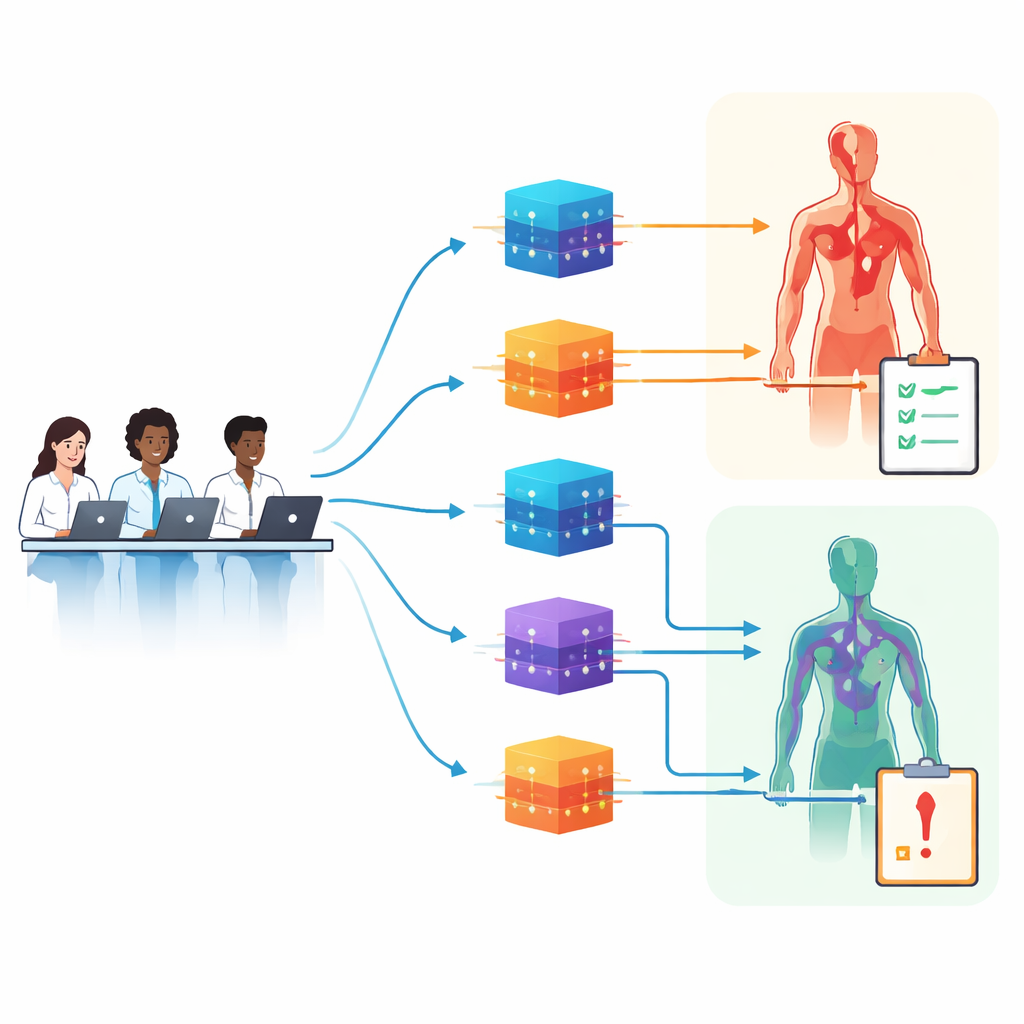

I ricercatori hanno scelto LMA e LMC perché, pur apparendo simili sulla carta, richiedono strategie farmacologiche nettamente diverse. Questa somiglianza crea un “test di stress” per gli LLM: i modelli riescono a distinguere le malattie o le confondono suggerendo terapie sbagliate? Usando un prompt maestro accuratamente progettato, hanno chiesto a quattro piattaforme principali di generare sessioni didattiche complete, con casi clinici, domande e ragionamento passo dopo passo. Centoquattro studenti di PharmD hanno interagito in modo naturale con queste simulazioni create dall’IA, mentre commissioni di esperti in oncologia e didattica hanno valutato ogni sessione su tre fronti: quanto il contenuto clinico fosse realistico e conforme alle linee guida, quanto fosse ben modellato il ragionamento clinico e quanto solida sembrasse la progettazione istruzionale.

Dove i chatbot hanno fatto bene — e dove hanno fallito

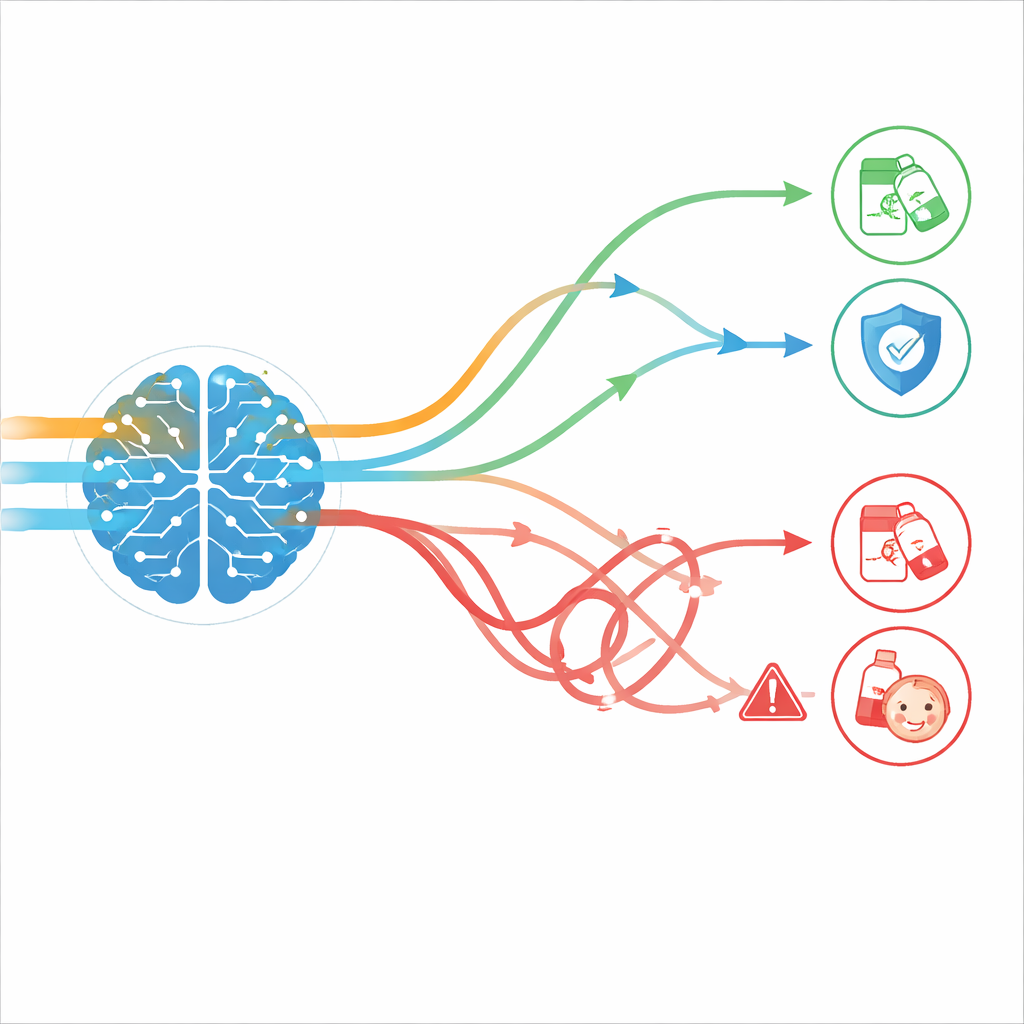

Su 103 sessioni utilizzabili, poco più della metà (circa il 52%) ha soddisfatto il giudizio degli esperti in tutti e tre i domini contemporaneamente. Gli ambiti più robusti sono stati la struttura della lezione e il ragionamento modellato: oltre l’80% delle sessioni forniva obiettivi chiari, supporti utili e processi di pensiero clinico plausibili. In altre parole, gli LLM erano piuttosto bravi nel raccontare una storia credibile e nel guidare le decisioni in modo simile al ragionamento degli esperti. Il punto debole è stata l’accuratezza e la sicurezza delle raccomandazioni farmacologiche effettive, che sono risultate corrette solo in circa il 58% dei casi. Gli errori includevano scelte obsolete o non conformi alle linee guida, decisioni errate legate al dosaggio, studi clinici inventati con dettagli verosimili e “entanglement di dominio”, dove trattamenti pensati per una leucemia — o addirittura per un diverso tumore del sangue — venivano applicati a un’altra. È importante notare che questo tipo di confusione tra malattie è avvenuto solo nei casi più complessi di LMA.

Diversi tumori, diversi modelli, risultati diversi

Le simulazioni sulla LMC hanno ottenuto risultati complessivamente migliori rispetto a quelle sulla LMA, con circa tre sessioni di LMC su cinque valide rispetto a solo due su cinque per la LMA. Gli autori suggeriscono che le regole terapeutiche più lineari della LMC possano essere più facili da seguire per gli LLM rispetto alle scelte ramificate e multifattoriali della LMA. La performance è variata anche tra le piattaforme: alcuni modelli hanno prodotto piani farmacologici più sicuri ma con una progettazione didattica leggermente più debole, mentre altri hanno offerto una struttura didattica elegante ma con errori clinici più frequenti. Tuttavia, gli studenti tendevano a gradirle tutte in modo simile. Hanno riportato una soddisfazione superiore al riferimento “neutrale”, lodando in particolare la facilità d’uso e il risparmio di tempo, e quasi la metà ha dichiarato di preferire l’apprendimento basato sugli LLM ai casi tradizionali. Fondamentalmente, la loro soddisfazione non si è correlata con la sicurezza o l’accuratezza giudicate dagli esperti — gli studenti erano altrettanto soddisfatti di sessioni con difetti come di quelle di alta qualità.

Perché la supervisione degli esperti è ancora importante

Per educatori e sistemi sanitari il messaggio è sfumato. Gli LLM sembrano già in grado di costruire simulazioni coinvolgenti e ben strutturate che appaiono realistiche e aiutano gli studenti a esercitare il ragionamento sulla terapia oncologica. Ma le stesse sessioni spesso nascondono errori terapeutici sottili o gravi che gli studenti difficilmente riconoscono da soli. Gli autori sostengono che, almeno per ora, l’IA dovrebbe essere utilizzata per redigere simulazioni che vengano poi attentamente riviste e modificate da esperti clinici, specialmente in campi complessi e in rapida evoluzione come l’oncologia. Con migliori salvaguardie — come accesso in tempo reale alle linee guida, controlli contro evidenze inventate e protezioni più forti contro la mescolanza di malattie correlate — gli LLM potrebbero in futuro offrire una formazione sicura e scalabile. Fino ad allora, il giudizio umano rimane la rete di sicurezza critica tra un caso AI ben confezionato e i pazienti reali che gli studenti cureranno un giorno.

Citazione: Farrag, A.N., El-Zeiny, A. & Ali, A.M. Evaluating large language models for pharmacotherapy simulations: a mixed-methods study. npj Digit. Med. 9, 355 (2026). https://doi.org/10.1038/s41746-026-02626-1

Parole chiave: formazione farmaceutica, grandi modelli linguistici, farmacoterapia oncologica, simulazione medica, sicurezza dell'IA