Clear Sky Science · zh

用于公共卫生信息监测的一套大型语言模型

为何在线讨论对公共卫生至关重要

在疫情暴发或健康恐慌期间,许多人首先求助的是社交媒体,而非官方网站或医生。这些帖子揭示了人们的恐惧、误解以及对建议的反应。本文所述的研究介绍了PH-LLM,这是一系列专为读取多语言在线信息流而构建的人工智能模型,帮助卫生官员早期发现问题并在谣言和担忧失控前做出回应。

实时监测健康话题

长期以来,公共卫生机构依赖问卷调查、门诊报告和实验室数据来指导决策。但这些传统工具节奏缓慢,常常漏掉网上迅速变化的舆情,在那里关于疫苗、检测和新疾病的信念数小时内就可传播开来。研究者将跟踪这种数字脉搏的工作称为“信息监测”(infoveillance)——监测信息而非感染。直到目前,大多数此类工作仍依赖为单一任务训练的小型机器学习模型,例如识别英文推文中的疫苗犹豫。当出现新的议题、语言或平台变得重要时,这些系统难以跟上。

为公共卫生问题打造的AI套件

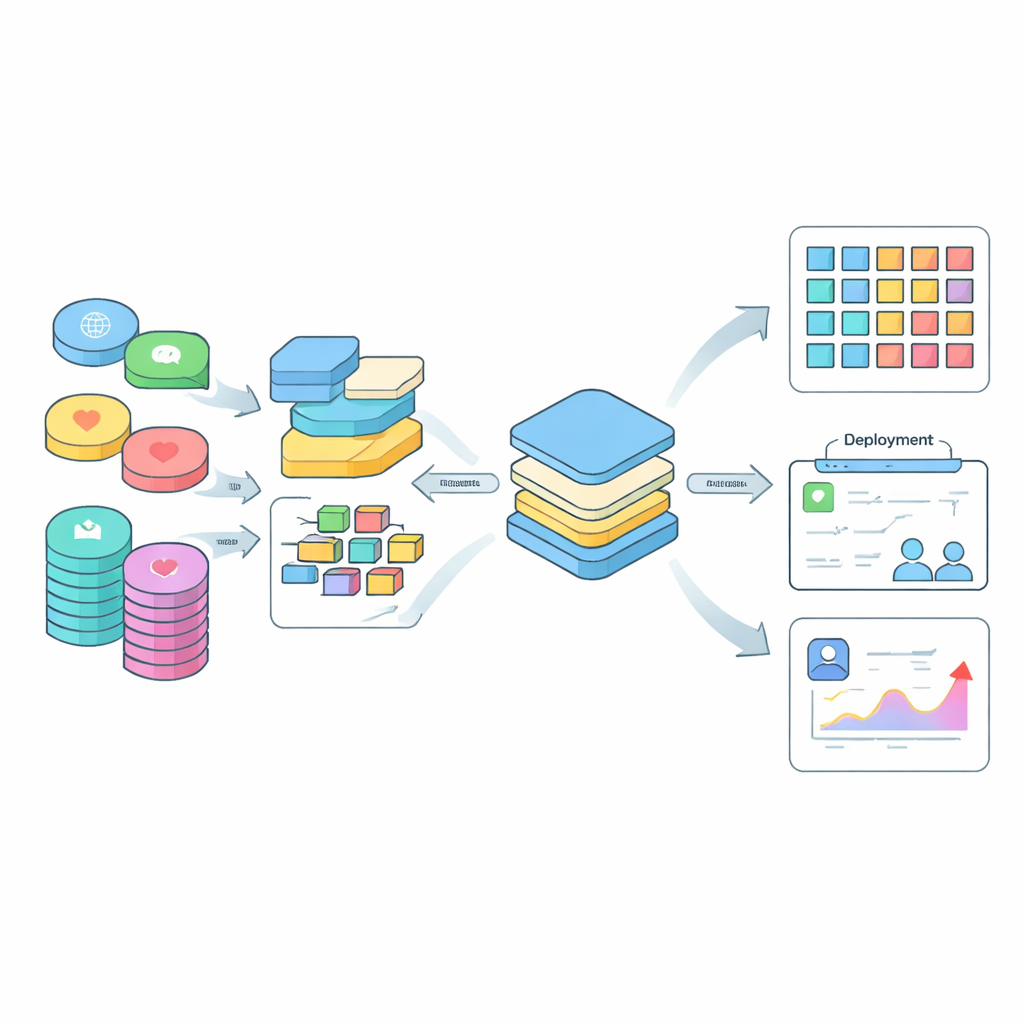

为填补这一空白,作者们创建了PH-LLM——一套专门为公共卫生信息监测调优的大型语言模型。从一个强大的多语种基础模型出发,他们微调了六个版本,从轻量级到更大规模不等,使用近60万条示例,这些示例来自30个社交媒体数据集和若干健康问答资源。示例覆盖广泛主题,包括疫苗态度、检测犹豫、精神健康信号、仇恨言论以及关于COVID-19和其他问题的错误信息。研究者没有把所有帖子都改写成英语,而是保留原始语言,并将指令模板翻译成29种语言,使模型能够自然处理混合语言和非英语内容。

对PH-LLM进行严苛测试

为了检验PH-LLM的实际表现,团队构建了一个苛刻的基准测试,包含来自10个不同数据集的39个未见任务,涉及英语、阿拉伯语、中文和印尼语。这些任务要求模型执行诸如将个人经历与新闻区分、标记仇恨言论、识别关于疗法的虚假断言,以及检测对COVID-19疫苗态度的变化等操作。PH-LLM在“零样本”(zero-shot)设置下回答问题,意味着没有针对任何特定任务进行额外训练。研究者将PH-LLM的准确性与多种知名系统进行比较,包括开源模型如Llama、Mistral、BLOOMZ和Qwen,以及商业模型如GPT-4o和GPT-4o mini。

更小却在多语言上更强

在仅英语和多语种任务上,PH-LLM模型不仅表现稳健,而且经常优于体量相仿甚至大得多的替代模型。14亿和32亿参数版本在整体表现上最为突出,在基准测试中平均成绩超越了更大的开源模型,甚至超过了商业的GPT-4o家族。更重要的是,较强的多语种得分意味着PH-LLM可以跟踪阿拉伯语、中文、印尼语等经常被忽视的语言中的健康相关对话。由于PH-LLM以比许多竞争者更少的参数达到该水平,它可以在更为节俭的计算硬件上运行,降低卫生机构的成本,尤其是在中低收入国家。

将在线信号转化为现实决策

作者设想将PH-LLM作为一款实用工具,通过简便的界面供非技术性的公共卫生工作人员使用。结合时间、地点和当地情况的信息,PH-LLM的分类可以揭示哪里对疫苗的疑虑在上升、哪些社区成为仇恨言论的目标,或何时危险的谣言开始传播。尽管模型仍有局限——例如在极难或类别不平衡的任务上表现不均以及可能继承自社交媒体数据的偏差——它们标志着朝向实时、多语种公共卫生对话监测迈出的重要一步。简单来说,PH-LLM将喧闹的社交媒体流转化为更清晰的信号,帮助当局在日常宣传和未来大流行期间更快、更公平地采取行动。

引用: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

关键词: 公共卫生监测, 社交媒体虚假信息, 疫苗犹豫, 多语种人工智能, 大型语言模型