Clear Sky Science · sv

En svit stora språkmodeller för folkhälso‑infoveillance

Varför samtal på nätet spelar roll för folkhälsan

Vid utbrott och hälsoro vänder sig många först till sociala medier i stället för till myndighetswebbplatser eller läkare. Dessa inlägg avslöjar vad människor fruktar, vad de missförstår och hur de reagerar på råd. Studien som beskrivs här presenterar PH-LLM, en familj av artificiella intelligensmodeller byggda specifikt för att läsa denna ständiga ström av online‑meddelanden på många språk och hjälpa hälsomyndigheter att upptäcka problem tidigt och agera innan rykten och oro spårar ur.

Övervakning av hälsosamtal i realtid

Folkhälsomyndigheter har länge förlitat sig på undersökningar, klinikrapporter och laboratoriedata för att fatta beslut. Men dessa traditionella verktyg är långsamma och missar ofta det snabbt skiftande stämningsläget online, där uppfattningar om vacciner, testning och nya sjukdomar sprids på timmar. Forskare kallar ansträngningar att följa denna digitala puls för «infoveillance»—övervakning av information i stället för infektioner. Hittills har de flesta sådana satsningar förlitat sig på mindre maskininlärningsmodeller tränade för en uppgift i taget, till exempel att upptäcka vaccinskepsis i engelskspråkiga tweets. Dessa system hade svårt att hänga med när en ny fråga, ett nytt språk eller en ny plattform blev viktig.

En AI‑svit byggd för folkhälsorelaterade frågor

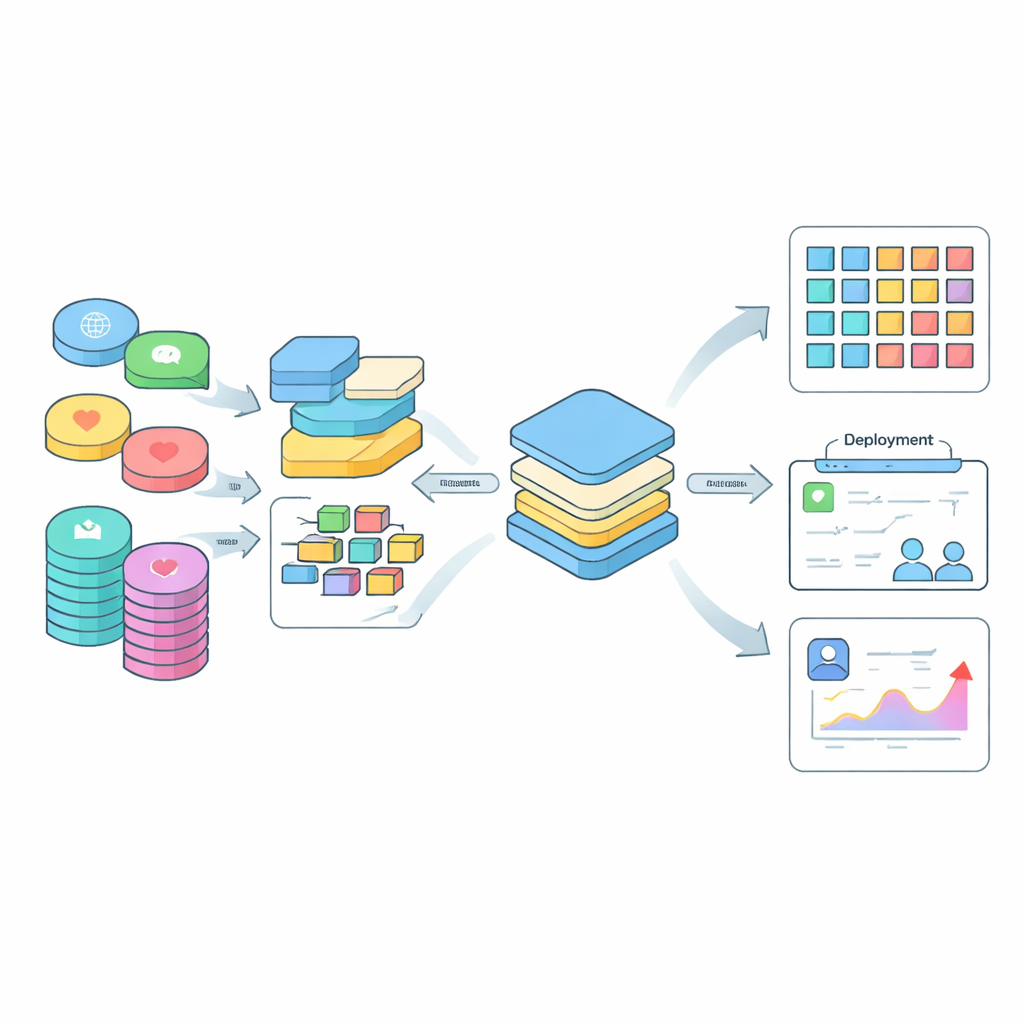

För att tackla denna lucka skapade författarna PH-LLM, en svit stora språkmodeller finjusterade särskilt för folkhälso‑infoveillance. Med utgångspunkt i en kraftfull flerspråkig basmodell finjusterades sex versioner, från lätta till större modeller, på nästan 600 000 exempel hämtade från 30 sociala medier‑dataset och flera resurser för hälsofrågor och svar. Dessa exempel täckte en bred blandning av ämnen, inklusive inställningar till vaccin, motvilja mot testning, signaler om psykisk hälsa, hatretorik och desinformation om COVID‑19 och andra frågor. I stället för att skriva om varje inlägg till engelska behölls originalspråken och kombinerades med instruktionstemplat översatta till 29 språk, så att modellerna naturligt kunde hantera blandade språk och icke‑engelskt innehåll.

Ett krävande test för PH-LLM

För att ta reda på hur väl PH-LLM verkligen fungerade byggde teamet ett krävande riktmärke av 39 osedda uppgifter hämtade från 10 separata dataset på engelska, arabiska, kinesiska och indonesiska. Dessa uppgifter bad modellerna göra saker som att skilja personliga berättelser från nyheter, flagga hatretorik, identifiera falska påståenden om botemedel och upptäcka förändrade attityder till COVID‑19‑vacciner. PH-LLM var tvungen att svara i en «zero‑shot»‑inställning, vilket innebär att den inte fick någon extra träning för någon specifik uppgift. Forskarna jämförde PH-LLM:s noggrannhet med en rad välkända system, inklusive open‑source‑modeller som Llama, Mistral, BLOOMZ och Qwen, samt kommersiella modeller som GPT‑4o och GPT‑4o mini.

Mindre men starkare över språk

Både i rent engelskspråkiga och i flerspråkiga uppgifter höll PH-LLM‑modellerna inte bara jämna steg utan presterade ofta bättre än alternativ av liknande eller till och med mycket större storlek. Versionerna med 14 miljarder och 32 miljarder parametrar gav den bästa samlade prestationen och slog större open‑source‑modeller och i genomsnitt till och med den kommersiella GPT‑4o‑familjen i riktmärket. Viktigt är att de bättre flerspråkiga resultaten innebär att PH-LLM kan följa hälsorelaterade samtal på arabiska, kinesiska, indonesiska och andra språk som ofta förbisetts. Eftersom PH-LLM når denna noggrannhetsnivå med färre parametrar än många konkurrenter kan den köras på mer måttlig hårdvara, vilket sänker kostnaderna för hälsomyndigheter, särskilt i låg‑ och medelinkomstländer.

Från online‑signaler till verkliga beslut

Författarna ser PH-LLM som ett praktiskt verktyg som icke‑teknisk folkhälsopersonal kan använda via enkla gränssnitt. När det kombineras med information om tid, plats och lokala förhållanden kan PH-LLM:s klassificeringar avslöja var vaccintvivlet ökar, vilka samhällen som utsätts för hatretorik eller när farliga rykten börjar spridas. Även om modellerna fortfarande har begränsningar—såsom ojämn prestanda på mycket svåra eller obalanserade uppgifter och möjliga fördomar ärvda från sociala mediedata—markerar de ett betydande steg mot realtids‑, flerspråkig övervakning av folkhälsosamtal. Enkelt uttryckt förvandlar PH-LLM den bullriga strömmen av sociala medier till klarare signaler som kan hjälpa myndigheter att agera snabbare och mer rättvist både i vardagliga kampanjer och vid framtida pandemier.

Citering: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Nyckelord: folkhälsosövervakning, desinformation i sociala medier, vaccinskepsis, flerspråkig AI, stora språkmodeller