Clear Sky Science · nl

Een reeks grote taalmodellen voor infoveillance in de volksgezondheid

Waarom online gesprekken belangrijk zijn voor de volksgezondheid

Tijdens uitbraken en gezondheidsalarms wenden veel mensen zich eerst tot sociale media in plaats van officiële websites of artsen. Deze berichten laten zien waar mensen bang voor zijn, wat ze verkeerd begrijpen en hoe ze reageren op adviezen. De hier beschreven studie introduceert PH-LLM, een familie kunstmatige-intelligentiemodellen die speciaal zijn ontwikkeld om deze constante stroom online berichten in veel talen te lezen, zodat gezondheidsautoriteiten problemen vroegtijdig kunnen zien en kunnen reageren voordat geruchten en zorgen uit de hand lopen.

Het volgen van gezondheidsgesprekken in real time

Instellingen voor volksgezondheid hebben lange tijd vertrouwd op enquêtes, kliniekrapporten en laboratoriumdata om beslissingen te sturen. Maar deze traditionele instrumenten zijn traag en missen vaak de snel veranderende stemming online, waar overtuigingen over vaccins, testen en nieuwe ziekten zich binnen uren verspreiden. Onderzoekers noemen pogingen om deze digitale pols te meten "infoveillance" — het monitoren van informatie in plaats van infecties. Tot nu toe waren de meeste van dergelijke inspanningen afhankelijk van kleinere machine-learningmodellen die voor één taak tegelijk waren getraind, zoals het opsporen van vaccinaarscheidigheid in Engelstalige tweets. Deze systemen hadden moeite om bij te blijven wanneer een nieuw onderwerp, een nieuwe taal of platform belangrijk werd.

Een AI‑suite gebouwd voor vragen van de volksgezondheid

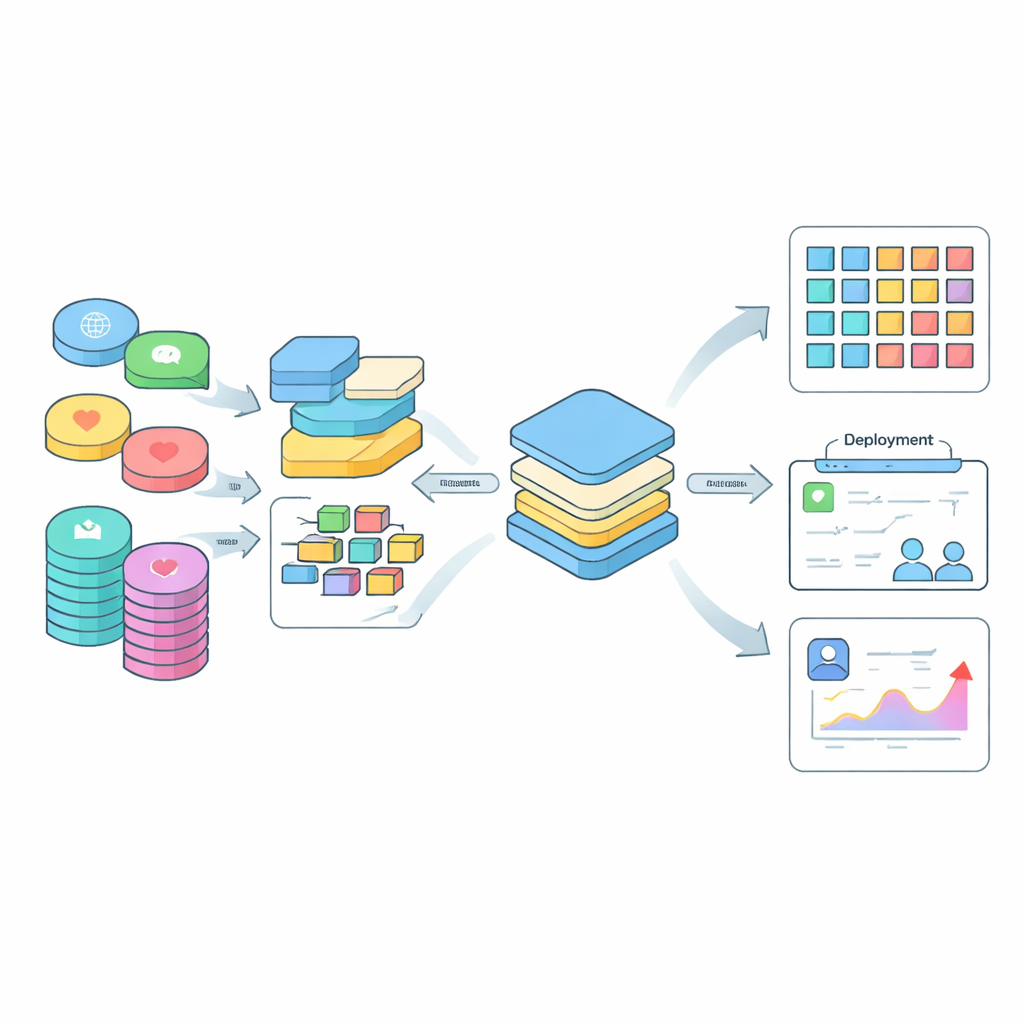

Om deze leemte aan te pakken, creëerden de auteurs PH-LLM, een suite van grote taalmodellen die specifiek zijn afgestemd op infoveillance in de volksgezondheid. Vertrekkend van een krachtig meertalig basismodel, finetuneden ze zes versies, variërend van lichtgewicht tot grotere modellen, op bijna 600.000 voorbeelden afkomstig uit 30 sociale-mediasets en verschillende gezondheidsvraag‑en‑antwoordbronnen. Deze voorbeelden besloegen een breed scala aan onderwerpen, waaronder houdingen tegenover vaccins, terughoudendheid bij testen, signalen rond mentale gezondheid, haatspraak en misinformatie over COVID-19 en andere kwesties. In plaats van elk bericht in het Engels te herschrijven, behielden ze de oorspronkelijke talen en combineerden die met instructiesjablonen vertaald in 29 talen, zodat de modellen op natuurlijke wijze mix‑taal- en niet-Engelstalige inhoud konden verwerken.

PH-LLM aan een zware proef onderwerpen

Om te achterhalen hoe goed PH-LLM daadwerkelijk presteert, bouwde het team een veeleisende benchmark van 39 ongeziene taken, afkomstig uit 10 afzonderlijke datasets in het Engels, Arabisch, Chinees en Indonesisch. Deze taken vroegen de modellen om zaken te doen zoals persoonlijke verhalen scheiden van nieuws, haatspraak signaleren, valse beweringen over remedies identificeren en veranderende gevoelens ten opzichte van COVID-19‑vaccins detecteren. PH-LLM moest antwoorden in een "zero-shot"-instelling, wat betekent dat het geen extra training voor een specifieke taak kreeg. De onderzoekers vergeleken PH-LLM’s nauwkeurigheid met een breed scala aan bekende systemen, waaronder open-source modellen zoals Llama, Mistral, BLOOMZ en Qwen, evenals commerciële modellen zoals GPT-4o en GPT-4o mini.

Kleiner maar sterker over talen heen

Zowel bij Engelstalige als meertalige taken hielden de PH-LLM‑modellen niet alleen stand, maar presteerden ze vaak beter dan alternatieven van vergelijkbare of zelfs veel grotere omvang. De versies met 14 miljard en 32 miljard parameters leverden de beste algehele prestaties, en versloegen in de benchmark gemiddeld grotere open-source modellen en zelfs de commerciële GPT-4o‑familie. Belangrijk is dat de sterkere meertalige scores betekenen dat PH-LLM gezondheidsgesprekken in het Arabisch, Chinees, Indonesisch en andere vaak over het hoofd geziene talen kan volgen. Omdat PH-LLM dit prestatieniveau bereikt met minder parameters dan veel concurrenten, kan het op bescheidener computermiddelen draaien, wat de kosten voor gezondheidsinstanties verlaagt, vooral in lage- en middeninkomenslanden.

Van online signalen naar beslissingen in de echte wereld

De auteurs zien PH-LLM als een praktisch hulpmiddel dat niet-technische volksgezondheidsmedewerkers via eenvoudige interfaces kunnen gebruiken. In combinatie met informatie over tijd, locatie en lokale omstandigheden kunnen de classificaties van PH-LLM onthullen waar twijfels over vaccins toenemen, welke gemeenschappen doelwit zijn van haatspraak, of wanneer gevaarlijke geruchten beginnen te verspreiden. Hoewel de modellen nog beperkingen hebben — zoals ongelijkmatige prestaties bij zeer moeilijke of ongelijke taken en mogelijke vooroordelen die ze overnemen uit sociale‑mediadata — vormen ze een belangrijke stap richting realtime, meertalige monitoring van volksgezondheidsgesprekken. Simpel gezegd verandert PH-LLM de rumoerige stroom van sociale media in duidelijkere signalen die autoriteiten kunnen helpen sneller en eerlijker te handelen, zowel tijdens dagelijkse campagnes als bij toekomstige pandemieën.

Bronvermelding: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Trefwoorden: volksgezondheidsbewaking, misinformatie op sociale media, vaccin terughoudendheid, meertalige AI, grote taalmodellen