Clear Sky Science · de

Eine Reihe großer Sprachmodelle für Public-Health-Infoveillance

Warum Online-Gespräche für die öffentliche Gesundheit wichtig sind

Während Ausbrüchen und Gesundheitsängsten wenden sich viele Menschen zuerst an soziale Medien statt an offizielle Webseiten oder Ärztinnen und Ärzte. Diese Beiträge zeigen, wovor Menschen Angst haben, was sie missverstehen und wie sie auf Ratschläge reagieren. Die hier beschriebene Studie stellt PH-LLM vor, eine Familie von künstlichen Intelligenzmodellen, die speziell dafür entwickelt wurde, diesen stetigen Strom an Online-Nachrichten in vielen Sprachen zu lesen und Gesundheitsbehörden zu helfen, Probleme früh zu erkennen und zu reagieren, bevor Gerüchte und Sorgen außer Kontrolle geraten.

Gesundheitsgespräche in Echtzeit beobachten

Öffentliche Gesundheitsbehörden haben sich lange auf Umfragen, Klinikberichte und Labordaten verlassen, um Entscheidungen zu treffen. Diese traditionellen Werkzeuge sind jedoch langsam und erfassen oft nicht die sich schnell verändernde Stimmung online, wo sich Überzeugungen zu Impfstoffen, Tests und neuen Krankheiten binnen Stunden verbreiten. Forschende bezeichnen Bemühungen, diesen digitalen Puls zu überwachen, als „Infoveillance“—die Überwachung von Informationen statt von Infektionen. Bislang beruhten die meisten dieser Ansätze auf kleineren Machine-Learning-Modellen, die für eine Aufgabe nach der anderen trainiert wurden, etwa um Impfzurückhaltung in englischen Tweets zu erkennen. Solche Systeme hatten Schwierigkeiten, mitzuhalten, wenn ein neues Thema, eine neue Sprache oder eine neue Plattform wichtig wurde.

Eine KI-Suite für Fragen der öffentlichen Gesundheit

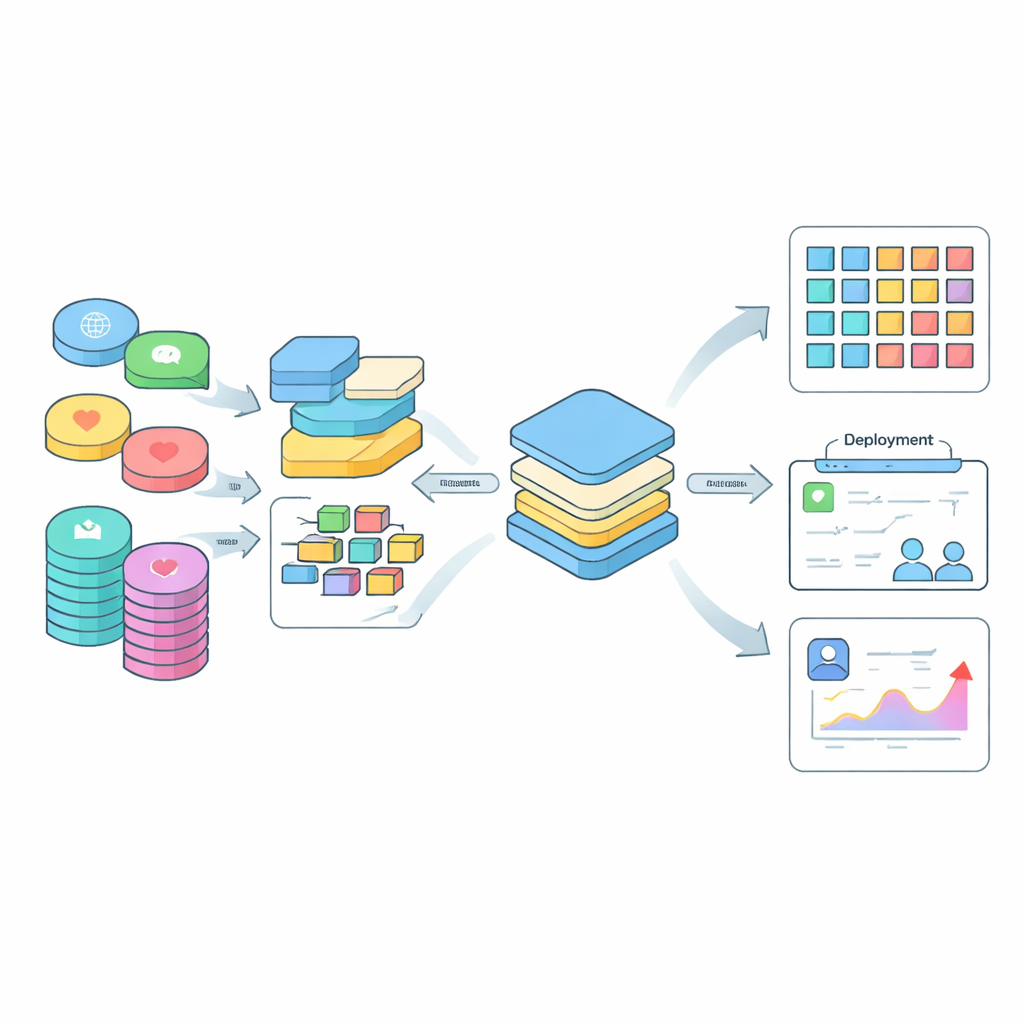

Um diese Lücke zu schließen, entwickelten die Autorinnen und Autoren PH-LLM, eine Suite großer Sprachmodelle, die speziell für Public-Health-Infoveillance feinabgestimmt wurden. Ausgehend von einem leistungsfähigen multilingualen Basismodell verfeinerten sie sechs Versionen, von leichten bis zu größeren Modellen, mit fast 600.000 Beispielen aus 30 Social-Media-Datensätzen und mehreren Frage-Antwort-Ressourcen im Gesundheitsbereich. Diese Beispiele deckten ein breites Themenspektrum ab, darunter Einstellungen zu Impfungen, Testzurückhaltung, Signale zur psychischen Gesundheit, Hassrede und Fehlinformationen über COVID-19 und andere Themen. Anstatt jeden Beitrag ins Englische umzuschreiben, blieben die Originalsprachen erhalten und wurden mit Instruktionsvorlagen kombiniert, die in 29 Sprachen übersetzt wurden, sodass die Modelle gemischte Sprachinhalte und nicht-englische Beiträge natürlich verarbeiten können.

PH-LLM einem harten Test unterziehen

Um herauszufinden, wie gut PH-LLM tatsächlich funktioniert, erstellte das Team ein anspruchsvolles Benchmark mit 39 ungesehenen Aufgaben aus 10 separaten Datensätzen in Englisch, Arabisch, Chinesisch und Indonesisch. Diese Aufgaben verlangten von den Modellen etwa, persönliche Geschichten von Nachrichten zu trennen, Hassrede zu markieren, falsche Behauptungen über Heilmittel zu identifizieren und sich ändernde Einstellungen gegenüber COVID-19-Impfstoffen zu erkennen. PH-LLM musste in einem „Zero-Shot“-Setting antworten, das heißt, es erhielt kein zusätzliches Training für eine bestimmte Aufgabe. Die Forschenden verglichen die Genauigkeit von PH-LLM mit einer breiten Palette bekannter Systeme, darunter Open-Source-Modelle wie Llama, Mistral, BLOOMZ und Qwen sowie kommerzielle Modelle wie GPT-4o und GPT-4o mini.

Kleiner, aber stärker über Sprachen hinweg

Sowohl bei rein englischen als auch bei multilingualen Aufgaben hielten sich die PH-LLM-Modelle nicht nur gut, sondern übertrafen häufig Alternativen ähnlicher oder sogar deutlich größerer Größe. Die Versionen mit 14 Milliarden und 32 Milliarden Parametern erzielten die beste Gesamtleistung und übertrafen im Benchmark größere Open-Source-Modelle und im Mittel sogar die kommerzielle GPT-4o-Familie. Wichtig ist, dass die besseren multilingualen Ergebnisse bedeuten, dass PH-LLM Gespräche zu Gesundheitsthemen in Arabisch, Chinesisch, Indonesisch und anderen oft vernachlässigten Sprachen verfolgen kann. Da PH-LLM dieses Genauigkeitsniveau mit weniger Parametern als viele Wettbewerber erreicht, lässt es sich auf bescheidenerer Rechenhardware betreiben und senkt die Kosten für Gesundheitsbehörden, insbesondere in Ländern mit niedrigem und mittlerem Einkommen.

Von Online-Signalen zu Entscheidungen in der realen Welt

Die Autorinnen und Autoren sehen PH-LLM als praktisches Werkzeug, das nicht-technische Mitarbeitende im öffentlichen Gesundheitswesen über einfache Oberflächen nutzen können. In Kombination mit Informationen zu Zeit, Ort und örtlichen Bedingungen können die Klassifikationen von PH-LLM aufzeigen, wo Zweifel an Impfungen zunehmen, welche Gemeinschaften Ziel von Hassrede sind oder wann gefährliche Gerüchte zu kursieren beginnen. Zwar haben die Modelle weiterhin Grenzen—etwa ungleichmäßige Leistung bei sehr schwierigen oder unausgewogenen Aufgaben und mögliche Verzerrungen, die aus Social-Media-Daten übernommen werden—doch sie markieren einen wichtigen Schritt hin zu einer Echtzeit-, mehrsprachigen Überwachung von Gesundheitsgesprächen. Einfach ausgedrückt verwandelt PH-LLM den lauten Strom sozialer Medien in klarere Signale, die Behörden helfen können, schneller und gerechter zu handeln, sowohl bei alltäglichen Kampagnen als auch bei künftigen Pandemien.

Zitation: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Schlüsselwörter: Überwachung der öffentlichen Gesundheit, Falschinformationen in sozialen Medien, Impfzurückhaltung, mehrsprachige KI, große Sprachmodelle