Clear Sky Science · he

מערך של מודלים לשוניים גדולים למעקב מידע ציבורי בתחום הבריאות

מדוע השיח המקוון חשוב לבריאות הציבור

במהלך התפרצויות ומקרי חרדה בריאותיים, רבים פונים קודם כל לרשתות החברתיות במקום לאתרים רשמיים או לרופאים. פרסומים אלה מגלים מה אנשים מפחדים ממנו, מה הם מבינים בצורה שגויה וכיצד הם מגיבים להנחיות. המחקר המתואר כאן מציג את PH-LLM, משפחה של מודלים בינה מלאכותית שנבנו במיוחד כדי לקרוא את הזרם המתמיד של הודעות מקוונות ברב־לשוניות, ולסייע לרשויות הבריאות לזהות בעיות מוקדם ולהגיב לפני שהשמועות והדאגות יוצאות משליטה.

צפייה בשיחות בריאות בזמן אמת

סוכנויות בריאות ציבוריות נסמכות זמן רב על סקרים, דיווחי מרפאות ונתוני מעבדה כדי להנחות החלטות. אך הכלים המסורתיים הללו איטיים ולעיתים מפספסים את המצב הרוח המשתנה במהירות ברשת, שם אמונות לגבי חיסונים, בדיקות ומחלות חדשות מתפשטות בשעות. חוקרים קוראים למאמצים למעקב אחר הדופק הדיגיטלי הזה "אינפוביילנס" — ניטור מידע במקום זיהומים. עד כה, מרבית המאמצים הללו הסתמכו על מודלים של למידת מכונה קטנים יותר שאומנו למשימה אחת בכל פעם, כגון זיהוי היסוס חיסוני בציוצים באנגלית. מערכות אלו התקשו לעמוד בקצב כאשר נושא חדש, שפה או פלטפורמה הפכו לרלוונטיים.

חבילת בינה מלאכותית המותאמת לשאלות בריאות הציבור

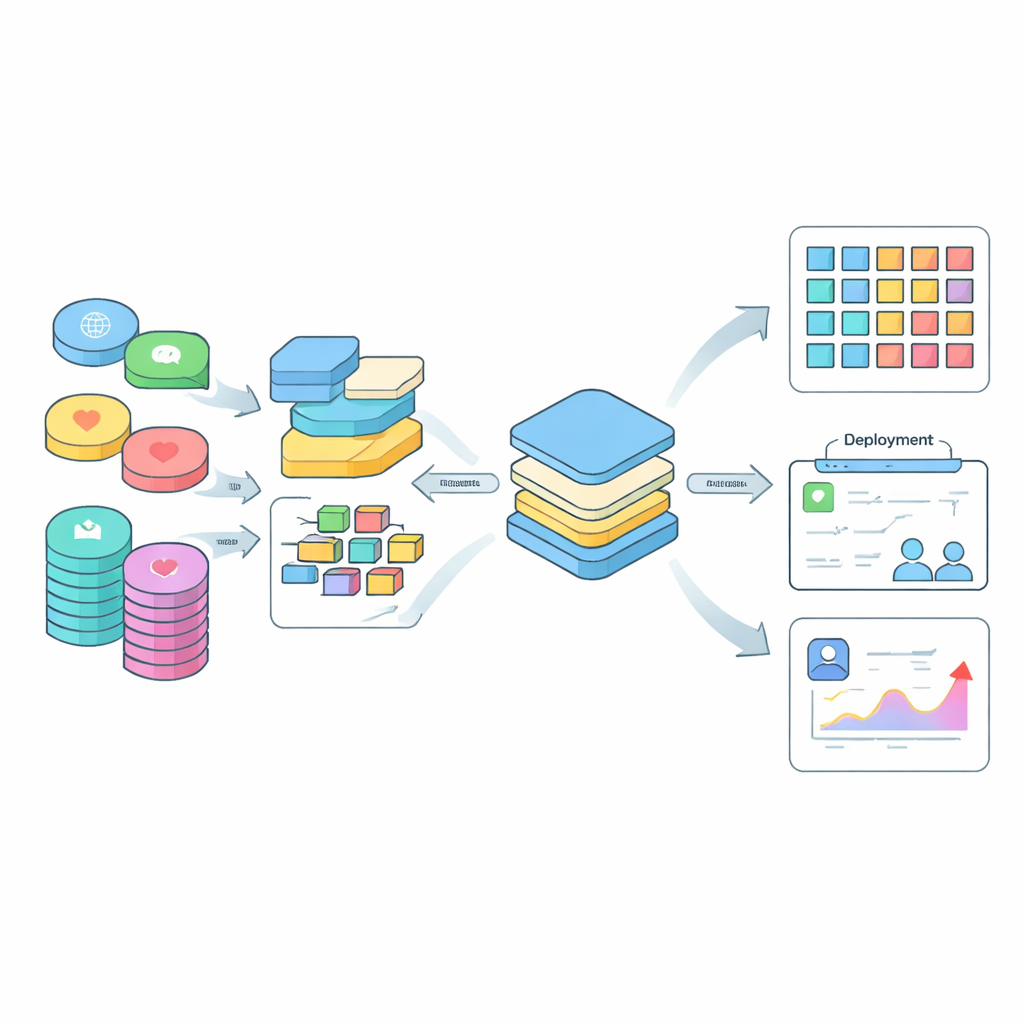

כדי לטפל בפער זה, המחברים יצרו את PH-LLM, חבילה של מודלים לשוניים גדולים מכוונים במיוחד לאינפוביילנס של בריאות הציבור. מתוך מודל בסיס רב־לשוני חזק, הם חילדו שישה גרסאות, מקלות ועד גדולות יותר, ואימנו אותן על כמעט 600,000 דוגמאות שנלקחו מ‑30 מערכי נתונים של רשתות חברתיות ומכמה משאבי שאלות־תשובות בריאותיים. הדוגמאות כיסו תערובת רחבה של נושאים, כולל עמדות כלפי חיסונים, היסוס לגבי בדיקות, אותות בריאות הנפש, שנאת זרים ומיסינפורמציה לגבי COVID-19 ונושאים אחרים. במקום לתרגם או לשכתב כל פוסט לאנגלית, הם שמרו על השפות המקוריות ושילבו אותן עם תבניות הנחיה שתורגמו ל‑29 שפות, כך שהמודלים יוכלו לטפל באופן טבעי בתוכן מעורב שפות ולא־אנגלי.

מבחן קשה ל‑PH-LLM

כדי לבדוק עד כמה PH-LLM אכן עובד, הצוות בנה סט מבחן תובעני שכלל 39 משימות שלא נראו בעבר שנלקחו מ‑10 מערכי נתונים שונים באנגלית, ערבית, סינית ואינדונזית. משימות אלה ביקשו מהמודלים לבצע פעולות כמו להפריד סיפורים אישיים מחדשות, לסמן שנאת דיבור, לזהות טענות שקריות על מרפאים ולגלות שינוי רגשות כלפי חיסוני COVID-19. ל‑PH-LLM נדרש לתת תשובות בהגדרת "זו‑שוט" — כלומר ללא אימון נוסף למשימה ספציפית. החוקרים השוו את הדיוק של PH-LLM לטווח רחב של מערכות ידועות, כולל מודלים בקוד פתוח כגון Llama, Mistral, BLOOMZ ו‑Qwen, וכן מודלים מסחריים כמו GPT-4o ו‑GPT-4o mini.

קטנים אך חזקים יותר בשפות רבות

במשימות אנגלית בלבד ובמשימות רב־לשוניות, דגמי PH-LLM לא רק היו תחרותיים אלא לעתים קרובות גם התעלו על חלופות בגודל דומה או אף גדול בהרבה. גרסאות ה‑14 מיליארד וה‑32 מיליארד פרמטרים העניקו את הביצועים הטובים ביותר באופן כללי, כשהן מנצחות מודלים בקוד פתוח גדולים יותר ואף את משפחת GPT-4o המסחרית בממוצע במדד. חשיבות נוספת היא שהציונים הרב־לשוניים החזקים מעידים כי PH-LLM יכול לעקוב אחר שיחות בריאותיות בערבית, סינית, אינדונזית ושפות נוספות שלרוב מוזנחות. מאחר ש‑PH-LLM מגיע לרמת דיוק זו עם פרמטרים מועטים יותר מאשר מתחרים רבים, הוא יכול לפעול על חומרת מחשב צנועה יותר, מה שמפחית עלויות עבור רשויות בריאות, במיוחד במדינות בעלות הכנסה נמוכה ובינונית.

מאותות מקוונים להחלטות בעולם האמיתי

המחברים מדמיינים את PH-LLM ככלי פרקטי שעובדי בריאות ציבור לא־טכניים יוכלו להשתמש בו דרך ממשקים פשוטים. בשילוב עם מידע על זמן, מיקום ותנאים מקומיים, הסיווגים של PH-LLM יכולים לחשוף היכן הספקות לגבי חיסונים גוברים, אילו קהילות מופנות לשנאת דיבור או מתי שמועות מסוכנות מתחילות להתפשט. למרות שמודלים אלה עדיין מוגבלים — כגון ביצועים לא אחידים במשימות קשות או מאוזנות בצורה גרועה והטיות אפשריות שמקורן בנתוני רשתות חברתיות — הם מהווים צעד משמעותי לקראת ניטור רב־לשוני בזמן אמת של שיחות בריאות הציבור. בפשטות, PH-LLM הופך את הזרם הרועש של רשתות חברתיות לאותות ברורים יותר שיכולים לסייע לרשויות לפעול מהר והוגן יותר במהלך קמפיינים שגרתיים ובחברות עתידיות של מגפות.

ציטוט: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

מילות מפתח: מעקב בריאות הציבור, מיסינפורמציה ברשתות חברתיות, היסוס חיסוני, בינה מלאכותית רב־לשונית, מודלים לשוניים גדולים