Clear Sky Science · fr

Une suite de grands modèles de langage pour l’infoveillance en santé publique

Pourquoi les échanges en ligne comptent pour la santé publique

Lors d’épidémies et d’alertes sanitaires, de nombreuses personnes se tournent d’abord vers les réseaux sociaux plutôt que vers les sites officiels ou les médecins. Ces publications révèlent ce que les gens craignent, ce qu’ils comprennent mal et comment ils réagissent aux conseils. L’étude présentée ici introduit PH-LLM, une famille de modèles d’intelligence artificielle conçus spécifiquement pour lire ce flux constant de messages en ligne dans de nombreuses langues, aidant les responsables de la santé à détecter les problèmes tôt et à réagir avant que rumeurs et inquiétudes ne prennent de l’ampleur.

Surveiller les conversations sur la santé en temps réel

Les agences de santé publique se sont longtemps appuyées sur des sondages, des rapports de cliniques et des données de laboratoire pour orienter leurs décisions. Mais ces outils traditionnels sont lents et manquent souvent l’évolution rapide du climat en ligne, où les croyances sur les vaccins, les tests et les nouvelles maladies se propagent en quelques heures. Les chercheurs appellent ces efforts visant à suivre ce pouls numérique « infoveillance » — la surveillance de l’information plutôt que de l’infection. Jusqu’à présent, la plupart de ces initiatives dépendaient de modèles d’apprentissage automatique plus petits, entraînés pour une tâche à la fois, comme repérer l’hésitation vaccinale dans des tweets en anglais. Ces systèmes peinaient à suivre quand un nouveau sujet, une nouvelle langue ou une nouvelle plateforme devenait important.

Une suite d’IA construite pour les questions de santé publique

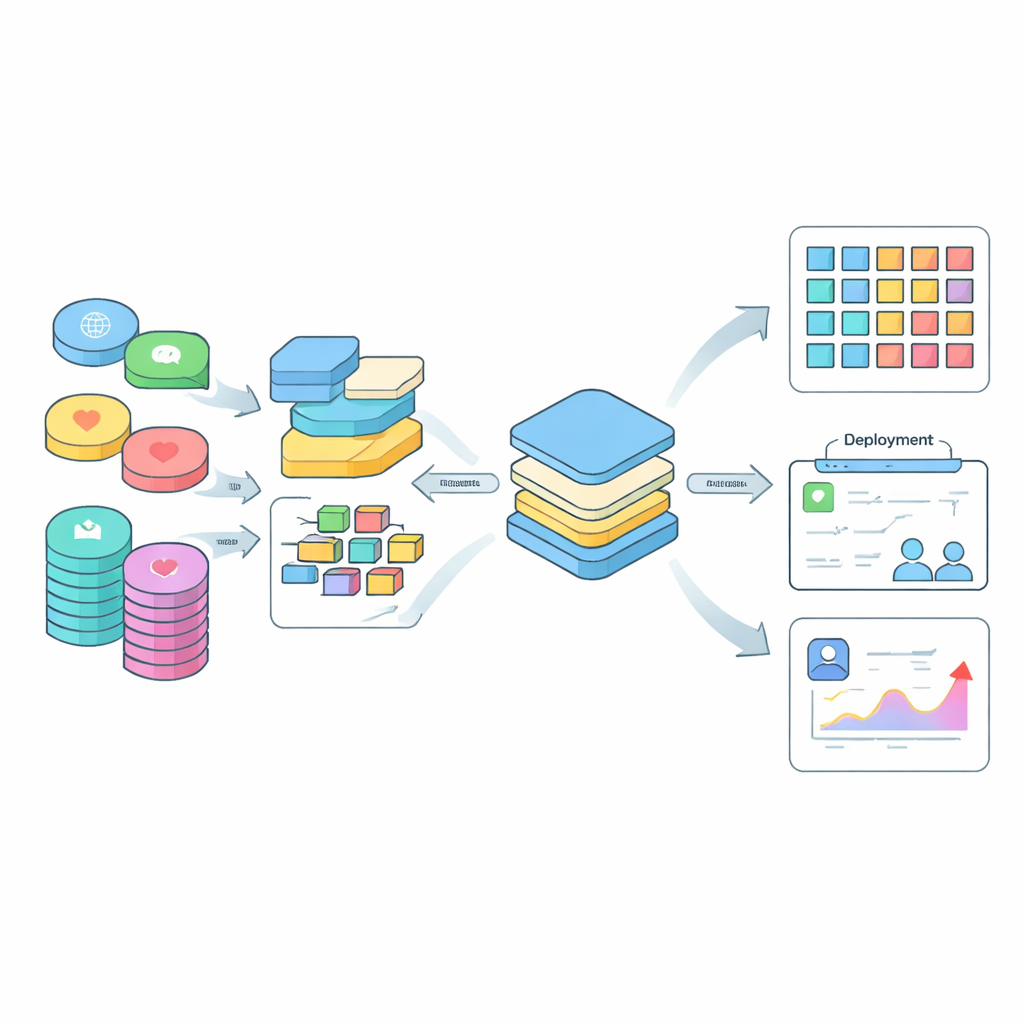

Pour combler cette lacune, les auteurs ont créé PH-LLM, une suite de grands modèles de langage ajustés spécifiquement pour l’infoveillance en santé publique. À partir d’un modèle de base multilingue puissant, ils ont affiné six versions, allant de légères à plus volumineuses, sur près de 600 000 exemples issus de 30 jeux de données de réseaux sociaux et de plusieurs ressources de questions-réponses en santé. Ces exemples couvraient un large éventail de sujets, notamment les attitudes vis-à-vis des vaccins, l’hésitation aux tests, les signaux de santé mentale, les discours de haine et la désinformation sur la COVID-19 et d’autres problématiques. Plutôt que de réécrire chaque publication en anglais, ils ont conservé les langues d’origine et les ont combinées avec des modèles d’instructions traduits en 29 langues, permettant aux modèles de traiter naturellement du contenu multilingue et non anglophone.

Soumettre PH-LLM à un test exigeant

Pour évaluer réellement les performances de PH-LLM, l’équipe a construit un banc d’essai exigeant de 39 tâches inédites tirées de 10 jeux de données distincts en anglais, arabe, chinois et indonésien. Ces tâches demandaient aux modèles d’effectuer des opérations telles que séparer les récits personnels des informations, signaler les discours de haine, identifier les fausses affirmations sur des remèdes et détecter l’évolution des sentiments envers les vaccins contre la COVID-19. PH-LLM devait répondre en mode « zero-shot », c’est-à-dire sans entraînement supplémentaire sur une tâche spécifique. Les chercheurs ont comparé la précision de PH-LLM à une large gamme de systèmes bien connus, y compris des modèles open source tels que Llama, Mistral, BLOOMZ et Qwen, ainsi que des modèles commerciaux comme GPT-4o et GPT-4o mini.

Plus petits mais meilleurs à travers les langues

Sur des tâches exclusivement en anglais comme sur des tâches multilingues, les modèles PH-LLM non seulement se défendaient, mais surpassaient fréquemment des alternatives de taille similaire voire bien supérieure. Les versions à 14 milliards et 32 milliards de paramètres ont offert les meilleures performances globales, battant en moyenne des modèles open source plus grands et même la famille commerciale GPT-4o sur le benchmark. Fait important, ces meilleurs résultats multilingues signifient que PH-LLM peut suivre les conversations liées à la santé en arabe, chinois, indonésien et d’autres langues souvent négligées. Parce que PH-LLM atteint ce niveau de précision avec moins de paramètres que beaucoup de concurrents, il peut fonctionner sur du matériel informatique plus modeste, réduisant les coûts pour les agences de santé, notamment dans les pays à revenu faible ou intermédiaire.

Des signaux en ligne aux décisions du monde réel

Les auteurs envisagent PH-LLM comme un outil pratique que les agents de santé publique non techniques peuvent utiliser via des interfaces simples. Lorsqu’elles sont combinées à des informations sur le temps, le lieu et les conditions locales, les classifications de PH-LLM peuvent révéler où les doutes sur les vaccins augmentent, quelles communautés sont ciblées par des discours de haine ou quand des rumeurs dangereuses commencent à se propager. Bien que les modèles présentent encore des limites — telles qu’une performance inégale sur des tâches très difficiles ou déséquilibrées et des biais possibles hérités des données des réseaux sociaux — ils représentent une avancée majeure vers une surveillance multilingue et en temps réel des conversations de santé publique. En termes simples, PH-LLM transforme le flux bruyant des réseaux sociaux en signaux plus clairs qui peuvent aider les autorités à agir plus rapidement et plus équitablement lors des campagnes courantes comme lors de futures pandémies.

Citation: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Mots-clés: surveillance de la santé publique, désinformation sur les réseaux sociaux, hésitation vaccinale, IA multilingue, grands modèles de langage