Clear Sky Science · ru

Набор больших языковых моделей для инфоведений в области общественного здравоохранения

Почему онлайн-обсуждения важны для общественного здравоохранения

Во время вспышек заболеваний и панических настроений многие сначала обращаются к социальным сетям, а не к официальным сайтам или врачам. Эти публикации показывают, чего люди боятся, что они неправильно понимают и как реагируют на рекомендации. Описанное здесь исследование представляет PH-LLM — семейство моделей искусственного интеллекта, специально созданных для анализа постоянного потока онлайн-сообщений на многих языках, помогая работникам здравоохранения рано выявлять проблемы и реагировать до того, как слухи и тревоги выйдут из-под контроля.

Отслеживание разговоров о здоровье в реальном времени

Агентства общественного здравоохранения долгое время опирались на опросы, отчёты клиник и лабораторные данные для принятия решений. Но эти традиционные инструменты медлительны и часто не успевают за быстро меняющейся атмосферой в сети, где мнения о вакцинах, тестировании и новых заболеваниях распространяются за часы. Исследователи называют попытки отслеживать этот цифровой пульс «инфоведением» — мониторинг информации вместо инфекций. До сих пор такие усилия в основном опирались на меньшие модели машинного обучения, обученные для одной задачи за раз, например, выявление сомнений в вакцинации в англоязычных твитах. Такие системы испытывали трудности, когда появлялась новая тема, язык или платформа.

ИИ-набор, ориентированный на вопросы общественного здравоохранения

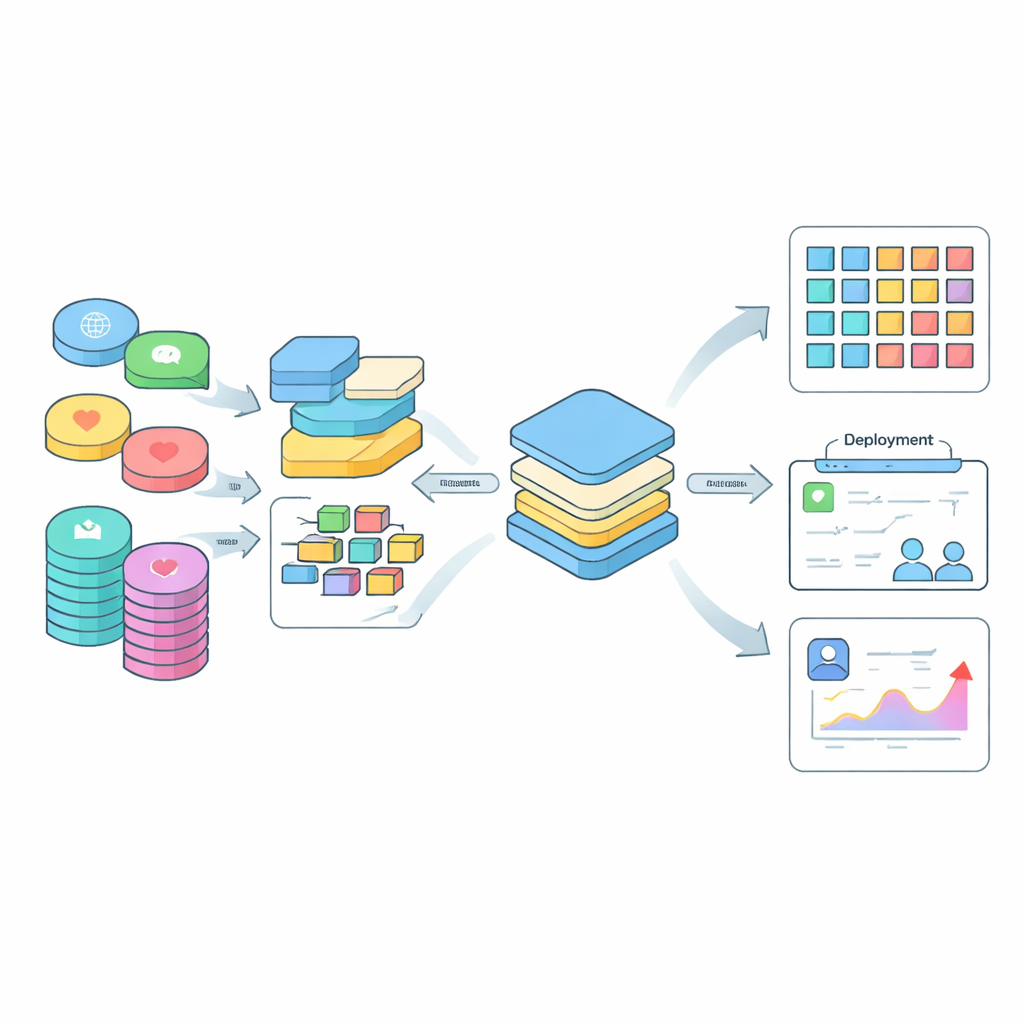

Чтобы преодолеть этот разрыв, авторы создали PH-LLM — набор больших языковых моделей, настроенных специально для инфоведений в области общественного здравоохранения. Начиная с мощной многоязычной базовой модели, они дообучили шесть версий, от лёгких до более крупных, на почти 600 000 примеров, взятых из 30 наборов данных социальных медиа и нескольких ресурсов вопросов и ответов по здравоохранению. Эти примеры охватывали широкий спектр тем, включая отношение к вакцинам, неготовность проходить тестирование, сигналы психического здоровья, речь ненависти и дезинформацию о COVID-19 и других проблемах. Вместо того чтобы переписывать каждое сообщение по-английски, они сохранили исходные языки и объединили их с шаблонами инструкций, переведёнными на 29 языков, чтобы модели могли естественно обрабатывать смешанный и неанглоязычный контент.

Трудное испытание для PH-LLM

Чтобы проверить, насколько хорошо работает PH-LLM, команда составила жёсткий бенчмарк из 39 невидимых задач, взятых из 10 отдельных наборов данных на английском, арабском, китайском и индонезийском языках. Эти задачи требовали от моделей, например, отделять личные истории от новостей, помечать речь ненависти, выявлять ложные утверждения о средствах лечения и обнаруживать изменения отношения к вакцинам против COVID-19. PH-LLM должен был отвечать в режиме «zero-shot», то есть без дополнительного обучения для конкретной задачи. Исследователи сравнивали точность PH-LLM с широким спектром известных систем, включая открытые модели, такие как Llama, Mistral, BLOOMZ и Qwen, а также коммерческие модели вроде GPT-4o и GPT-4o mini.

Меньше, но сильнее в разных языках

Как в задачах только на английском, так и в многоязычных заданиях модели PH-LLM не просто держались на уровне конкурентов, но часто превосходили аналоги сопоставимого или даже значительно большего размера. Версии с 14 и 32 миллиардами параметров показали наилучшие результаты в целом, обойдя в среднем более крупные открытые модели и даже семейство коммерческих GPT-4o в бенчмарке. Важно, что более высокие многоязычные показатели означают: PH-LLM может отслеживать разговоры о здоровье на арабском, китайском, индонезийском и других языках, которые часто остаются без внимания. Поскольку PH-LLM достигает такого уровня точности с меньшим числом параметров, он может работать на более скромном оборудовании, снижая затраты для органов здравоохранения, особенно в странах с низким и средним уровнем дохода.

От сигналов в сети к решениям в реальном мире

Авторы видят PH-LLM как практический инструмент, который сотрудники общественного здравоохранения без технической подготовки смогут использовать через простые интерфейсы. В сочетании с информацией о времени, месте и локальных условиях классификации PH-LLM могут выявлять, где растут сомнения в отношении вакцин, какие сообщества становятся мишенью для речи ненависти или когда начинают распространяться опасные слухи. Хотя у моделей остаются ограничения — например, неравномерная производительность на очень сложных или несбалансированных задачах и возможные предвзятости, унаследованные из данных социальных сетей — они означают большой шаг к мониторингу разговоров о здоровье в реальном времени и на многих языках. Проще говоря, PH-LLM превращает шумный поток социальных сетей в более чёткие сигналы, которые помогают властям действовать быстрее и справедливее как в повседневных кампаниях, так и во время будущих пандемий.

Цитирование: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Ключевые слова: надзор за общественным здоровьем, дезинформация в социальных сетях, колебания в отношении вакцин, многоязычный ИИ, большие языковые модели