Clear Sky Science · it

Una suite di grandi modelli linguistici per l'infoveglianza in sanità pubblica

Perché le conversazioni online sono importanti per la sanità pubblica

Durante focolai e allarmi sanitari, molte persone si rivolgono prima ai social media invece che ai siti ufficiali o ai medici. Questi post rivelano ciò che la gente teme, ciò che fraintende e come reagisce ai consigli. Lo studio descritto qui presenta PH-LLM, una famiglia di modelli di intelligenza artificiale costruiti specificamente per leggere questo flusso costante di messaggi online in molte lingue, aiutando le autorità sanitarie a individuare i problemi precocemente e a intervenire prima che voci e preoccupazioni sfuggano al controllo.

Monitorare le conversazioni sulla salute in tempo reale

Le agenzie di sanità pubblica si sono a lungo affidate a sondaggi, rapporti clinici e dati di laboratorio per guidare le decisioni. Ma questi strumenti tradizionali sono lenti e spesso non colgono l'umore online, che cambia rapidamente, dove convinzioni su vaccini, test e nuove malattie si diffondono in poche ore. I ricercatori chiamano questi sforzi per tracciare il polso digitale «infoveillance» — monitorare le informazioni anziché le infezioni. Finora, la maggior parte di tali iniziative dipendeva da modelli di machine learning più piccoli addestrati per un singolo compito alla volta, come identificare l'esitazione vaccinale nei tweet in inglese. Questi sistemi faticavano a tenere il passo quando emergeva una nuova questione, lingua o piattaforma.

Una suite di IA pensata per le domande di sanità pubblica

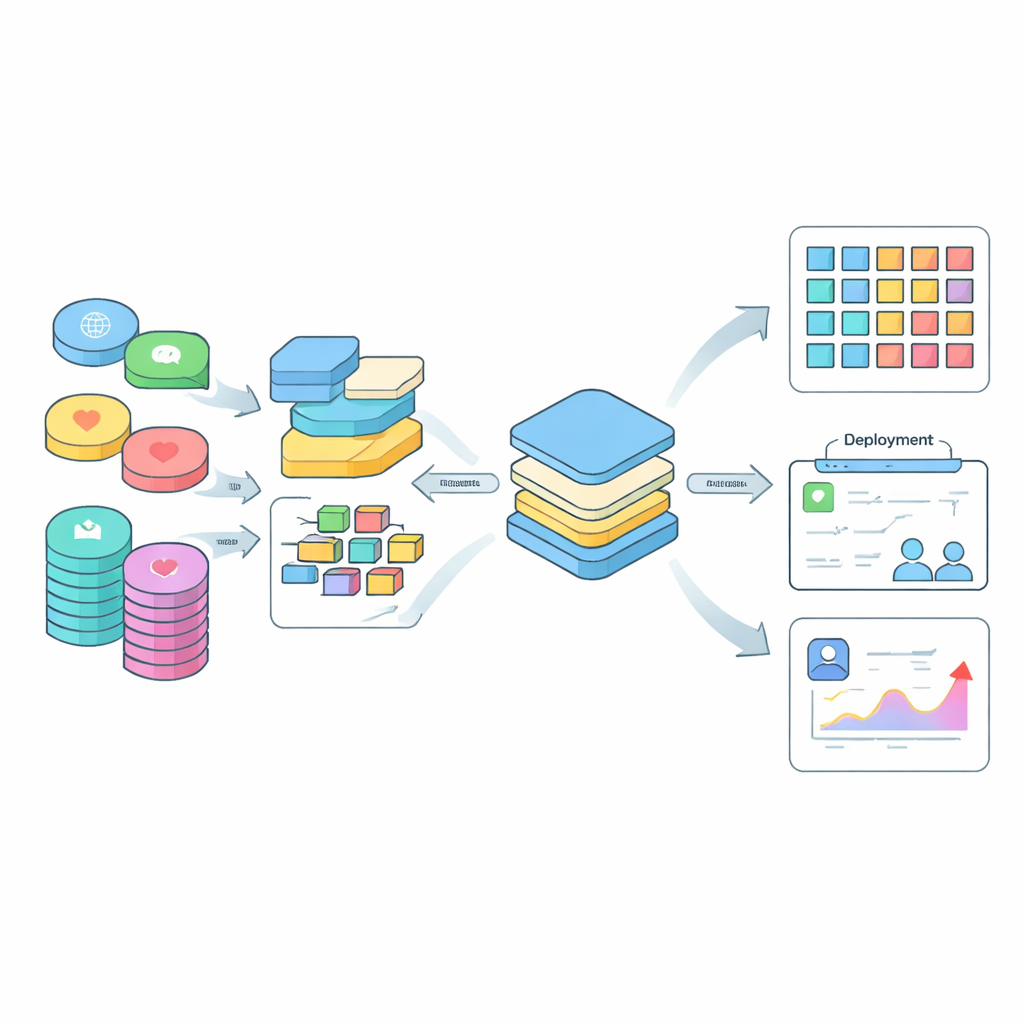

Per colmare questa lacuna, gli autori hanno creato PH-LLM, una suite di grandi modelli linguistici sintonizzati specificamente per l'infoveglianza in sanità pubblica. Partendo da un potente modello di base multilingue, hanno messo a punto sei versioni, che vanno da leggere a più grandi, su quasi 600.000 esempi ricavati da 30 dataset di social media e da diverse risorse di domande e risposte in ambito sanitario. Questi esempi coprivano un'ampia gamma di argomenti, incluse attitudini verso i vaccini, esitazione ai test, segnali di salute mentale, discorsi d'odio e disinformazione su COVID-19 e altre tematiche. Invece di riscrivere ogni post in inglese, hanno mantenuto le lingue originali e le hanno combinate con modelli di istruzioni tradotti in 29 lingue, così i modelli possono gestire in modo naturale contenuti multilingue e non inglesi.

Mettere PH-LLM alla prova

Per capire quanto PH-LLM funzionasse realmente, il team ha costruito un benchmark impegnativo composto da 39 compiti non visti, tratti da 10 dataset distinti in inglese, arabo, cinese e indonesiano. Questi compiti richiedevano ai modelli di fare cose come separare racconti personali da notizie, segnalare discorsi d'odio, identificare affermazioni false su cure e rilevare il cambiamento di atteggiamenti verso i vaccini COVID-19. PH-LLM ha dovuto rispondere in una modalità «zero-shot», ovvero senza ulteriore addestramento specifico per i singoli compiti. I ricercatori hanno confrontato l'accuratezza di PH-LLM con un'ampia gamma di sistemi noti, inclusi modelli open-source come Llama, Mistral, BLOOMZ e Qwen, oltre a modelli commerciali come GPT-4o e GPT-4o mini.

Più piccoli ma più efficaci attraverso le lingue

Sia nei compiti esclusivamente in inglese sia in quelli multilingue, i modelli PH-LLM non si sono limitati a tenere il passo, ma spesso hanno superato alternative di dimensioni simili o persino molto maggiori. Le versioni da 14 miliardi e 32 miliardi di parametri hanno fornito le migliori prestazioni complessive, battendo modelli open-source più grandi e, in media nel benchmark, anche la famiglia commerciale GPT-4o. È importante che i punteggi migliori in ambito multilingue significhino che PH-LLM può tracciare conversazioni legate alla salute in arabo, cinese, indonesiano e altre lingue spesso trascurate. Poiché PH-LLM raggiunge questo livello di accuratezza con meno parametri rispetto a molti concorrenti, può funzionare su hardware di calcolo più modesto, riducendo i costi per le agenzie sanitarie, in particolare nei paesi a basso e medio reddito.

Dai segnali online alle decisioni nel mondo reale

Gli autori immaginano PH-LLM come uno strumento pratico che operatori della sanità pubblica non tecnici possono usare tramite interfacce semplici. Se combinati con informazioni su tempo, posizione e condizioni locali, le classificazioni di PH-LLM possono rivelare dove stanno aumentando i dubbi sui vaccini, quali comunità sono bersaglio di discorsi d'odio o quando iniziano a circolare voci pericolose. Pur avendo ancora limiti — come prestazioni disomogenee su compiti molto difficili o sbilanciati e possibili bias ereditati dai dati dei social media — rappresentano un passo importante verso il monitoraggio multilingue in tempo reale delle conversazioni di sanità pubblica. In termini semplici, PH-LLM trasforma il flusso rumoroso dei social media in segnali più chiari che possono aiutare le autorità ad agire più rapidamente e in modo più equo sia nelle campagne quotidiane sia nelle future pandemie.

Citazione: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Parole chiave: sorveglianza della sanità pubblica, disinformazione sui social media, esitazione vaccinale, IA multilingue, grandi modelli linguistici