Clear Sky Science · pl

Pakiet dużych modeli językowych do infoweligilii zdrowia publicznego

Dlaczego rozmowy online mają znaczenie dla zdrowia publicznego

W czasie epidemii i niepokojów zdrowotnych wielu ludzi najpierw szuka informacji w mediach społecznościowych, a nie na oficjalnych stronach czy u lekarzy. Posty te ujawniają, czego ludzie się boją, co źle rozumieją i jak reagują na porady. Opisane tu badanie przedstawia PH-LLM — rodzinę modeli sztucznej inteligencji stworzonych specjalnie do czytania tego nieustannego strumienia wiadomości online w wielu językach, pomagając służbom zdrowia wykrywać problemy wcześnie i reagować, zanim plotki i obawy wymkną się spod kontroli.

Obserwowanie rozmów o zdrowiu w czasie rzeczywistym

Agencje zdrowia publicznego od dawna opierają decyzje na ankietach, raportach z przychodni i danych laboratoryjnych. Tradycyjne narzędzia są jednak powolne i często nie wychwytują szybko zmieniającego się nastroju online, gdzie poglądy na temat szczepionek, testów i nowych chorób rozprzestrzeniają się w ciągu godzin. Badacze nazywają próby śledzenia tego cyfrowego pulsu „infoweligilencją” — monitorowaniem informacji zamiast infekcji. Do tej pory większość takich działań polegała na mniejszych modelach uczenia maszynowego trenowanych do jednego zadania, na przykład wykrywania niechęci do szczepień w anglojęzycznych tweetach. Systemy te miały trudności z nadążaniem, gdy pojawiał się nowy problem, język lub platforma.

Pakiet AI zaprojektowany pod kątem pytań zdrowia publicznego

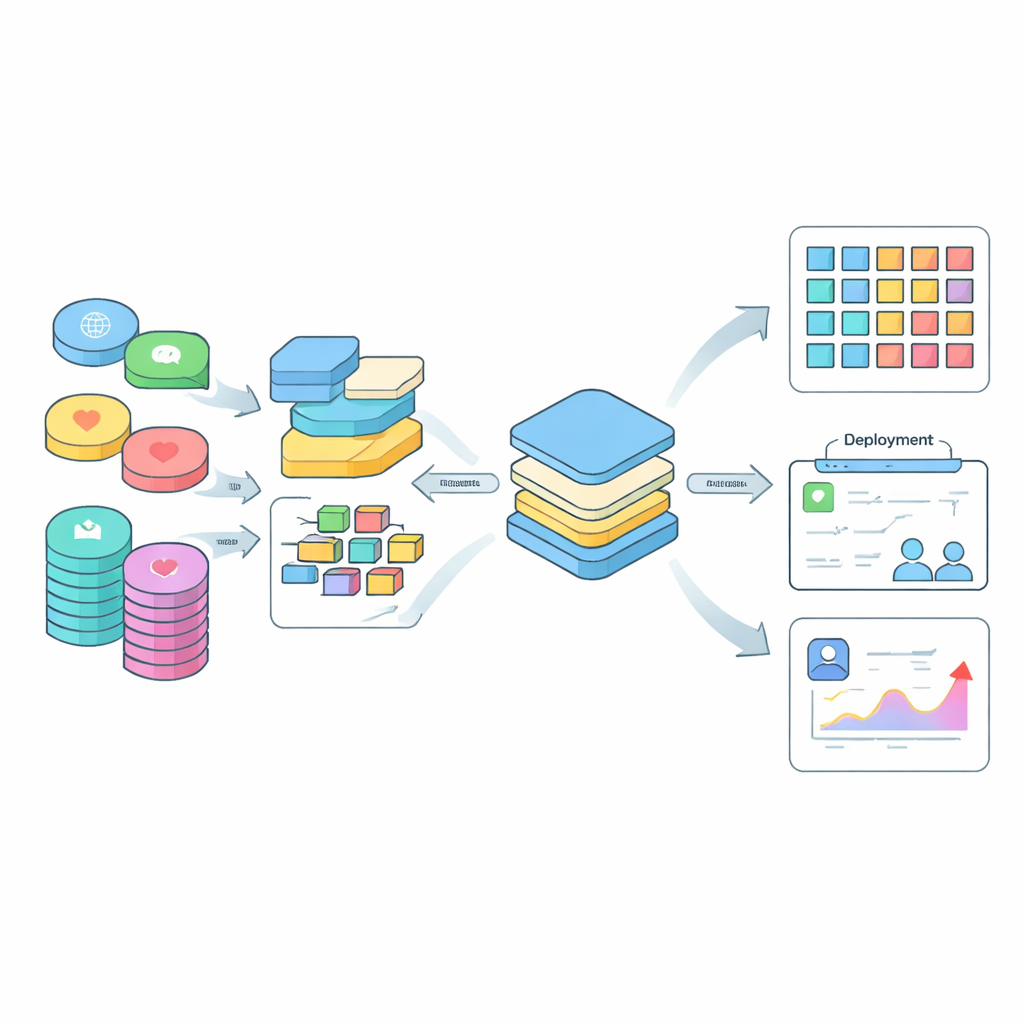

Aby wypełnić tę lukę, autorzy stworzyli PH-LLM — zestaw dużych modeli językowych dostrojonych specjalnie do infoweligilencji zdrowia publicznego. Wychodząc od mocnego, wielojęzycznego modelu bazowego, dopracowali sześć wersji — od lekkich po większe — na niemal 600 000 przykładów pochodzących z 30 zestawów danych z mediów społecznościowych oraz kilku zasobów pytań i odpowiedzi dotyczących zdrowia. Przykłady te obejmowały szerokie spektrum tematów, w tym postawy wobec szczepień, niechęć do testowania, sygnały dotyczące zdrowia psychicznego, mowę nienawiści i dezinformację o COVID-19 i innych zagadnieniach. Zamiast przepisywać każde wezwanie na angielski, zachowali oryginalne języki i połączyli je z szablonami instrukcji przetłumaczonymi na 29 języków, dzięki czemu modele mogły naturalnie obsługiwać treści mieszane i nieanglojęzyczne.

Trudny test dla PH-LLM

Aby sprawdzić, jak dobrze PH-LLM działa w praktyce, zespół przygotował wymagający benchmark obejmujący 39 niewidzianych wcześniej zadań wybranych z 10 oddzielnych zestawów danych w języku angielskim, arabskim, chińskim i indonezyjskim. Zadania prosiły modele o takie rzeczy, jak oddzielanie osobistych relacji od wiadomości, oznaczanie mowy nienawiści, identyfikowanie fałszywych twierdzeń o lekach oraz wykrywanie zmieniających się nastrojów wobec szczepionek przeciw COVID-19. PH-LLM musiał odpowiadać w trybie „zero-shot”, czyli bez dodatkowego treningu do konkretnych zadań. Badacze porównali dokładność PH-LLM z szerokim wachlarzem znanych systemów, w tym modelami open-source takimi jak Llama, Mistral, BLOOMZ i Qwen, a także modelami komercyjnymi, np. GPT-4o i GPT-4o mini.

Mniejsze, ale silniejsze w wielu językach

W zadaniach zarówno tylko w języku angielskim, jak i wielojęzycznych modele PH-LLM nie tylko dotrzymywały kroku, lecz często przewyższały alternatywy o podobnej lub znacznie większej wielkości. Wersje z 14 i 32 miliardami parametrów osiągnęły najlepsze wyniki ogólne, pokonując większe modele open-source, a w benchmarku średnio przewyższając nawet komercyjne modele z rodziny GPT-4o. Istotne jest to, że lepsze wyniki wielojęzyczne oznaczają, iż PH-LLM może śledzić rozmowy o zdrowiu w językach arabskim, chińskim, indonezyjskim i innych, które często są pomijane. Ponieważ PH-LLM osiąga tę dokładność przy mniejszej liczbie parametrów niż wielu konkurentów, może działać na skromniejszym sprzęcie obliczeniowym, obniżając koszty dla agencji zdrowia, szczególnie w krajach o niskich i średnich dochodach.

Od sygnałów online do decyzji w świecie rzeczywistym

Autorzy widzą PH-LLM jako praktyczne narzędzie, z którego pracownicy służby zdrowia bez zaawansowanej wiedzy technicznej mogą korzystać przez proste interfejsy. W połączeniu z informacjami o czasie, miejscu i lokalnych warunkach klasyfikacje PH-LLM mogą pokazać, gdzie rosną wątpliwości wobec szczepień, które społeczności są celem mowy nienawiści, lub kiedy zaczynają rozprzestrzeniać się niebezpieczne plotki. Modele wciąż mają ograniczenia — na przykład nierówną wydajność w bardzo trudnych lub niezbalansowanych zadaniach oraz możliwe uprzedzenia odziedziczone z danych z mediów społecznościowych — jednak stanowią istotny krok w kierunku monitorowania rozmów o zdrowiu publicznym w czasie rzeczywistym i w wielu językach. Mówiąc prosto, PH-LLM przekształca hałaśliwy strumień mediów społecznościowych w wyraźniejsze sygnały, które mogą pomóc władzom działać szybciej i sprawiedliwiej podczas rutynowych kampanii i przyszłych pandemii.

Cytowanie: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Słowa kluczowe: monitorowanie zdrowia publicznego, dezinformacja w mediach społecznościowych, niechęć do szczepień, wielojęzyczna sztuczna inteligencja, duże modele językowe