Clear Sky Science · es

Una suite de modelos de lenguaje grande para la infoveiligancia en salud pública

Por qué importa el ruido en línea para la salud pública

Durante brotes y alarmas sanitarias, muchas personas consultan primero las redes sociales en lugar de sitios oficiales o médicos. Estas publicaciones revelan qué temen las personas, qué malentienden y cómo responden a las recomendaciones. El estudio que se describe aquí presenta PH-LLM, una familia de modelos de inteligencia artificial diseñados específicamente para leer ese flujo constante de mensajes en línea en muchos idiomas, ayudando a las autoridades sanitarias a detectar problemas pronto y responder antes de que los rumores y las inquietudes se descontrolen.

Vigilar las conversaciones sobre salud en tiempo real

Las agencias de salud pública han confiado durante mucho tiempo en encuestas, informes clínicos y datos de laboratorio para orientar sus decisiones. Pero estas herramientas tradicionales son lentas y a menudo pasan por alto el pulso cambiante en línea, donde las creencias sobre vacunas, pruebas y nuevas enfermedades se difunden en horas. Los investigadores llaman a estos esfuerzos para rastrear el pulso digital «infoveiligancia»: monitorizar la información en lugar de las infecciones. Hasta ahora, la mayoría de estos intentos dependían de modelos de aprendizaje automático más pequeños entrenados para una tarea a la vez, como detectar la hesitación vacunal en tuits en inglés. Estos sistemas tenían dificultades para adaptarse cuando surgía un nuevo tema, idioma o plataforma relevante.

Una suite de IA construida para preguntas de salud pública

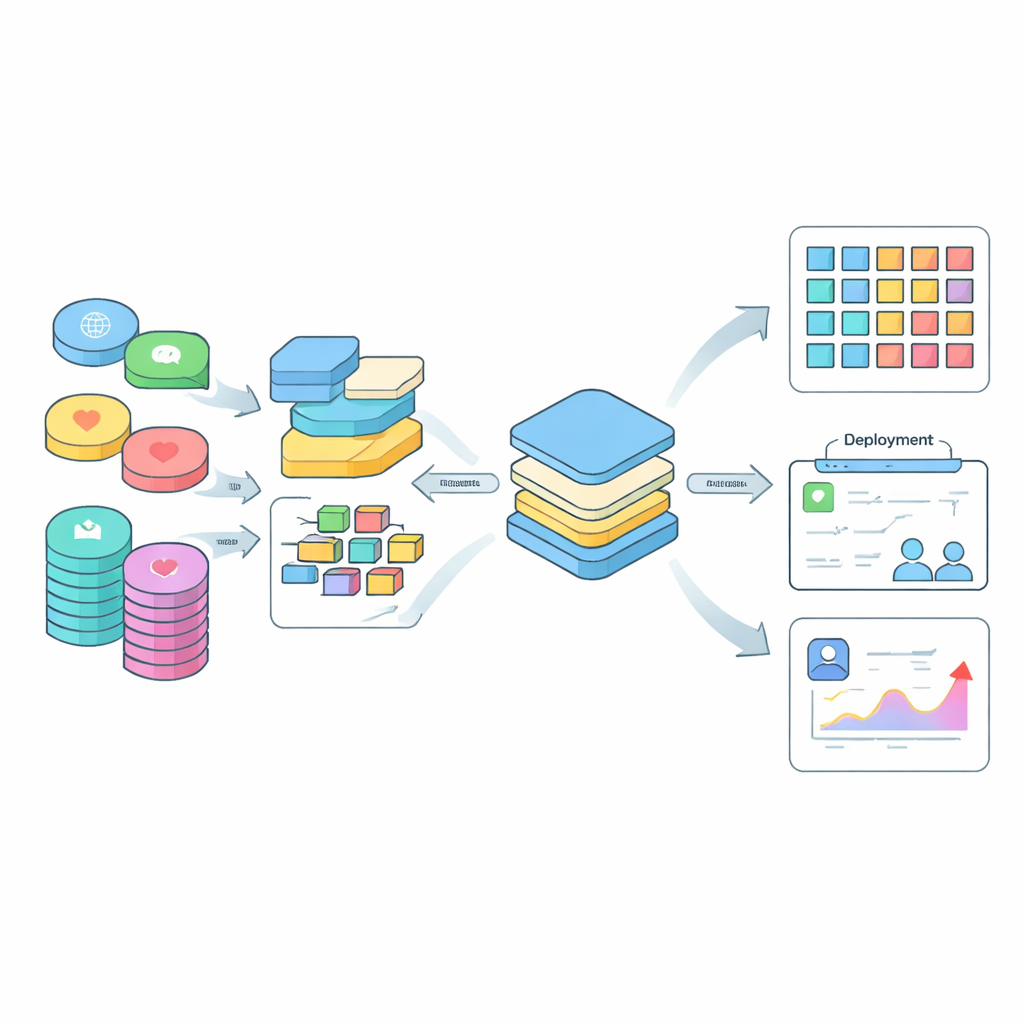

Para abordar esta brecha, los autores crearon PH-LLM, una suite de modelos de lenguaje grande ajustados específicamente para la infoveiligancia en salud pública. Partiendo de un potente modelo base multilingüe, afinaron seis versiones, desde ligeras hasta más grandes, con casi 600 000 ejemplos extraídos de 30 conjuntos de datos de redes sociales y varias fuentes de preguntas y respuestas sobre salud. Estos ejemplos abarcaron una mezcla amplia de temas, incluidas actitudes hacia las vacunas, hesitación ante las pruebas, señales de salud mental, discurso de odio y desinformación sobre la COVID-19 y otros asuntos. En lugar de reescribir cada publicación en inglés, conservaron los idiomas originales y los combinaron con plantillas de instrucciones traducidas a 29 lenguas, de modo que los modelos pudieran manejar de forma natural contenido multilingüe y no inglés.

Poner a PH-LLM a una prueba exigente

Para evaluar realmente el rendimiento de PH-LLM, el equipo construyó un riguroso punto de referencia con 39 tareas inéditas tomadas de 10 conjuntos de datos distintos en inglés, árabe, chino e indonesio. Estas tareas pedían a los modelos cosas como separar relatos personales de noticias, señalar discurso de odio, identificar afirmaciones falsas sobre curas y detectar cambios en las actitudes hacia las vacunas contra la COVID-19. PH-LLM tuvo que responder en un contexto «zero-shot», lo que significa que no recibió entrenamiento adicional para ninguna tarea específica. Los investigadores compararon la precisión de PH-LLM con una amplia gama de sistemas conocidos, incluidos modelos de código abierto como Llama, Mistral, BLOOMZ y Qwen, así como modelos comerciales como GPT-4o y GPT-4o mini.

Más pequeños pero más fuertes entre idiomas

Tanto en tareas solo en inglés como en tareas multilingües, los modelos PH-LLM no solo se mantuvieron al nivel de sus competidores, sino que con frecuencia los superaron, incluso frente a alternativas de tamaño similar o mucho mayor. Las versiones de 14 000 y 32 000 millones de parámetros ofrecieron el mejor rendimiento global, superando en promedio a modelos open source más grandes e incluso a la familia comercial GPT-4o en el punto de referencia. Es importante que las mejores puntuaciones multilingües signifiquen que PH-LLM puede seguir conversaciones relacionadas con la salud en árabe, chino, indonesio y otros idiomas que a menudo se pasan por alto. Dado que PH-LLM alcanza este nivel de precisión con menos parámetros que muchos competidores, puede ejecutarse en hardware informático más modesto, reduciendo costos para las agencias de salud, especialmente en países de ingresos bajos y medios.

De las señales en línea a decisiones del mundo real

Los autores imaginan PH-LLM como una herramienta práctica que los trabajadores de salud pública sin perfil técnico puedan usar a través de interfaces sencillas. Combinadas con información sobre tiempo, ubicación y condiciones locales, las clasificaciones de PH-LLM pueden revelar dónde aumentan las dudas sobre las vacunas, qué comunidades son objeto de discurso de odio o cuándo empiezan a difundirse rumores peligrosos. Aunque los modelos siguen teniendo limitaciones —como un rendimiento irregular en tareas muy difíciles o desbalanceadas y posibles sesgos heredados de los datos de redes sociales—, suponen un avance importante hacia la monitorización multilingüe y en tiempo real de las conversaciones sobre salud pública. En términos sencillos, PH-LLM convierte el flujo ruidoso de las redes sociales en señales más claras que pueden ayudar a las autoridades a actuar más rápido y con más equidad tanto en campañas cotidianas como en futuras pandemias.

Cita: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Palabras clave: vigilancia de la salud pública, desinformación en redes sociales, hesitación vacunal, IA multilingüe, modelos de lenguaje grande