Clear Sky Science · pt

Um conjunto de grandes modelos de linguagem para infoveigência em saúde pública

Por que o burburinho online importa para a saúde pública

Durante surtos e alertas de saúde, muitas pessoas recorrem primeiro às redes sociais em vez de sites oficiais ou médicos. Essas publicações revelam o que as pessoas temem, o que elas entendem mal e como respondem a orientações. O estudo descrito aqui apresenta o PH-LLM, uma família de modelos de inteligência artificial desenvolvida especificamente para ler esse fluxo constante de mensagens online em vários idiomas, ajudando autoridades de saúde a identificar problemas cedo e responder antes que boatos e preocupações saiam do controle.

Monitorando conversas sobre saúde em tempo real

Agências de saúde pública há muito dependem de pesquisas, relatórios clínicos e dados laboratoriais para orientar decisões. Mas essas ferramentas tradicionais são lentas e frequentemente não captam o humor, em rápida mudança, que circula online, onde crenças sobre vacinas, testes e novas doenças se espalham em horas. Pesquisadores chamam os esforços para rastrear esse pulso digital de "infoveigência"—monitoramento da informação em vez das infecções. Até agora, a maioria dessas iniciativas dependia de modelos de aprendizado de máquina menores treinados para uma tarefa de cada vez, como identificar hesitação vacinal em tuítes em inglês. Esses sistemas tiveram dificuldade para acompanhar quando surgia um novo tema, idioma ou plataforma relevante.

Um conjunto de IA projetado para questões de saúde pública

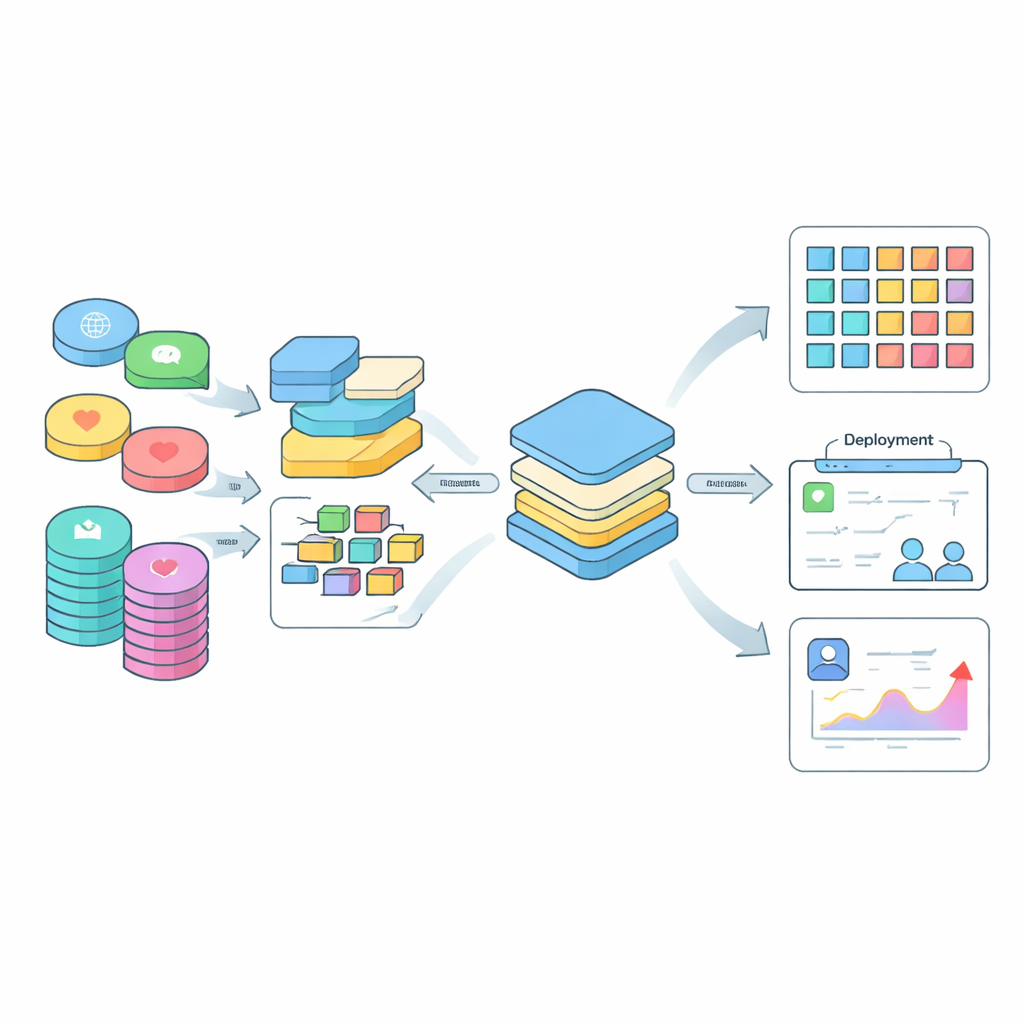

Para enfrentar essa lacuna, os autores criaram o PH-LLM, um conjunto de grandes modelos de linguagem ajustados especificamente para infoveigência em saúde pública. A partir de um modelo base multilíngue poderoso, eles ajustaram seis versões, do leve ao maior, usando quase 600.000 exemplos extraídos de 30 conjuntos de dados de redes sociais e diversos recursos de perguntas e respostas em saúde. Esses exemplos cobriram uma ampla mistura de tópicos, incluindo atitudes em relação às vacinas, hesitação em realizar testes, sinais de saúde mental, discurso de ódio e desinformação sobre COVID-19 e outras questões. Em vez de reescrever cada postagem em inglês, mantiveram as línguas originais e combinaram-nas com templates de instrução traduzidos para 29 idiomas, para que os modelos pudessem lidar naturalmente com conteúdo multilíngue e não inglês.

Submetendo o PH-LLM a um teste rigoroso

Para descobrir quão bem o PH-LLM realmente funciona, a equipe construiu um benchmark exigente com 39 tarefas inéditas extraídas de 10 conjuntos de dados separados em inglês, árabe, chinês e indonésio. Essas tarefas pediam que os modelos fizessem coisas como separar relatos pessoais de notícias, sinalizar discurso de ódio, identificar afirmações falsas sobre curas e detectar mudanças no sentimento em relação às vacinas contra a COVID-19. O PH-LLM teve de responder em um cenário "zero-shot", o que significa que não recebeu treinamento adicional para nenhuma tarefa específica. Os pesquisadores compararam a acurácia do PH-LLM com uma ampla gama de sistemas conhecidos, incluindo modelos open-source como Llama, Mistral, BLOOMZ e Qwen, bem como modelos comerciais como GPT-4o e GPT-4o mini.

Menores, mas mais fortes entre os idiomas

Tanto em tarefas apenas em inglês quanto em tarefas multilíngues, os modelos PH-LLM não apenas se mantiveram competitivos, como frequentemente superaram alternativas de tamanho similar ou mesmo muito maiores. As versões de 14 bilhões e 32 bilhões de parâmetros obtiveram o melhor desempenho geral, superando modelos open-source maiores e até a família comercial GPT-4o em média no benchmark. De forma importante, as pontuações multilíngues mais fortes significam que o PH-LLM pode acompanhar conversas relacionadas à saúde em árabe, chinês, indonésio e outros idiomas frequentemente negligenciados. Como o PH-LLM alcança esse nível de precisão com menos parâmetros que muitos concorrentes, ele pode rodar em hardware de computação mais modesto, reduzindo custos para agências de saúde, especialmente em países de renda baixa e média.

De sinais online a decisões no mundo real

Os autores imaginam o PH-LLM como uma ferramenta prática que profissionais de saúde pública não técnicos podem usar por meio de interfaces simples. Quando combinado com informações sobre tempo, local e condições locais, as classificações do PH-LLM podem revelar onde as dúvidas sobre vacinas estão aumentando, quais comunidades são alvo de discurso de ódio ou quando rumores perigosos começam a se espalhar. Embora os modelos ainda tenham limites—como desempenho desigual em tarefas muito difíceis ou desequilibradas e possíveis vieses herdados dos dados das redes sociais—eles representam um passo importante rumo ao monitoramento multilíngue e em tempo real das conversas sobre saúde pública. Em termos simples, o PH-LLM transforma o fluxo barulhento das redes sociais em sinais mais claros que podem ajudar autoridades a agir mais rápido e com mais justiça, tanto em campanhas rotineiras quanto em futuras pandemias.

Citação: Zhou, X., Zhou, J., Wang, C. et al. A suite of large language models for public health infoveillance. npj Digit. Med. 9, 270 (2026). https://doi.org/10.1038/s41746-026-02435-6

Palavras-chave: vigilância em saúde pública, desinformação nas redes sociais, hesitação vacinal, IA multilíngue, grandes modelos de linguagem