Clear Sky Science · zh

BGC-LiteNet:嵌入北斗网格编码的轻量级神经架构,用于无人机实时火情检测与定位

从高空守望林海

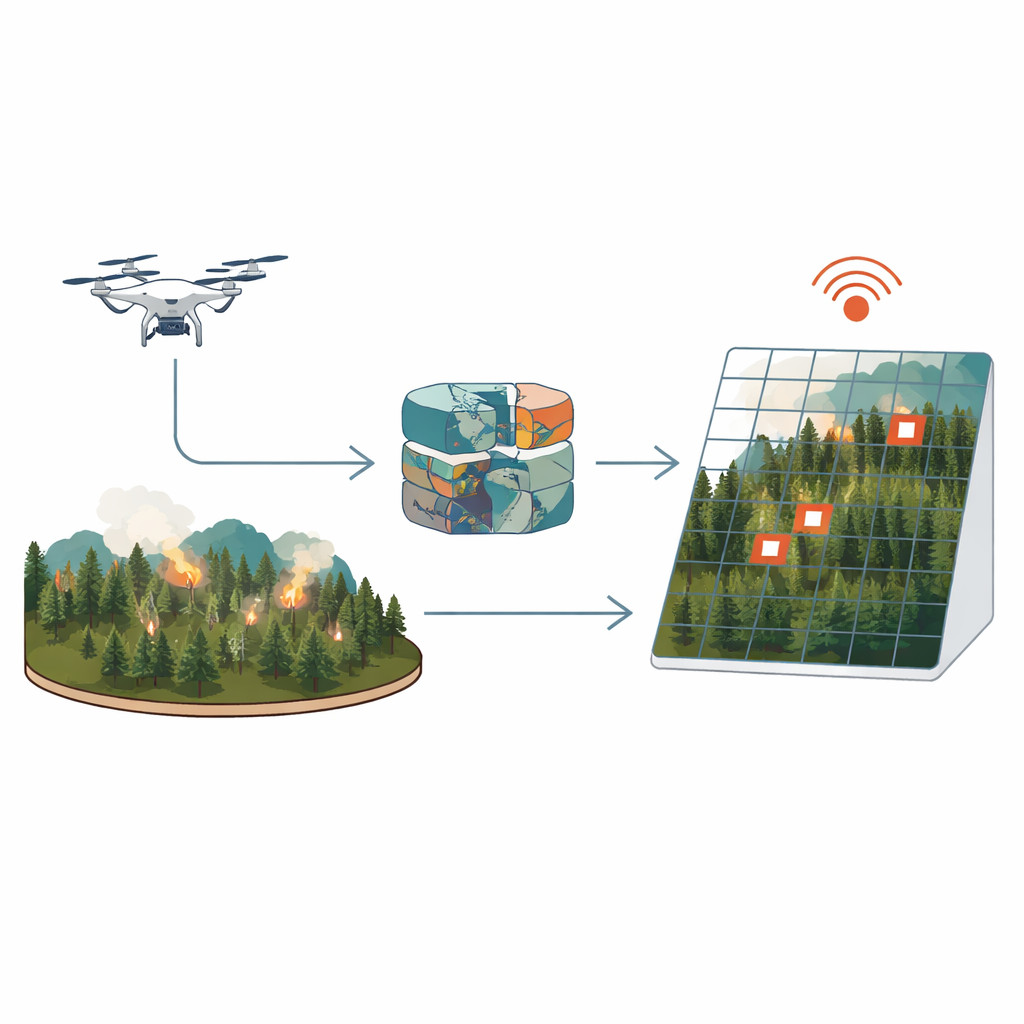

森林火灾可以在几分钟内由一簇小火星演变成灾难。配备热成像相机的无人机有望尽早发现这些火情,但现有系统面临艰难的权衡:运行快速且轻量的软件通常会漏检微小、初期的火苗,而更重、更精确的程序在紧急情况下响应太慢。本文提出了一种称为 BGC‑LiteNet 的新方法,旨在同时兼顾两者——在算力有限的机载计算平台上快速检测小火并几乎实时地将其定位到地图上。

为何早期火情难以检测

早期阶段的森林火在无人机影像中往往只表现为几个发光像素,常被烟雾、光线昏暗或复杂地形遮掩。依赖简单阈值或手工图像特征的传统方法虽然速度快,但容易被其它热源或变化的环境条件误导。较新的深度学习系统在识别火情方面更可靠,但通常只给出图像内的位置,而非实际地图坐标。将这些位置转换为真实世界坐标需要额外步骤,涉及相机几何、卫星定位和在线地图服务。每增加一步都会消耗时间——数百毫秒或更多——且依赖可靠通信,而在偏远山区这些通信往往无法保证。

把地图放进神经网络

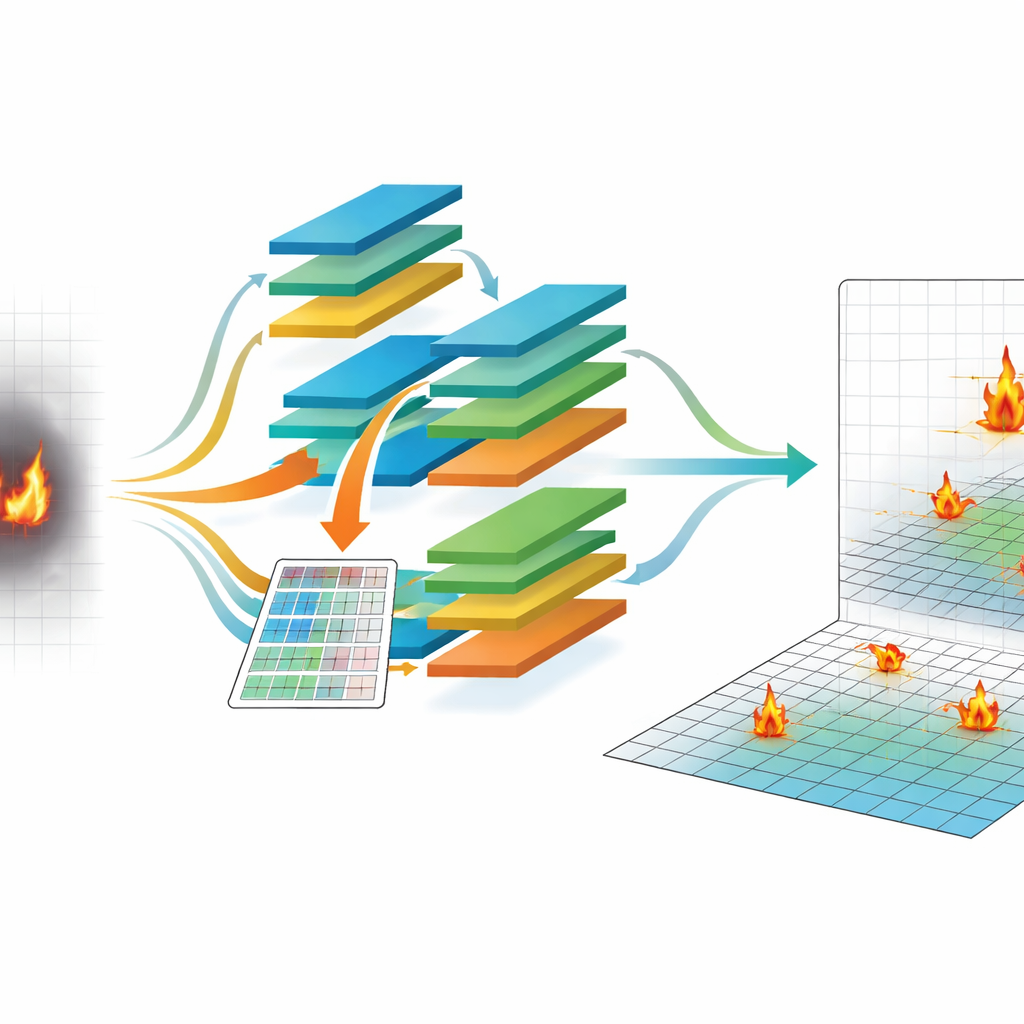

BGC‑LiteNet 不把制图当作事后的补充,而是将地理信息直接融入检测过程。它使用中国的北斗网格编码(BGC),这一国家标准将地球划分为大约 100 米见方的规则网格。对于无人机红外图像中的每个像素,系统计算其对应地面上的哪一个网格单元,并构建匹配的网格地图。然后将该网格地图转化为一组可学习的数值编码,与图像一起送入神经网络。实际上,每个像素既带有视觉线索,又带有地理提示,使模型能够学习火情可能出现的位置,并直接输出标准化的网格标识,而无需调用外部地图服务。

设计一个反应迅速的大脑

将地理信息嵌入只是其中一半;另一半是让它在小型机载计算机上高速运行。作者使用了一种称为神经架构搜索的技术,该技术自动测试多种可能的网络设计,以找到在精度与速度之间的平衡。他们测量了基本构件——例如紧凑卷积和注意力模块——在嵌入式设备上的运行时长,并以此引导搜索,使得运行缓慢的组合受到抑制。最终的 BGC‑LiteNet 设计参数量不到一百万,广泛采用高效卷积并剪除不必要的路径,导致在无人机搭载的 NVIDIA Jetson Xavier NX 模块上以标准分辨率处理一张图像的平均时间约为 38 毫秒。

将系统投入实地检验

为了评估该方法在现实世界中的效果,团队构建了一个近 13,000 张无人机图片的数据集,覆盖中国若干省份的山地、平原、林缘和混合地形。每张图像都配有高精度的无人机位置信息和与北斗网格单元关联的火情标注。在这组包含白天、夜晚、有烟和晴朗等多样场景的数据上,BGC‑LiteNet 的检测平均精度约为 89%,在 50 米范围内的地理定位准确率超过 92%。相比传统方法和流行的紧凑深度学习模型,它在火情微小、光线弱或烟雾浓重时表现尤为出色。该系统在不同图像尺寸间也具有良好伸缩性,即使在更高分辨率下仍保持响应性。

从单架无人机到协同灭火网络

在多架无人机与地面队伍协同作业时,准确且标准化的位置十分关键。由于 BGC‑LiteNet 直接输出国家网格系统中的位置,不同无人机自然“说同一种语言”,减少了报告位置时的分歧。模拟多机巡逻的测试显示,其对同一火情的定位估计聚集得更紧密,明显优于依赖各平台独立制图步骤的方法。研究者还展示了该系统在光照、浓烟、降雨和雾霾等挑战环境下仍能工作,并且可以快速转换为现有地图工具使用的标准 GPS 风格坐标。

这对灭火工作的意义

BGC‑LiteNet 证明了可以通过将制图作为智能的一部分而非附加功能,构建出既快速又精确的无人机火情检测系统。通过将国家网格参考直接嵌入神经网络并自动为低功耗硬件设计模型,作者实现了能将应急人员引导至新火点几十米范围内的快速、准确的火情警报。除了森林火灾外,这一理念——教会神经网络理解“在哪里”与“是什么”——也可应用于野生动物调查、灾损评估和精准农业等其他任务。

引用: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

关键词: 无人机火情检测, 地理空间深度学习, 边缘人工智能, 北斗网格编码, 实时定位