Clear Sky Science · fr

BGC-LiteNet : architecture neuronale légère intégrant le code grille BeiDou pour la détection et la localisation en temps réel des incendies par UAV

Surveiller la forêt depuis le ciel

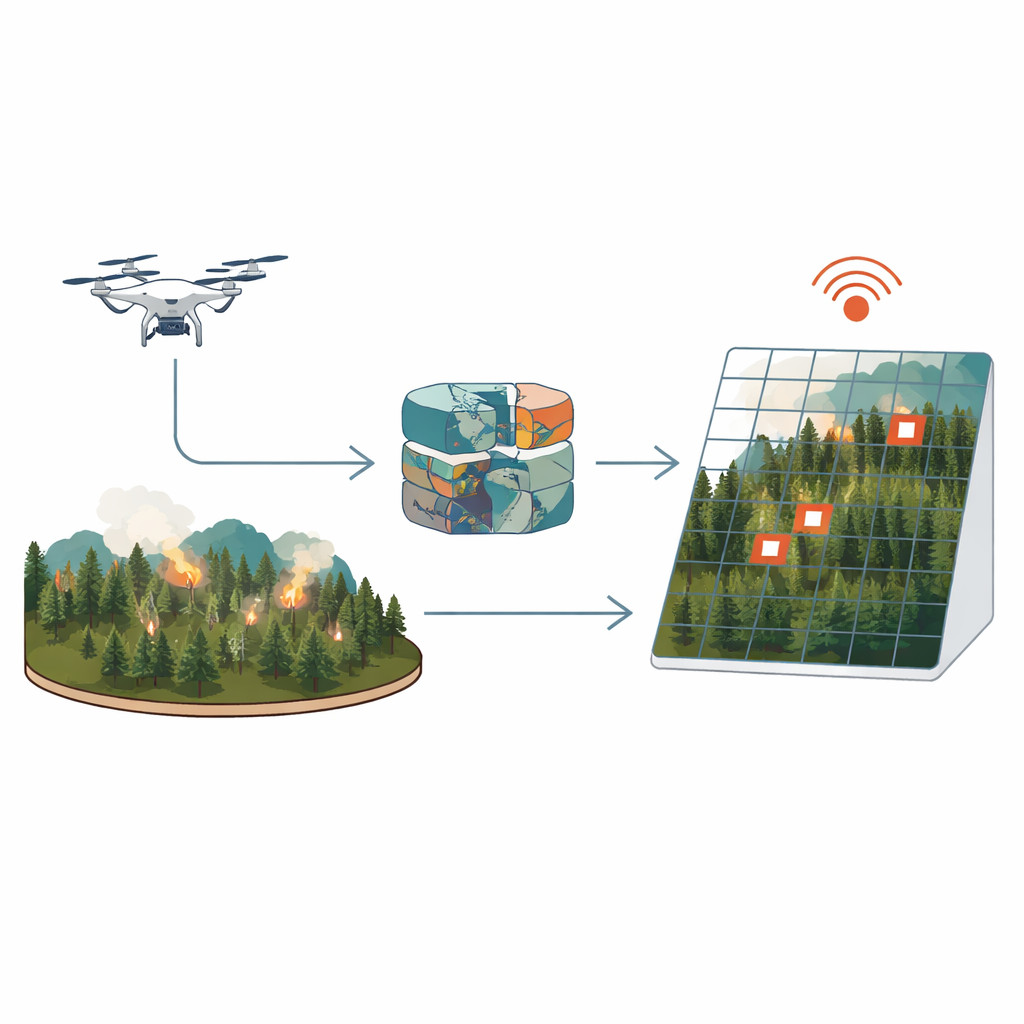

Un feu de forêt peut passer d’une petite étincelle à une catastrophe en quelques minutes. Les drones équipés de caméras thermiques promettent de détecter ces départs de feu précocement, mais les systèmes actuels sont confrontés à un compromis difficile : les logiciels rapides et légers manquent souvent les flammes minuscules des débuts, tandis que les programmes plus lourds et plus précis réagissent trop lentement pour être utiles en situation d’urgence. Cet article présente une nouvelle approche, nommée BGC‑LiteNet, qui vise à faire les deux : détecter rapidement les petits foyers et en indiquer la position sur une carte en quasi‑temps réel, même sur des ordinateurs de bord modestes.

Pourquoi la détection précoce d’un incendie est si difficile

Au stade initial, les incendies de forêt apparaissent sur les images de drone comme quelques pixels brillants, souvent masqués par la fumée, une faible luminosité ou un terrain encombré. Les méthodes traditionnelles, fondées sur des seuils simples ou des caractéristiques d’image conçues manuellement, sont rapides mais facilement trompées par d’autres sources de chaleur et les variations de conditions. Les systèmes récents d’apprentissage profond reconnaissent mieux les feux, mais fournissent généralement seulement des positions dans l’image, pas des coordonnées cartographiques réelles. La conversion de ces positions en lieux réels exige des étapes supplémentaires impliquant la géométrie de la caméra, le positionnement satellite et des services de cartographie en ligne. Chaque étape additionnelle coûte du temps — des centaines de millisecondes ou plus — et dépend de communications fiables, souvent indisponibles en zones montagneuses isolées.

Intégrer la carte directement dans le réseau neuronal

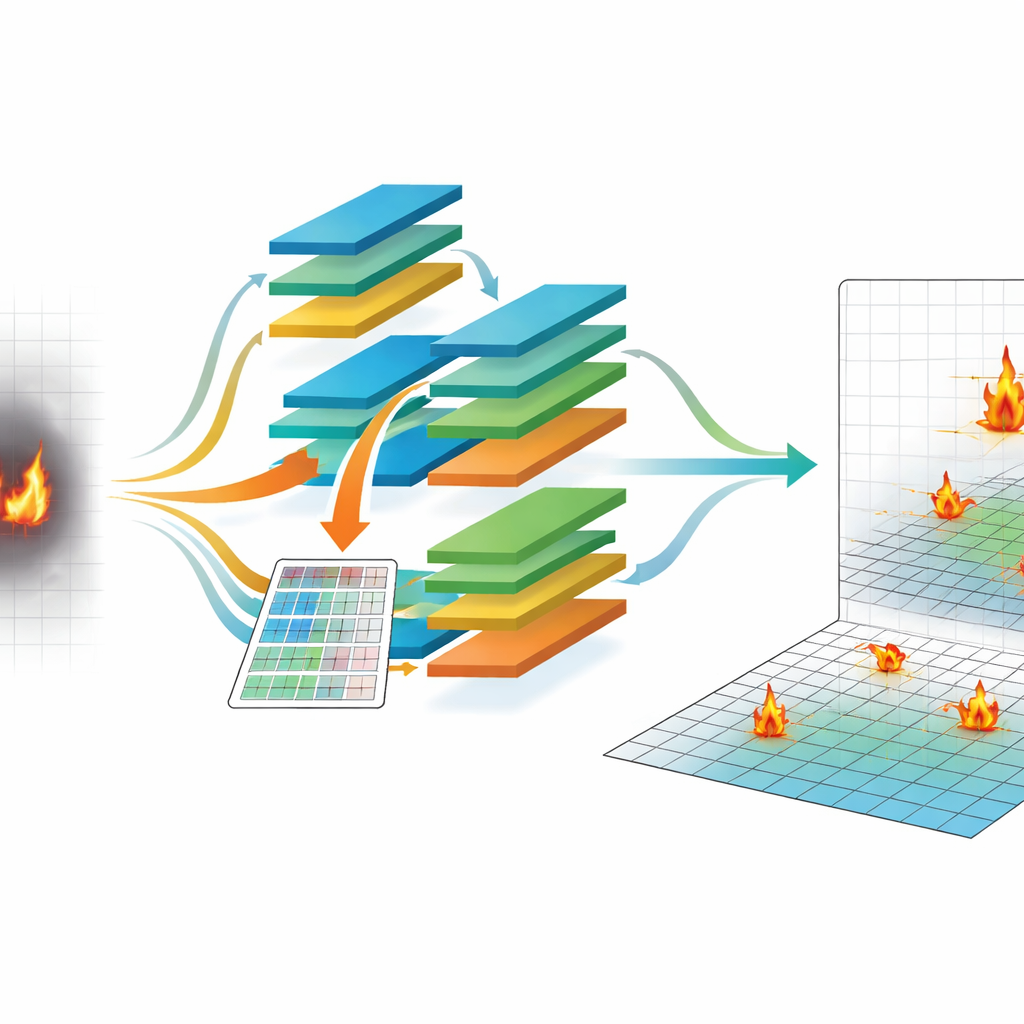

Plutôt que de considérer la cartographie comme un ajout, BGC‑LiteNet incorpore la géographie directement au processus de détection. Il utilise le Code Grille BeiDou (BGC) — une norme nationale qui divise la Terre en une grille régulière de cellules d’environ 100 mètres de côté. Pour chaque pixel d’une image infrarouge de drone, le système calcule à quelle cellule de la grille au sol il correspond et construit une carte en grille correspondante. Cette carte en grille est ensuite convertie en un ensemble de codes numériques apprenables qui accompagnent l’image à l’intérieur du réseau neuronal. En pratique, chaque pixel est doté à la fois d’un indice visuel et d’un indice géographique, ce qui permet au modèle d’apprendre où les incendies sont susceptibles d’apparaître et de produire directement des identifiants de grille standardisés, sans recourir à des services de cartographie externes.

Concevoir un « cerveau » qui raisonne vite

L’intégration de la géographie n’est qu’une partie du problème ; l’autre est de faire tourner le système rapidement sur un petit ordinateur de bord. Les auteurs utilisent une technique appelée recherche d’architecture neuronale (neural architecture search), qui teste automatiquement de nombreux designs de réseau possibles pour trouver un compromis entre précision et rapidité. Ils mesurent le temps d’exécution des blocs de base — comme des convolutions compactes et des modules d’attention — sur un dispositif embarqué, puis orientent la recherche de sorte que les combinaisons lentes soient défavorisées. Le design final de BGC‑LiteNet comporte moins d’un million de paramètres, s’appuie fortement sur des convolutions efficaces et émonde les chemins inutiles, conduisant à un temps de traitement moyen d’environ 38 millisecondes par image en résolution standard sur un module NVIDIA Jetson Xavier NX embarqué sur le drone.

Évaluer le système sur le terrain

Pour vérifier l’efficacité de l’approche en conditions réelles, l’équipe a constitué un jeu de données de près de 13 000 images de drone collectées au-dessus de montagnes, plaines, lisières de forêt et terrains mixtes dans plusieurs provinces chinoises. Chaque image est associée à des données de position de drone très précises et à des annotations d’incendie liées à des cellules de la grille BeiDou. Sur cette collection diverse de scènes diurnes, nocturnes, enfumées ou claires, BGC‑LiteNet détecte les incendies avec environ 89 % de moyenne de précision (mAP) et atteint plus de 92 % d’exactitude pour les localiser à l’intérieur d’un rayon de 50 m. Il surpasse à la fois les méthodes traditionnelles et les modèles compacts d’apprentissage profond populaires, notamment lorsque les feux sont petits, la lumière faible ou la fumée dense. Le système s’adapte également bien à différentes tailles d’images et reste réactif même à des résolutions plus élevées.

Du drone isolé aux réseaux anti‑incendie

Des positions précises et standardisées sont cruciales lorsque plusieurs drones et équipes au sol doivent coopérer. Parce que BGC‑LiteNet fournit directement des emplacements dans un système de grille national, différents drones « parlent la même langue », ce qui réduit les divergences dans les positions rapportées. Des tests de patrouilles multi‑drones simulées montrent que ses estimations de position pour un même feu sont fortement regroupées, bien plus que pour des méthodes qui effectuent des étapes de cartographie séparées pour chaque plateforme. Les chercheurs montrent aussi que le système reste opérationnel sous des éclairages difficiles, fumée, pluie et brouillard, et qu’il peut être rapidement converti en coordonnées de type GPS pour les outils de cartographie existants.

Quelles implications pour la lutte contre les incendies

BGC‑LiteNet démontre qu’il est possible de concevoir un système de détection d’incendie par drone à la fois rapide et précis en traitant la cartographie comme partie intégrante de l’intelligence plutôt que comme un complément. En intégrant une référence de grille nationale directement dans le réseau neuronal et en concevant automatiquement le modèle pour du matériel basse consommation, les auteurs obtiennent des alertes rapides et fiables qui peuvent guider les intervenants à quelques dizaines de mètres d’un nouveau foyer. Au‑delà des feux de forêt, la même idée — apprendre aux réseaux neuronaux à comprendre où en plus de quoi — pourrait être utile pour d’autres tâches comme les inventaires faunistiques, l’évaluation des catastrophes et l’agriculture de précision.

Citation: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

Mots-clés: détection d’incendie par UAV, apprentissage profond géospatial, IA embarquée, Code grille BeiDou, localisation en temps réel