Clear Sky Science · de

BGC-LiteNet: BeiDou-Gittercode eingebettete leichte neuronale Architektur zur Echtzeit-Erkennung und Lokalisierung von Bränden mit UAVs

Den Wald von oben beobachten

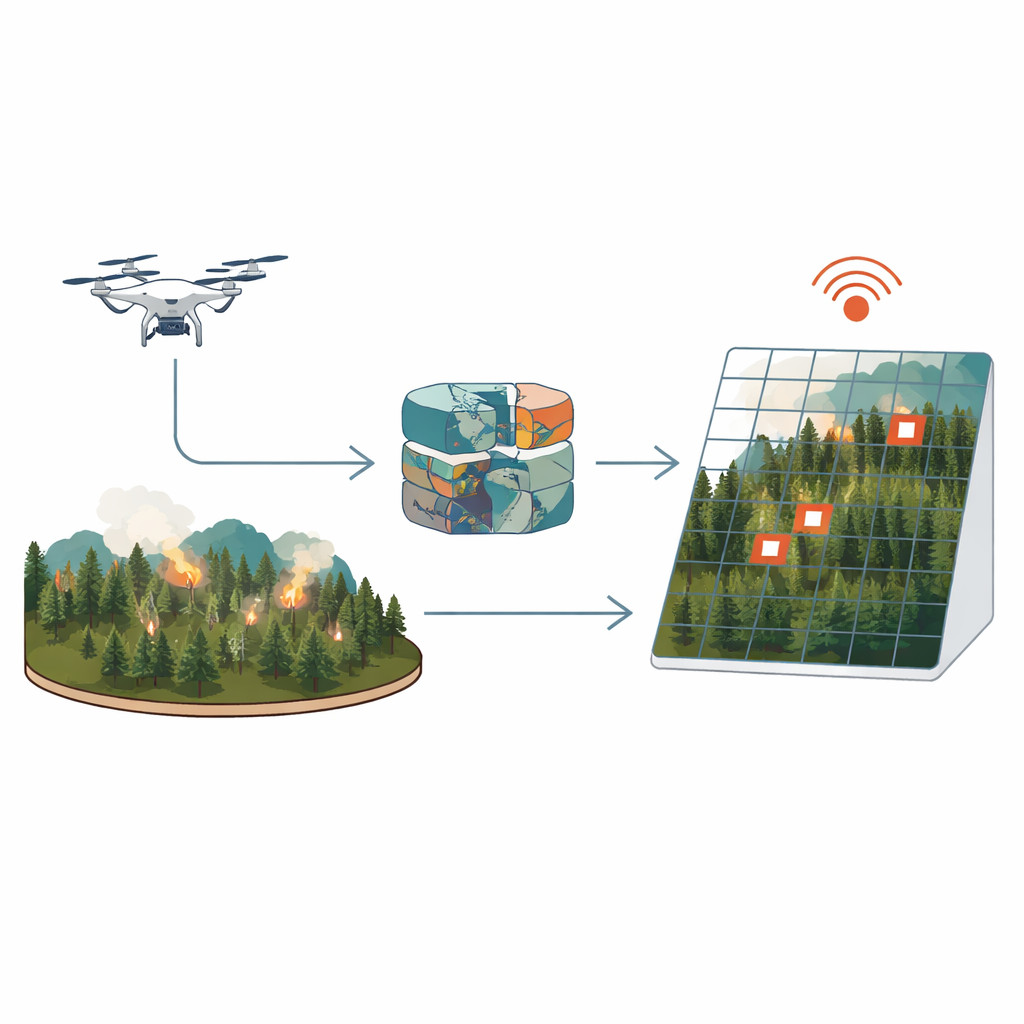

Waldbrände können sich innerhalb von Minuten aus einem kleinen Funken zu einer Katastrophe entwickeln. Drohnen mit wärmesensitiven Kameras versprechen, solche Brände früh zu entdecken, doch heutige Systeme stehen vor einem schwierigen Kompromiss: Schnelle, ressourcenschonende Software verpasst oft winzige, frühe Flammen, während schwerere, genauere Programme im Notfall zu langsam reagieren. Dieses Papier stellt einen neuen Ansatz namens BGC‑LiteNet vor, der beides zugleich erreichen will — kleine Brände schnell erkennen und ihre Positionen nahezu in Echtzeit auf einer Karte bestimmen, selbst auf bescheidenen Bordcomputern.

Warum Früherkennung so schwierig ist

Brände in einem frühen Stadium erscheinen in Drohnenbildern oft nur als wenige leuchtende Pixel, die zudem durch Rauch, schwaches Licht oder unruhiges Gelände verdeckt werden. Traditionelle Verfahren, die auf einfachen Schwellenwerten oder handgemachten Bildmerkmalen basieren, sind schnell, lassen sich aber leicht von anderen Wärmequellen und veränderten Bedingungen täuschen. Neuere Deep‑Learning‑Systeme erkennen Brände besser, liefern jedoch meist nur Bildkoordinaten, keine echten Kartenpositionen. Die Umwandlung dieser Bildpositionen in realweltliche Orte erfordert zusätzliche Schritte mit Kamerageometrie, Satellitenpositionierung und Online‑Kartendiensten. Jeder zusätzliche Schritt kostet Zeit — hunderte Millisekunden oder mehr — und ist von zuverlässiger Kommunikation abhängig, die in abgelegenen Bergen oft nicht verfügbar ist.

Die Karte in das neuronale Netz einbauen

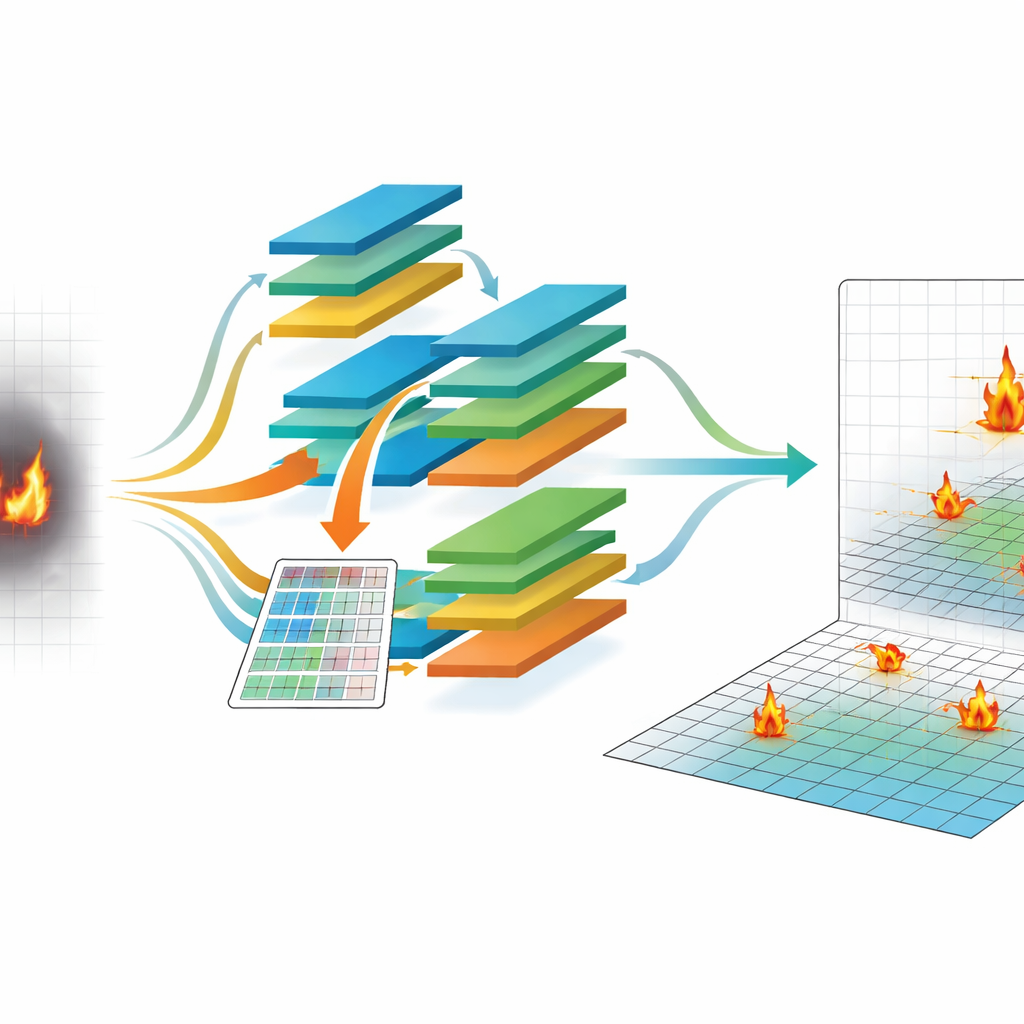

Statt Kartierung als Nachgedanken zu behandeln, integriert BGC‑LiteNet die Geografie direkt in den Erkennungsprozess. Es nutzt den chinesischen BeiDou-Gittercode (BGC), einen nationalen Standard, der die Erde in ein regelmäßiges Gitter von Zellen von etwa 100 Metern Kantenlänge unterteilt. Für jedes Pixel in einem Infrarotbild der Drohne berechnet das System, welcher Gitterzelle am Boden es entspricht, und erzeugt eine entsprechende Gitterkarte. Diese Gitterkarte wird dann in eine Reihe lernbarer numerischer Codes verwandelt, die zusammen mit dem Bild in das neuronale Netz eingespeist werden. Effektiv hat jedes Pixel sowohl einen visuellen Hinweis als auch einen geografischen Hinweis, wodurch das Modell lernen kann, wo Brände wahrscheinlich auftreten, und standardisierte Gitterkennungen direkt ausgeben kann, ohne externe Kartendienste aufzurufen.

Ein schnelles „Gehirn“ entwerfen

Die Einbettung der Geografie ist nur die halbe Geschichte; der zweite Teil besteht darin, das System schnell auf einem kleinen Bordcomputer laufen zu lassen. Die Autoren verwenden eine Technik namens Neural Architecture Search, die automatisch viele mögliche Netzwerkdesigns testet, um solche zu finden, die Genauigkeit und Geschwindigkeit ausbalancieren. Sie messen, wie lange grundlegende Bausteine — etwa kompakte Faltungen und Attention‑Module — auf einem eingebetteten Gerät benötigen, und steuern die Suche so, dass langsame Kombinationen benachteiligt werden. Das finale BGC‑LiteNet‑Design kommt mit unter einer Million Parametern aus, setzt stark auf effiziente Faltungen und kürzt unnötige Pfade, was zu einer durchschnittlichen Verarbeitungszeit von etwa 38 Millisekunden pro Bild in Standardauflösung auf einem NVIDIA Jetson Xavier NX Modul an einer Drohne führt.

Das System auf die Probe stellen

Um zu prüfen, ob dieser Ansatz in der Praxis funktioniert, hat das Team einen Datensatz von fast 13.000 Drohnenbildern aufgebaut, die über Berge, Ebenen, Waldränder und gemischtes Gelände in mehreren chinesischen Provinzen aufgenommen wurden. Jedes Bild ist mit hochgenauen Drohnenpositionsdaten und Brandannotationen verknüpft, die auf BeiDou‑Gitterzellen bezogen sind. Über diese vielfältige Sammlung von Tag-, Nacht-, Rauch‑ und klaren Szenen hinweg erkennt BGC‑LiteNet Brände mit etwa 89 Prozent mittlerer durchschnittlicher Präzision und erreicht mehr als 92 Prozent Genauigkeit bei der Geolokalisierung innerhalb von 50 Metern. Es übertrifft sowohl traditionelle Methoden als auch gängige kompakte Deep‑Learning‑Modelle, insbesondere wenn Brände klein sind, das Licht schwach ist oder dichter Rauch vorhanden ist. Das System skaliert zudem gut über verschiedene Bildgrößen und bleibt auch bei höheren Auflösungen reaktionsschnell.

Von einzelnen Drohnen zu Einsatznetzwerken

Genau standardisierte Positionen sind entscheidend, wenn mehrere Drohnen und Bodenmannschaften zusammenarbeiten müssen. Weil BGC‑LiteNet Orte direkt in einem nationalen Gittersystem ausgibt, „sprechen“ verschiedene Drohnen automatisch dieselbe Sprache, was Unstimmigkeiten bei gemeldeten Positionen reduziert. Tests mit simulierten Multi‑Drohnen‑Patrouillen zeigen, dass die Lageabschätzungen für denselben Brand eng beieinanderliegen, deutlich mehr als bei Methoden, die für jede Plattform separate Kartierungsschritte verwenden. Die Forschenden zeigen außerdem, dass das System unter herausfordernden Bedingungen wie schlechtem Licht, Rauch, Regen und Nebel weiter funktioniert und schnell in standardisierte GPS‑ähnliche Koordinaten für bestehende Kartenwerkzeuge umgewandelt werden kann.

Was das für die Brandbekämpfung bedeutet

BGC‑LiteNet demonstriert, dass sich ein drohnenbasiertes Branderkennungssystem bauen lässt, das sowohl schnell als auch präzise ist, indem Kartierung Teil der Intelligenz und nicht nur ein Zusatz wird. Durch die direkte Einbettung einer nationalen Gitterreferenz in das neuronale Netz und die automatische Auslegung des Modells für energieeffiziente Hardware erzielen die Autoren schnelle, genaue Brandmeldungen, die Einsatzkräfte auf wenige Dutzend Meter an einen neuen Brand heranführen können. Über Waldbrände hinaus könnte dieselbe Idee — neuronalen Netzen beizubringen, wo genauso wie was — auch in anderen Aufgaben helfen, etwa bei Tierbeständen, Schadensbewertungen nach Katastrophen und präziser Landwirtschaft.

Zitation: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

Schlüsselwörter: UAV-Branderkennung, georäumliches Deep Learning, Edge-AI, BeiDou-Gittercode, Echtzeit-Lokalisierung