Clear Sky Science · pt

BGC-LiteNet: arquitetura neural leve incorporando BeiDou Grid Code para detecção e localização em tempo real de incêndios por UAV

Observando a floresta de cima

Incêndios florestais podem se transformar de uma pequena faísca em um desastre em minutos. Drones equipados com câmeras sensíveis ao calor prometem identificar esses focos precocemente, mas os sistemas atuais enfrentam um difícil compromisso: softwares rápidos e leves costumam perder chamas pequenas e iniciais, enquanto programas mais pesados e precisos respondem lentamente demais para serem úteis numa emergência. Este artigo apresenta uma nova abordagem chamada BGC‑LiteNet, que busca conciliar ambos—detectar incêndios pequenos rapidamente e localizar suas posições no mapa quase em tempo real, mesmo em computadores de bordo modestos.

Por que detectar incêndios cedo é tão difícil

Incêndios em estágio inicial aparecem nas imagens dos drones como apenas alguns pixels luminosos, frequentemente ocultos por fumaça, pouca iluminação ou terreno confuso. Métodos tradicionais que dependem de limiares simples ou de características de imagem manuais são rápidos, mas facilmente enganam-se com outras fontes de calor e condições variáveis. Sistemas mais recentes de aprendizado profundo são melhores em reconhecer incêndios, mas normalmente retornam apenas posições na imagem, não coordenadas reais no mapa. Converter essas posições em localizações do mundo real exige etapas adicionais envolvendo geometria da câmera, posicionamento por satélite e serviços de mapeamento online. Cada etapa adicionada consome tempo—centenas de milissegundos ou mais—e depende de comunicações confiáveis, que muitas vezes não existem em regiões montanhosas remotas.

Colocando o mapa dentro da rede neural

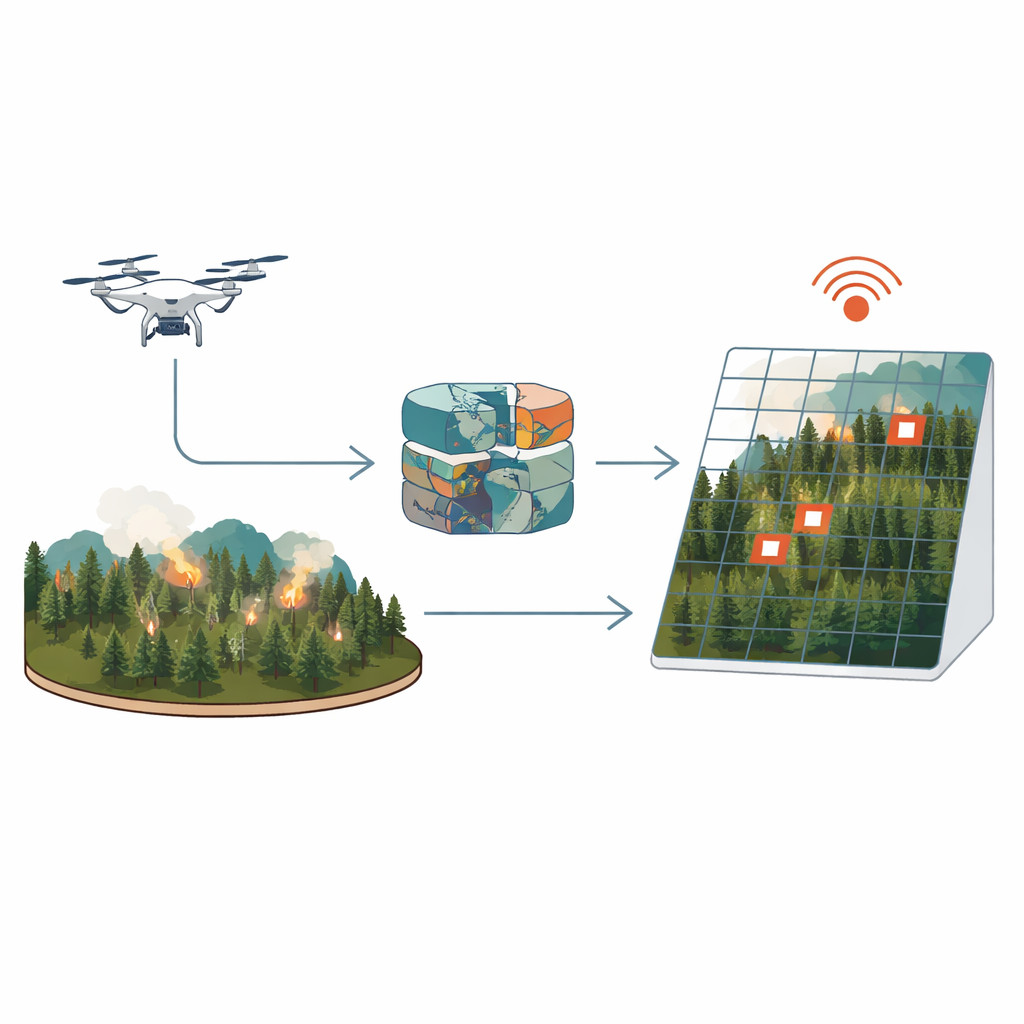

Em vez de tratar o mapeamento como um complemento, o BGC‑LiteNet incorpora a geografia diretamente no processo de detecção. Ele usa o BeiDou Grid Code (BGC), um padrão nacional que divide a Terra em uma grade regular de células de cerca de 100 metros. Para cada pixel na imagem infravermelha do drone, o sistema calcula a qual célula da grade no solo ele corresponde e constrói um mapa de grade correspondente. Esse mapa de grade é então transformado em um conjunto de códigos numéricos aprendíveis que entram na rede neural junto com a própria imagem. Na prática, cada pixel vem com uma pista visual e uma dica geográfica, permitindo que o modelo aprenda onde é mais provável que ocorram incêndios e produza identificadores de grade padronizados diretamente, sem chamar serviços de mapeamento externos.

Projetando um cérebro que pensa rápido

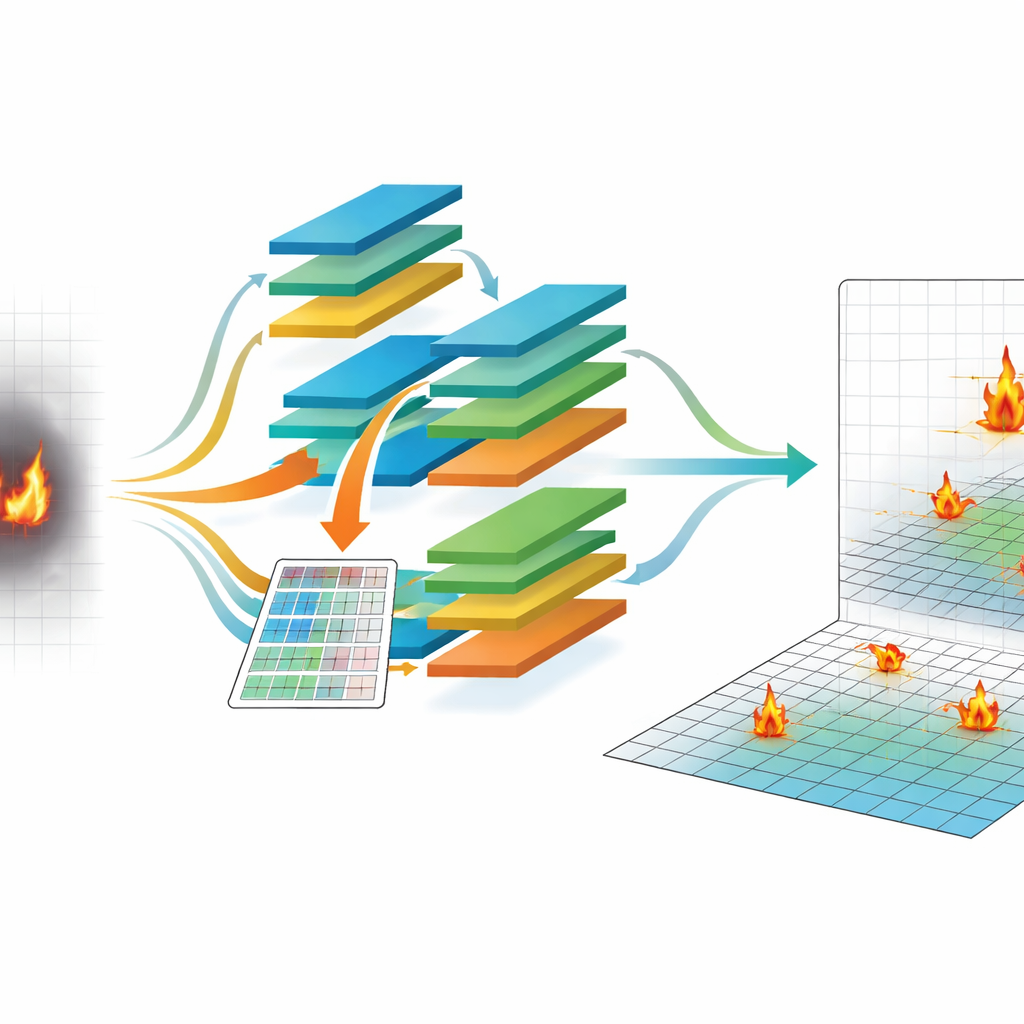

Incorporar a geografia é apenas metade da história; a outra metade é fazê‑lo rodar rapidamente em um pequeno computador de bordo. Os autores usam uma técnica chamada busca de arquitetura neural, que testa automaticamente muitos designs de rede possíveis para encontrar aqueles que equilibram precisão e velocidade. Eles medem quanto tempo blocos básicos—como convoluções compactas e módulos de atenção—levam para rodar em um dispositivo embarcado, e então orientam a busca para desencorajar combinações lentas. O desenho final do BGC‑LiteNet usa menos de um milhão de parâmetros, baseia‑se fortemente em convoluções eficientes e poda caminhos desnecessários, resultando em um tempo médio de processamento de cerca de 38 milissegundos por imagem em resolução padrão em um módulo NVIDIA Jetson Xavier NX transportado por um drone.

Colocando o sistema à prova

Para verificar se essa abordagem funciona no mundo real, a equipe construiu um conjunto de dados de quase 13.000 imagens de drone coletadas sobre montanhas, planícies, bordas de florestas e terrenos mistos em várias províncias chinesas. Cada imagem está emparelhada com dados de posição do drone altamente precisos e anotações de incêndio vinculadas a células da grade BeiDou. Ao longo dessa coleção diversa de cenas diurnas, noturnas, com fumaça e claras, o BGC‑LiteNet detecta incêndios com cerca de 89% de média de precisão (mAP) e alcança mais de 92% de acurácia ao geolocalizá‑los dentro de 50 metros. Ele supera tanto métodos tradicionais quanto modelos compactos populares de aprendizado profundo, especialmente quando os incêndios são pequenos, a iluminação é fraca ou a fumaça é densa. O sistema também escala bem para diferentes tamanhos de imagem e mantém responsividade mesmo em resoluções mais altas.

De drones individuais a redes de combate a incêndios

Localizações precisas e padronizadas são cruciais quando múltiplos drones e equipes terrestres precisam trabalhar juntos. Como o BGC‑LiteNet gera localizações diretamente em um sistema de grade nacional, diferentes drones automaticamente “falam a mesma língua”, reduzindo divergências nas posições relatadas. Testes com patrulhas simuladas de múltiplos drones mostram que suas estimativas de localização para o mesmo incêndio ficam estreitamente agrupadas, muito mais do que em métodos que dependem de etapas de mapeamento separadas para cada plataforma. Os pesquisadores também demonstram que o sistema continua funcionando sob iluminação desafiadora, fumaça, chuva e neblina, e pode ser convertido rapidamente para coordenadas no estilo GPS para ferramentas de mapeamento existentes.

O que isso significa para o combate a incêndios

O BGC‑LiteNet demonstra que é possível construir um sistema de detecção de incêndios por drone que seja rápido e preciso ao tratar o mapeamento como parte da inteligência em vez de um acessório. Ao incorporar uma referência de grade nacional diretamente na rede neural e projetar automaticamente o modelo para hardware de baixo consumo, os autores alcançam alertas rápidos e precisos que podem guiar os respondentes a dezenas de metros de um novo foco. Além de incêndios florestais, a mesma ideia—ensinar redes neurais a entender onde, além do que—poderia ajudar em outras tarefas, como levantamentos de vida selvagem, avaliação de desastres e agricultura de precisão.

Citação: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

Palavras-chave: detecção de incêndio por UAV, aprendizado profundo geoespacial, IA de borda, BeiDou Grid Code, localização em tempo real