Clear Sky Science · it

BGC-LiteNet: architettura neurale leggera con codice griglia BeiDou incorporato per il rilevamento e la localizzazione in tempo reale degli incendi con UAV

Osservare il bosco dall’alto

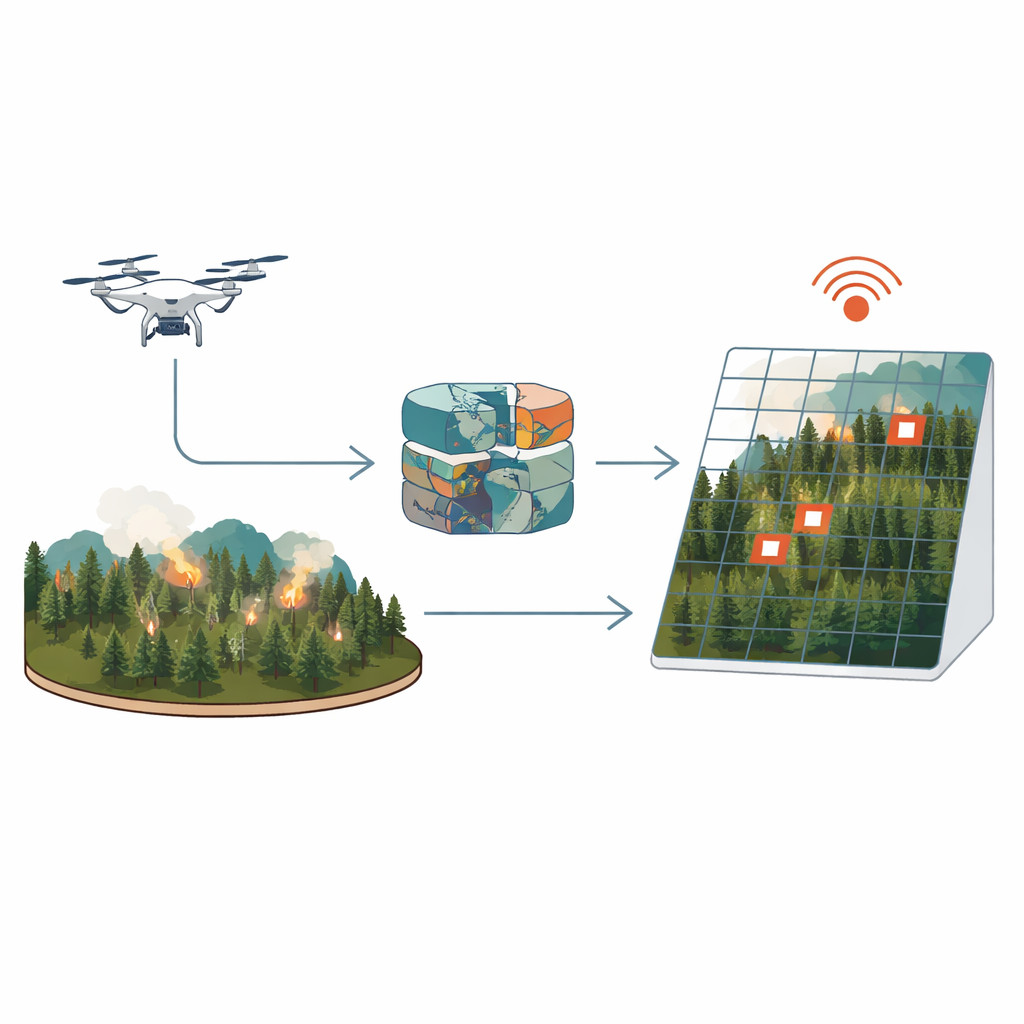

Gli incendi boschivi possono trasformarsi da una piccola scintilla a una catastrofe in pochi minuti. I droni dotati di telecamere sensibili al calore promettono di individuare questi incendi nelle fasi iniziali, ma i sistemi attuali affrontano un difficile compromesso: il software veloce e leggero normalmente non rileva fiamme piccole e precoci, mentre programmi più pesanti e accurati rispondono troppo lentamente per essere utili in emergenza. Questo articolo presenta un nuovo approccio chiamato BGC‑LiteNet che mira a fare entrambe le cose: rilevare piccoli incendi rapidamente e individuare la loro posizione su una mappa quasi in tempo reale, anche su computer di bordo modesti.

Perché è così difficile rilevare un incendio precoce

Gli incendi nelle fasi iniziali appaiono nelle immagini dei droni come poche gocce luminose, spesso nascoste da fumo, luce fioca o terreno ingombrato. I metodi tradizionali che si basano su semplici soglie o caratteristiche dell’immagine progettate a mano sono rapidi ma facilmente ingannati da altre sorgenti di calore e da condizioni variabili. I sistemi di deep learning più recenti riconoscono meglio gli incendi, ma di solito forniscono solo posizioni nell’immagine, non coordinate reali sulla mappa. Convertire quelle posizioni in localizzazioni nel mondo reale richiede passaggi aggiuntivi che coinvolgono la geometria della camera, il posizionamento satellitare e servizi di mappatura online. Ogni passaggio aggiunto costa tempo—centinaia di millisecondi o più—e dipende da comunicazioni affidabili, spesso non disponibili in montagne remote.

Mettere la mappa dentro la rete neurale

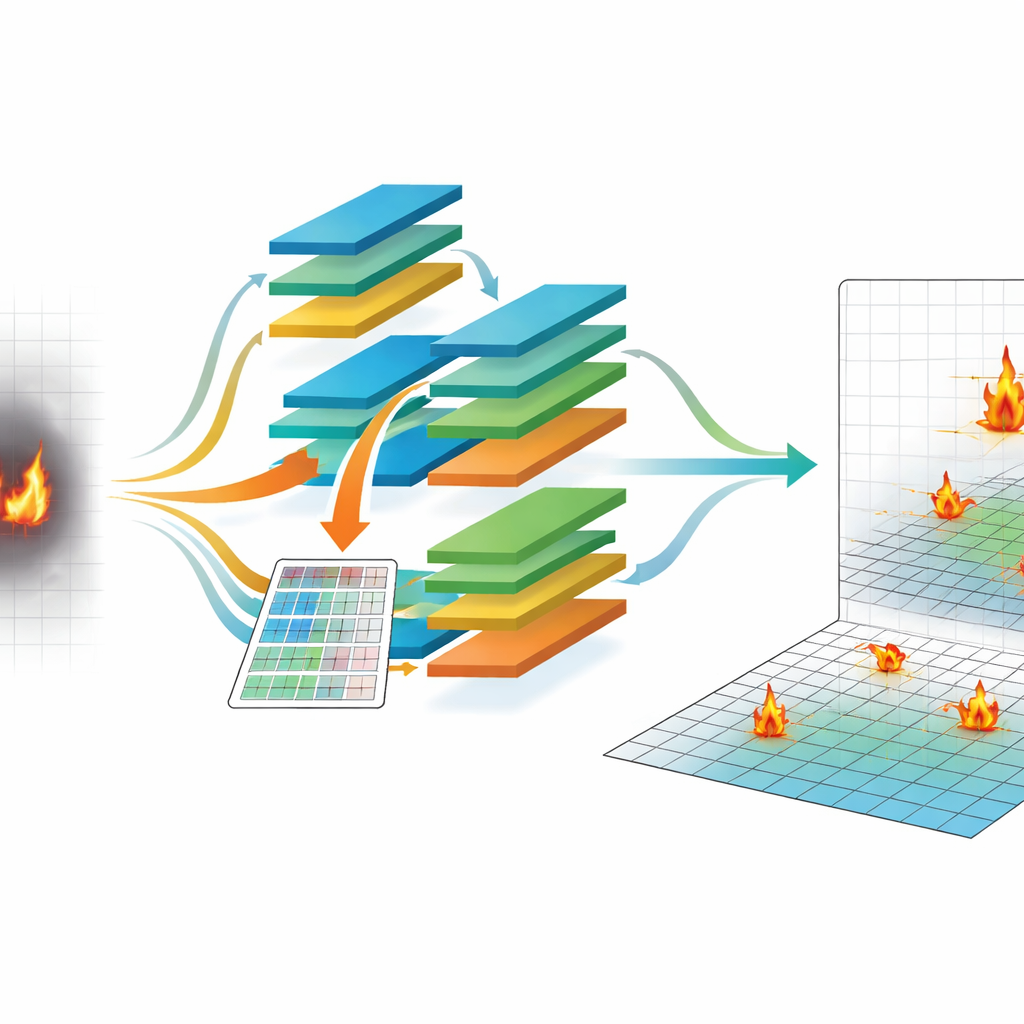

Invece di considerare la mappatura un ripensamento, BGC‑LiteNet incorpora la geografia direttamente nel processo di rilevamento. Usa il BeiDou Grid Code (BGC), uno standard nazionale che divide la Terra in una griglia regolare di celle di circa 100 metri. Per ogni pixel nell’immagine infrarossa del drone, il sistema calcola a quale cella della griglia a terra corrisponde e costruisce una mappa a griglia corrispondente. Questa mappa a griglia viene quindi trasformata in un insieme di codici numerici apprendibili che viaggiano nella rete neurale insieme all’immagine stessa. In pratica, ogni pixel porta con sé sia un indizio visivo sia un suggerimento geografico, permettendo al modello di imparare dove è probabile che si verifichino incendi e di restituire identificatori di griglia standardizzati direttamente, senza invocare servizi di mappatura esterni.

Progettare un cervello che pensa veloce

Incorporare la geografia è solo metà della storia; il resto è farlo funzionare velocemente su un piccolo computer di bordo. Gli autori usano una tecnica chiamata neural architecture search, che testa automaticamente molte possibili progettazioni di rete per trovare quelle che bilanciano accuratezza e velocità. Misurano quanto tempo richiedono i blocchi costitutivi di base—come convoluzioni compatte e moduli di attenzione—per essere eseguiti su un dispositivo embedded, quindi guidano la ricerca in modo che combinazioni lente siano scoraggiate. Il progetto finale di BGC‑LiteNet usa meno di un milione di parametri, si basa ampiamente su convoluzioni efficienti e pota percorsi non necessari, ottenendo un tempo di elaborazione medio di circa 38 millisecondi per immagine a risoluzione standard su un modulo NVIDIA Jetson Xavier NX trasportato da un drone.

Mettere il sistema alla prova

Per verificare se questo approccio funziona nel mondo reale, il team ha costruito un dataset di quasi 13.000 immagini da drone raccolte su montagne, pianure, margini boschivi e terreni misti in diverse province cinesi. Ogni immagine è abbinata a dati di posizione del drone altamente accurati e ad annotazioni degli incendi collegate alle celle della griglia BeiDou. In questa raccolta diversificata di scene diurne, notturne, fumose e chiare, BGC‑LiteNet rileva incendi con circa l’89 percento di mean average precision e raggiunge oltre il 92 percento di accuratezza nel geolocalizzarli entro 50 metri. Supera sia i metodi tradizionali sia i modelli compatti di deep learning più diffusi, specialmente quando gli incendi sono piccoli, l’illuminazione è scarsa o il fumo è denso. Il sistema scala bene anche con diverse dimensioni di immagine e resta reattivo anche a risoluzioni più alte.

Da singoli droni a reti antincendio

Localizzazioni accurate e standardizzate sono cruciali quando più droni e squadre a terra devono lavorare insieme. Poiché BGC‑LiteNet fornisce direttamente posizioni in un sistema di griglia nazionale, diversi droni automaticamente “parlano la stessa lingua”, riducendo le discrepanze nelle posizioni segnalate. Test con pattugliamenti multi‑drone simulati mostrano che le stime di posizione per lo stesso incendio sono strettamente raggruppate, molto di più rispetto ai metodi che si affidano a passaggi di mappatura separati per ciascuna piattaforma. I ricercatori mostrano inoltre che il sistema continua a funzionare in condizioni difficili di illuminazione, fumo, pioggia e nebbia, e può essere convertito rapidamente in coordinate in stile GPS per gli strumenti di mappatura esistenti.

Cosa significa per la lotta agli incendi

BGC‑LiteNet dimostra che è possibile costruire un sistema di rilevamento incendi basato su droni che sia sia veloce sia preciso trattando la mappatura come parte dell’intelligenza anziché come un’aggiunta. Incorporando un riferimento di griglia nazionale direttamente nella rete neurale e progettando automaticamente il modello per hardware a basso consumo, gli autori ottengono allarmi rapidi e accurati che possono guidare gli operatori entro decine di metri da un nuovo focolaio. Oltre agli incendi boschivi, la stessa idea—insegnare alle reti neurali a comprendere dove oltre a cosa—potrebbe aiutare in altri compiti come monitoraggi della fauna selvatica, valutazioni dei disastri e agricoltura di precisione.

Citazione: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

Parole chiave: rilevamento incendi con UAV, deep learning geospaziale, edge AI, BeiDou Grid Code, localizzazione in tempo reale