Clear Sky Science · pl

BGC-LiteNet: Wbudowana w sieć lekka architektura z kodem siatki BeiDou do wykrywania i lokalizacji pożarów UAV w czasie rzeczywistym

Obserwowanie lasu z góry

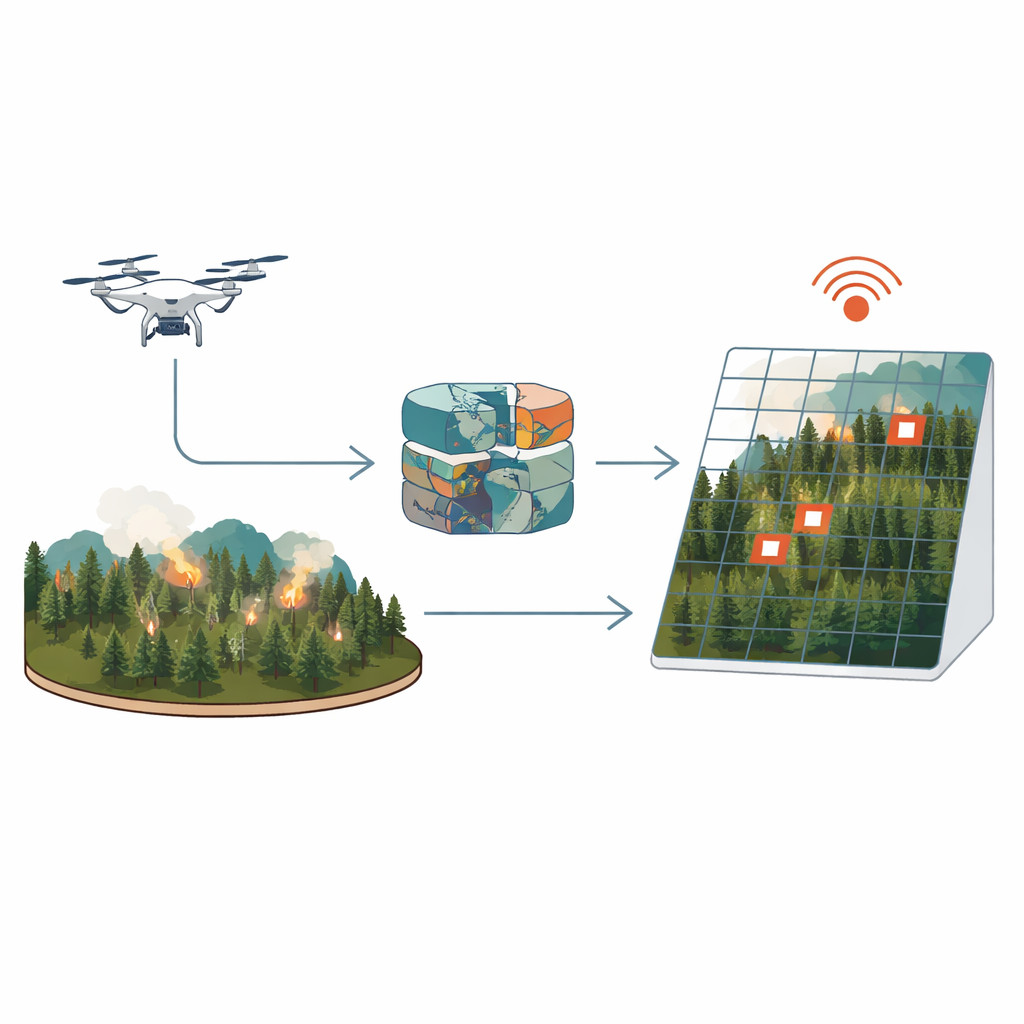

Pożary lasów mogą w ciągu kilku minut przekształcić się z małej iskry w katastrofę. Drony wyposażone w kamery wykrywające ciepło obiecują wczesne wykrywanie takich ognisk, ale współczesne systemy stoją przed trudnym kompromisem: szybkie, lekkie oprogramowanie zwykle nie wychwytuje małych, wczesnych płomieni, podczas gdy cięższe, dokładniejsze programy reagują zbyt wolno, by być przydatne w nagłej sytuacji. W artykule przedstawiono nowe podejście nazwane BGC‑LiteNet, które ma osiągnąć oba cele jednocześnie — szybko wykrywać małe pożary i niemal w czasie rzeczywistym określać ich położenie na mapie, nawet na skromnych komputerach pokładowych.

Dlaczego wczesne wykrywanie pożarów jest tak trudne

Wczesne stadia pożarów leśnych w obrazach z drona wyglądają jak zaledwie kilka świecących pikseli, często ukrytych dymem, słabym oświetleniem lub złożonym terenem. Tradycyjne metody oparte na prostych progach lub ręcznie projektowanych cechach obrazu są szybkie, ale łatwo dają się zmylić przez inne źródła ciepła i zmienne warunki. Nowsze systemy z użyciem głębokiego uczenia lepiej rozpoznają ogień, lecz zazwyczaj podają jedynie pozycje w obrazie, a nie współrzędne na mapie. Przekształcenie tych pozycji w rzeczywiste lokalizacje wymaga dodatkowych kroków związanych z geometrią kamery, pozycjonowaniem satelitarnym i usługami mapowymi online. Każdy dodany etap kosztuje czas — setki milisekund lub więcej — i zależy od niezawodnej łączności, która często jest niedostępna w odległych górach.

Wprowadzenie mapy bezpośrednio do sieci neuronowej

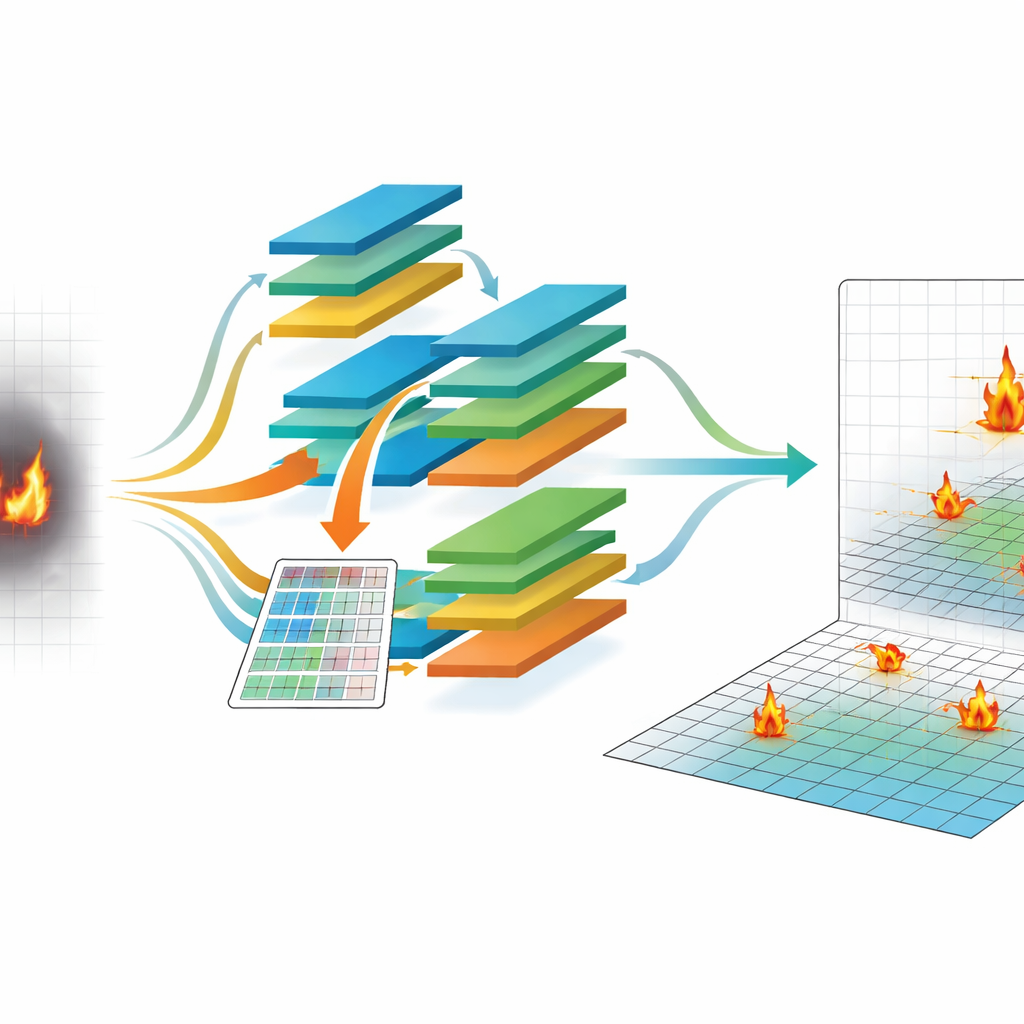

Zamiast traktować mapowanie jako dodatek, BGC‑LiteNet wbudowuje geografię bezpośrednio w proces detekcji. Wykorzystuje chiński standard BeiDou Grid Code (BGC), który dzieli Ziemię na regularną siatkę komórek o boku około 100 metrów. Dla każdego piksela w podczerwonym obrazie z drona system oblicza, której komórce siatki na ziemi odpowiada, i buduje odpowiadającą mapę siatki. Ta mapa siatki jest następnie zamieniana na zestaw uczących się kodów numerycznych, które trafiają do sieci neuronowej równolegle z obrazem. W efekcie każdy piksel niesie zarówno wskazówkę wizualną, jak i geograficzną, co pozwala modelowi nauczyć się, gdzie prawdopodobnie pojawią się pożary i bezpośrednio wypisywać standardowe identyfikatory siatki, bez odwoływania się do zewnętrznych usług mapowych.

Projektowanie „mózgu”, który myśli szybko

Wbudowanie geografii to tylko połowa historii; reszta to sprawienie, by działało szybko na małym komputerze pokładowym. Autorzy używają techniki zwanej przeszukiwaniem architektury sieci neuronowej (neural architecture search), która automatycznie testuje wiele możliwych projektów sieci, aby znaleźć te, które równoważą dokładność i szybkość. Mierzą czas działania podstawowych bloków — takich jak kompaktowe sploty i moduły uwagi — na urządzeniu wbudowanym i kierują przeszukiwanie tak, aby niekorzystne kombinacje były zniechęcane. Końcowy projekt BGC‑LiteNet używa poniżej miliona parametrów, opiera się w dużej mierze na wydajnych splotach i przycina niepotrzebne ścieżki, co przekłada się na średni czas przetwarzania około 38 milisekund na obraz w standardowej rozdzielczości na module NVIDIA Jetson Xavier NX niesionym przez drona.

Testy systemu

Aby sprawdzić, czy podejście działa w rzeczywistych warunkach, zespół zbudował zestaw danych prawie 13 000 obrazów z dronów zebranych nad górami, równinami, skrajami lasów i terenami mieszanymi w kilku prowincjach Chin. Każdy obraz jest sparowany z bardzo dokładnymi danymi pozycji drona i adnotacjami pożarów powiązanymi z komórkami siatki BeiDou. W tym różnorodnym zbiorze scen dnia i nocy, przy dymie i w przejrzystych warunkach, BGC‑LiteNet wykrywa pożary z około 89-procentową średnią precyzją (mAP) i osiąga ponad 92 procent trafności w geolokalizacji w granicach 50 metrów. Przewyższa zarówno metody tradycyjne, jak i popularne kompaktowe modele głębokiego uczenia, szczególnie gdy pożary są małe, o słabym oświetleniu lub przy gęstym dymie. System dobrze skaluje się też przy różnych rozmiarach obrazów i pozostaje responsywny nawet przy wyższych rozdzielczościach.

Od pojedynczych dronów do sieci ratowniczych

Dokładne, znormalizowane lokalizacje są kluczowe, gdy wiele dronów i zespołów naziemnych musi współpracować. Ponieważ BGC‑LiteNet bezpośrednio wypisuje lokalizacje w krajowym systemie siatkowym, różne drony automatycznie „mówią tym samym językiem”, zmniejszając rozbieżności w zgłaszanych pozycjach. Testy symulowanych patroli wielodronowych pokazują, że jego estymaty lokalizacji tego samego pożaru są ściśle skupione, znacznie bardziej niż w przypadku metod polegających na oddzielnych krokach mapowania dla każdej platformy. Badacze pokazują też, że system działa w trudnych warunkach oświetleniowych, przy dymie, deszczu i mgle, i może być szybko przekształcony na standardowe współrzędne w stylu GPS dla istniejących narzędzi mapowych.

Co to oznacza dla działań gaśniczych

BGC‑LiteNet demonstruje, że możliwe jest zbudowanie systemu wykrywania pożarów opartych na dronach, który jest jednocześnie szybki i precyzyjny, traktując mapowanie jako element inteligencji, a nie dodatek. Poprzez osadzenie krajowego odniesienia siatkowego bezpośrednio w sieci neuronowej i automatyczne projektowanie modelu pod kątem sprzętu o niskim poborze mocy, autorzy uzyskują szybkie, dokładne alerty o pożarach, które mogą kierować ratowników na odległość dziesiątek metrów od nowego ogniska. Poza pożarami lasów ta sama idea — nauczyć sieci neuronowe rozumieć gdzie, a nie tylko co — może pomóc w zadaniach takich jak inwentaryzacja dzikiej fauny, ocena zniszczeń po katastrofach czy precyzyjne rolnictwo.

Cytowanie: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

Słowa kluczowe: Wykrywanie pożarów UAV, geoprzestrzenne uczenie głębokie, edge AI, Kod siatki BeiDou, lokalizacja w czasie rzeczywistym