Clear Sky Science · sv

BGC-LiteNet: BeiDou-gridkod inbäddad lättviktig neuralt arkitektur för realtidsdetektion och lokalisering av bränder med UAV

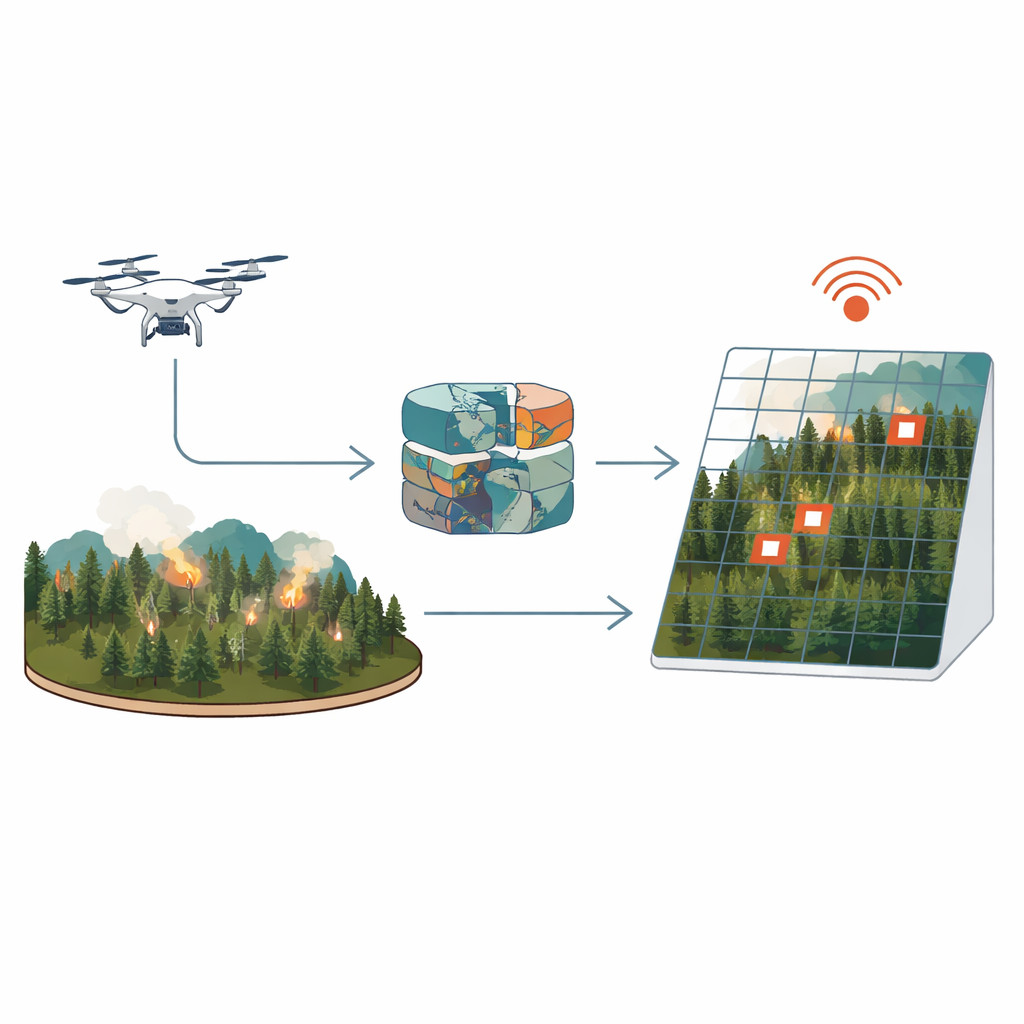

Att övervaka skogen från ovan

Skogsbränder kan på några minuter gå från en liten gnista till en katastrof. Drönare utrustade med värmekameror lovar att upptäcka dessa bränder tidigt, men dagens system står inför ett svårt kompromiss: snabb, lätt programvara missar ofta små, tidiga lågor, medan tyngre, mer precisa program reagerar för långsamt för att vara användbara i en nödsituation. Denna artikel introducerar ett nytt tillvägagångssätt kallat BGC‑LiteNet som siktar på att göra båda delarna samtidigt — upptäcka små bränder snabbt och bestämma deras positioner på en karta i nästan realtid, även på enkla omborddatorer.

Varför tidig brandupptäckt är så svårt

Bränder i ett tidigt skede syns i drönarbilder ofta som bara några lysande pixlar, ofta dolda av rök, svagt ljus eller rörig terräng. Traditionella metoder som förlitar sig på enkla tröskelvärden eller handgjorda bildfunktioner är snabba men lättrubbade av andra värmekällor och förändrade förhållanden. Nyare djupinlärningssystem är bättre på att känna igen bränder, men ger vanligtvis bara bildpositioner, inte verkliga kartkoordinater. Att omvandla dessa positioner till verkliga platser kräver extra steg som involverar kamerageometri, satellitpositionering och onlinetjänster för kartor. Varje tillagt steg kostar tid—hundratals millisekunder eller mer—och är beroende av pålitlig kommunikation, vilket ofta saknas i avlägsna bergstrakter.

Att lägga kartan inuti neuronnätet

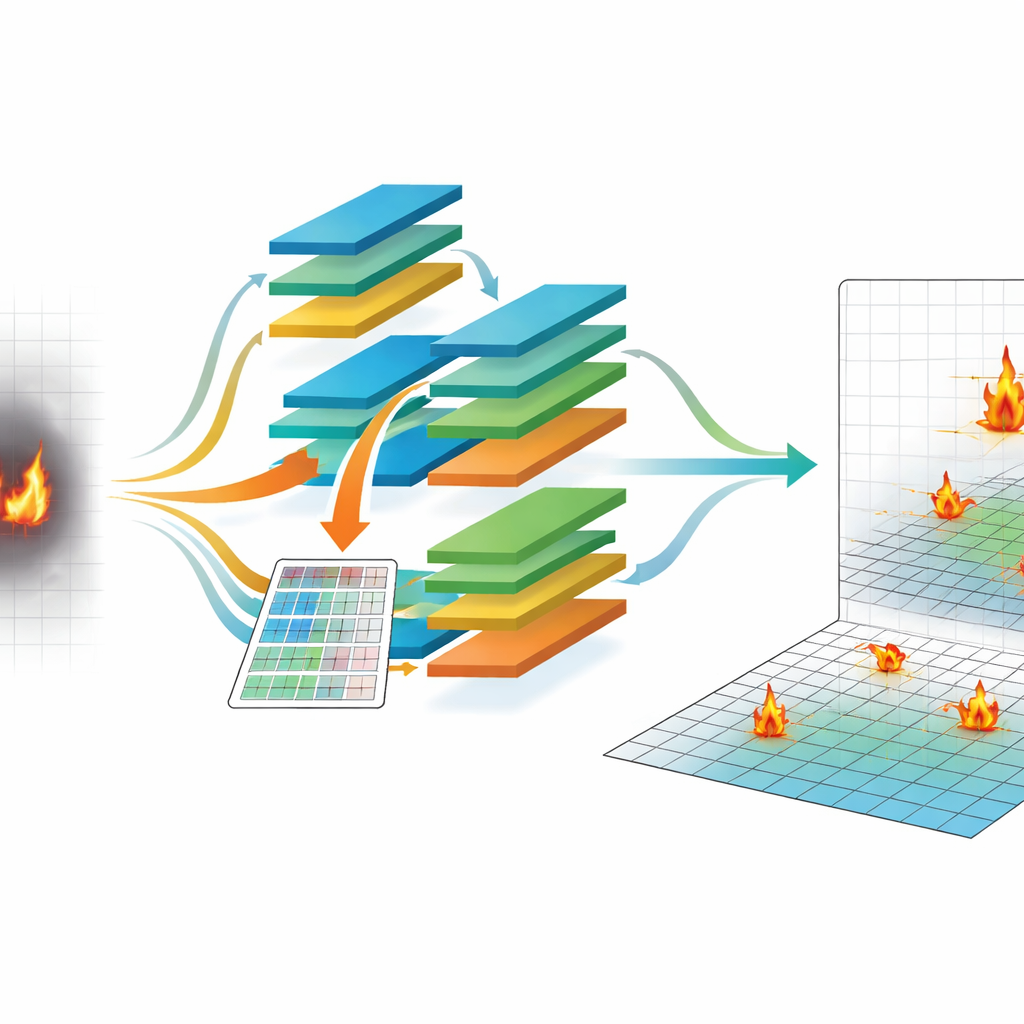

I stället för att betrakta kartläggning som en eftertanke bakar BGC‑LiteNet in geografi direkt i detekteringsprocessen. Det använder Kinas BeiDou Grid Code (BGC), en nationell standard som delar in jorden i ett regelbundet rutnät med celler om cirka 100 meter. För varje pixel i en drönarens infraröda bild beräknar systemet vilken rutcell på marken den motsvarar och bygger en matchande rutnätskarta. Denna rutnätskarta omvandlas sedan till en uppsättning lärbara numeriska koder som förs in i neuronnätet tillsammans med själva bilden. I praktiken kommer varje pixel med både en visuell ledtråd och en geografisk hint, vilket gör det möjligt för modellen att lära sig var bränder sannolikt uppstår och att direkt ge ut standardiserade rutnätsidentifierare utan att anropa externa karttjänster.

Att designa en hjärna som tänker snabbt

Att bädda in geografi är bara halva historien; resten är att få det att köras snabbt på en liten omborddator. Författarna använder en teknik kallad neural architecture search, som automatiskt testar många möjliga nätverksdesigner för att hitta dem som balanserar noggrannhet mot hastighet. De mäter hur lång tid grundläggande byggstenar—såsom kompakta konvolutioner och attention-moduler—tar att köra på en inbäddad enhet, och styr sedan sökningen så att långsamma kombinationer ogillas. Den slutliga BGC‑LiteNet-designen använder under en miljon parametrar, förlitar sig i hög grad på effektiva konvolutioner och beskär onödiga vägar, vilket resulterar i en genomsnittlig bearbetningstid på cirka 38 millisekunder per bild i standardupplösning på en NVIDIA Jetson Xavier NX-modul bärbar av en drönare.

Testning av systemet

För att se om detta tillvägagångssätt fungerar i verkligheten byggde teamet en dataset med nästan 13 000 drönarbilder insamlade över berg, slätter, skogskanter och blandad terräng i flera kinesiska provinser. Varje bild är parvis kopplad till mycket noggranna drönarpositionsdata och brandannoteringar länkade till BeiDou-rutceller. I denna mångfacetterade samling av dag-, natt-, rökiga och klara scener upptäcker BGC‑LiteNet bränder med cirka 89 procent mean average precision och uppnår mer än 92 procents noggrannhet i att geografiskt lokalisera dem inom 50 meter. Det överträffar både traditionella metoder och populära kompakta djupinlärningsmodeller, särskilt när bränder är små, belysningen är svag eller röken tät. Systemet skalar också väl över olika bildstorlekar och förblir responsivt även vid högre upplösningar.

Från enskilda drönare till brandbekämpningsnätverk

Exakta, standardiserade positioner är avgörande när flera drönare och markteam måste samarbeta. Eftersom BGC‑LiteNet levererar positioner direkt i ett nationellt rutnätsystem, "talar" olika drönare automatiskt samma språk, vilket minskar oenigheter i rapporterade positioner. Tester med simulerade patruller med flera drönare visar att dess positionsskattningar för samma brand är tätt klustrade, mycket mer än för metoder som förlitar sig på separata kartläggningssteg för varje plattform. Forskarna visar också att systemet fortsätter fungera under utmanande förhållanden som svagt ljus, rök, regn och dimma, och kan snabbt konverteras till standard GPS‑liknande koordinater för befintliga kartverktyg.

Vad det här betyder för brandbekämpning

BGC‑LiteNet visar att det är möjligt att bygga ett drönarbaserat brandsdetekteringssystem som både är snabbt och precist genom att behandla kartläggning som en del av intelligensen snarare än ett tillägg. Genom att bädda in en nationell rutnätsreferens direkt i neuronnätet och automatiskt designa modellen för lågströms hårdvara uppnår författarna snabba, precisa brandlarm som kan leda insatser till inom tiotals meter från en ny brand. Utöver skogsbränder kan samma idé—att lära neurala nät att förstå var såväl som vad—vara till hjälp i andra uppgifter som viltinventeringar, katastrofbedömning och precisionsjordbruk.

Citering: Yin, H., Yu, Y., Hong, A. et al. BGC-LiteNet: BeiDou grid code embedded lightweight neural architecture for real-time UAV fire detection and localization. Sci Rep 16, 14456 (2026). https://doi.org/10.1038/s41598-026-44728-6

Nyckelord: UAV-brandsdetektion, geospatial djupinlärning, edge-AI, BeiDou Grid Code, realtidslokalisering