Clear Sky Science · zh

利用大型语言模型和 ROBUST-RCT 评估临床试验偏倚风险:一项可行性研究

这对患者和医生为何重要

现代医学依赖临床试验来决定哪些治疗有效,但即便设计良好的研究也可能因偏倚而产生误导。逐一仔细检查每项试验以发现潜在问题是耗时且复杂的工作,可能导致医学指南的更新被推迟数年。本研究探讨大型语言模型——能够阅读和分析文本的先进人工智能系统——是否能帮助人类更快且更一致地判断临床试验的可信度,所用的是一种较新且更简化的工具:ROBUST-RCT。

当前如何判断试验质量

临床试验常被称为金标准,然而它们仍可能因设计缺陷、报告不充分或选择性分析而被扭曲。为发现这些问题,审稿者通常使用 Cochrane 的风险偏倚 2(RoB 2)检查表。尽管它很严谨,但 RoB 2 很耗时、即便对专家也难以应用,并且不同评审者之间的一致性通常仅为中等。同时,每年发表的试验数量不断增加,但真正进入系统评价的研究数量并未同步增长,许多综述在发表时已落后于最新证据。日益扩大的这一差距促使人们对更易用的工具以及来自人工智能的技术帮助产生兴趣。

一种新工具与 AI 的角色

ROBUST-RCT 是一种最近开发的 RoB 2 替代工具。它不试图覆盖所有可能的偏倚来源,而是聚焦于六个既常见又与治疗效果扭曲高度相关的核心项目。该工具由流行病学家设计,旨在在简洁性和科学严谨之间取得平衡,并在初级审稿者中进行了可用性测试。由于 ROBUST-RCT 比 RoB 2 更新且不那么为人熟知,作者看到了一个机会:将这一精简的检查表与大型语言模型结合,评估 AI 是否可以在判断试验偏倚时可靠地辅助人工审稿者。

研究者实际测试了什么

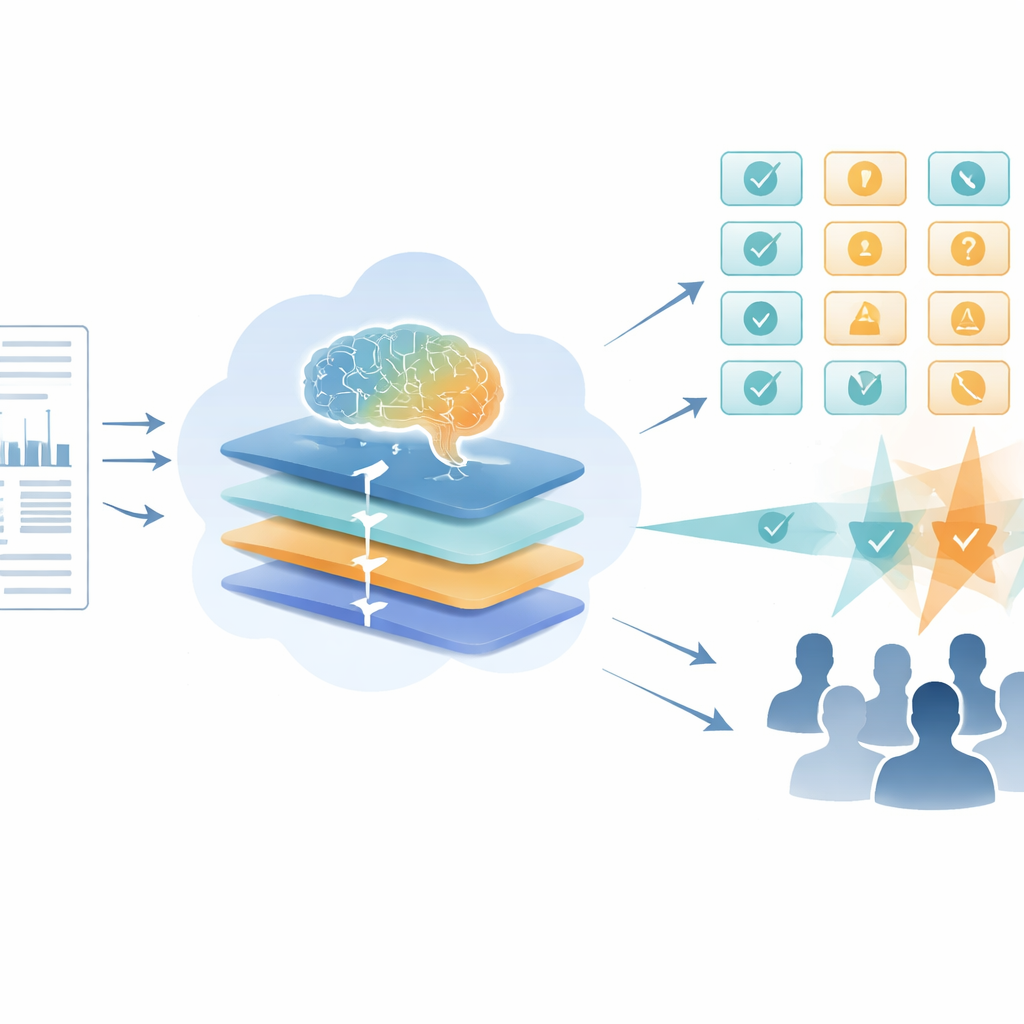

研究团队从 PubMed Central 随机挑选了 20 项药物试验,排除若干不符合条件的后,最终对 9 项随机对照试验进行了详细分析。三位早期职业的医学研究者独立使用 ROBUST-RCT 手册对每项试验的主要结局进行评分,随后在一致性会议中解决分歧。与此同时,四种不同的大型语言模型——GPT-4-turbo、Gemini 2.5 Pro Preview、DeepSeek-R1 和 Qwen3-235B-A22B——被提供了完整的试验 PDF 以及逐步的详细指令提示,说明如何应用 ROBUST-RCT。核心问题是:每个 AI 的最终评分在该工具的六个主要项目上与人工一致性结论的匹配程度如何?

AI 与人工的一致性如何

为量化一致性,作者使用了一种称为 Gwet’s AC2 的统计量,它在处理不均衡评分模式时优于更常见的 Kappa 分数。在 54 对人机比较中,四个模型中有三个在概率性基准下达到至少“中等”可靠性,这意味着它们的评分通常与人工一致性结论相似,且重大分歧相对少见。表现最好的是 Gemini 2.5 Pro Preview(AC2 = 0.69),其次为 Qwen3-235B-A22B(0.65)和 GPT-4-turbo(0.60)。DeepSeek-R1 最弱(0.46),且倾向于比人工更频繁地判定试验存在偏倚,可能是因为它仅依赖文本抽取,无法充分利用表格和图示。值得注意的是,当作者仅看在达成共识前的人类评审者时,他们自身的一致性(Fleiss’ Kappa = 0.49)与已有关于较旧 RoB 2 工具的报告相近。

这对未来证据综述意味着什么

尽管样本量较小,这项可行性研究表明,几种当前的大型语言模型在应用 ROBUST-RCT 时可以与人类评审者达到至少中等程度的一致性。实际上,这类模型未来可能充当“第三评审者”以打破僵局、标记可能的错误或对研究进行预筛选,从而让人类专家将精力集中在最复杂或有争议的案例上。作者强调 AI 不会取代人类判断,并指出必须解决伦理问题——如数据隐私、以受版权保护材料为训练数据以及对自动化工具过度依赖的风险。尽管如此,研究发现表明,在严格引导下的 AI 有望帮助使系统评价保持更新,从而使临床医生和指南小组能少花时间在技术评分上,多花时间解读全部证据对患者护理的意义。

引用: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

关键词: 偏倚风险, 临床试验, 系统评价, 大型语言模型, 循证医学