Clear Sky Science · fr

Évaluer le risque de biais des essais cliniques avec des grands modèles de langue et ROBUST-RCT : une étude de faisabilité

Pourquoi cela compte pour les patients et les médecins

La médecine moderne s’appuie sur les essais cliniques pour déterminer quels traitements fonctionnent, mais même des études bien conçues peuvent tromper si elles sont biaisées. Examiner chaque essai avec attention pour détecter des problèmes cachés est un travail long et complexe qui peut retarder la mise à jour des recommandations médicales pendant des années. Cette étude explore si les grands modèles de langue — des systèmes d’intelligence artificielle avancés capables de lire et d’analyser des textes — peuvent aider les humains à juger plus rapidement et de façon plus cohérente la fiabilité des essais cliniques, en utilisant un outil récent et plus simple appelé ROBUST-RCT.

Comment la qualité des essais est évaluée aujourd’hui

Les essais cliniques sont souvent qualifiés de référence, pourtant ils peuvent être altérés par des défauts de conception, un mauvais reporting ou des analyses sélectives. Pour repérer ces problèmes, les évaluateurs utilisent couramment la grille Risk of Bias 2 (RoB 2) de Cochrane. Bien que rigoureuse, RoB 2 est réputée longue à appliquer, difficile même pour les experts, et ne donne qu’un accord modéré entre évaluateurs. Parallèlement, le nombre d’essais publiés chaque année augmente, mais le nombre d’études effectivement incluses dans les revues systématiques n’a pas suivi, et de nombreuses revues sont déjà obsolètes au moment de leur publication. Cet écart grandissant suscite l’intérêt pour des outils plus simples et pour l’aide technologique apportée par l’IA.

Un nouvel outil et un rôle pour l’IA

ROBUST-RCT est une alternative récemment développée à RoB 2. Plutôt que d’essayer de couvrir toutes les sources possibles de biais, il se concentre sur six items centraux, à la fois fréquents et fortement liés à des effets de traitement biaisés. L’outil a été conçu par des épidémiologistes pour trouver un équilibre entre simplicité et rigueur scientifique, et il a été testé en termes d’utilisabilité auprès d’évaluateurs débutants. Parce que ROBUST-RCT est plus récent et moins familier que RoB 2, les auteurs ont vu une opportunité : combiner cette grille allégée avec des grands modèles de langue pour vérifier si l’IA pouvait assister de manière fiable le jugement humain sur le biais des essais.

Ce que les chercheurs ont réellement testé

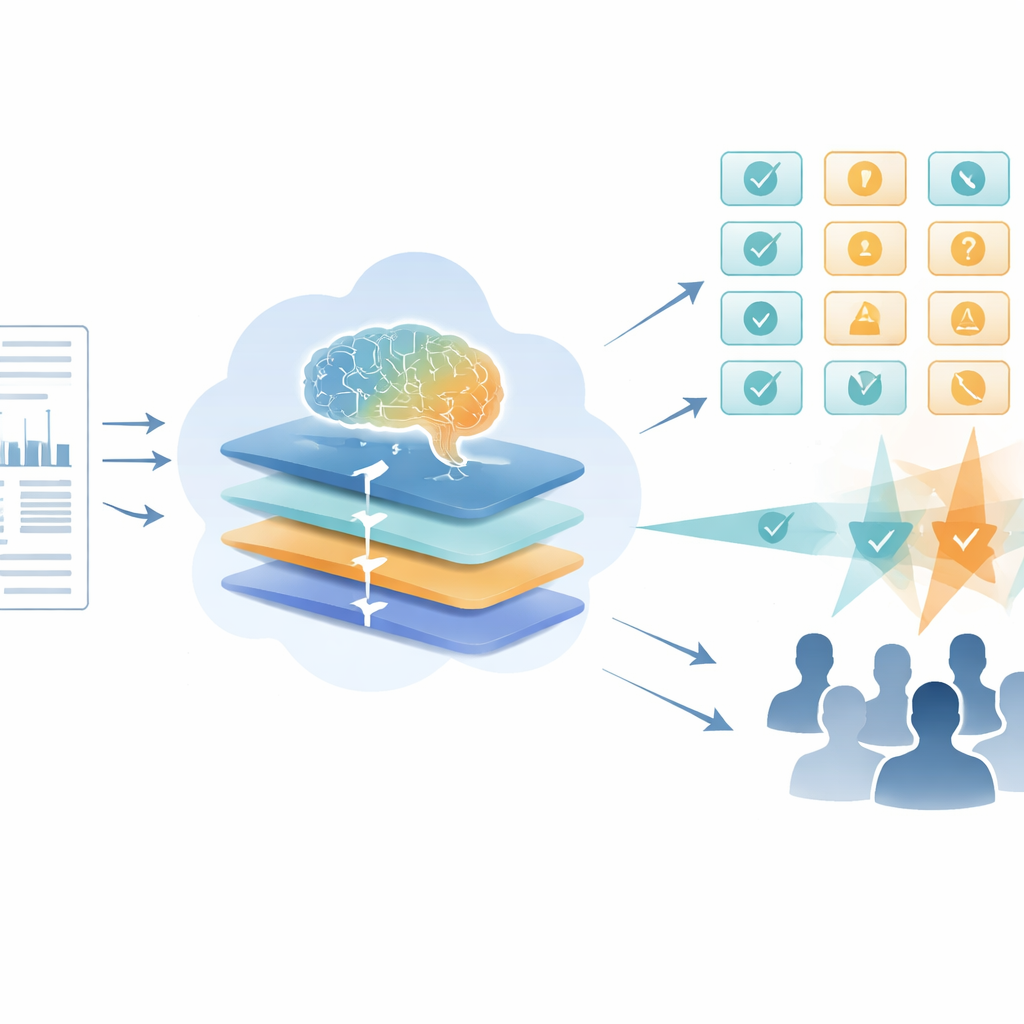

L’équipe a sélectionné au hasard 20 essais médicamenteux indexés dans PubMed Central et, après exclusions, a retenu 9 essais randomisés pour une analyse détaillée. Trois chercheurs médicaux en début de carrière ont utilisé indépendamment le manuel ROBUST-RCT pour évaluer le résultat primaire de chaque essai, puis ont résolu leurs désaccords lors de réunions de consensus. En parallèle, quatre grands modèles de langue différents — GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 et Qwen3-235B-A22B — ont reçu les PDF complets des essais ainsi qu’un prompt d’instructions détaillées étape par étape expliquant comment appliquer ROBUST-RCT. La question centrale était : dans quelle mesure les évaluations finales de chaque IA correspondaient-elles au consensus humain pour les six items principaux de l’outil ?

Quel a été le niveau d’accord entre les IA et les humains

Pour quantifier l’accord, les auteurs ont utilisé une statistique appelée AC2 de Gwet, qui améliore les coefficients Kappa plus connus et gère mieux les distributions d’évaluations inégales. Sur 54 paires comparées humain–IA, trois des quatre modèles ont atteint au moins une fiabilité « modérée » en test probabiliste, ce qui signifie que leurs évaluations étaient souvent similaires à celles du consensus humain et que de grands désaccords étaient relativement rares. Gemini 2.5 Pro Preview s’est montré le meilleur (AC2 = 0,69), suivi de Qwen3-235B-A22B (0,65) et GPT-4-turbo (0,60). DeepSeek-R1 était le plus faible (0,46) et avait tendance à évaluer les essais comme plus biaisés que les humains, possiblement parce qu’il se limitait à l’extraction textuelle et ne pouvait pas exploiter pleinement les tableaux et figures. Notamment, lorsque les auteurs n’ont examiné que les évaluateurs humains avant leurs réunions de discussion, leur propre accord (Kappa de Fleiss = 0,49) était similaire à ce qui a été rapporté pour l’ancien outil RoB 2.

Ce que cela implique pour les revues d’évidence à venir

Malgré sa petite taille d’échantillon, cette étude de faisabilité montre que plusieurs grands modèles de langue actuels peuvent atteindre au moins un accord modéré avec des évaluateurs humains lors de l’application de ROBUST-RCT, un outil plus simple d’évaluation du risque de biais des essais cliniques. En pratique, ces modèles pourraient éventuellement servir de « troisième évaluateur » pour départager, signaler des erreurs probables ou présélectionner des études afin que les experts humains se concentrent sur les cas les plus complexes ou contestés. Les auteurs insistent sur le fait que l’IA ne remplacera pas le jugement humain et que des questions éthiques — telles que la confidentialité des données, l’entraînement sur des œuvres protégées par le droit d’auteur et le risque de dépendance excessive aux outils automatisés — doivent être traitées. Néanmoins, les résultats suggèrent qu’une IA guidée avec soin pourrait aider à maintenir les revues systématiques à jour, permettant aux cliniciens et aux comités de recommandations de passer moins de temps sur le scoring technique et davantage à interpréter ce que l’ensemble des preuves signifie pour la prise en charge des patients.

Citation: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Mots-clés: risque de biais, essais cliniques, revues systématiques, grands modèles de langue, médecine fondée sur les preuves