Clear Sky Science · es

Evaluación del riesgo de sesgo en ensayos clínicos con modelos de lenguaje grande y ROBUST-RCT: un estudio de viabilidad

Por qué esto importa para pacientes y médicos

La medicina moderna depende de los ensayos clínicos para decidir qué tratamientos funcionan, pero incluso estudios bien concebidos pueden resultar engañosos si están sesgados. Revisar cada ensayo con detalle para detectar problemas ocultos es un trabajo lento y complejo que puede retrasar durante años la actualización de las guías médicas. Este estudio explora si los modelos de lenguaje grande —avanzados sistemas de IA que leen y analizan texto— pueden ayudar a los humanos a juzgar más rápida y consistentemente la confiabilidad de los ensayos clínicos, empleando una herramienta más reciente y sencilla llamada ROBUST-RCT.

Cómo se juzga hoy la calidad de los ensayos

Los ensayos clínicos suelen considerarse el estándar de referencia, sin embargo pueden verse distorsionados por fallos en el diseño, una mala presentación de los datos o análisis selectivos. Para detectar estos problemas, los revisores suelen usar la lista de verificación Risk of Bias 2 (RoB 2) de Cochrane. Aunque rigurosa, RoB 2 consume mucho tiempo, es difícil de aplicar incluso para expertos y ofrece solo un acuerdo moderado entre diferentes revisores. Mientras tanto, el número de ensayos publicados cada año sigue creciendo, pero la cantidad de estudios que se incorporan a revisiones sistemáticas no va al mismo ritmo, y muchas revisiones están ya desactualizadas en el momento de su publicación. Esta brecha creciente ha impulsado el interés por herramientas más fáciles de usar y por la ayuda tecnológica de la IA.

Una nueva herramienta y un papel para la IA

ROBUST-RCT es una alternativa desarrollada recientemente a RoB 2. En lugar de intentar captar todas las posibles fuentes de sesgo, se centra en seis ítems centrales que son a la vez comunes y están fuertemente vinculados a la distorsión de los efectos del tratamiento. La herramienta fue diseñada por epidemiólogos para equilibrar simplicidad y rigor científico, y se ensayó en términos de usabilidad con revisores junior. Como ROBUST-RCT es más nueva y menos familiar que RoB 2, los autores vieron una oportunidad: combinar esta lista simplificada con modelos de lenguaje grande para comprobar si la IA podría asistir de forma fiable en la valoración del sesgo de ensayos junto a revisores humanos.

Qué probaron exactamente los investigadores

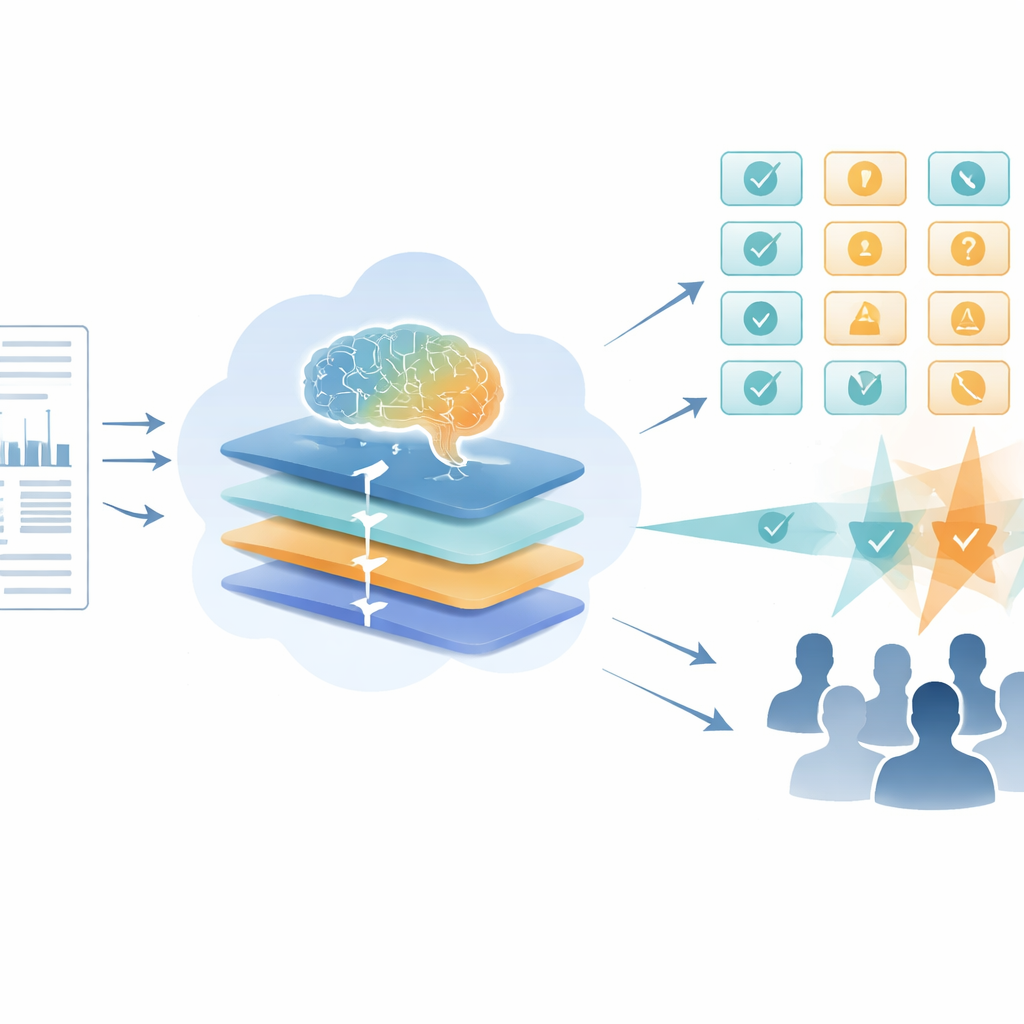

El equipo seleccionó al azar 20 ensayos farmacológicos indexados en PubMed Central y, tras aplicar exclusiones, quedó con 9 ensayos aleatorizados para análisis detallado. Tres investigadores médicos en inicio de carrera usaron de forma independiente el manual de ROBUST-RCT para valorar el resultado primario de cada ensayo y luego resolvieron sus desacuerdos en reuniones de consenso. En paralelo, a cuatro modelos de lenguaje grande distintos —GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 y Qwen3-235B-A22B— se les proporcionaron los PDFs completos de los ensayos junto con un prompt de instrucciones detallado y paso a paso sobre cómo aplicar ROBUST-RCT. La pregunta central fue: ¿qué tan estrechamente coincidían las valoraciones finales de cada IA con el consenso humano en los seis ítems principales de la herramienta?

Qué tan bien coincidieron las IAs con los humanos

Para cuantificar el acuerdo, los autores usaron una estadística llamada AC2 de Gwet, que mejora los coeficientes Kappa más conocidos y maneja mejor patrones de calificación desiguales. En 54 comparaciones emparejadas humano–IA, tres de los cuatro modelos alcanzaron al menos fiabilidad “moderada” cuando se evaluó de forma probabilística, lo que significa que sus valoraciones fueron a menudo similares a las del consenso humano y que las discrepancias importantes fueron relativamente raras. Gemini 2.5 Pro Preview fue el mejor (AC2 de 0,69), seguido por Qwen3-235B-A22B (0,65) y GPT-4-turbo (0,60). DeepSeek-R1 fue el más débil (0,46) y tendió a calificar los ensayos como más sesgados que los humanos, posiblemente porque se basó en extracción solo de texto y no pudo aprovechar completamente tablas y figuras. Cabe destacar que, cuando los autores examinaron únicamente a los revisores humanos antes de reunirse a discutir, su propio acuerdo (Kappa de Fleiss de 0,49) fue similar a lo reportado para la herramienta RoB 2 más antigua.

Qué significa esto para futuras revisiones de la evidencia

A pesar del tamaño reducido de la muestra, este estudio de viabilidad muestra que varios modelos de lenguaje grande actuales pueden alcanzar al menos un acuerdo moderado con revisores humanos al aplicar ROBUST-RCT, una herramienta más simple para evaluar el riesgo de sesgo en ensayos clínicos. En la práctica, dichos modelos podrían eventualmente actuar como un “tercer revisor” para desempatar, señalar errores probables o preseleccionar estudios para que los expertos humanos se concentren en los casos más complejos o controvertidos. Los autores subrayan que la IA no reemplazará el juicio humano y que deben abordarse cuestiones éticas —como la privacidad de los datos, el entrenamiento con material protegido por derechos de autor y el riesgo de confiar en exceso en herramientas automatizadas—. Aun así, los hallazgos sugieren que una IA guiada con cuidado podría ayudar a mantener las revisiones sistemáticas más actualizadas, permitiendo a clínicos y paneles de guías dedicar menos tiempo a la puntuación técnica y más a interpretar lo que el conjunto de la evidencia significa para la atención de los pacientes.

Cita: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Palabras clave: riesgo de sesgo, ensayos clínicos, revisiones sistemáticas, modelos de lenguaje grande, medicina basada en la evidencia