Clear Sky Science · de

Bewertung des Verzerrungsrisikos klinischer Studien mit großen Sprachmodellen und ROBUST-RCT: eine Machbarkeitsstudie

Warum das für Patientinnen, Patienten und Ärztinnen und Ärzte wichtig ist

Die moderne Medizin stützt sich auf klinische Studien, um zu entscheiden, welche Behandlungen wirken. Selbst gut konzipierte Studien können jedoch irreführend sein, wenn sie verzerrt sind. Jede Studie sorgfältig auf versteckte Probleme zu prüfen, ist zeitaufwändig und komplex und kann die Aktualisierung medizinischer Leitlinien über Jahre verzögern. Diese Studie untersucht, ob große Sprachmodelle — fortgeschrittene KI-Systeme, die Texte lesen und analysieren — Menschen dabei unterstützen können, die Vertrauenswürdigkeit klinischer Studien schneller und konsistenter einzuschätzen, und zwar mithilfe eines neueren, vereinfachten Instruments namens ROBUST-RCT.

Wie die Studienqualität heute beurteilt wird

Klinische Studien gelten oft als Goldstandard, können aber trotzdem durch methodische Mängel, unvollständige Berichterstattung oder selektive Auswertung verzerrt werden. Um diese Probleme zu erkennen, verwenden Gutachterinnen und Gutachter häufig die Checkliste Risk of Bias 2 (RoB 2) von Cochrane. Obwohl sie gründlich ist, ist RoB 2 berüchtigt dafür, zeitaufwendig zu sein, selbst für Expertinnen und Experten schwer anwendbar und liefert nur mäßige Übereinstimmung zwischen verschiedenen Bewerterinnen und Bewertern. Gleichzeitig steigt die Zahl der jährlich veröffentlichten Studien weiter an, während die Zahl der Studien, die tatsächlich in systematische Übersichten eingehen, nicht im gleichen Maße zunimmt — viele Reviews sind bereits bei Veröffentlichung veraltet. Diese wachsende Lücke hat das Interesse an leichter anwendbaren Instrumenten und an technologischer Unterstützung durch KI geweckt.

Ein neues Instrument und eine Rolle für KI

ROBUST-RCT ist eine kürzlich entwickelte Alternative zu RoB 2. Anstatt zu versuchen, jede mögliche Quelle von Verzerrung abzudecken, konzentriert sich das Tool auf sechs Kernpunkte, die sowohl häufig auftreten als auch stark mit verzerrten Behandlungseffekten verknüpft sind. Das Instrument wurde von Epidemiologinnen und Epidemiologen entwickelt, um einen Kompromiss zwischen Einfachheit und wissenschaftlicher Strenge zu finden, und auf Benutzerfreundlichkeit mit weniger erfahrenen Gutachterinnen und Gutachtern getestet. Da ROBUST-RCT neuer und weniger bekannt ist als RoB 2, sahen die Autorinnen und Autoren eine Möglichkeit: diese schlankere Checkliste mit großen Sprachmodellen zu kombinieren, um zu prüfen, ob KI zuverlässig die Beurteilung von Studienverzerrungen neben menschlichen Gutachtern unterstützen kann.

Was die Forschenden tatsächlich getestet haben

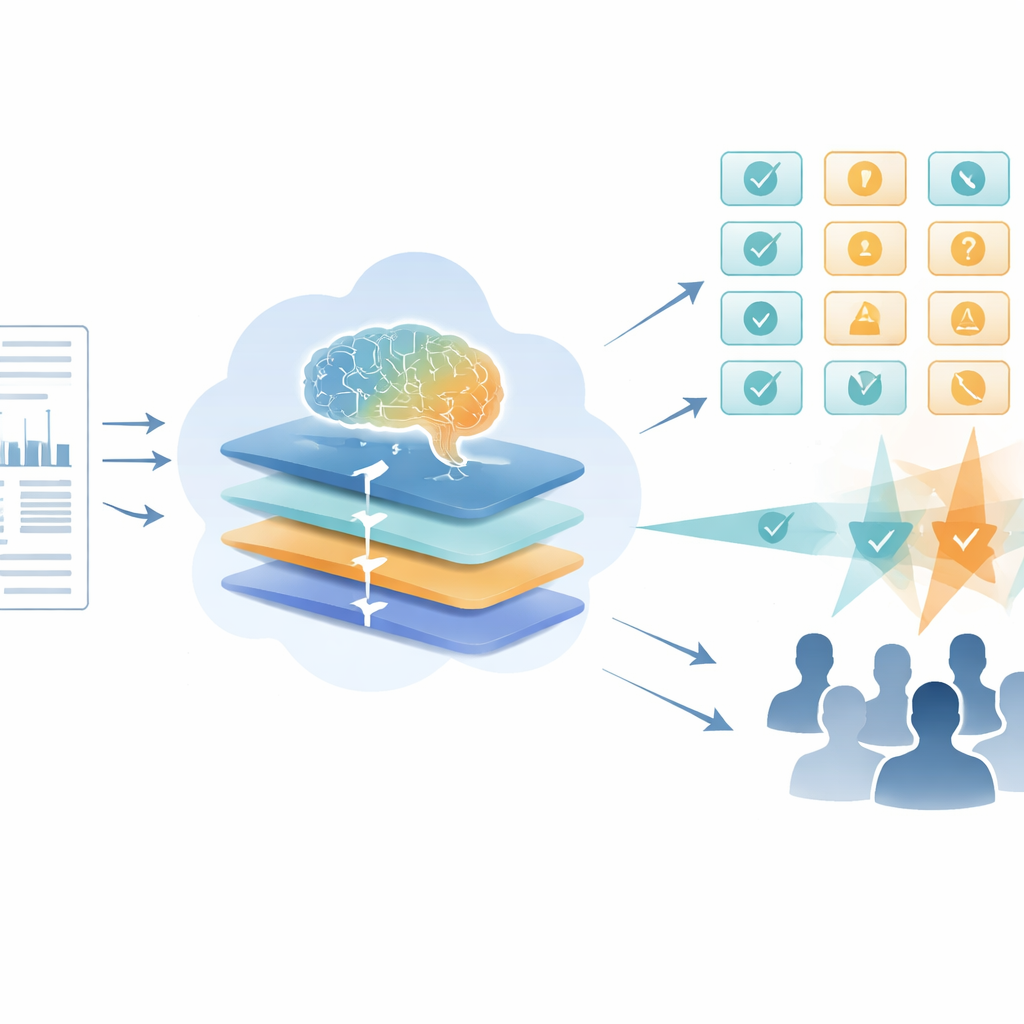

Das Team wählte zufällig 20 Arzneimittelstudien aus, die in PubMed Central indexiert sind, und kam nach Ausschlüssen auf 9 randomisierte kontrollierte Studien für die detaillierte Analyse. Drei Medizinerinnen und Mediziner in der frühen Karrierephase bewerteten unabhängig voneinander anhand des ROBUST-RCT-Handbuchs das primäre Ergebnis jeder Studie und klärten anschließend Meinungsverschiedenheiten in Konsenssitzungen. Parallel dazu wurden vier verschiedene große Sprachmodelle — GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 und Qwen3-235B-A22B — mit den vollständigen Studien-PDFs sowie einer detaillierten, schrittweisen Anweisung zur Anwendung von ROBUST-RCT versorgt. Die zentrale Frage war: Wie eng stimmten die endgültigen Bewertungen der jeweiligen KI mit dem menschlichen Konsens über die sechs Hauptpunkte des Instruments überein?

Wie gut die KIs mit Menschen übereinstimmten

Zur Quantifizierung der Übereinstimmung nutzten die Autorinnen und Autoren eine Statistik namens Gwet’s AC2, die Kappa-Werten überlegen ist und besser mit unausgewogenen Bewertungsmustern umgehen kann. In 54 gepaarten Mensch–KI-Vergleichen erreichten drei der vier Modelle bei probabilistischer Bewertung mindestens eine „mäßige“ Zuverlässigkeit, was bedeutet, dass ihre Bewertungen häufig mit dem menschlichen Konsens übereinstimmten und große Abweichungen relativ selten waren. Am besten schnitt Gemini 2.5 Pro Preview ab (AC2 = 0,69), gefolgt von Qwen3-235B-A22B (0,65) und GPT-4-turbo (0,60). DeepSeek-R1 war mit 0,46 am schwächsten und neigte dazu, Studien als stärker verzerrt einzustufen als Menschen — möglicherweise, weil es nur Text extrahierte und Tabellen sowie Abbildungen nicht vollständig nutzen konnte. Bemerkenswert ist, dass die Übereinstimmung der menschlichen Gutachterinnen und Gutachter vor ihren Konsensgesprächen (Fleiss’ Kappa = 0,49) ähnlich war wie Werte, die für das ältere RoB 2-Instrument berichtet wurden.

Was das für künftige Evidenzübersichten bedeutet

Trotz der kleinen Stichprobengröße zeigt diese Machbarkeitsstudie, dass mehrere aktuelle große Sprachmodelle zumindest eine mäßige Übereinstimmung mit menschlichen Gutachterinnen und Gutachtern beim Einsatz von ROBUST-RCT erreichen können — einem einfacheren Instrument zur Bewertung des Verzerrungsrisikos klinischer Studien. In der Praxis könnten solche Modelle schließlich als „dritte Gutachter“ dienen, um Unentschieden zu entscheiden, wahrscheinliche Fehler zu markieren oder Studien vorzusortieren, sodass menschliche Expertinnen und Experten sich auf die komplexesten oder umstrittensten Fälle konzentrieren können. Die Autorinnen und Autoren betonen, dass KI die menschliche Urteilskraft nicht ersetzen wird und dass ethische Fragen — etwa Datenschutz, Training an urheberrechtlich geschütztem Material und das Risiko übermäßiger Abhängigkeit von automatisierten Werkzeugen — geklärt werden müssen. Dennoch deuten die Ergebnisse darauf hin, dass sorgfältig gesteuerte KI dazu beitragen könnte, systematische Übersichten aktueller zu halten, sodass Klinikerinnen und Kliniker sowie Leitliniengremien weniger Zeit mit technischem Scoring verbringen und mehr Zeit damit, die Gesamtheit der Evidenz für die Patientenversorgung zu interpretieren.

Zitation: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Schlüsselwörter: Verzerrungsrisiko, klinische Studien, systematische Übersichten, große Sprachmodelle, evidenzbasierte Medizin