Clear Sky Science · it

Valutare il rischio di bias negli studi clinici con modelli linguistici di grandi dimensioni e ROBUST-RCT: uno studio di fattibilità

Perché questo è importante per pazienti e medici

La medicina moderna si basa sugli studi clinici per decidere quali terapie funzionano, ma anche studi ben progettati possono essere fuorvianti se affetti da bias. Controllare con cura ogni studio per individuare problemi nascosti è un lavoro lento e complesso che può ritardare l'aggiornamento delle linee guida mediche per anni. Questo studio esplora se i modelli linguistici di grandi dimensioni — sistemi avanzati di intelligenza artificiale che leggono e analizzano testi — possono aiutare gli esseri umani a giudicare in modo più rapido e coerente quanto siano affidabili gli studi clinici, usando uno strumento più recente e più semplice chiamato ROBUST-RCT.

Come viene valutata oggi la qualità degli studi

Gli studi clinici sono spesso chiamati standard d’oro, ma possono comunque essere distorti da difetti di disegno, scarsa qualità nella segnalazione o analisi selettive. Per individuare questi problemi, i revisori usano comunemente la checklist Risk of Bias 2 (RoB 2) della Cochrane. Pur essendo rigorosa, la RoB 2 richiede molto tempo, è difficile da applicare anche per esperti e dà solo un accordo modesto tra revisori diversi. Intanto, il numero di studi pubblicati ogni anno continua ad aumentare, mentre non è aumentato proporzionalmente il numero di studi inclusi nelle revisioni sistematiche, e molte revisioni sono già obsolete al momento della pubblicazione. Questo divario crescente ha stimolato l’interesse per strumenti più semplici da usare e per il supporto tecnologico offerto dall’IA.

Un nuovo strumento e un ruolo per l’IA

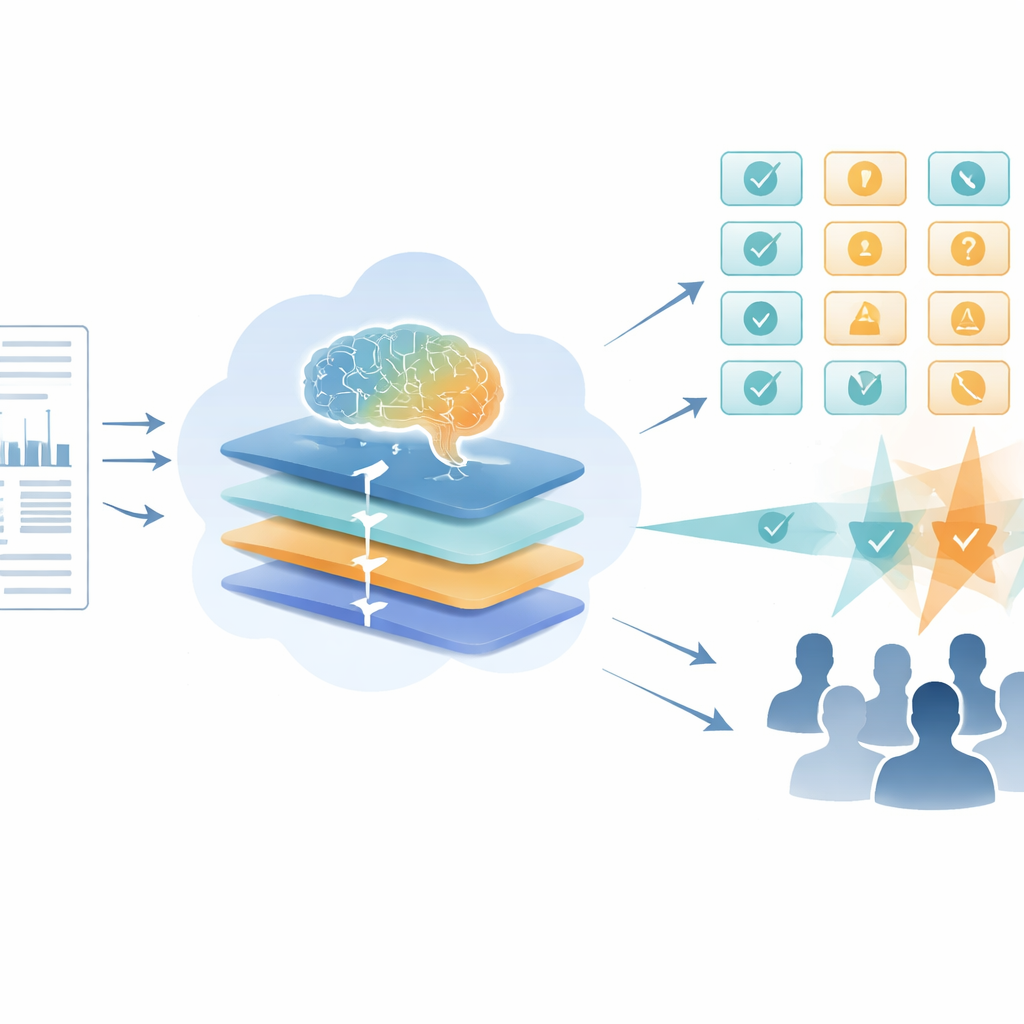

ROBUST-RCT è un’alternativa sviluppata di recente alla RoB 2. Invece di cercare di catturare tutte le possibili fonti di bias, si concentra su sei item fondamentali che sono sia comuni sia fortemente associati a effetti di trattamento distorti. Lo strumento è stato pensato da epidemiologi per bilanciare semplicità e rigore scientifico ed è stato testato per l’usabilità con revisori junior. Poiché ROBUST-RCT è più recente e meno familiare della RoB 2, gli autori hanno colto l’opportunità di combinare questa checklist semplificata con i modelli linguistici di grandi dimensioni per verificare se l’IA possa assistere in modo affidabile il giudizio sul bias degli studi insieme ai revisori umani.

Cosa hanno effettivamente testato i ricercatori

Il team ha scelto casualmente 20 studi farmacologici indicizzati in PubMed Central e, dopo le esclusioni, ha ottenuto 9 trial randomizzati per l’analisi dettagliata. Tre ricercatori medici in fase iniziale di carriera hanno valutato in modo indipendente l’outcome primario di ciascun trial usando il manuale ROBUST-RCT, risolvendo poi le discrepanze in riunioni di consenso. Parallelamente, a quattro diversi modelli linguistici di grandi dimensioni — GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 e Qwen3-235B-A22B — sono stati forniti i PDF completi dei trial più un prompt di istruzioni dettagliato e passo dopo passo su come applicare ROBUST-RCT. La domanda centrale era: quanto si avvicinavano le valutazioni finali di ciascuna IA al consenso umano sui sei item principali dello strumento?

Quanto gli strumenti di IA si sono accordati con gli umani

Per quantificare l’accordo, gli autori hanno usato una statistica chiamata AC2 di Gwet, che migliora le più note statistiche Kappa e gestisce meglio schemi di valutazione disomogenei. Su 54 confronti coppia umano–IA, tre dei quattro modelli hanno raggiunto almeno una affidabilità “moderata” se valutati probabilisticamente, cioè le loro valutazioni erano spesso simili al consenso umano e i grandi disaccordi erano relativamente rari. Gemini 2.5 Pro Preview ha ottenuto i migliori risultati (AC2 = 0,69), seguito da Qwen3-235B-A22B (0,65) e GPT-4-turbo (0,60). DeepSeek-R1 è risultato il più debole (0,46) e tendeva a valutare i trial come più soggetti a bias rispetto agli umani, probabilmente perché si basava solo sull’estrazione testuale e non poteva sfruttare appieno tabelle e figure. È interessante notare che, osservando solo i revisori umani prima delle discussioni di consenso, il loro stesso accordo (Kappa di Fleiss = 0,49) era simile a quanto riportato per il più vecchio strumento RoB 2.

Cosa significa per le future revisioni delle prove

Nonostante la piccola dimensione del campione, questo studio di fattibilità mostra che diversi modelli linguistici di grandi dimensioni possono raggiungere almeno un accordo moderato con i revisori umani nell’applicazione di ROBUST-RCT, uno strumento di valutazione del rischio di bias più semplice per gli studi clinici. Nella pratica, tali modelli potrebbero fungere da “terzo revisore” per risolvere pareggi, segnalare errori probabili o pre-selezionare gli studi in modo che gli esperti umani si concentrino sui casi più complessi o controversi. Gli autori sottolineano che l’IA non sostituirà il giudizio umano e che vanno affrontate questioni etiche — come la privacy dei dati, l’addestramento su materiale coperto da copyright e il rischio di eccessiva dipendenza da strumenti automatizzati. Tuttavia, i risultati suggeriscono che un’IA opportunamente guidata potrebbe contribuire a mantenere le revisioni sistematiche più aggiornate, permettendo a clinici e comitati di linee guida di dedicare meno tempo alla valutazione tecnica e più tempo a interpretare cosa significhi, per l’assistenza ai pazienti, la totalità delle prove disponibili.

Citazione: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Parole chiave: rischio di bias, studi clinici, revisioni sistematiche, modelli linguistici di grandi dimensioni, medicina basata sulle prove