Clear Sky Science · ja

大規模言語モデルとROBUST-RCTによる臨床試験のバイアス評価:実現可能性研究

患者と医師にとってなぜ重要か

現代医療はどの治療が有効かを判断するために臨床試験に依存していますが、設計が良くてもバイアスがあると誤った結論に導かれることがあります。各試験の隠れた問題を入念にチェックする作業は遅く、複雑であり、医療ガイドラインの更新が何年も遅れる原因になります。本研究は、テキストを読み解析する高度なAIである大規模言語モデルが、新しく簡略化されたツールROBUST-RCTを用いて、臨床試験の信頼性を人間とともにより迅速かつ一貫して評価できるかを検討します。

今日の試験品質の評価方法

臨床試験はしばしばゴールドスタンダードと呼ばれますが、設計上の欠陥、報告の不備、選択的解析などによって歪められることがあります。こうした問題を見つけるために、査読者は一般にCochraneのRisk of Bias 2(RoB 2)チェックリストを使用します。厳密ではあるものの、RoB 2は非常に時間がかかり、専門家でも適用が難しく、査読者間の一致度は控えめです。一方で毎年発表される試験の数は増え続けているのに、系統的レビューに実際に取り込まれる研究の数は追いついておらず、多くのレビューは出版時点で既に古くなっています。この拡大する乖離は、使いやすいツールやAIといった技術的支援への関心を高めています。

新しいツールとAIの役割

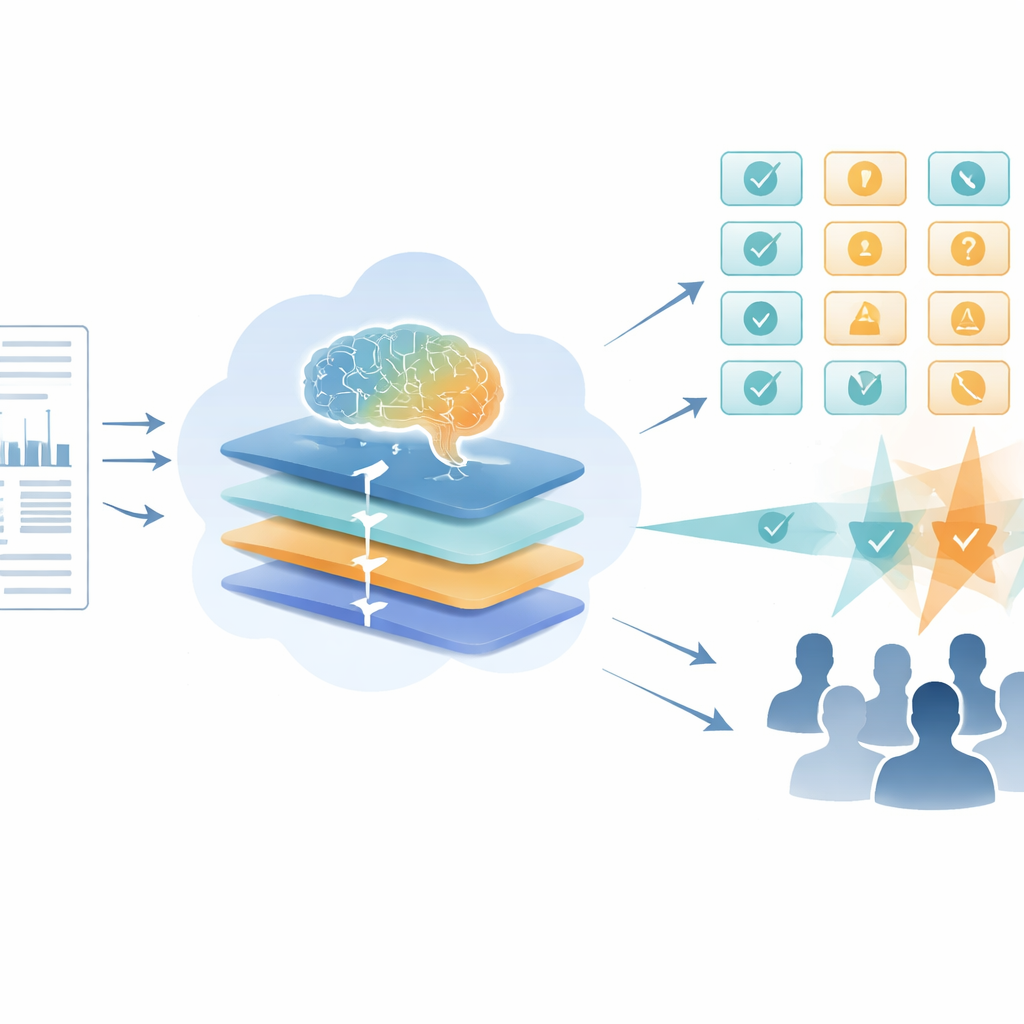

ROBUST-RCTはRoB 2の代替として最近開発されたものです。あらゆるバイアス源を網羅しようとする代わりに、治療効果の歪みに強く関連し、かつ一般的な6つの主要項目に焦点を当てています。このツールは疫学者によって単純さと科学的厳密さのバランスを取るよう設計され、若手査読者での使いやすさも検証されました。ROBUST-RCTはRoB 2より新しく馴染みが薄いため、著者らは機会を見出しました:この簡略化されたチェックリストと大規模言語モデルを組み合わせ、AIが人間の査読者の判断をどの程度確実に支援できるかを検証することです。

研究者たちが実際に試したこと

研究チームはPubMed Centralに収録された医薬品試験から無作為に20件を選び、除外を経て詳細解析には9件のランダム化比較試験を用いました。3名の初期キャリアの医療研究者が独立してROBUST-RCTマニュアルを用いて各試験の主要アウトカムを評価し、意見の不一致はコンセンサス会議で解消しました。同時に、GPT-4-turbo、Gemini 2.5 Pro Preview、DeepSeek-R1、Qwen3-235B-A22Bという4つの異なる大規模言語モデルに、試験の全文PDFとROBUST-RCTの適用方法を詳細に示した段階的指示プロンプトを与えました。核心の問いは、各AIの最終評価がツールの6つの主要項目に関して人間の合意とどれほど一致するか、でした。

AIが人間とどれほど一致したか

一致度を定量化するために、著者らはGwetのAC2という統計指標を使用しました。これはより馴染みのあるKappaより改善されており、不均衡な評価パターンをより適切に扱います。54の人間–AIのペア比較のうち、4モデル中3モデルが確率的にベンチマークした場合に少なくとも「中等度の」信頼性に達しました。つまり、それらの評価はしばしば人間の合意に類似しており、大きな不一致は比較的まれでした。性能はGemini 2.5 Pro Previewが最良(AC2=0.69)、次いでQwen3-235B-A22B(0.65)、GPT-4-turbo(0.60)でした。DeepSeek-R1は最も低く(0.46)、人間よりも試験を偏っていると評価する傾向があり、これは表や図を十分に利用できずテキストのみの抽出に頼ったためかもしれません。注目すべきは、著者らが検討会で議論する前の人間査読者同士の一致(FleissのKappa=0.49)が、古いRoB 2ツールで報告されているものに類似していた点です。

将来のエビデンスレビューにとっての意味

サンプルサイズは小さいものの、この実現可能性研究は、いくつかの現行大規模言語モデルが臨床試験の簡易バイアス評価ツールであるROBUST-RCTを適用する際に、人間の査読者と少なくとも中等度の一致を達成し得ることを示しています。実務上、こうしたモデルは最終判断を下す「第三の査読者」として同点を破る、誤りの可能性を示す、あるいは人間の専門家が最も複雑または争点のあるケースに集中できるよう事前スクリーニングする用途が考えられます。著者らは、AIが人間の判断を置き換えるものではなく、データプライバシー、著作権のある教材での学習、ツールへの過度の依存といった倫理的課題に対処する必要があることを強調しています。それでも、注意深く指示されたAIは系統的レビューをより最新に保つ手助けとなり、臨床医やガイドライン委員会が技術的なスコアリングに費やす時間を減らし、総体としてのエビデンスが患者ケアにとって何を意味するかの解釈により多くの時間を割けるようにする可能性を示唆しています。

引用: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

キーワード: バイアスのリスク, 臨床試験, 系統的レビュー, 大規模言語モデル, エビデンスに基づく医療