Clear Sky Science · pl

Ocena ryzyka błędu w badaniach klinicznych przy użyciu dużych modeli językowych i ROBUST-RCT: badanie wykonalności

Dlaczego to ma znaczenie dla pacjentów i lekarzy

Współczesna medycyna opiera się na badaniach klinicznych przy podejmowaniu decyzji o skuteczności terapii, jednak nawet dobrze zaprojektowane badania mogą wprowadzać w błąd, jeśli zawierają uprzedzenia. Dokładne sprawdzanie każdego badania pod kątem ukrytych problemów jest czasochłonne i złożone, co może opóźniać aktualizację wytycznych medycznych o lata. Niniejsze badanie bada, czy duże modele językowe — zaawansowane systemy AI analizujące tekst — mogą pomóc ludziom szybciej i konsekwentniej oceniać wiarygodność badań klinicznych, stosując nowsze, prostsze narzędzie nazwane ROBUST-RCT.

Jak dziś ocenia się jakość badań

Badania kliniczne często nazywane są złotym standardem, mimo to mogą być zniekształcone przez błędy projektowe, słabe raportowanie lub selektywną analizę. Aby wychwycić takie problemy, recenzenci powszechnie korzystają z listy kontrolnej Cochrane’a Risk of Bias 2 (RoB 2). Choć rygorystyczna, RoB 2 jest znana z tego, że jest czasochłonna, trudna w stosowaniu nawet dla ekspertów i daje tylko umiarkowaną zgodność między różnymi recenzentami. Jednocześnie liczba publikowanych co roku badań rośnie, ale liczba prac trafiających do przeglądów systematycznych nie nadąża, a wiele przeglądów jest już nieaktualnych w momencie publikacji. Ten narastający rozdźwięk pobudził zainteresowanie łatwiejszymi w użyciu narzędziami oraz wsparciem technologicznym od AI.

Nowe narzędzie i rola AI

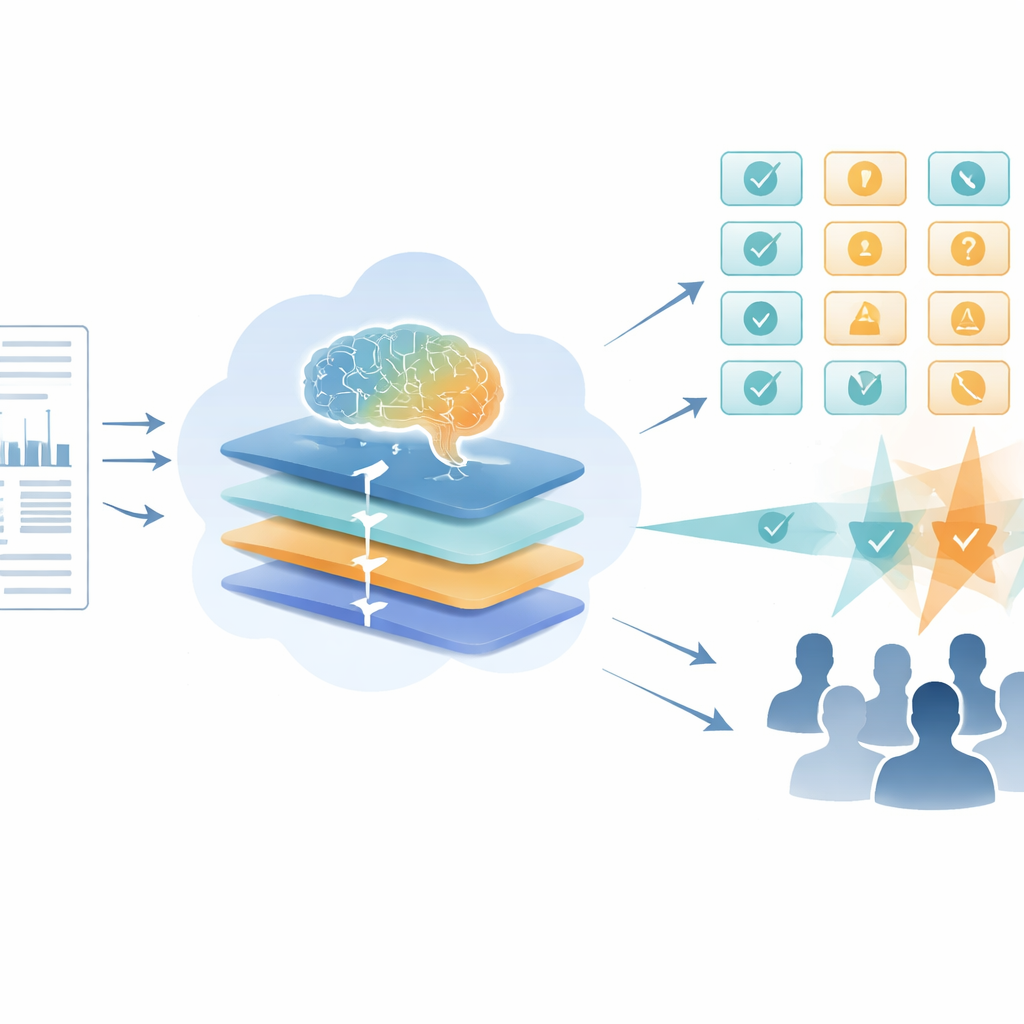

ROBUST-RCT to niedawno opracowana alternatywa dla RoB 2. Zamiast próbować uchwycić każdy możliwy źródło uprzedzenia, koncentruje się na sześciu podstawowych elementach, które są zarówno powszechne, jak i silnie powiązane z zniekształceniem efektów leczenia. Narzędzie zaprojektowali epidemiolodzy, starając się pogodzić prostotę z naukową rzetelnością, i przetestowali jego użyteczność wśród młodszych recenzentów. Ponieważ ROBUST-RCT jest nowsze i mniej znane niż RoB 2, autorzy dostrzegli możliwość: połączyć tę odchudzoną listę kontrolną z dużymi modelami językowymi, aby sprawdzić, czy AI może wiarygodnie wspomagać ocenę uprzedzeń w badaniach razem z recenzentami ludzkimi.

Co dokładnie zbadano

Zespół losowo wybrał 20 badań dotyczących leków zindeksowanych w PubMed Central i po wykluczeniach pozostało 9 randomizowanych badań kontrolowanych do szczegółowej analizy. Trzech początkujących badaczy medycznych niezależnie stosowało podręcznik ROBUST-RCT, aby ocenić wynik pierwotny każdego badania, a następnie rozwiązywali wszelkie rozbieżności podczas spotkań konsensusowych. Równolegle cztery różne duże modele językowe — GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 oraz Qwen3-235B-A22B — otrzymały pełne pliki PDF badań wraz ze szczegółową, krok po kroku instrukcją wyjaśniającą, jak stosować ROBUST-RCT. Kluczowe pytanie brzmiało: na ile końcowe oceny każdego AI pokrywały się z ludzkim konsensusem w obrębie sześciu głównych elementów narzędzia?

Jak dobrze AI zgadzały się z ludźmi

Aby zmierzyć zgodność, autorzy użyli statystyki zwanej AC2 Gweta, która ulepsza bardziej znane wskaźniki Kappa i lepiej radzi sobie z nierównymi wzorcami oceniania. W 54 sparowanych porównaniach człowiek–AI trzy z czterech modeli osiągnęły przynajmniej „umiarkowaną” wiarygodność, gdy porównywano je probabilistycznie, co oznacza, że ich oceny często były zbliżone do konsensusu ludzkiego, a duże rozbieżności występowały rzadko. Najlepiej wypadł Gemini 2.5 Pro Preview (AC2 = 0,69), dalej Qwen3-235B-A22B (0,65) i GPT-4-turbo (0,60). DeepSeek-R1 był najsłabszy (0,46) i miał tendencję do oceniania badań jako bardziej obciążonych uprzedzeniami niż ludzie, prawdopodobnie dlatego, że opierał się tylko na ekstrakcji tekstu i nie mógł w pełni wykorzystać tabel i rysunków. Co istotne, gdy autorzy przyjrzeli się ocenom ludzkim przed spotkaniami konsensusowymi, ich własna zgodność (Kappa Fleiss’a = 0,49) była podobna do tej, którą odnotowano dla starszego narzędzia RoB 2.

Co to oznacza dla przyszłych przeglądów dowodów

Mimo niewielkiej liczby przypadków to badanie wykonalności pokazuje, że kilka obecnych dużych modeli językowych może osiągnąć co najmniej umiarkowaną zgodność z recenzentami ludzkimi przy stosowaniu ROBUST-RCT, prostszego narzędzia do oceny ryzyka błędu w badaniach klinicznych. W praktyce takie modele mogłyby ostatecznie pełnić rolę „trzeciego recenzenta” rozstrzygającego remisy, sygnalizować prawdopodobne błędy lub wstępnie przeglądać prace, tak aby eksperci ludzcy mogli skupić się na najbardziej złożonych lub spornych przypadkach. Autorzy podkreślają, że AI nie zastąpi ludzkiego osądu i że trzeba rozwiązać kwestie etyczne — takie jak prywatność danych, trenowanie na materiałach objętych prawami autorskimi oraz ryzyko nadmiernego polegania na narzędziach zautomatyzowanych. Niemniej jednak wyniki sugerują, że starannie ukierunkowane AI mogłoby pomóc aktualizować przeglądy systematyczne, pozwalając klinicystom i panelom wytycznych spędzać mniej czasu na technicznym punktowaniu, a więcej na interpretowaniu, co całość dowodów oznacza dla opieki nad pacjentem.

Cytowanie: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Słowa kluczowe: ryzyko błędu, badania kliniczne, przeglądy systematyczne, duże modele językowe, medycyna oparta na dowodach