Clear Sky Science · nl

Beoordeling van het risico op bias van klinische onderzoeken met grote taalmodellen en ROBUST-RCT: een haalbaarheidsstudie

Waarom dit belangrijk is voor patiënten en artsen

Moderne geneeskunde is afhankelijk van klinische onderzoeken om te bepalen welke behandelingen werken, maar zelfs goed opgezette studies kunnen misleidend zijn als ze bevooroordeeld zijn. Elk onderzoek zorgvuldig controleren op verborgen problemen is traag en complex werk dat bijgewerkte medische richtlijnen jaren kan vertragen. Deze studie onderzoekt of grote taalmodellen — geavanceerde AI-systemen die tekst lezen en analyseren — mensen kunnen helpen om sneller en consistenter te beoordelen hoe betrouwbaar klinische onderzoeken zijn, met behulp van een nieuwer, eenvoudiger instrument genaamd ROBUST-RCT.

Hoe de kwaliteit van onderzoeken nu wordt beoordeeld

Klinische onderzoeken worden vaak het gouden standaard genoemd, maar ze kunnen nog steeds vertekend raken door ontwerpfouten, slechte rapportage of selectieve analyse. Om deze problemen te ontdekken gebruiken beoordelaars vaak de Risk of Bias 2 (RoB 2) checklist van Cochrane. Hoewel rigoureus, is RoB 2 berucht om zijn tijdsintensieve karakter, de moeilijkheid om het zelfs voor deskundigen toe te passen, en het feit dat verschillende beoordelaars vaak slechts matig overeenkomen. Tegelijkertijd neemt het aantal gepubliceerde onderzoeken elk jaar toe, maar het aantal studies dat daadwerkelijk in systematische reviews terechtkomt blijft achter, en veel reviews zijn al verouderd op het moment van publicatie. Deze groeiende kloof heeft de interesse aangewakkerd in gebruiksvriendelijkere instrumenten en technologische hulp vanuit AI.

Een nieuw instrument en een rol voor AI

ROBUST-RCT is een recent ontwikkeld alternatief voor RoB 2. In plaats van te proberen elke mogelijke bron van bias te vangen, richt het zich op zes kernpunten die zowel veelvoorkomend zijn als sterk gerelateerd aan vertekende behandelings-effecten. Het instrument is door epidemiologen ontworpen om een balans te vinden tussen eenvoud en wetenschappelijke degelijkheid en is getest op bruikbaarheid met beginnende beoordelaars. Omdat ROBUST-RCT nieuwer en minder bekend is dan RoB 2, zagen de auteurs een kans: combineer deze gestroomlijnde checklist met grote taalmodellen om te onderzoeken of AI betrouwbaar kan helpen bij het beoordelen van bias in onderzoeken naast menselijke beoordelaars.

Wat de onderzoekers precies hebben getest

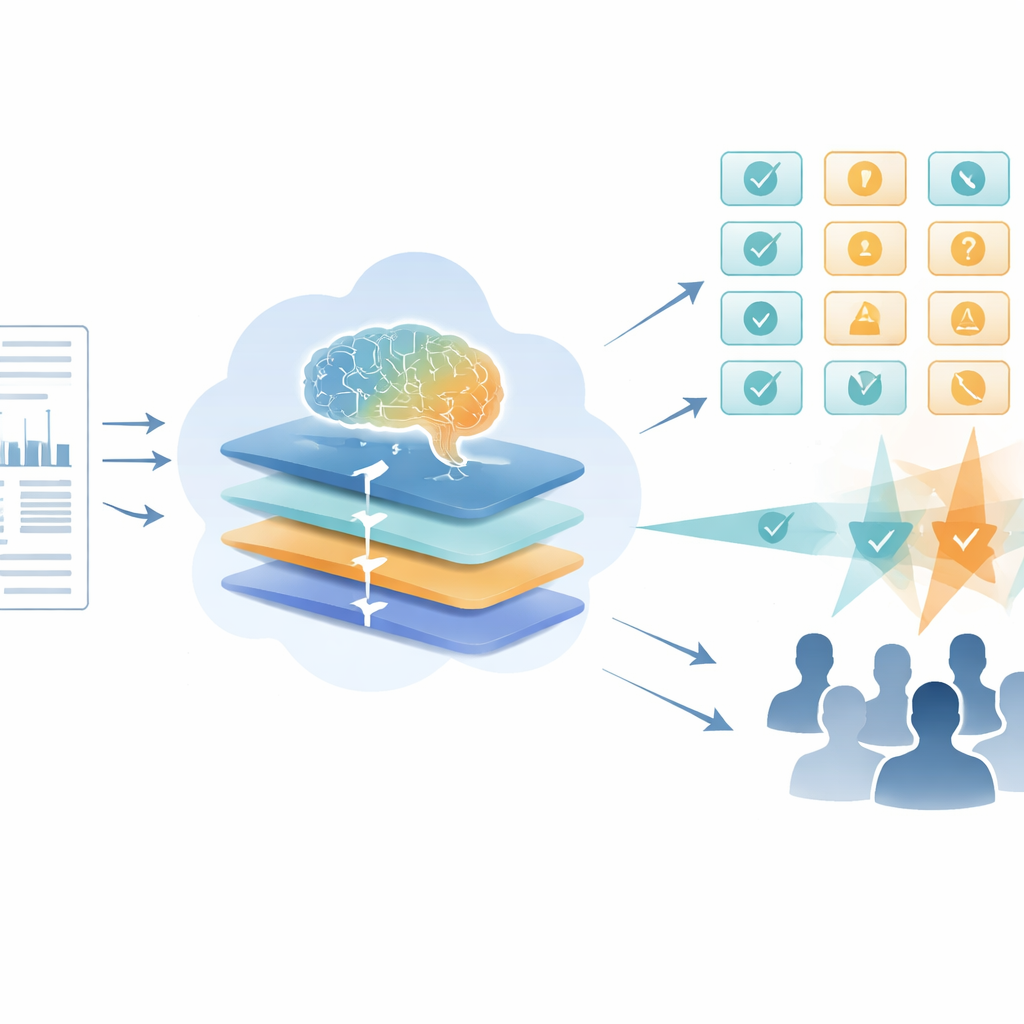

Het team selecteerde willekeurig 20 geneesmiddelonderzoeken uit PubMed Central en kwam, na exclusies, uit op 9 gerandomiseerde gecontroleerde onderzoeken voor gedetailleerde analyse. Drie beginnende medische onderzoekers beoordeelden onafhankelijk het primaire uitkomstmaat van elk onderzoek met behulp van het ROBUST-RCT-handboek en losten eventuele meningsverschillen op in consensusvergaderingen. Parallel daaraan kregen vier verschillende grote taalmodellen — GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 en Qwen3-235B-A22B — de volledige onderzoekspdfs plus een gedetailleerde, stapsgewijze instructieprompt die uitlegt hoe ROBUST-RCT moet worden toegepast. De kernvraag was: hoe nauwkeurig kwamen de eindbeoordelingen van elk AI-model overeen met de menselijke consensus over de zes hoofditems van het instrument?

Hoe goed de AI’s overeenkwamen met mensen

Om overeenstemming te kwantificeren gebruikten de auteurs een statistiek genaamd Gwet’s AC2, die verbeteringen biedt ten opzichte van meer bekende Kappa-scores en beter omgaat met ongelijke beoordelingspatronen. Over 54 gekoppelde mens–AI-vergelijkingen bereikten drie van de vier modellen ten minste een “matige” betrouwbaarheid wanneer probabilistisch gebenchmarkt, wat betekent dat hun beoordelingen vaak overeenkwamen met die van de menselijke consensus en grote meningsverschillen relatief zeldzaam waren. Gemini 2.5 Pro Preview presteerde het best (AC2 van 0,69), gevolgd door Qwen3-235B-A22B (0,65) en GPT-4-turbo (0,60). DeepSeek-R1 was het zwakst (0,46) en neigde ertoe onderzoeken als meer bevooroordeeld te beoordelen dan mensen deden, mogelijk omdat het afhankelijk was van tekstanalyse alleen en tabellen en figuren niet volledig kon benutten. Opmerkelijk is dat, wanneer de auteurs alleen naar de menselijke beoordelaars keken voordat zij bijeenkwamen om te overleggen, hun onderlinge overeenstemming (Fleiss’ Kappa van 0,49) vergelijkbaar was met wat voor het oudere RoB 2-instrument is gerapporteerd.

Wat dit betekent voor toekomstige evidence reviews

Ondanks de kleine steekproefgrootte toont deze haalbaarheidsstudie aan dat meerdere huidige grote taalmodellen ten minste matige overeenstemming kunnen bereiken met menselijke beoordelaars bij het toepassen van ROBUST-RCT, een eenvoudiger instrument om het risico op bias in klinische onderzoeken te beoordelen. In de praktijk zouden zulke modellen uiteindelijk kunnen dienen als een “derde beoordelaar” om beslissingen te beslechten, waarschijnlijk foutieve beoordelingen te signaleren, of studies voor te screenen zodat menselijke experts zich kunnen concentreren op de meest complexe of betwiste gevallen. De auteurs benadrukken dat AI het menselijk oordeel niet zal vervangen en dat ethische kwesties — zoals gegevensprivacy, trainen op auteursrechtelijk beschermd materiaal en het risico van te veel vertrouwen op geautomatiseerde hulpmiddelen — moeten worden aangepakt. Toch suggereren de bevindingen dat zorgvuldig begeleide AI kan helpen systematische reviews actueel te houden, waardoor clinici en richtlijncommissies minder tijd kwijt zijn aan technische scores en meer tijd kunnen besteden aan het interpreteren wat het geheel van bewijs betekent voor de patiëntenzorg.

Bronvermelding: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Trefwoorden: risico op bias, klinische onderzoeken, systematische reviews, grote taalmodellen, evidence-based medicine